Clear Sky Science · pl

Rzetelne oszacowania niepewności w głębokim uczeniu przy użyciu efektywnych algorytmów Metropolisa-Hastingsa

Dlaczego inteligentniejsza niepewność ma znaczenie

Od badań medycznych po samochody autonomiczne—współczesna sztuczna inteligencja często podejmuje decyzje, w których pewne, lecz błędne przekonanie może być niebezpieczne. Standardowe systemy uczenia głębokiego świetnie rozpoznają wzorce, ale mają słabą zdolność do komunikowania, jak bardzo są niepewne. Ten artykuł zajmuje się tą luką: przedstawia nowe sposoby wyposażenia głębokich sieci neuronowych w wiarygodne miary niepewności, przy jednoczesnym opanowaniu dużych kosztów obliczeniowych tradycyjnych metod bayesowskich.

Od strzałów do zmierzonej pewności

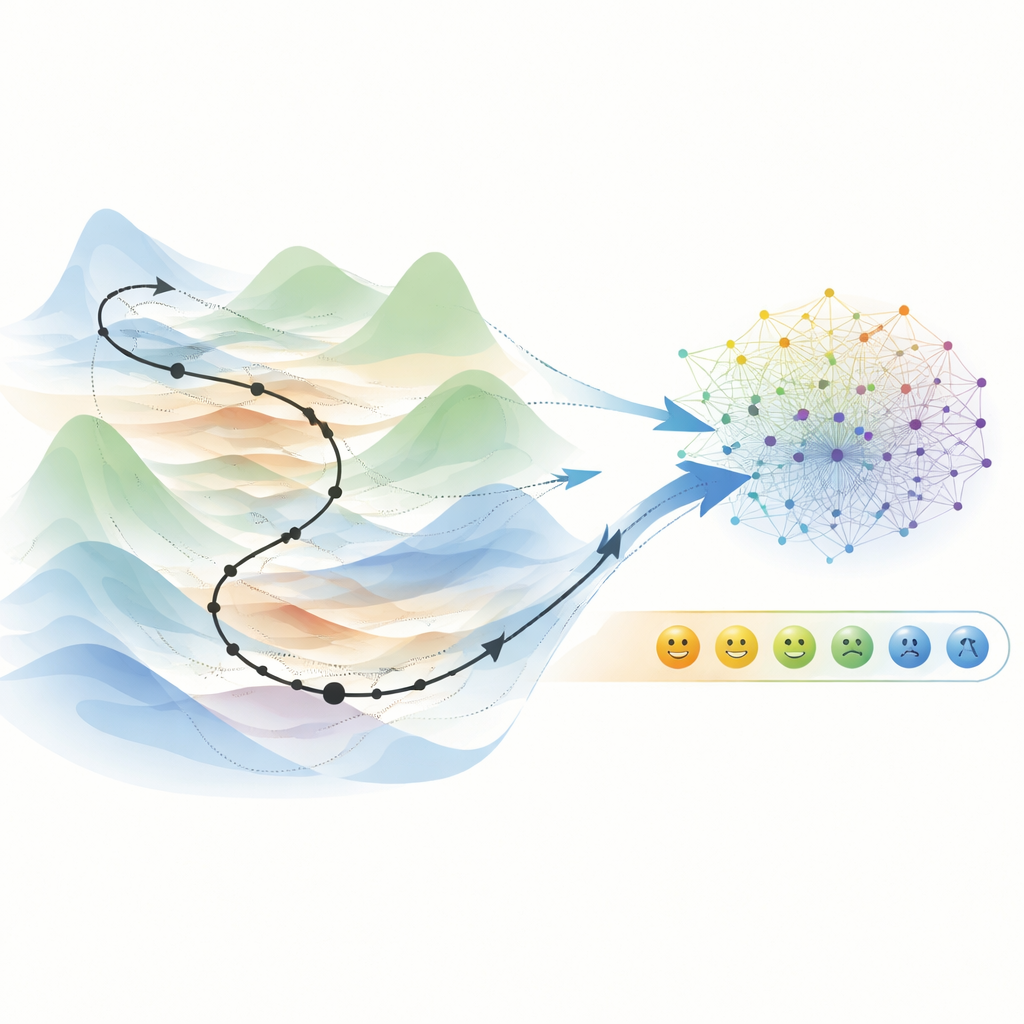

W codziennym uczeniu głębokim model jest trenowany raz, a następnie używany „jak jest”. Zwraca jedną najlepszą prognozę, ale niewiele mówi o jej wiarygodności. Bayesowskie sieci neuronowe idą inną drogą: zamiast ustalać jedną konfigurację parametrów, traktują parametry jako losowe i starają się uchwycić całą dystrybucję możliwych modeli. Średkowanie predykcji w ramach tej kolekcji może ujawnić zarówno najbardziej prawdopodobną odpowiedź, jak i stopień zaufania modelu do siebie. Wyzwanie polega na tym, że dokładne próbkowanie z tej dystrybucji metodami rzetelnymi, takimi jak Hamiltonian Monte Carlo, jest niezwykle kosztowne dla dzisiejszych dużych sieci i zbiorów danych.

Szybsze próbkowanie bez utraty obrazu całości

Autorzy koncentrują się na rodzinie metod zwanych stochastycznym gradientowym Hamiltonian Monte Carlo, które już wykorzystują pomysły ze standardowego treningu—mini-batche i zaszumione gradienty—by przyspieszyć próbkowanie. Brakuje jednak wiarygodnego „filtra”, który decydowałby, które tymczasowe aktualizacje parametrów zachować. W klasycznym Hamiltonian Monte Carlo tę rolę pełni krok akceptacji Metropolisa-Hastingsa, korygujący błędy numeryczne i zapobiegający dryfowi próbkera w złe rejony. Wprowadzenie tego kroku akceptacji do zaszumionego, mini-batchowego świata głębokiego uczenia jest trudne, ponieważ zwykle wymaga oceny na pełnym zbiorze danych i może blokować postęp, gdy wskaźniki akceptacji są zbyt niskie.

Dwa nowe sposoby przemieszczania się po krajobrazie

Artykuł wprowadza dwie komplementarne strategie. Pierwsza, nazwana uogólnionym stochastycznym gradientowym Hamiltonian Monte Carlo (GSGHMC), projektuje test akceptacji działający na mini-batchach, zachowując jednocześnie istotną własność: rzeczywiste optima problemu z pełnym zbiorem danych są nadal poprawnie rozpoznawane. Wykorzystuje starannie dobrany całkownik numeryczny, dzięki czemu akceptacja krok po kroku pozostaje stabilna, mimo że widzi tylko wycinek danych na raz. Daje to wydajny sampler, który pozostaje blisko prawdziwego bayesowskiego obrazu i generuje zespoły modeli o szczególnie dobrze skalibrowanych ocenach pewności.

Przejażdżki długimi trajektoriami dla lepszych predykcji

Druga metoda, Hamiltonian Trajectory Ensemble (HTE), dokonuje świadomego kompromisu: zamiast upierać się przy dokładnym zachowaniu bayesowskim, faworyzuje długie, napędzane pędem wędrówki po przestrzeni parametrów, które przypominają agresywne sesje treningowe. Na końcu każdej takiej trajektorii stosuje się test w stylu Metropolisa, decydujący, czy zachować uzyskany snapshot modelu. Ponieważ te ścieżki mają tendencję do osiadania w szerokich, uogólnialnych dolinach funkcji straty, zebrane modele tworzą zróżnicowany, lecz skoncentrowany zespół. W benchmarkach klasyfikacji obrazów, takich jak EMNIST i CIFAR-10, HTE poprawia dokładność nawet o około sześć punktów procentowych względem silnych bayesowskich baz, oraz o kilka punktów względem zwykłego deterministycznego treningu, oferując jednocześnie użyteczne informacje o niepewności i silne wykrywanie danych spoza rozkładu.

Mniejsze zespoły, mądrzejsze użycie

Próbkowanie setek lub tysięcy modeli brzmi drogo w fazie testowej, dlatego autorzy badają też, ilu członków zespołu naprawdę potrzeba. Poprzez chciwe odrzucanie modeli, które mają niewielki wpływ na wydajność, stwierdzają, że zwykle można zachować około jednej trzeciej zespołu bez pogorszenia dokładności, choć utrzymanie bardzo ostrej kalibracji zazwyczaj wymaga więcej członków. W zadaniach obrazowych i chaotycznym problemie prognozowania szeregów czasowych ich metody konsekwentnie przewyższają lub dorównują popularnym alternatywom, takim jak wnioskowanie wariacyjne, Monte Carlo dropout czy prostsze głębokie zespoły, choć kosztem wyższego nakładu treningowego niż w przypadku czysto deterministycznego uczenia.

Co to oznacza dla praktycznej sztucznej inteligencji

Dla osoby niespecjalizującej się kluczowy przekaz jest taki, że możemy uczynić uczenie głębokie nie tylko dokładnym, lecz też uczciwym wobec tego, czego nie wie, bez potrzeby zasobów na poziomie superkomputerów. Poprzez staranne splecenie klasycznych idei próbkowania z nowoczesnym, opartym na mini-batchach treningiem, proponowane podejścia dostarczają lepszych predykcji i bardziej wiarygodnych oszacowań pewności niż wiele istniejących technik. To połączenie efektywności, odporności i skalibrowanej niepewności to kluczowy krok w kierunku bezpiecznego wdrażania uczenia głębokiego w wrażliwych dziedzinach, gdzie koszt nadmiernej pewności może być mierzony życiem, a nie tylko punktami procentowymi.

Cytowanie: Schmal, M., Mäder, P. Reliable uncertainty estimates in deep learning with efficient Metropolis-Hastings algorithms. Nat Commun 17, 2531 (2026). https://doi.org/10.1038/s41467-026-70015-z

Słowa kluczowe: Bayesowskie sieci neuronowe, ocena niepewności, Hamiltonian Monte Carlo, zespoły w głębokim uczeniu, stochastyczne gradientowe MCMC