Clear Sky Science · pl

Równowartościowy wstępnie wytrenowany transformer do zunifikowanego uczenia reprezentacji 3D cząsteczek

Nauka komputerów widzenia cząsteczek w 3D

Projektowanie nowych leków i materiałów zależy od zrozumienia, jak cząsteczki wyglądają i poruszają się w trzech wymiarach, a nie tylko jako płaskie wzory na papierze. W artykule przedstawiono potężny nowy model sztucznej inteligencji, który potrafi uczyć się na podstawie trójwymiarowych kształtów wielu rodzajów cząsteczek naraz — od małych związków przypominających leki po duże białka i ich kompleksy — i następnie wykorzystać tę wiedzę do przewidywania, jak silnie wchodzą ze sobą w interakcje oraz które z nich mogą stać się przyszłymi lekami.

Jedna mapa dla wielu molekularnych światów

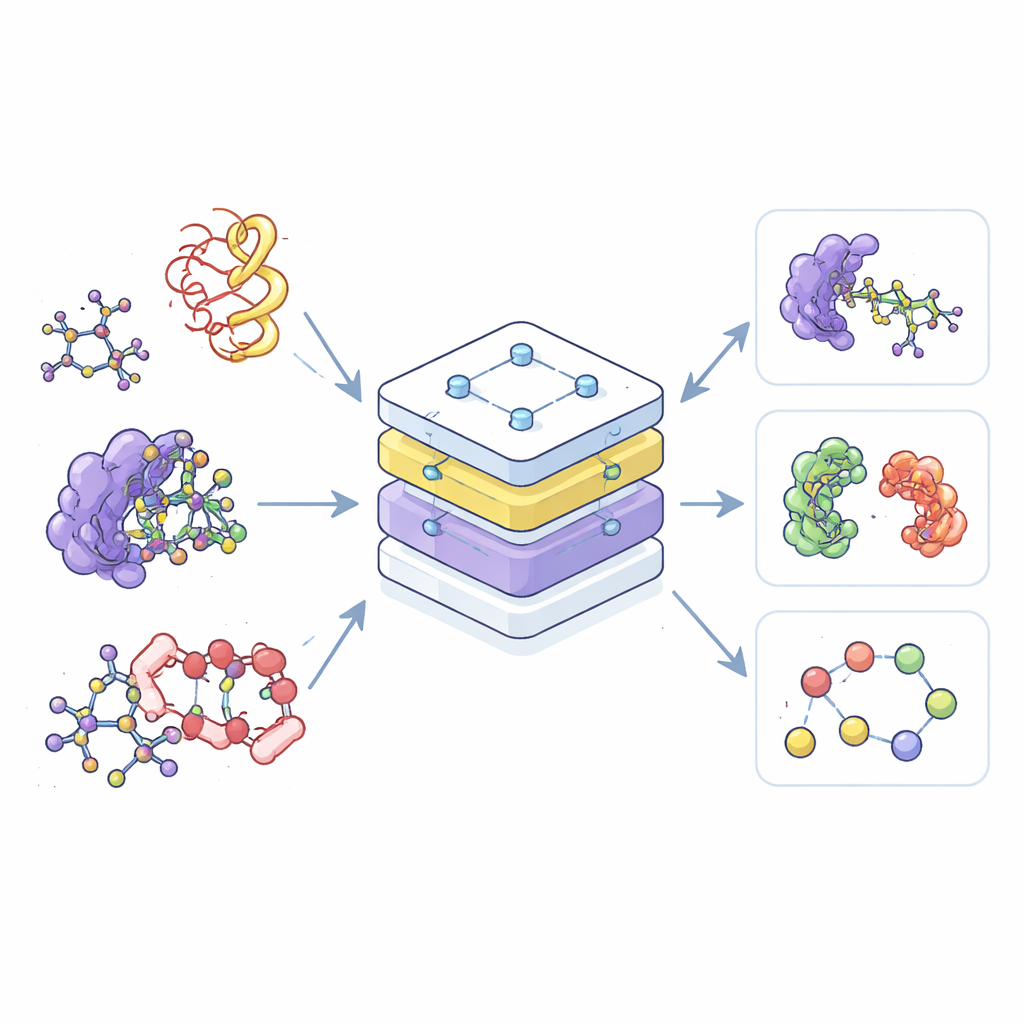

Większość obecnych narzędzi AI w chemii to specjaliści: jeden jest trenowany tylko na małych cząsteczkach, inny tylko na białkach, a trzeci tylko na ich kompleksach. Taki podział marnuje dane i utrudnia przenoszenie zdobytej wiedzy z jednej dziedziny do drugiej. Autorzy budują zamiast tego pojedynczy model „fundacyjny”, nazwany Equivariant Pretrained Transformer (EPT), który uczy się na ogromnej kolekcji struktur 3D pobranych z wielu publicznych baz danych. Traktując wszystkie te struktury w jednym wspólnym ramach, model potrafi rozpoznawać wspólne wzorce w rozmieszczeniu i interakcjach atomów, niezależnie od tego, czy należą do prostej cząsteczki leku, czy do złożonego splotu łańcuchów białkowych.

Rozbijanie cząsteczek na przystępne części

Aby poradzić sobie z ogromną różnorodnością i rozmiarem układów molekularnych, badacze wprowadzają pojęcie „bloków” — niewielkich, sensownych fragmentów atomów. Dla małych cząsteczek blok grupuje atom ciężki z dołączonymi wodorem; dla białek każdy aminokwas staje się blokiem. Podczas treningu model widzi zarówno drobiazgowe atomy, jak i grubsze struktury blokowe, co pozwala mu łączyć lokalne szczegóły chemiczne z szerszymi kształtami 3D, takimi jak kręgosłupy białkowe czy kieszenie wiążące. Ten widok blokowy tworzy również wspólny język działający w bardzo różnych typach cząsteczek, umożliwiając jednemu modelowi ich zrozumienie.

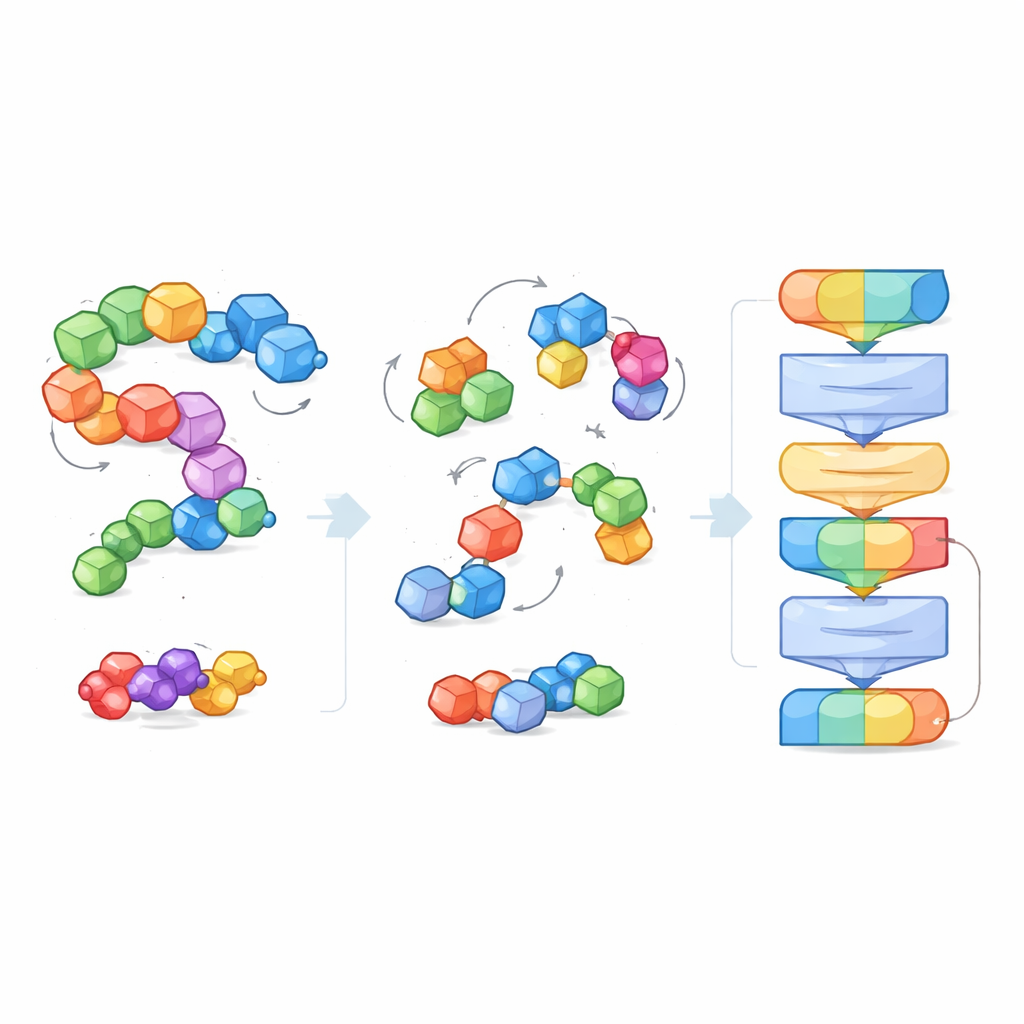

Uczenie przez naprawianie zaszumionych struktur

Zamiast otrzymywać explicite etykiety typu „ta cząsteczka jest rozpuszczalna” lub „ta silnie wiąże”, EPT jest trenowany w trybie samonadzorowanym. Autorzy celowo zaburzają każdy blok molekularny, losowo przesuwając i obracając go względem prawdziwej pozycji, a następnie proszą model o wywnioskowanie sił i momentów potrzebnych do przywrócenia oryginalnej struktury. Ponieważ trening respektuje fundamentalne reguły geometryczne — cząsteczka powinna wyglądać tak samo, jeśli cały układ zostanie obrócony lub przesunięty w przestrzeni — model uczy się fizycznie sensownego rozumienia kształtu 3D. Ta gra denoisingowa uczy EPT, jak atomy wewnątrz i między blokami się trzymają oraz jak subtelne zmiany geometrii wpływają na stabilność.

Próba modelu w praktyce

Po wstępnym treningu na ponad pięciu milionach struktur EPT jest dostrajany do kilku rzeczywistych zadań naukowych. Przewiduje, jak silnie mała cząsteczka wiąże się z kieszenią białka, jak pojedyncza mutacja na interfejsie białkowym wpływa na wiązanie oraz kluczowe właściwości fizyczne małych cząsteczek istotne dla chemików. W różnych benchmarkach zunifikowany model dorównuje lub przewyższa najlepsze istniejące narzędzia, w tym te starannie dostosowane do jednego tylko obszaru. Co istotne, gdy jest trenowany na jednym typie danych, na przykład małych cząsteczkach, wciąż pomaga w pozornie odmiennych zadaniach, takich jak wiązanie białek, co ujawnia, że uchwycił szeroko użyteczne zasady chemiczne, a nie wąskie sztuczki.

Poszukiwanie nowych terapii na COVID‑19

Autorzy dodatkowo demonstrują praktyczną użyteczność EPT, stosując go do wyzwania związanego z repurposingiem leków. Najpierw dostrajają model na kompleksach białko–ligand, a następnie używają go do uszeregowania prawie 2000 już zatwierdzonych leków według przewidywanej zdolności wiązania głównej proteazy SARS‑CoV‑2, kluczowego enzymu niezbędnego wirusowi do replikacji. Znane leki przeciw COVID‑19 przesuwają się ku górze rankingu, a model wskazuje dodatkowe obiecujące kandydatury. Dwanaście najwyżej ocenionych cząsteczek badano dokładniej za pomocą symulacji komputerowych, a dwie — w tym jedna pierwotnie nie opracowana pod kątem COVID‑19 — wykazują szczególnie silne przewidywane wiązanie i zostały eksperymentalnie potwierdzone jako hamujące proteazę wirusa w stężeniach mikromolarnych.

Krok w stronę ogólnej molekularnej AI

Mówiąc prostymi słowami, praca ta pokazuje, że jeden, świadomy geometrycznie model AI może nauczyć się wspólnego 3D rozumienia wielu systemów molekularnych i następnie wykorzystać to do odpowiedzi na szeroki zakres pytań naukowych. Organizując cząsteczki w bloki i trenując model do „naprawiania” zniekształconych struktur, autorzy stworzyli narzędzie, które nie tylko przewiduje wartości z większą dokładnością, ale także może przyspieszyć zadania takie jak znajdowanie nowych leków przeciwwirusowych. EPT wskazuje drogę ku przyszłości, w której ogólnego przeznaczenia systemy AI dla molekuł pomagają chemikom i biologom efektywniej eksplorować przestrzeń chemiczną, kierując eksperymentami i skracając drogę od struktury atomowej do praktycznych terapii i materiałów.

Cytowanie: Jiao, R., Kong, X., Zhang, L. et al. An equivariant pretrained transformer for unified 3D molecular representation learning. Nat Commun 17, 2606 (2026). https://doi.org/10.1038/s41467-026-69185-7

Słowa kluczowe: reprezentacja cząsteczek 3D, równowartościowy transformer, poszukiwanie leków, wiązanie białko–ligand, uczenie w trybie samonadzorowanym