Clear Sky Science · pl

Obliczenia blisko sensora wzorowane na wzroku sowy

Widzieć w ciemności jak sowa

Wyobraź sobie drona, który potrafi dostrzec zagubionego wędrowca lub odległy statek kosmiczny bez żadnych reflektorów, nawet przy blasku gwiazd tak słabym, że zwykłe kamery prawie nic nie widzą. Artykuł opisuje nowy sprzęt wizyjny inspirowany sowami, który przybliża taką możliwość do realizacji. Naśladując sposób, w jaki oczy sowy adaptują się do ciemności oraz jak jej mózg efektywnie przetwarza słabe sygnały, badacze skonstruowali maleńki elektroniczny „synaps”, który równocześnie wykrywa słabe światło i wykonuje część obliczeń potrzebnych do rozpoznawania — bezpośrednio na sensorze.

Dlaczego istniejące maszyny mają problemy w nocy

Współczesna sztuczna inteligencja potrafi rozpoznawać twarze, obiekty i sceny z imponującą dokładnością, ale zwykle wymaga do tego mocnych układów zużywających ogromne ilości energii. Konwencjonalne kamery oddzielają sensorykę od obliczeń: najpierw kamera rejestruje obraz, potem odległe procesory przetwarzają dane. W bardzo słabym świetle te kamery zazwyczaj zawodzą, chyba że wspomagane są silnymi lampami lub intensywną cyfrową obróbką. Dla kontrastu, oko i mózg sowy współdziałają: siatkówka akumuluje maleńkie strumienie fotonów w czasie, a jej obwody nerwowe adaptują się tak, że przyćmione kształty stopniowo stają się widoczne. Autorzy dążą do przeniesienia podobnej, ściśle zintegrowanej i energooszczędnej strategii do maszynowego widzenia.

Maleńkie urządzenie, które uczy się od światła

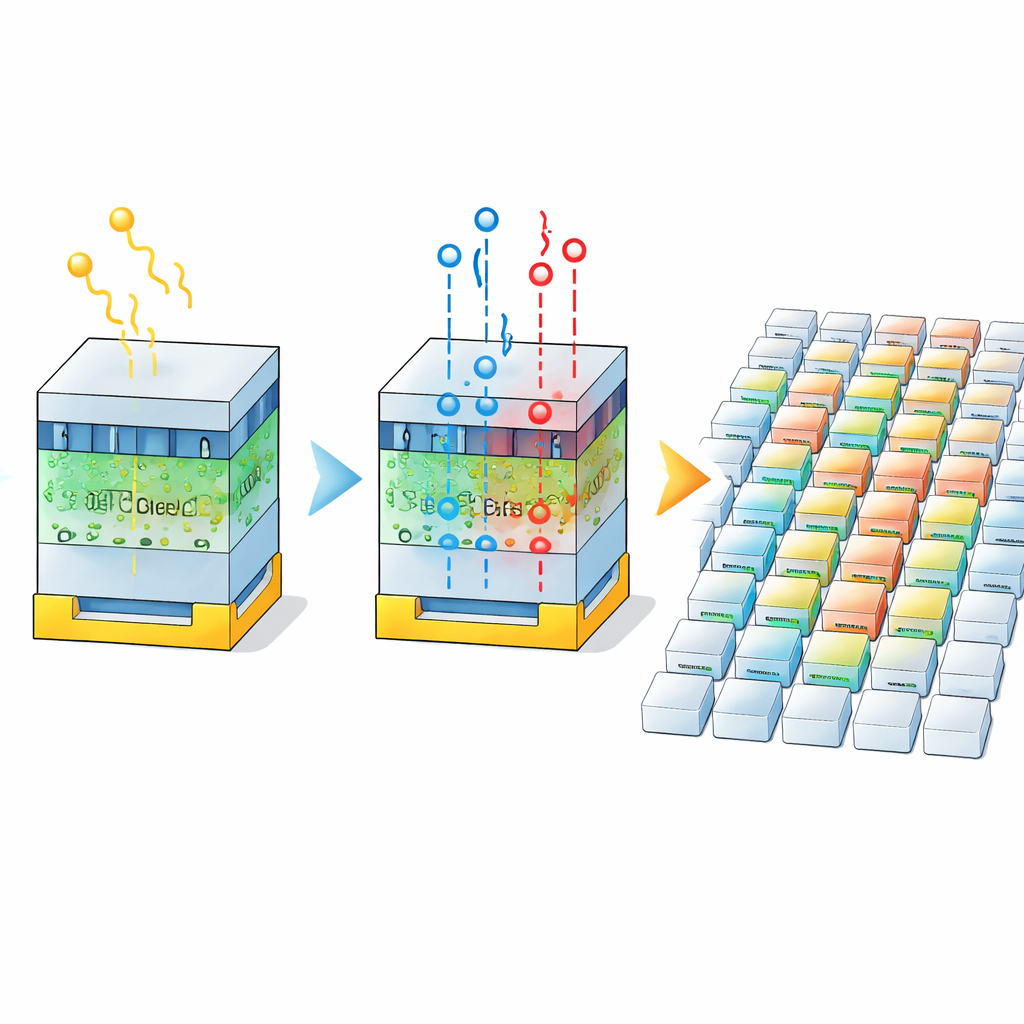

W centrum pracy znajduje się „inspirowana sową dwutrybowa adaptacyjna synapsa” — małe urządzenie oparte na tranzystorze, które działa jednocześnie jak czujnik światła i jak uczące się połączenie między komórkami nerwowymi. Urządzenie jest zbudowane warstwowo: przezroczysta dolna elektroda, dielektryk zdolny do pułapkowania ładunków, specjalnie zaprojektowana warstwa absorbująca światło i organiczny kanał półprzewodnikowy na wierzchu. Gdy pada na warstwę absorbującą słabe światło, wytwarzane są nieliczne nośniki ładunku, które pod kierunkiem przyłożonego napięcia zostają uwięzione w dielektryku i zgromadzone w kanale. To stopniowo zwiększa odpowiedź elektryczną urządzenia, podobnie jak komórki pręcikowe w siatkówce sowy stają się bardziej czułe w miarę adaptacji do ciemności. Autorzy pokazują, że ich układ może reagować na natężenia światła rzędu 0,146 nanowata na centymetr kwadratowy — mniej więcej o trzy rzędy wielkości słabiej niż to, co są w stanie obsłużyć standardowe matryce kamer — jednocześnie wykazując silne, regulowane wzmocnienie, które mierzy jego adaptację do ciemności.

Działając jak sztuczna synapsa

Później urządzenie nie tylko wykrywa światło, lecz także naśladuje sposób, w jaki biologiczne synapsy wzmacniają się lub osłabiają w odpowiedzi na aktywność. Pod wpływem powtarzających się impulsów świetlnych w szerokim zakresie długości fal, od ultrafioletu do bliskiej podczerwieni, prąd urządzenia zwiększa się skokami, przechowując pamięć o optycznej historii. Pod wpływem impulsów elektrycznych przyłożonych do bramki wykazuje długotrwałe wzmocnienie i osłabienie — stopniowe, odwracalne zmiany przewodności kodujące „wagi” synaptyczne w sztucznych sieciach neuronowych. Te wagi są przechowywane nieulotnie, co oznacza, że urządzenie pamięta je bez stałego zasilania, i można je regulować na wielu poziomach, jak wartość wielobitowa. Co istotne, każde zdarzenie synaptyczne zużywa energię rzędu 10 femtodżuli, porównywalną lub nawet niższą od szacunków dla synaps biologicznych, i wielokrotnie mniejszą niż budżety energetyczne typowego sprzętu AI.

Od pojedynczej synapsy do systemu wzrokowego

Aby potwierdzić, że zachowanie utrzymuje się w skali, zespół wytworzył macierz 19 na 17 urządzeń i wykazał, że działają one jednorodnie. Gdy na macierz rzutowany jest słaby wzór świetlny, prądy fotogeniczne w naświetlonych punktach stopniowo rosną podczas adaptacji, ujawniając wcześniej ukryte kształty przy ultrasłabym oświetleniu — tak jak siatkówka sowy wyostrza obraz w ciemności. Autorzy następnie odwzorowują wielopoziomowe stany przewodności urządzenia na wagi w modelach uczenia maszynowego, w tym proste perceptrony wielowarstwowe, sieci konwolucyjne i głęboką architekturę w stylu VGG. Nawet przy stosunkowo grubych, dyskretnych wagach symulowane sieci osiągają ponad 90 procent dokładności na standardowych zbiorach obrazów, co pokazuje, że stany synaptyczne są wystarczające do praktycznych obliczeń.

Nocne widzenie dla dronów i nie tylko

Aby zilustrować potencjał w zastosowaniach, badacze symulowali system rozpoznawania powietrze‑ziemia zamontowany na małym dronie, trenowany do wykrywania celu o kształcie ubioru przy różnych poziomach jasności odpowiadających warunkom oświetlenia gwiazdami. Poprzez powiązanie zależnej od czasu odpowiedzi urządzenia z kontrastem przechwyconych obrazów, zbudowali etap wstępnego przetwarzania, który „adaptuje” obraz, wzmacniając użyteczny kontrast przy jednoczesnym zachowaniu realistycznego zachowania sensora. Popularna sieć do wykrywania obiektów (YOLOv5) szkolona na tych zaadaptowanych danych osiąga ponad 95 procent dokładności rozpoznawania nawet przy najniższym testowanym poziomie światła. Mówiąc prosto, praca pokazuje, że łącząc sówkopodobną adaptację do ciemności z wbudowanym uczeniem synaptycznym bezpośrednio przy sensorze, można przesunąć granice widzenia maszynowego w warunki, w których tradycyjne kamery zawodzą, przy znacznie mniejszym zużyciu energii. Taka technologia mogłaby w przyszłości zasilać drony poszukiwawczo‑ratunkowe, autonomicznych eksploratorów lub instrumenty astronomiczne, które widzą więcej, świecąc mniej.

Cytowanie: Zhao, Z., Cao, Y., Huang, S. et al. Owl-vision-inspired near sensor computing. Nat Commun 17, 2676 (2026). https://doi.org/10.1038/s41467-026-69123-7

Słowa kluczowe: widzenie w słabym świetle, czujnik neuromorficzny, obrazowanie inspirowane sowami, obliczenia blisko sensora, detekcja obiektów nocą