Clear Sky Science · pl

Uczenie transferowe w DeepLC poprawia przewidywanie czasu retencji LC dla znacząco różnych modyfikacji i ustawień

Dlaczego przewidywanie czasu reakcji chemicznej ma znaczenie

Za każdym razem, gdy naukowcy badają białka w komórkach, korzystają z techniki, która najpierw przepuszcza maleńkie fragmenty białek, zwane peptydami, przez kolumnę wypełnioną cieczą, a następnie waży je w spektrometrze mas. To, jak długo każdy peptyd spędza w kolumnie — jego „czas retencji” — jest niezwykle pouczające i pomaga badaczom rozpoznać i potwierdzić mierzone związki. Jednak ponieważ każda pracownia używa nieco innych instrumentów i ustawień, modele komputerowe przewidujące te czasy często zawodzą po przeniesieniu na inne środowisko. Ten artykuł pokazuje, jak współczesny trik z uczenia maszynowego, zwany uczeniem transferowym, może uczynić te przewidywania znacznie bardziej niezawodnymi i elastycznymi w wielu warunkach eksperymentalnych.

Mierzenie podróży fragmentów białek

W badaniach białek chromatografia cieczowo–spektrometria mas jest metodą powszechnie stosowaną. Etap chromatografii cieczowej rozdziela tysiące peptydów na podstawie ich właściwości chemicznych, tak by nie docierały do detektora jednocześnie. Otrzymany czas retencji, wraz z zmierzoną masą peptydu, daje naukowcom potężny dwuwymiarowy odcisk palca. W ciągu ostatniej dekady badacze szkolili modele komputerowe do przewidywania czasu retencji bezpośrednio z sekwencji peptydów. Te przewidywania zwiększają pewność identyfikacji peptydów, pomagają projektować lepsze eksperymenty i są niezbędne do budowy dużych, komputerowo generowanych bibliotek widm używanych we współczesnych przepływach pracy o dużej wydajności.

Problem zmieniających się warunków laboratoryjnych

Niestety czas retencji jest bardzo wrażliwy na szczegóły, takie jak kwasowość rozpuszczalnika, materiał kolumny, ciśnienie i temperatura. Nawet drobne zmiany mogą przetasować kolejność, w jakiej peptydy wychodzą z kolumny. Tradycyjne podejścia próbują temu zaradzić przez „kalibrację” modelu wytrenowanego gdzie indziej za pomocą niewielkiego zestawu referencyjnych peptydów, zakładając, że kolejność elucji pozostaje taka sama. Gdy to założenie zawodzi — na przykład gdy zmienia się chemia kolumny lub pH próbki — kalibracja może zawieść. Inną opcją jest trenowanie całkowicie nowego modelu dla każdego ustawienia, ale to wymaga wielu dobrze zmierzonych peptydów, których nie zawsze można pozyskać, szczególnie dla rzadkich lub nietypowych modyfikacji chemicznych.

Wykorzystanie istniejącej wiedzy przez uczenie transferowe

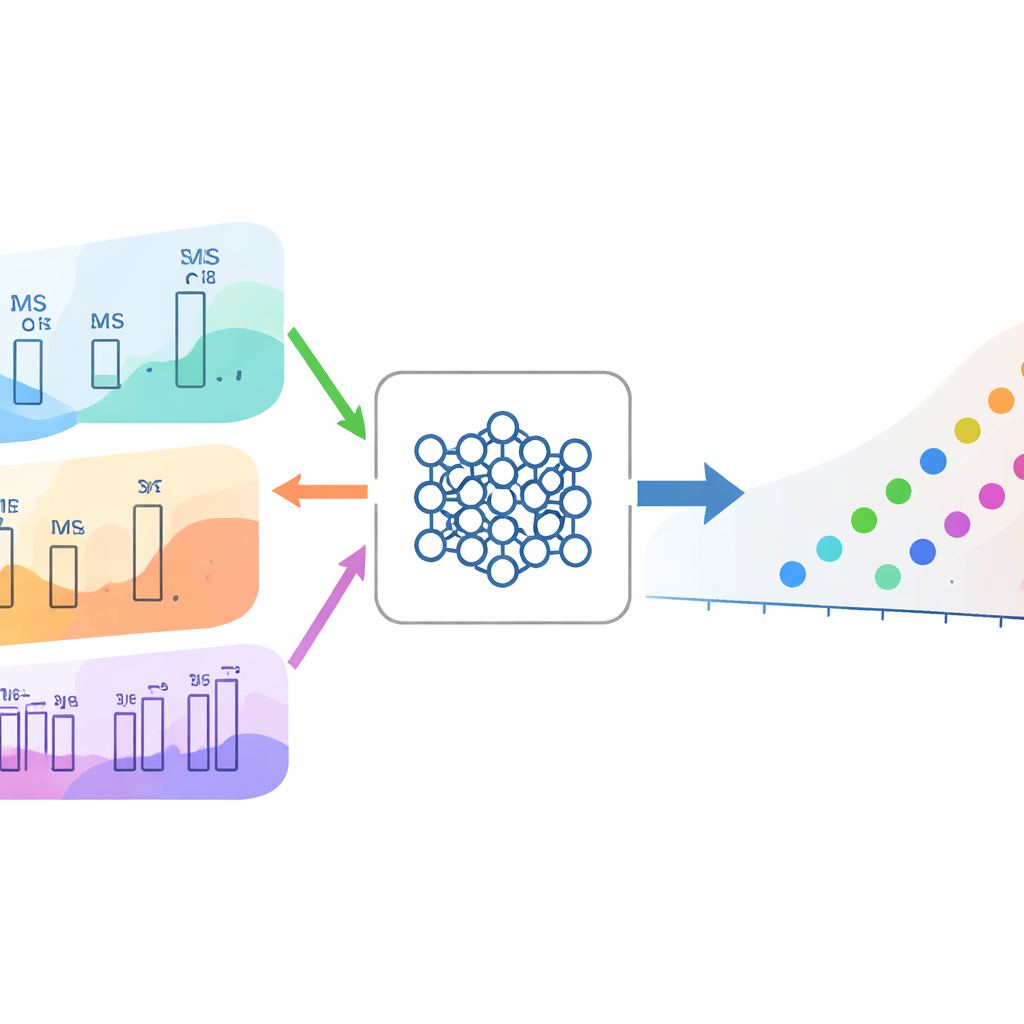

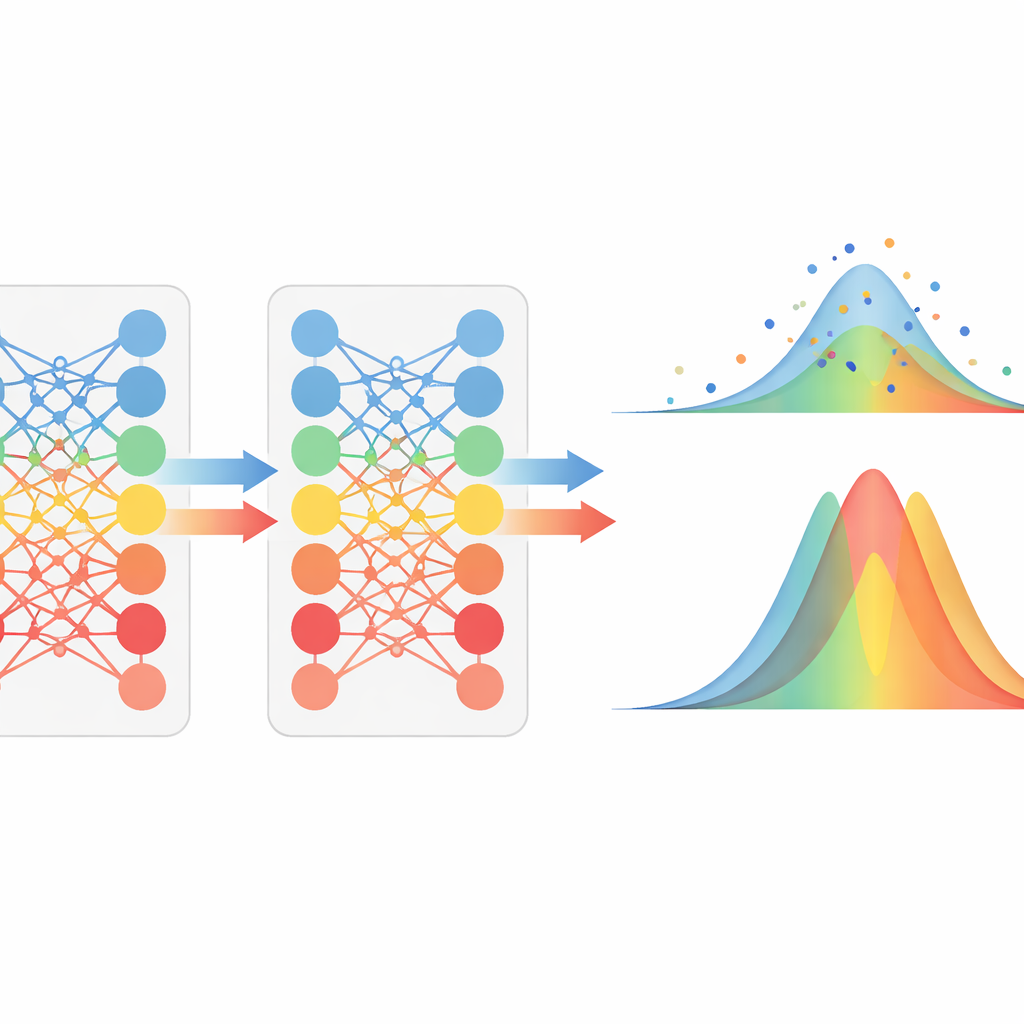

Autorzy opierają się na DeepLC, modelu głębokiego uczenia, który już przewiduje czasy retencji dla wielu typów peptydów. Zamiast zaczynać od zera dla każdej nowej sytuacji, ponownie wykorzystują model wytrenowany na dużym, wysokiej jakości zbiorze danych i dostrajają go na znacznie mniejszej próbce peptydów z nowego ustawienia. Na 474 zestawach danych pochodzących ze setek publicznych eksperymentów ta strategia uczenia transferowego prawie zawsze przewyższa zarówno prostą kalibrację, jak i trenowanie nowego modelu od losowych ustawień początkowych. Zyski są szczególnie widoczne, gdy dostępnych jest tylko kilkaset do kilku tysięcy peptydów treningowych — to częsty scenariusz w rzeczywistych badaniach. Nawet gdy jest wiele przykładów, uczenie transferowe nadal zwykle zapewnia nieco lepszą dokładność.

Radzenie sobie z nietypową chemią i skrajnymi warunkami

Aby sprawdzić granice podejścia, zespół zbadał bardzo trudne scenariusze. W jednym przypadku peptydy nosiły masywną grupę chemiczną, która czyni je znacznie bardziej „lipofilnymi”, silnie przesuwając ich czasy retencji. W innym ciecz w kolumnie była zasadowa zamiast kwaśnej, co fundamentalnie zmienia sposób, w jaki peptydy oddziałują z kolumną. W obu przypadkach prosta kalibracja starego modelu zawiodła, a nawet nowo trenowany model potrzebował wielu przykładów, by osiągnąć dobrą dokładność. Uczenie transferowe natomiast zaadaptowało się szybko, osiągając podobne lub lepsze wyniki przy dwukrotnie lub trzykrotnie mniejszej liczbie peptydów treningowych. Metoda poprawiła także przewidywania dla szerokiego panelu modyfikacji potranslacyjnych, które nie były widziane podczas treningu, co wskazuje, że wcześniejsza wiedza modelu o chemii peptydów przenosi się na nowe modyfikacje.

Co to oznacza dla przyszłych badań białek

Dla osób niebędących specjalistami główne przesłanie jest takie, że ponowne wykorzystanie tego, czego sieć neuronowa już się nauczyła o zachowaniu peptydów, znacznie ułatwia uzyskanie precyzyjnych przewidywań czasu w nowych warunkach eksperymentalnych. Zamiast żmudnego zbierania dużych zestawów treningowych lub akceptowania słabych wyników prostych kalibracji, badacze mogą dostroić istniejący model DeepLC przy użyciu skromnej liczby przykładów i nadal osiągnąć bardzo dokładne czasy retencji. To sprawia, że zaawansowane narzędzia przewidywania są bardziej odporne i dostępne, umożliwiając rzetelną analizę w różnych instrumentach, ustawieniach chemicznych i przy rzadkich modyfikacjach peptydów, a ostatecznie pomagając naukowcom czytać świat białek z większą jasnością i efektywnością.

Cytowanie: Bouwmeester, R., Nameni, A., Declercq, A. et al. Transfer learning in DeepLC improves LC retention time prediction across substantially different modifications and setups. Nat Commun 17, 2601 (2026). https://doi.org/10.1038/s41467-026-68981-5

Słowa kluczowe: proteomika, chromatografia cieczowa, przewidywanie czasu retencji, głębokie uczenie, uczenie transferowe