Clear Sky Science · pl

Połączenia rekurencyjne ułatwiają rozpoznawanie obiektów zasłoniętych poprzez wyjaśnianie

Jak mózg widzi to, czego nie ma

W codziennym życiu bez trudu rozpoznajemy obiekty częściowo ukryte — kota za zasłoną, samochód za drzewem. W artykule zadano pytanie, jak mózgi i inspirowane nimi sieci sztuczne radzą sobie z tym zadaniem. Autorzy pokazują, że obwody z pętlami sprzężenia zwrotnego mogą wykorzystać informacje o obiekcie zasłaniającym, by mentalnie „uzupełnić” to, co jest za nim, ujawniając istotny mechanizm, na którym może opierać się nasz system wzrokowy, gdy świat jest zagracony i niepełny.

Dlaczego ukryte obiekty stanowią trudny problem

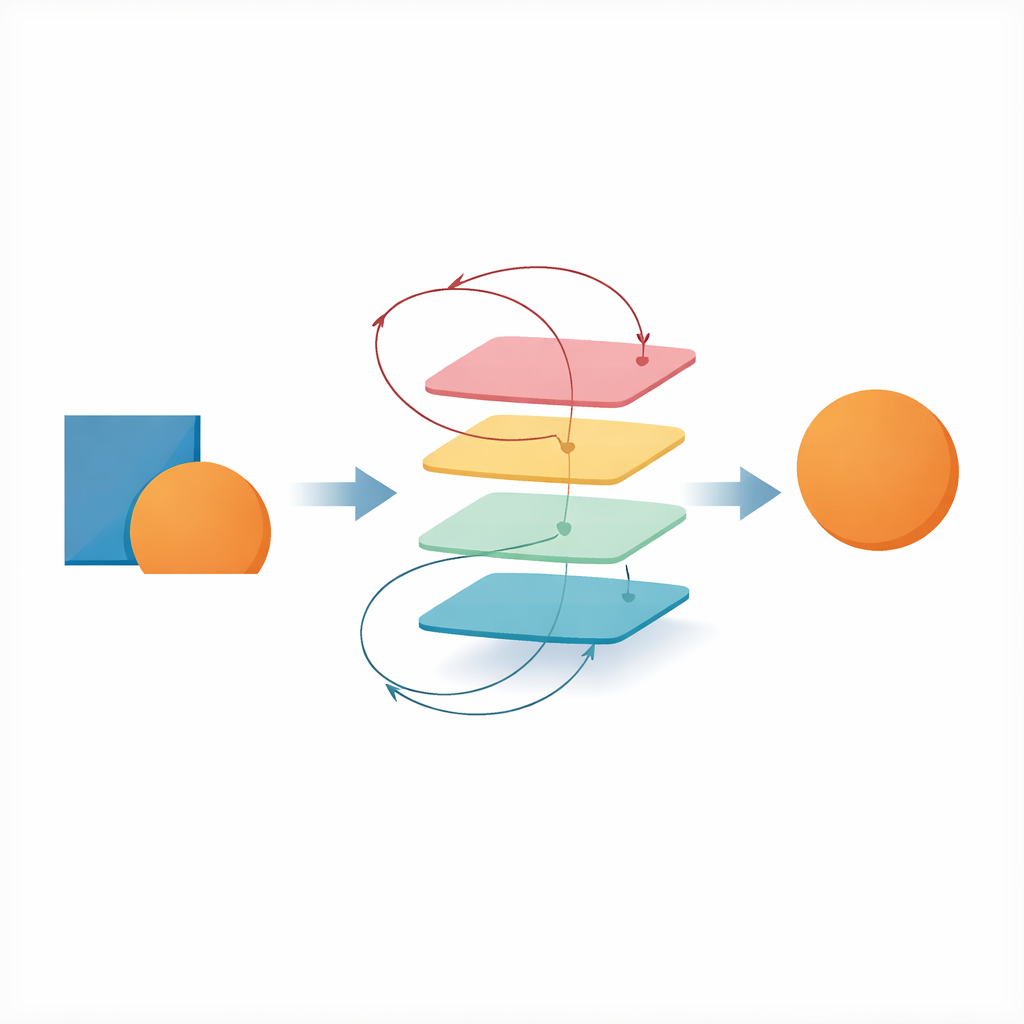

Gdy obiekt jest zasłonięty, wiele jego zwykłych cech wizualnych jest nieobecnych lub zniekształconych. Prosty system wzrokowy typu feedforward, w którym informacja płynie bezpośrednio od oczu do ośrodków rozpoznawania, musi zgadywać ukryty obiekt wyłącznie na podstawie widocznych fragmentów. Mózgi biologiczne są jednak pełne połączeń rekurencyjnych — pętli, w których wyższe obszary komunikują się z wcześniejszymi. Od dawna podejrzewano, że te pętle pomagają w trudnych zadaniach, takich jak rozpoznawanie obiektów zasłoniętych, lecz nie było jasne, jaką konkretną przewagę dają ani jak zmieniają wewnętrzne reprezentacje tego, co widzimy.

Testowanie sieci inspirowanych mózgiem

Autorzy zbudowali rozległy zestaw głębokich sieci konwolucyjnych naśladujących etapy przetwarzania wzrokowego. Niektóre były czysto feedforward, inne miały pętle rekurencyjne lub dodatkowe sprzężenie zwrotne z wyższych poziomów. Modele trenowano na specjalnych zestawach obrazów, w których jeden element mody częściowo zasłaniał inny. Sieci musiały identyfikować zarówno przedni (zasłaniający), jak i tylny (zasłonięty) obiekt w różnych konfiguracjach zadań. Wydajność zależała mniej od tego, czy sieć była rekurencyjna, czy feedforward, a bardziej od jej „głębokości obliczeniowej” — ile kolejnych kroków przetwarzania przechodził sygnał wejściowy. Głębokie modele feedforward mogły dorównać lub przewyższyć modele rekurencyjne w podstawowym zadaniu rozpoznawania, co dowodzi, że sama rekurencja nie daje magicznej przewagi.

Szczególny trik: wyjaśnianie zasłaniania

Choć to głębokość miała największe znaczenie dla surowej dokładności, sieci rekurencyjne wykazały wyróżniającą się zaletę w sposobie wykorzystania kontekstu. Kiedy poproszono te sieci, aby najpierw rozpoznały przedni obiekt, a dopiero potem ukryty, ich skuteczność w rozpoznawaniu obiektu zasłoniętego poprawiła się w porównaniu z sytuacją, gdy klasyfikowały go same. Taki wzorzec nie pojawił się w zwykłych sieciach feedforward, które zwracały obie etykiety jednocześnie. Autorzy interpretują to jako „wyjaśnianie” (explaining away): po rozpoznaniu zasłaniacza system może traktować brakujące lub dziwne cechy obrazu jako spowodowane przez ten zasłaniacz, zamiast jako dowód na istnienie jakiegoś nietypowego nowego obiektu. W realistyczniejszych scenach 3D i w modelu inspirowanym prymatami (CORnet) ta sama kolejność — najpierw przedni obiekt, potem ukryty — również poprawiała rozpoznawanie.

Widoczny ten sam efekt u ludzi

Aby sprawdzić, czy ludzie wykorzystują podobną strategię, badacze przeprowadzili eksperyment online. Uczestnicy krótko oglądali pojedynczy obiekt, potem scenę, w której jeden obiekt zasłaniał inny, i w końcu musieli wybrać, który z dwóch wariantów był obiektem ukrytym. W niektórych próbach początkowy pojedynczy obiekt był tym samym, co późniejszy zasłaniacz; w innych był niezwiązany. Gdy uczestnicy przed chwilą zobaczyli faktyczny zasłaniacz, dokładniej i szybciej identyfikowali obiekt ukryty, w różnych poziomach zasłonięcia. To sugeruje, że nasze mózgi, podobnie jak sieci rekurencyjne, korzystają na uprzednim przetworzeniu elementu zasłaniającego, a potem wykorzystują tę wiedzę do interpretacji fragmentarycznych dowodów na to, co jest za nim.

Odbudowywanie ukrytych obrazów od wewnątrz

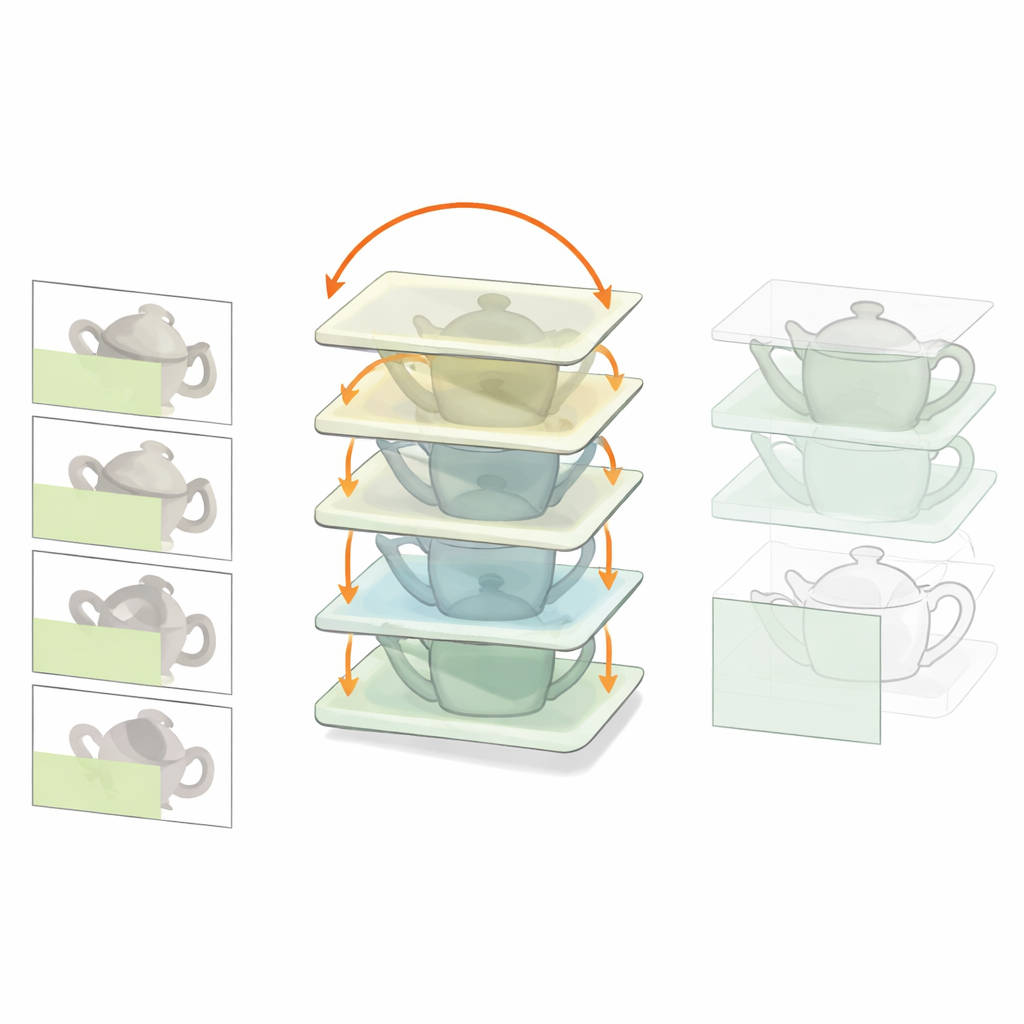

Aby bliżej przyjrzeć się mechanizmowi, autorzy zaprojektowali model bardziej inspirowany biologicznie, Recon-Net, luźno oparty na interakcjach między korą wzrokową a korą przedczołową. Recon-Net otrzymuje obraz z obiektem zasłoniętym oraz oddzielny widok zasłaniacza i iteracyjnie przekształca wewnętrzną reprezentację, aż będzie ona odpowiadać temu, jak powinien wyglądać niezasłonięty wariant ukrytego obiektu. Co uderzające, klasyfikatory trenowane wyłącznie na czystych, niezasłoniętych obrazach potrafią rozpoznawać wyjścia Recon-Net niemal tak dobrze, jakby trenowano je bezpośrednio na przykładach z zasłonięciami. To oznacza, że przetwarzanie rekurencyjne faktycznie „odtwarza” czysty wewnętrzny obraz ukrytego obiektu, mimo braku odpowiednich pikseli.

Co to znaczy dla mózgów i maszyn

Podsumowując, badanie pokazuje, że pętle sprzężenia zwrotnego nie dotyczą jedynie surowej wydajności, lecz jakościowo innego sposobu wykorzystania kontekstu. Połączenia rekurencyjne naturalnie wspierają wyjaśnianie: pozwalają systemowi wzrokowemu uwzględnić, jak zasłaniacz zniekształca to, co widzimy, i przywrócić stabilną wewnętrzną reprezentację obiektu ukrytego. Jednocześnie autorzy odkrywają, że trenowanie na silnie zasłoniętych obrazach może pozostawić odpowiedzi na czyste obrazy w dużej mierze niezmienione, co potencjalnie ułatwia uczenie w prawdziwych mózgach, unikając ciągłego przebudowywania połączeń. Te wnioski wskazują na wspólną zasadę dla neuronauki i sztucznej inteligencji: gdy świat ukrywa informacje, inteligentne systemy nie tylko intensywniej patrzą — one wnioskują, dlaczego informacje są nieobecne.

Cytowanie: Kang, B., Midler, B., Chen, F. et al. Recurrent connections facilitate occluded object recognition by explaining-away. Nat Commun 17, 2225 (2026). https://doi.org/10.1038/s41467-026-68806-5

Słowa kluczowe: rozpoznawanie obiektów zasłoniętych, rekurencyjne sieci neuronowe, percepcja wzrokowa, wyjaśnianie, neuronauka obliczeniowa