Clear Sky Science · pl

Szkolenie czujników dotyku, aby uczyły się wykrywania siły od siebie nawzajem

Roboty, które potrafią czuć i dzielić się odczuciem dotyku

W miarę jak roboty wychodzą z fabryk i trafiają do domów, szpitali i magazynów, potrzebują zmysłu, który na co dzień bierzemy za pewnik: dotyku. Tak jak nasze palce automatycznie dostosowują się, gdy podnosimy chipsa zamiast ciężkiego pudełka, przyszłe roboty muszą nauczyć się, jak mocno ściskać i kiedy przedmiot zaczyna się wyślizgiwać. Artykuł przedstawia nowy sposób, dzięki któremu „skóra” robotów uczy się wykrywania siły od innych skór, redukując kosztowną kalibrację i przybliżając maszyny do ludzkiej zręczności.

Dlaczego dotyk w robotach jest trudny do opanowania

Współczesne roboty mają już wiele rodzajów sztucznej skóry. Niektóre wykorzystują małe kamery patrzące w miękkie żele, inne opierają się na magnesach lub elektronicznych siatkach wykrywających nacisk. Każdy projekt sprawdza się w określonych zadaniach, ale wszystkie mówią różnymi „dialektami” dotyku: ten sam nacisk na dwa czujniki może dawać bardzo różne sygnały. Dziś każdy nowy czujnik zwykle wymaga pracochłonnego procesu szkolenia z użyciem precyzyjnych mierników siły, powtarzanego tysiące razy. Co gorsza, miękkie materiały starzeją się i zużywają, więc ta kosztowna kalibracja musi być powtarzana za każdym razem, gdy czujnik zostanie wymieniony.

Wzór zaczerpnięty z ludzkiego mózgu

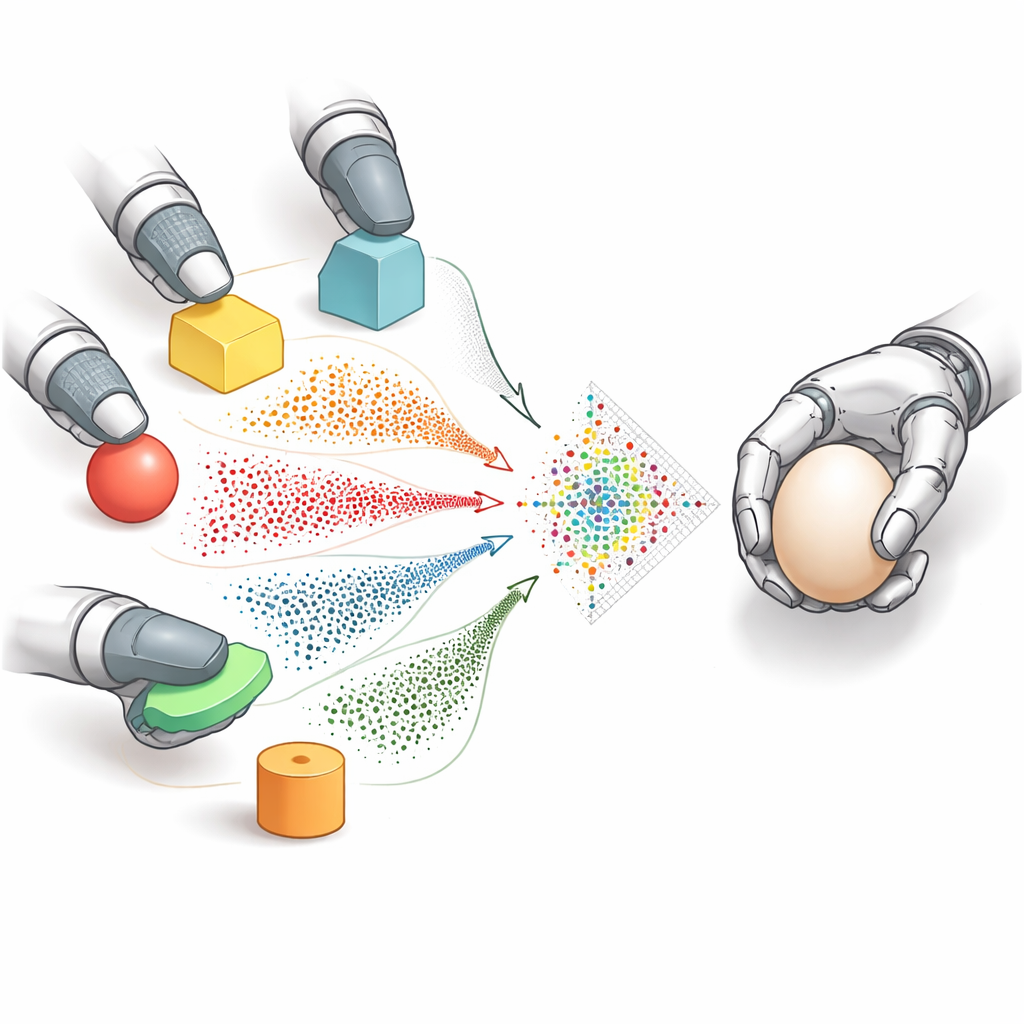

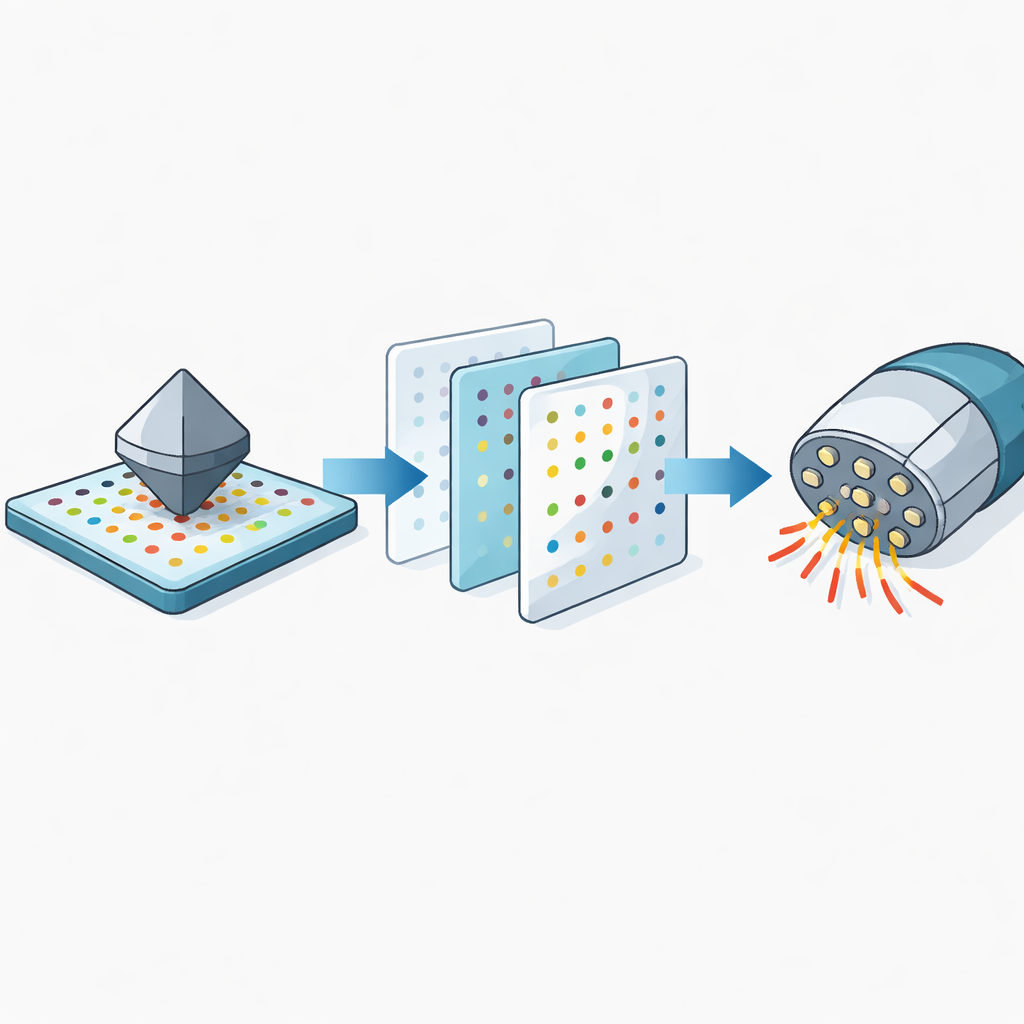

Ludzie rozwiązują podobny problem bez wysiłku. Nasza skóra jest wypełniona różnymi rodzajami receptorów dotyku, a mózg przekształca wszystkie ich sygnały w wspólny wewnętrzny kod. Ta zunifikowana pamięć dotykowa pozwala nam ocenić, jak coś mogłoby wyglądać na części dłoni, która nigdy tego nie dotknęła, korzystając po prostu z doświadczenia. Badacze stojący za tym projektem naśladują ten pomysł w robotach. Przekształcają wszystkie wyjścia czujników — obrazy z kamer, odczyty magnetyczne czy sygnały elektroniczne — w wspólną, przypominającą obraz formę z kropek, które reprezentują deformację skóry. Ta wspólna reprezentacja markerów działa jak proste „język dotyku”, którego może używać każdy czujnik.

Nauczanie jednego czujnika, by naśladował inny

Gdy wszystkie czujniki zaczynają mówić tym językiem opartym na kropkach, zespół wprowadza krok translacji zwany tłumaczeniem marker-do-markera. Przy użyciu potężnych modeli generatywnych szkolą system, który potrafi przekształcić wzór kropek z jednego czujnika w wzór, który inny czujnik pokazałby przy tym samym kontakcie. Oznacza to, że dobrze skalibrowany czujnik może efektywnie „wyobrazić sobie”, co poczułby nieskalibrowany czujnik, i wygenerować dla niego syntetyczne dane treningowe. Drugi model analizuje krótkie sekwencje tych obrazów z kropek, aby przewidzieć, jak siły zmieniają się w czasie w trzech kierunkach, uwzględniając zarówno docisk, jak i przesuwne ścinanie.

Radzenie sobie z rzeczywistymi różnicami w miękkiej skórze

W praktyce różne skóry robotyczne nie tylko różnią się kształtem i okablowaniem; są też wykonane z materiałów, które mogą być bardziej miękkie lub sztywniejsze i zmieniać się w miarę starzenia. Różnice te mogą zniekształcać oszacowania siły, nawet jeśli wzory wyglądają podobnie. Badacze mierzą, jak każdy typ miękkiego materiału wygina się pod obciążeniem i tworzą prosty krok korekcji, który skalibruje etykiety siły w górę lub w dół przed treningiem. Ta kompensacja materiałowa znacznie zmniejsza błędy, zwłaszcza przy przenoszeniu wiedzy między bardzo miękkimi i bardzo sztywnymi skórami.

Od stołu laboratoryjnego do codziennej manipulacji

Zespół testuje swoją metodę, nazwaną GenForce, na szerokim zestawie czujników — od wielu kopii tej samej podkładki opartej na kamerze po bardzo różne konstrukcje wykorzystujące magnesy lub zakrzywione, przypominające końcówki palców kształty. W ponad 200 kombinacjach w symulacji i na sprzęcie GenForce znacząco zmniejsza błędy przewidywań w porównaniu z prostym ponownym użyciem modelu wytrenowanego na innym czujniku. W pokazach robotyczna dłoń wyposażona w różne skórki dotykowe na każdym palcu wykorzystuje przetransferowane modele do delikatnego chwytania kruchych przedmiotów, takich jak owoce czy chipsy, oraz do wykrywania i korygowania poślizgu przez koordynację odczytów z obu stron chwytu.

Co to oznacza dla przyszłości robotycznych dłoni

Pozwalając czujnikom dotyku uczyć się wykrywania siły od siebie nawzajem zamiast zaczynać od zera, GenForce wskazuje drogę do rąk robotów, które są łatwiejsze i tańsze w masowym wdrożeniu. Jeden, starannie skalibrowany czujnik mógłby szkolić wiele innych, nawet o różnych konstrukcjach, a modele wstępnie wytrenowane można by dopracować przy użyciu niewielkiej ilości nowych danych. Dla osób niezwiązanych ze specjalistyczną dziedziną — sedno jest proste: ta praca sprawia, że praktyczniejsze staje się to, by roboty wiedziały, jak mocno ściskają przedmioty i szybko reagowały, gdy zaczynają się one ślizgać, przybliżając nas do maszyn, które operują w świecie rzeczywistym z równie pewnym dotykiem jak ludzkie dłonie.

Cytowanie: Chen, Z., Ou, N., Zhang, X. et al. Training tactile sensors to learn force sensing from each other. Nat Commun 17, 2101 (2026). https://doi.org/10.1038/s41467-026-68753-1

Słowa kluczowe: dotyk robota, czujniki dotykowe, wykrywanie siły, manipulacja robotów, uczenie transferowe