Clear Sky Science · pl

Mechanizmy neuronalne i obliczeniowe leżące u podstaw jednokrotnego uczenia percepcyjnego u ludzi

Widzieć ukryty obraz

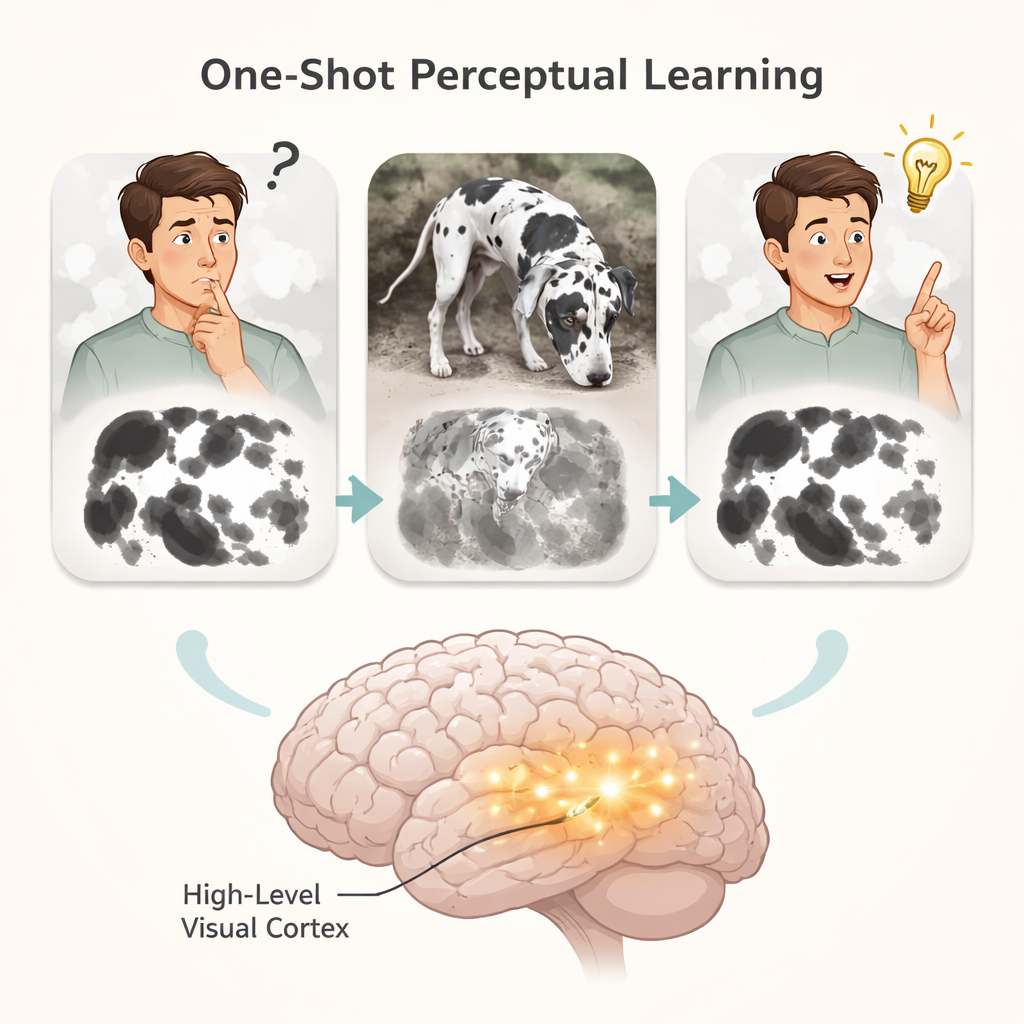

Wielu ludzi doświadczyło nagłego „aha!” — chwili, gdy zagadkowy, czarno-biały, plamisty obrazek nagle przeistacza się w wyraźny wizerunek psa lub twarzy — i gdy już go zobaczysz, nie możesz tego „odzobaczyć”. Badanie to pyta, w jaki sposób jednorazowy, krótkotrwały wgląd w wyraźne zdjęcie może trwale zmienić to, co widzimy w zamazanej wersji, oraz co to mówi o tym, jak nasze mózgi — i przyszłe systemy sztucznej inteligencji — uczą się na podstawie pojedynczego przykładu.

Z rozmytych plam do natychmiastowego rozpoznania

Naukowcy wykorzystali klasyczne obrazy typu Mooney: silnie uproszczone, czarno-białe zdjęcia trudne do rozpoznania, dopóki nie zobaczy się oryginalnego zdjęcia w odcieniach szarości, z którego pochodzą. Ochotnicy najpierw próbowali nazwać to, co widzą w tych trudnych obrazach. Później przez krótki moment oglądali odpowiadające im wyraźne fotografie, a następnie ponownie podejmowali próbę rozpoznania trudnych obrazów. Po tej pojedynczej ekspozycji ludzie nagle potrafili rozpoznać wcześniej tajemnicze obrazki, a ten postęp utrzymywał się. Poprzez staranne modyfikowanie wyraźnych zdjęć — odbicie lustrzane, obrót, zmianę rozmiaru lub przesunięcie na ekranie — zespół zmapował, jakie informacje wzrokowe mózg faktycznie przechowuje podczas tego jednokrotnego uczenia.

Gdzie mózg przechowuje nową wgląd

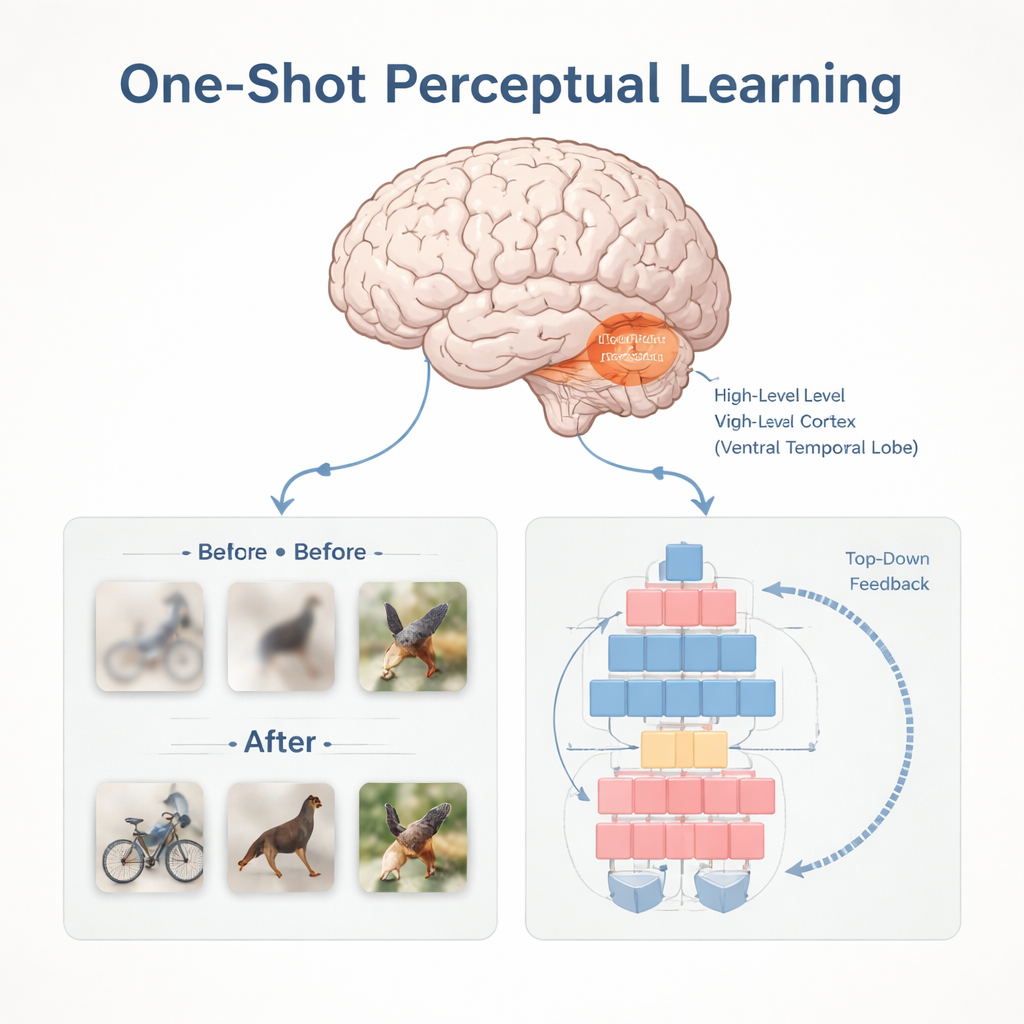

Różne modyfikacje obrazów wpływały na uczenie w odmienny sposób. Powiększenie wyraźnego obrazu dwukrotnie lub zmniejszenie go o połowę nie zaszkodziło uczeniu, co sugeruje, że przechowywany „szablon” mózgu jest elastyczny względem rozmiaru. Natomiast odbicie, obrót czy przesunięcie obrazu na ekranie osłabiało uczenie, choć nie uczyniło go niemożliwym. Zastąpienie wyraźnego zdjęcia innym przykładem z tej samej kategorii — na przykład innym psem — całkowicie likwidowało efekt uczenia. To pokazuje, że mózg nie przechowuje jedynie idei „to jest pies”; zamiast tego zachowuje szczegółową, obrazopodobną pamięć konkretnego kształtu i układu tego właśnie zdjęcia. Połączenie tych wyników behawioralnych z wiedzą o układzie wzrokowym wskazywało na wysokopoziomowe obszary wzrokowe, a nie na wczesne rejony wzrokowe czy struktury pamięciowe, takie jak hipokamp, jako najprawdopodobniejsze miejsce przechowywania tej nowej wiedzy.

Obserwowanie uczenia w mózgu

Aby to potwierdzić, zespół użył ultrawysokopolowych skanerów MRI 7-Tesli oraz bezpośrednich zapisów z elektrod umieszczonych na mózgach pacjentów z epilepsją. Eksperymenty MRI wykazały, że neurony w obszarze zwanym wysokopoziomową korą wzrokową reagowały na różne wersje tego samego obiektu (zmienione pod względem rozmiaru, pozycji lub orientacji) dokładnie w sposób przewidywany na podstawie testów behawioralnych. W zapisach z elektrod krytyczna zmiana pojawiała się najpierw w tej wysokopoziomowej korze wzrokowej: po nauce wzorce aktywności wywołane przez trudny obraz stały się bardziej podobne do tych wywołanych przez jego wyraźny odpowiednik, i działo się to wcześniej tutaj niż w pierwszorzędnych obszarach wzrokowych. To tempo wskazuje, że to w tym regionie przechowywany i reaktywowany jest nowy „priorytet”, który następnie wysyła sprzężenie zwrotne do wcześniejszych obszarów wzrokowych, pomagając zinterpretować niejednoznaczne sygnały.

Budowanie maszyny uczącej się w jednym skoku

Naukowcy zbudowali też model głębokiej sieci neuronowej zaprojektowany, by naśladować tę zdolność. Ich system używał nowoczesnego transformera wzrokowego jako „dolnego” silnika wizualnego, sparowanego ze specjalnym modułem przechowującym informacje uprzednie i wysyłającym „górnoprzepustowe” sprzężenie zwrotne, gdy później widzi powiązany obraz. Trenowany na zadaniach typu Mooney model wykazał prawdziwe uczenie jednokrotne: jego dokładność skoczyła po zaledwie jednej ekspozycji na wyraźne zdjęcie i znacznie przewyższała to, co dało się wyjaśnić prostym powtórzeniem. Model dzielił nawet wiele tych samych sukcesów i porażek co obserwatorzy ludzie na konkretnych obrazach, a wewnętrzne cechy, których nauczył się z wyraźnych zdjęć, mogły przewidzieć, które obrazki ludzie będą, a których nie będą w stanie rozpoznać. Gdy zespół porównał przechowywane przez model informacje uprzednie z ludzkimi skanami mózgu, znalazł najbliższe dopasowanie w tych samych wysokopoziomowych obszarach wzrokowych wyróżnionych w eksperymentach.

Dlaczego to ma znaczenie dla mózgów i maszyn

Razem te ustalenia sugerują, że nasze nagłe „teraz widzę!”-momenty powstają, gdy wysokopoziomowe obszary wzrokowe szybko dostosowują swoje połączenia po jednym doświadczeniu, przechowując szczegółowy, obrazopodobny priorytet, który później może przekształcać sposób, w jaki interpretujemy zaszumione dane. Ta szybka, a zarazem stabilna forma uczenia, osadzona w wysokopoziomowej korze wzrokowej i wspierana przez sprzężenie zwrotne z góry, daje plan budowy systemów AI, które potrafią uczyć się z bardzo niewielu przykładów. Stanowi też punkt wyjścia do zrozumienia, co może pójść nie tak, gdy percepcja zbytnio polega na uprzednich oczekiwaniach, na przykład w niektórych zaburzeniach psychicznych związanych z halucynacjami.

Cytowanie: Hachisuka, A., Shor, J.D., Liu, X.C. et al. Neural and computational mechanisms underlying one-shot perceptual learning in humans. Nat Commun 17, 1204 (2026). https://doi.org/10.1038/s41467-026-68711-x

Słowa kluczowe: uczenie jednokrotne, percepcja wzrokowa, wysokopoziomowa kora wzrokowa, uczenie percepcyjne, głębokie sieci neuronowe