Clear Sky Science · pl

Błyskawiczne postrzeganie wzrokowe wykraczające poza możliwości człowieka dzięki analizie ruchu z użyciem tranzystorów synaptycznych

Dlaczego szybsze widzenie robotów ma znaczenie

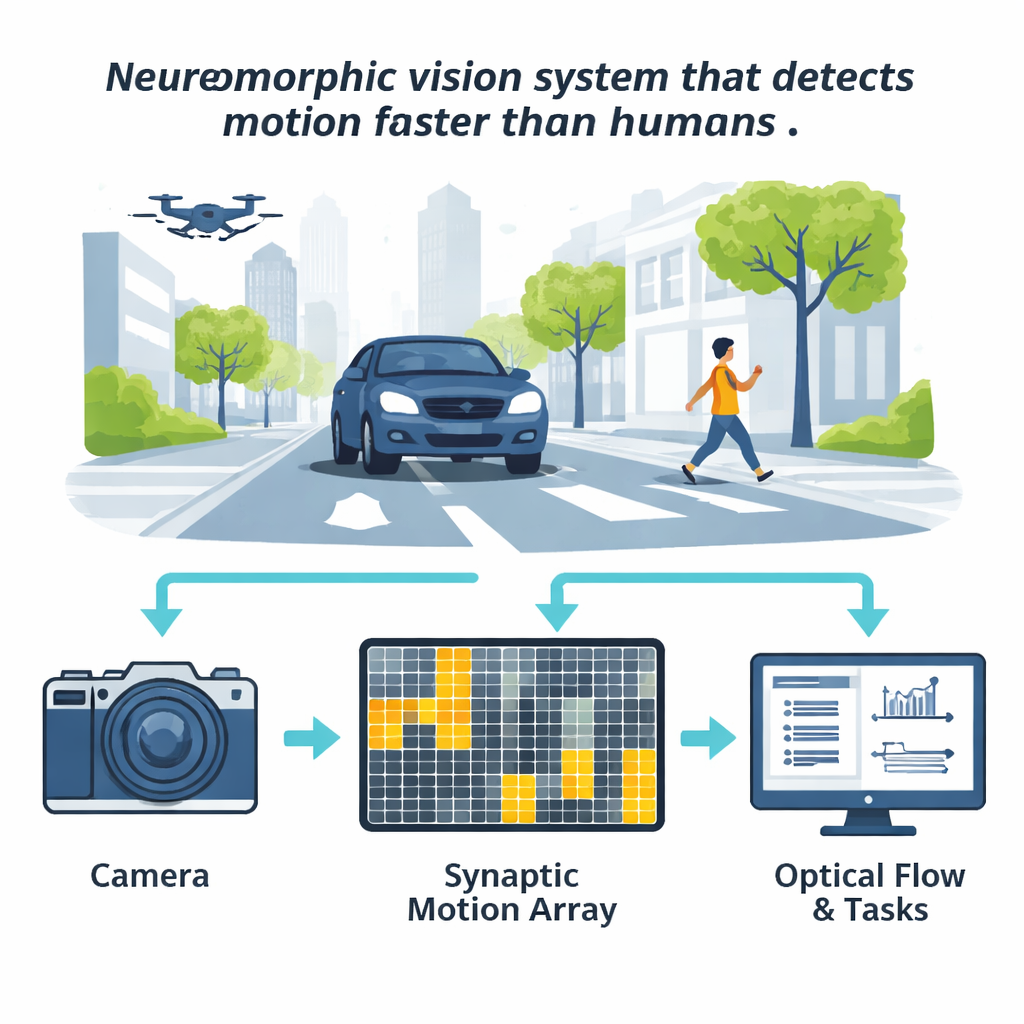

Gdy system autonomiczny samochodu lub lecący dron zareaguje choćby ułamkiem sekundy za wolno, konsekwencje mogą być poważne. Najlepsze dziś algorytmy widzenia komputerowego dorównują lub przewyższają ludzi w standardowych testach, jednak wciąż potrzebują za dużo czasu na przetworzenie każdej klatki w czasie rzeczywistym. W artykule opisano nowy typ sprzętu wzrokowego inspirowanego mózgiem, który pozwala maszynom wykrywać ruch dużo szybciej niż ludzie, nie tracąc przy tym na dokładności.

Jak zwykle uczymy maszyny rozpoznawać ruch

Tradycyjna analiza ruchu opiera się na technice zwanej przepływem optycznym, która estymuje, jak każdy punkt obrazu przesuwa się z jednej klatki do następnej. Metoda działa dobrze, ale jest obliczeniowo kosztowna: dla pełnego obrazu w wysokiej rozdzielczości potężna karta graficzna może potrzebować więcej niż pół sekundy na wykonanie obliczeń. W szybkich scenariuszach, jak jazda po autostradzie, to opóźnienie może przełożyć się na dziesiątki metrów pokonanych, zanim system rozpozna zagrożenie. W przeciwieństwie do ludzkiego systemu wzrokowego, który szybko skupia się na najbardziej istotnych fragmentach sceny, standardowe algorytmy przetwarzają skrupulatnie każdy piksel, także w statycznym tle niosącym niewiele informacji.

Pożyczka z wczesnych etapów widzenia mózgu

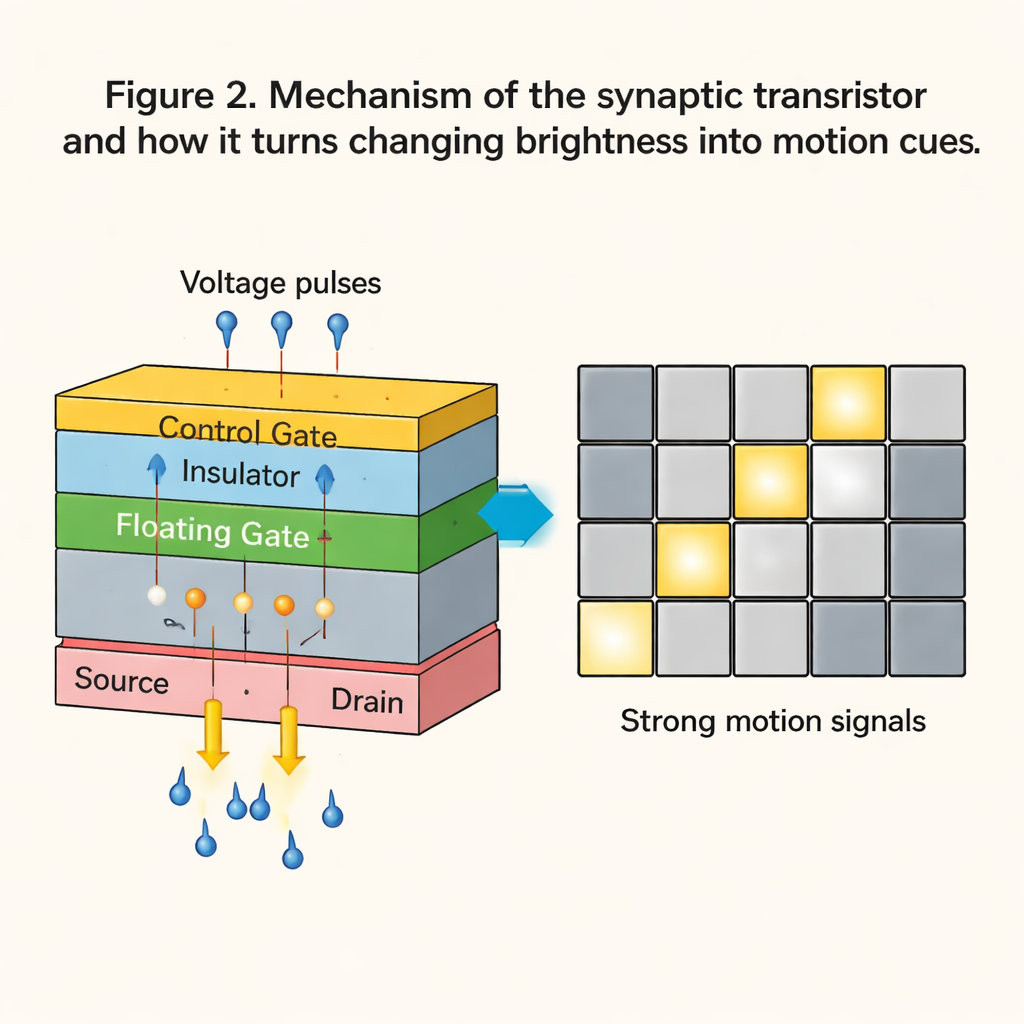

Biologia rozwiązuje ten problem, wykorzystując wczesne warstwy filtrujące w oku i wzgórzu do wyeksponowania miejsc, gdzie zachodzą zmiany, i przytłumienia reszty. Autorzy naśladują ten pomysł w krzemie, budując neuromorficzny moduł „uwagi temporalnej”. Standardowa kamera wciąż rejestruje obrazy, ale zmiany jasności są także przekazywane do zwartej siatki tranzystorów synaptycznych — urządzeń elektronicznych zachowujących się nieco jak regulowane połączenia w mózgu. Każde urządzenie lokalnie akumuluje, jak bardzo zmieniło się oświetlenie przypisanego obszaru w krótkim oknie czasowym. Fragmenty siatki, które obserwują silne zmiany, rozświetlają się jako regiony zainteresowania, podczas gdy spokojniejsze obszary bledną w tło.

Inteligentne tranzystory, które pamiętają ruch

W sercu systemu znajduje się specjalnie zaprojektowany tranzystor synaptyczny z pływającą bramką zbudowany z warstwowych, atomowo cienkich materiałów. Poprzez krótkie impulsy napięciowe można dostroić przewodność urządzenia, która następnie utrzymuje się przez godziny, efektywnie przechowując pamięć o niedawnej aktywności wzrokowej. Tranzystory reagują w około 100 mikrosekund — wystarczająco szybko dla wideo o dużej prędkości — i wytrzymują tysiące cykli aktualizacji bez pogorszenia parametrów. Zespół skalował pojedyncze urządzenie do macierzy 4×4 i pokazał, jak zmiany jasności z kamery są zamieniane na impulsy napięciowe, które selektywnie przeprowadzają niektóre komórki do stanów wysokiej przewodności „ruchu”, tłumiąc jednocześnie drobne migotania i szumy.

Skupianie ciężkich obliczeń tam, gdzie mają znaczenie

Wyjście z macierzy jest przekształcane w zgrubną „mapę ciepła” ruchu, która wyznacza zwarte regiony zainteresowania. Zamiast uruchamiać kosztowny kod przepływu optycznego na całym obrazie, system analizuje tylko te wyróżnione obszary, z niewielkim marginesem wokół nich. Autorzy demonstrują, że podejście to można bezpośrednio zintegrować z kilkoma popularnymi metodami przepływu optycznego, od klasycznych algorytmów takich jak Farneback po współczesne modele uczenia głębokiego, jak RAFT i GMFlow. W testach obejmujących samochody, drony, ramiona robotyczne i szybkie dyscypliny sportowe, jak tenis stołowy, neuromorficzny front-end rutynowo skraca czas poświęcany na estymację ruchu i zadania następcze — takie jak prognozowanie trajektorii obiektu, segmentacja poruszających się obiektów z tła czy śledzenie celu — około czterokrotnie.

Wyprzedzanie reakcji człowieka bez utraty dokładności

Co istotne, to przyspieszenie nie odbywa się kosztem niezawodności. Dostarczając dodatkowe informacje o tym, gdzie prawdopodobnie występuje ruch, sygnały temporalne często poprawiają dokładność, zwłaszcza w śledzeniu obiektów i segmentacji w zatłoczonych scenach. W scenariuszach z pojazdami i małymi dronami metryki wydajności zadań wzrosły ponad dwukrotnie w porównaniu z konwencjonalnymi potokami, podczas gdy łączny czas przetwarzania spadł do kilkudziesięciu milisekund — na poziomie, lub lepiej niż typowy czas reakcji człowieka wynoszący około 150 milisekund. Autorzy argumentują, że ten neuromorficzny front-end ruchu można łączyć z wieloma istniejącymi algorytmami widzenia, a nawet z detektorami obiektów wykraczającymi poza przepływ optyczny, aby dać robotom, pojazdom i maszynom interaktywnym znacznie szybszy i bardziej ukierunkowany sposób rozumienia dynamicznego otoczenia.

Cytowanie: Wang, S., Zhao, J., Pu, T. et al. Ultrafast visual perception beyond human capabilities enabled by motion analysis using synaptic transistors. Nat Commun 17, 1215 (2026). https://doi.org/10.1038/s41467-026-68659-y

Słowa kluczowe: neuromorficzna wizja, przepływ optyczny, tranzystory synaptyczne, percepcja robotów, autonomiczna jazda