Clear Sky Science · pl

Analogowe obliczenia w pamięci dla nieujemnej faktoryzacji macierzy

Dlaczego dzielenie dużych danych na części ma znaczenie

Codzienne usługi, takie jak rekomendacje filmów, aplikacje do zdjęć czy analiza genetyczna, opierają się na odnajdywaniu wzorców ukrytych w ogromnych tabelach liczb. Popularną metodą jest nie‑ujemna faktoryzacja macierzy (NMF), która rozkłada dużą tabelę danych na prostsze bloki konstrukcyjne, łatwiejsze do interpretacji. Jednak w miarę wzrostu zbiorów danych do milionów użytkowników, pozycji czy pikseli, dzisiejsze cyfrowe układy mogą mieć trudności z obsługą tych zadań w czasie rzeczywistym. Artykuł pokazuje, jak analogowe, w‑pamięci podejście obliczeniowe może wykonać takie intensywne operacje matematyczne znacznie szybciej i przy znacznie mniejszym zużyciu energii, otwierając drogę do bardziej responsywnych i wydajnych usług napędzanych sztuczną inteligencją.

Wydobywanie wzorców z olbrzymich tabel

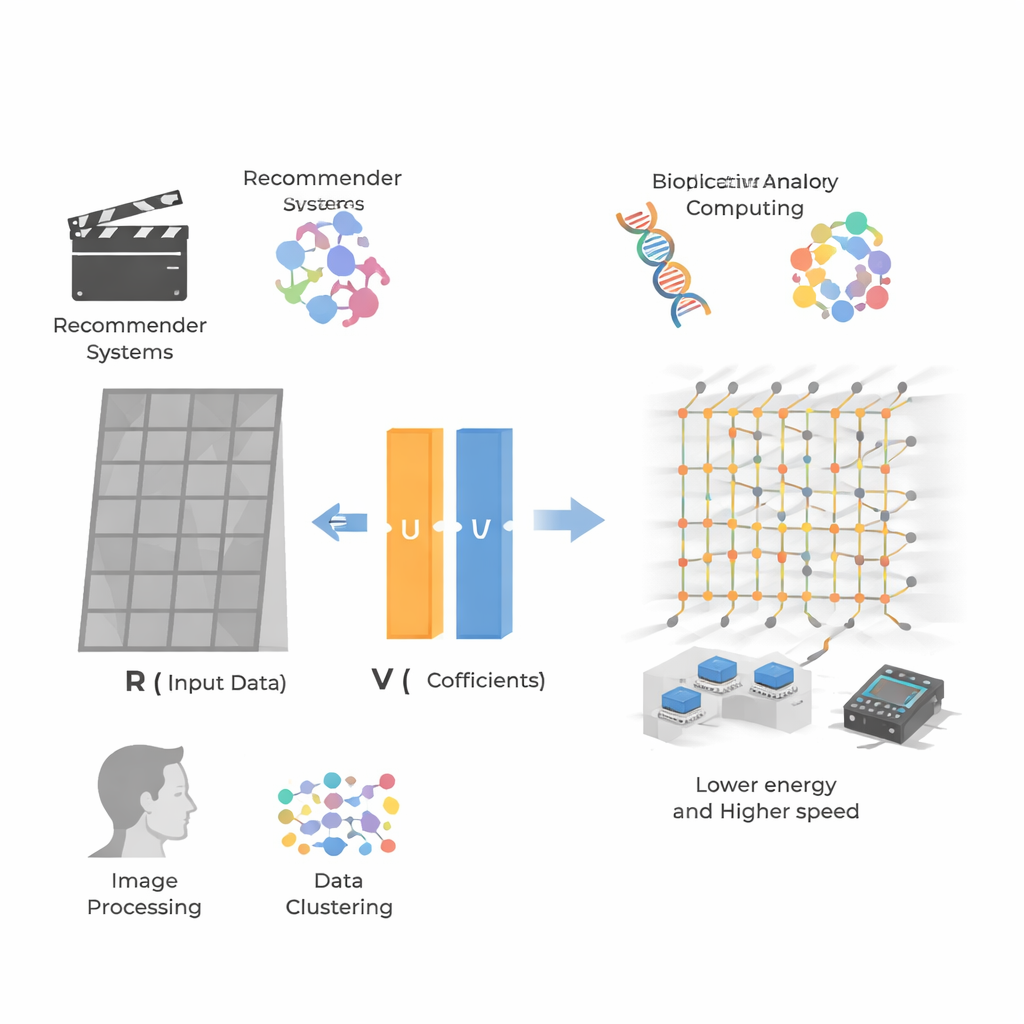

W centrum pracy znajduje się nie‑ujemna faktoryzacja macierzy (NMF), metoda, która bierze dużą siatkę nieujemnych liczb — na przykład oceny użytkowników filmów lub wartości pikseli obrazu — i zapisuje ją jako iloczyn dwóch mniejszych siatek. Jedna siatka reprezentuje ukryte „cechy” (np. gust użytkownika: akcja kontra romans), a druga pokazuje, jak silnie każdy element lub piksel przejawia te cechy. Ponieważ wszystkie wartości pozostają nieujemne, cechy te mają tendencję do przypominać intuicyjne części: komponenty twarzy na zdjęciach lub profile preferencji w danych rekomendacyjnych. Dzięki temu NMF jest popularne w systemach rekomendacyjnych, bioinformatyce, przetwarzaniu obrazów i klasteryzacji, ale także sprawia, że jest to obliczeniowo wymagające dla bardzo dużych, rzadkich zbiorów danych.

Dlaczego cyfrowe układy napotykają barierę

Tradycyjne procesory — CPU, GPU, a nawet FPGA — traktują operacje macierzowe jako długie sekwencje podstawowych kroków, przemieszczając dane tam i z powrotem między pamięcią a jednostkami obliczeniowymi. Dla umiarkowanych problemów działa to dobrze, ale dla współczesnych zbiorów danych z milionami wierszy i kolumn koszt czasowy i energetyczny staje się ogromny. Spowolnienie prawa Moore’a i tzw. wąskie gardło von Neumanna, gdzie dostęp do pamięci dominuje nad zużyciem energii i opóźnieniami, utrudniają skalowanie NMF do zastosowań w czasie rzeczywistym, takich jak rekomendacje na żywo czy szybka analiza obrazów. Nawet sprytne algorytmy cyfrowe nadal napotykają złożoność wielomianową i intensywny ruch danych, gdy macierze muszą być wielokrotnie aktualizowane.

Obliczenia wewnątrz pamięci z użyciem sygnałów analogowych

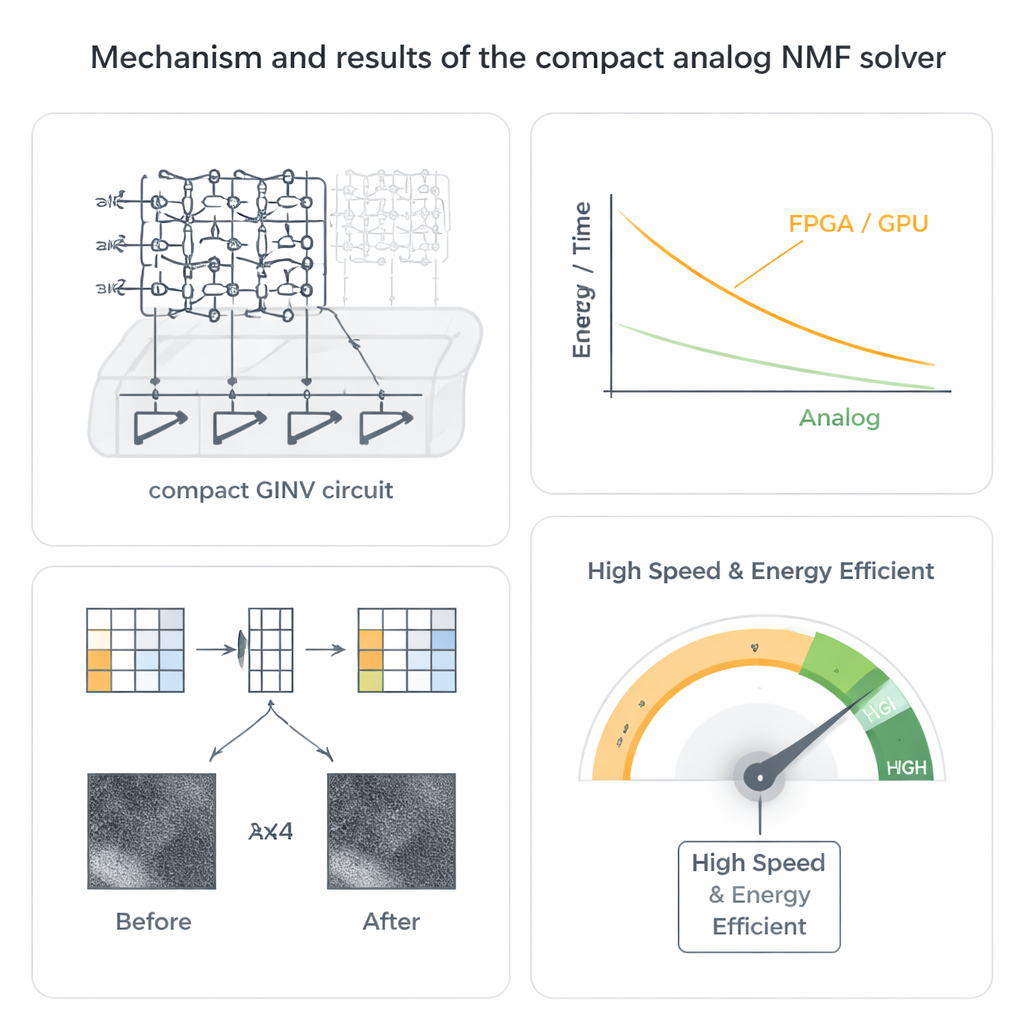

Autorzy wybierają inną drogę, stosując analogowe obliczenia macierzowe oparte na rezystancyjnych pamięciach znanych jako memrystory. Urządzenia te można zorganizować w gęste macierze krzyżowe, gdzie każdy węzeł przechowuje wartość przewodności. Gdy przyłożone są napięcia z jednej strony macierzy, prądy wypływające po drugiej stronie naturalnie wykonują wiele operacji mnożenia i dodawania równolegle. Poprzez połączenie tych macierzy w zamknięty obwód z niewielką liczbą wzmacniaczy operacyjnych zespół buduje kompaktowy układ odwrotności uogólnionej (GINV), który rozwiązuje całe problemy regresji w zasadzie w jednym analogowym kroku, zamiast w wielu cyfrowych iteracjach. Udoskonalają projekt za pomocą schematu kompensacji przewodności, który utrzymuje stabilność układu przy jednoczesnym znacznym zmniejszeniu liczby wzmacniaczy, oszczędzając powierzchnię układu i energię.

Od sztuczki matematycznej do działającego sprzętu

Aby uczynić to praktycznym dla NMF, badacze łączą swój kompaktowy układ GINV ze znaną strategią zwaną naprzemienną nie‑ujemną regresją najmniejszych kwadratów. Zamiast próbować rozwiązać obie macierze czynników jednocześnie — trudny problem nie‑wypukły — metoda naprzemiennie poprawia jedną macierz przy trzymaniu drugiej stałej, dzieląc zadanie na łańcuch prostszych nie‑ujemnych problemów regresji, które układ analogowy potrafi rozwiązać. Wytwarzają macierze memrystorów na bazie tlenku hafnu i budują platformę na płytce drukowanej, po czym demonstrują dwa kluczowe zastosowania. Dla kompresji obrazów fotografia mgławicy jest dzielona na małe fragmenty, które są faktoryzowane, zmniejszając objętość przechowywania o połowę przy reprodukcji obrazu z jedynie niewielką utratą jakości wizualnej. W systemach rekomendacyjnych faktoryzują dane ocen użytkownik–przedmiot, takie jak zbiór MovieLens 100k, dokładnie przewidując brakujące oceny, mimo że macierz jest ekstremalnie rzadka.

Szybkość, efektywność i odporność w realnym świecie

Ponad podstawową poprawnością, analogowy solver wykazuje godne uwagi przewagi w szybkości i zużyciu energii. Ponieważ prąd przez macierz krzyżową reprezentuje wiele operacji wykonywanych jednocześnie, czas rozwiązania problemu regresji staje się niemal niezależny od rozmiaru macierzy, w ostrym kontraście do metod cyfrowych. Szacunki na poziomie systemu sugerują przyspieszenia od setek do tysięcy razy w porównaniu z zaawansowanymi implementacjami na FPGA i GPU, wraz z poprawą efektywności energetycznej o kilka rzędów wielkości. Co może zaskakiwać, analogowy charakter sprzętu nie jest słabością, lecz zaletą: algorytm NMF naturalnie toleruje szum urządzeń i błędy programowania, a w symulacjach końcowa jakość obrazu i rekomendacji pozostaje wysoka nawet wtedy, gdy bazowe wartości memrystorów są dość nieprecyzyjne lub dryfują z temperaturą.

Co to oznacza dla codziennej technologii

Mówiąc prościej, badanie pokazuje, że nowy rodzaj „kalkulatora w pamięci” może obsłużyć jedno z podstawowych narzędzi nowoczesnej nauki o danych znacznie szybciej i wydajniej niż dzisiejsze cyfrowe układy. Poprzez osadzenie faktoryzacji macierzy bezpośrednio w kompaktowych obwodach analogowych, usługi takie jak rekomendacje strumieniowe, personalizowane rankingi treści i przetwarzanie obrazów na urządzeniu mogłyby w przyszłości działać w czasie rzeczywistym przy znacznie mniejszym zużyciu energii. Praca dostarcza zarówno planu układu, jak i eksperymentalnego dowodu, że takie analogowe obliczenia w pamięci potrafią sprostać realistycznym zbiorom danych z dokładnością zbliżoną do oprogramowania w pełnej precyzji, wskazując na przyszły sprzęt, który będzie przesiewał ogromne strumienie danych równie bezwysiłkowo jak światło przechodzące przez szkło.

Cytowanie: Wang, S., Luo, Y., Zuo, P. et al. In-memory analog computing for non-negative matrix factorization. Nat Commun 17, 1881 (2026). https://doi.org/10.1038/s41467-026-68609-8

Słowa kluczowe: analogowe obliczenia w pamięci, nieujemna faktoryzacja macierzy, macierz krzyżowa memrystorów, kompresja obrazów, systemy rekomendacyjne