Clear Sky Science · pl

Pamięć mozaikowa dużych modeli językowych

Dlaczego bliskie kopie mają znaczenie

Duże modele językowe, takie jak ChatGPT, uczą się na oceanach tekstu i czasem zapamiętują ich fragmenty. To rodzi obawy o prywatność, prawa autorskie i o to, jak uczciwie możemy oceniać, co te systemy naprawdę potrafią. Artykuł pokazuje, że zapamiętywanie to nie tylko dokładne kopiowanie i wklejanie. Modele językowe potrafią rekonstruować fragmenty z wielu nieznacznie różnych wersji, niczym składając mozaikę. Zrozumienie tego ukrytego rodzaju pamięci jest kluczowe dla każdego, komu zależy na bezpiecznym i wiarygodnym AI.

Nowy sposób myślenia o pamięci maszynowej

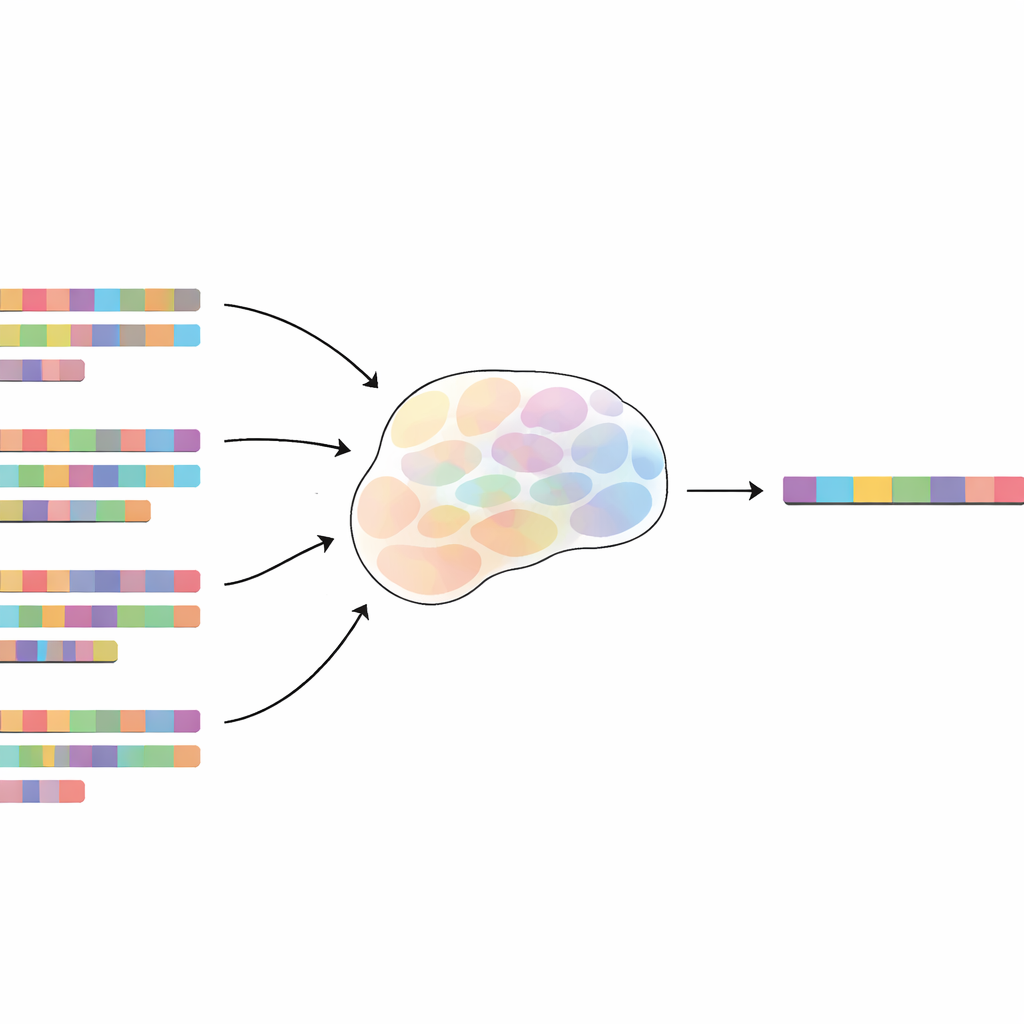

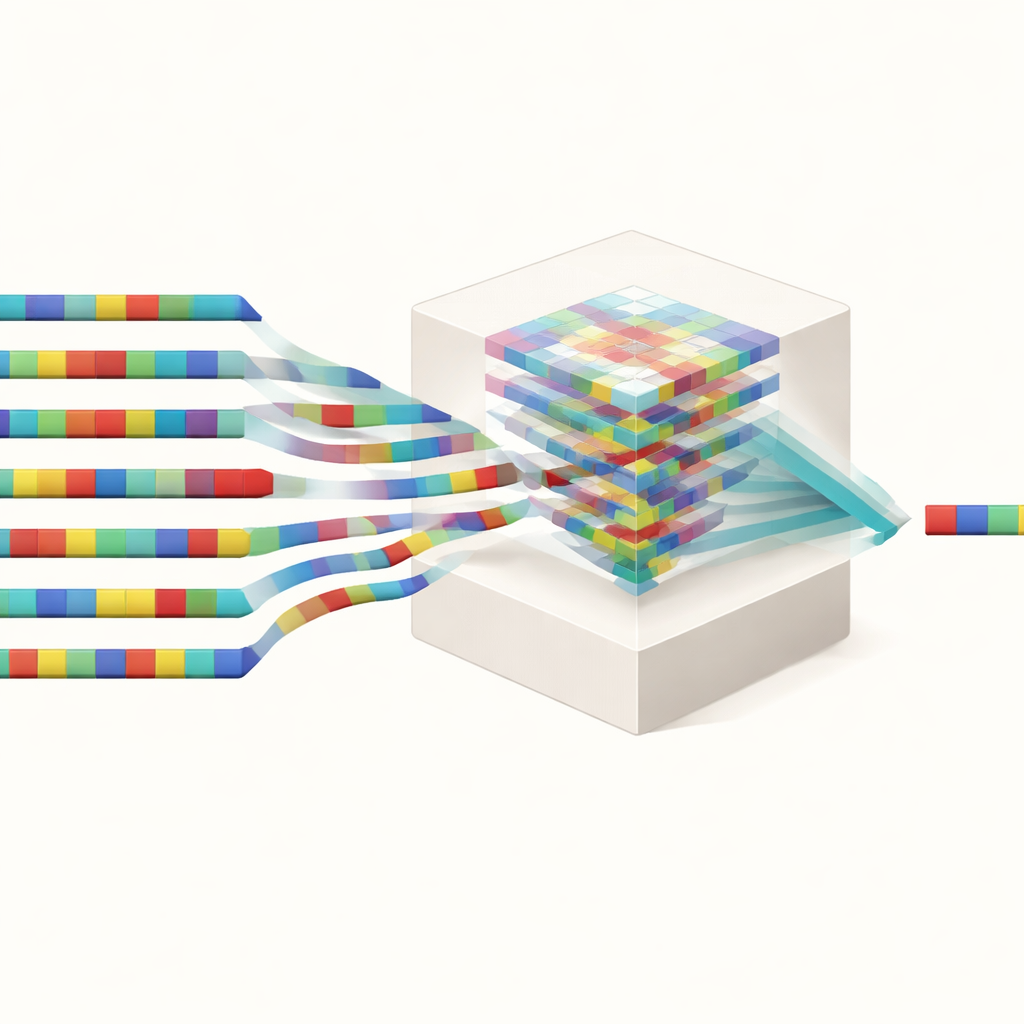

Wielu ludzi zakłada, że model językowy zapamiętuje coś tylko wtedy, gdy widzi dokładnie to samo zdanie wielokrotnie. Autorzy kwestionują ten pogląd, wprowadzając pojęcie „pamięci mozaikowej”. W tym ujęciu model może zapamiętać 100‑wyrazowy fragment nie tylko na podstawie dokładnych powtórek, lecz także z wielu nieostrych duplikatów — wersji, w których niektóre słowa zostały pominięte, zmienione lub przemieszczone. Aby to dokładnie zbadać, autorzy wstawili sztuczne frazy testowe, zwane kanarkami, do danych treningowych modelu razem z licznymi zmodyfikowanymi wersjami. Po treningu mierzą, jak łatwo można stwierdzić, czy dany kanarek znajdował się w zbiorze treningowym, używając rodzaju testu prywatności zwanego atakiem wnioskowania członkostwa.

Jak nieostre kopie pozostawiają wyraźny ślad

Porównując nieostre duplikaty z dokładnymi powtórzeniami, badacze definiują „równoważnik dokładnego duplikatu”: ile jeden nieostry egzemplarz wnosi do zapamiętania w porównaniu z idealną kopią. Stwierdzają, że nawet bardzo łagodne zmiany ledwie osłabiają zapamiętywanie. Jeśli w każdym duplikacie około 10% słów zostanie zastąpionych losowo, pojedynczy nieostry egzemplarz wciąż wnosi mniej więcej 60–65% wartości dokładnego duplikatu. Nawet gdy połowa słów jest zmieniona, każda zmieniona wersja liczy się wciąż za około 15–20% pełnej kopii. Efekt jest odporne: dodawanie losowych wypełniaczy między kluczowymi frazami czy mieszanie fragmentów zdania zmniejsza zapamiętywanie, lecz go nie eliminuje. Model wydaje się potrafić przeskakiwać nad szumem, skupiać się na nakładających się fragmentach i znów je składać.

Forma ponad znaczenie w tym, co modele przechowują

Skoro współczesne modele językowe potrafią rozwiązywać zadania matematyczne, wykonywać polecenia i tłumaczyć między językami, można by oczekiwać, że ich pamięć dotyczy znaczenia. Ku zaskoczeniu, badanie wykazuje coś przeciwnego. Gdy autorzy zastępują słowa alternatywami zachowującymi sens zdania, zapamiętywanie poprawia się tylko nieznacznie w porównaniu z zastępowaniem ich losowymi słowami. Parafrazy wygenerowane przez inne systemy AI — które zachowują tę samą ideę, ale zmieniają wiele powierzchownych szczegółów — wnoszą stosunkowo niewiele do zapamiętywania, chyba że nadal dzielą wiele krótkich sekwencji tokenów z oryginalnym fragmentem. W szeregu testów tym, co naprawdę napędza pamięć, jest nakładanie się dokładnych tokenów (podstawowych jednostek słownych modelu), a nie wspólne idee. Innymi słowy, pamięć mozaikowa modelu dotyczy głównie formy, nie znaczenia.

Ukryte duplikaty w rzeczywistych danych treningowych

Autorzy pytają następnie, jak często występują nieostre duplikaty w popularnym, silnie oczyszczonym zbiorze internetowym używanym do trenowania modeli językowych, znanym jako SlimPajama. Chociaż ten zbiór miał już usunięte niemal identyczne dokumenty, zespół odkrywa, że wiele 100‑tokenowych sekwencji pojawiających się dokładnie 1 000 razy ma też tysiące bliskich, lecz nieidealnych wersji. Dla małych odległości edycyjnych — rzędu około 10% zmienionych znaków — średnio istnieje około 4 razy więcej nieostrych duplikatów niż dokładnych, a przy większych, wciąż istotnych odległościach liczby te rosną do dziesiątek tysięcy. Co istotne, standardowe techniki „deduplikacji” stosowane w przemyśle, które zwykle usuwają tylko długie, dokładne nakładki, pozostawiają większość tych nieostrych kopii nienaruszoną. Oznacza to, że modele wciąż mogą zapamiętywać wrażliwe lub objęte prawami autorskimi materiały, składając je z wielu nieznacznie zmienionych źródeł.

Dlaczego to ma znaczenie dla prywatności, uczciwości i kontroli

Wyniki te mają dalekosiężne konsekwencje. W kontekście prywatności pokazują, że samo oczyszczenie danych treningowych z dokładnych powtórzeń nie wystarcza: informacje osobiste lub poufne mogą zostać zapamiętane przez rodziny podobnych fragmentów. W kwestiach praw autorskich i benchmarków nieostre duplikaty mogą sprawić, że modele będą odtwarzać chronione teksty lub sztucznie zawyżać wyniki na testach, które w istocie widziały w przebranej formie. W działaniach mających na celu „oduczenie” konkretnych danych nie wystarczy usunąć jednego problematycznego przykładu, jeśli pozostaje wiele jego wariantów. Ogólnie rzecz biorąc, praca ujawnia, że pamięć modelu językowego to złożona mozaika zbudowana z wielu małych nakładań, co podważa dzisiejsze narzędzia bezpieczeństwa i wymaga mądrzejszych, bardziej szczegółowych metod oczyszczania i audytu danych treningowych.

Cytowanie: Shilov, I., Meeus, M. & de Montjoye, YA. The mosaic memory of large language models. Nat Commun 17, 2142 (2026). https://doi.org/10.1038/s41467-026-68603-0

Słowa kluczowe: zapamiętywanie przez model językowy, nieostre duplikaty, prywatność danych, deduplikacja danych treningowych, zanieczyszczenie benchmarku