Clear Sky Science · pl

Uczenie online z liniową pamięcią niezależne od modelu w sieciach impulsacyjnych

Dlaczego trenowanie komputerów wzorowanych na mózgu jest takie trudne

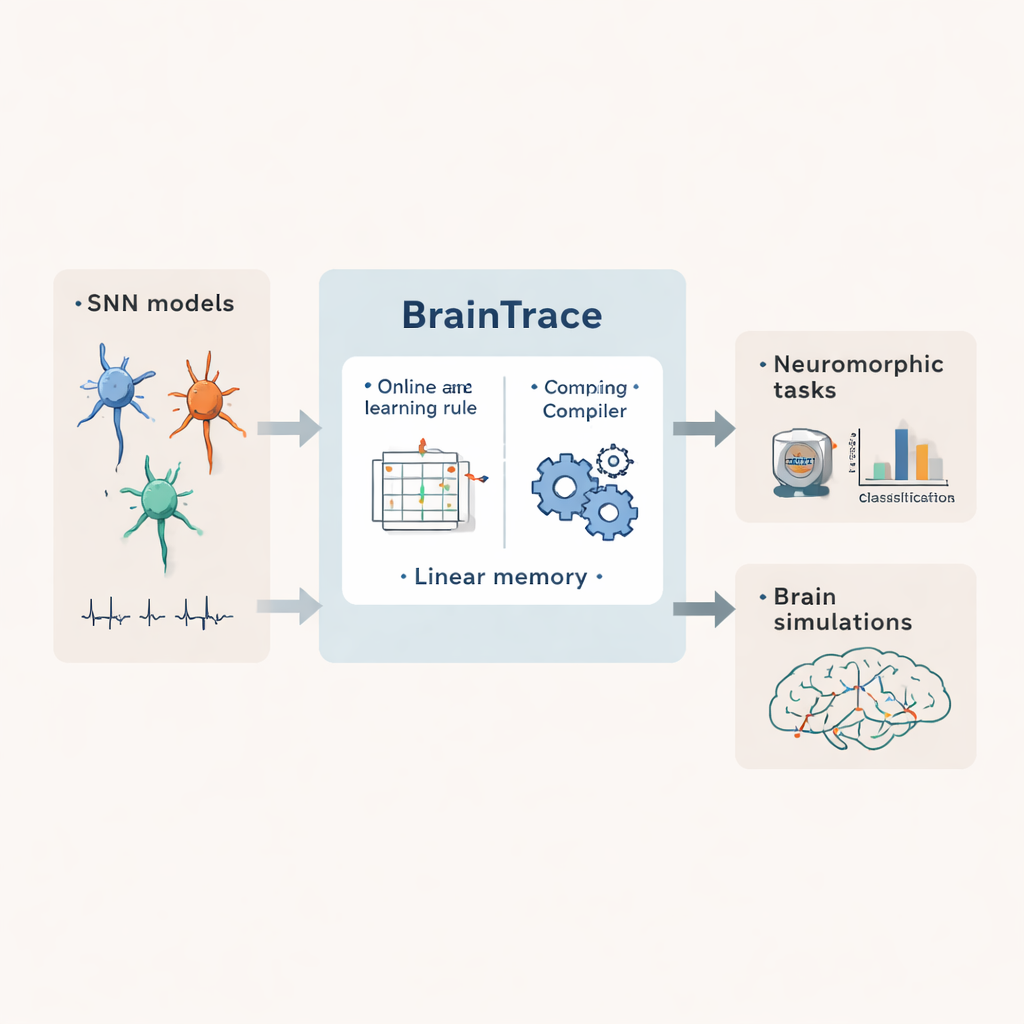

Sieci impulsacyjne to klasa sztucznych sieci, które komunikują się za pomocą krótkich impulsów elektrycznych, podobnie jak prawdziwe komórki mózgowe. Obiecują bardzo wydajne, zainspirowane biologicznie przetwarzanie oraz bardziej realistyczne symulacje obwodów nerwowych. Jednak nauczanie tych sieci wykonywania złożonych zadań, szczególnie w długich przedziałach czasu, zwykle wymaga ogromnych zasobów pamięciowych i ręcznie pisanego kodu. W artykule przedstawiono BrainTrace — system zaprojektowany, by uczynić trenowanie sieci impulsacyjnych praktycznym i szeroko dostępnym.

Nauczanie sieci działających w czasie rzeczywistym

Najskuteczniejsze metody trenowania sieci wzorowanych na mózgu polegają na odtworzeniu całej sekwencji aktywności i propagowaniu sygnałów błędu wstecz przez każde krok czasowy. Podejście to, znane jako backpropagation through time, może być bardzo dokładne, lecz szybko napotyka ograniczenia, gdy sekwencje są długie lub sieci duże: każdy stan pośredni trzeba zapisać, co powoduje wzrost zapotrzebowania na pamięć zależny zarówno od czasu, jak i rozmiaru sieci. Alternatywne metody „online” aktualizują połączenia krok po kroku w miarę napływu danych, co znacznie redukuje potrzeby magazynowe. Jednak istniejące reguły online działają albo tylko dla silnie uproszczonych modeli neuronów, albo wciąż wymagają pamięci rosnącej kwadratowo z rozmiarem sieci, co utrudnia ich zastosowanie do realistycznych, mózgowych skal.

Ogólna recepta dla wielu typów sieci impulsacyjnych

BrainTrace rozwiązuje ten problem, najpierw opisując sieci impulsacyjne w ujednolicony sposób. Autorzy pokazują, że wiele typów neuronów i synaps można przedstawić jako dwie współdziałające części: wewnętrzną dynamikę opisującą, jak zmienia się stan każdego neuronu w czasie, oraz dynamikę interakcji, która przekształca przychodzące impulsy w prądy płynące między komórkami. Wprowadzają też dwa spojrzenia modelowe, nazwane AlignPre i AlignPost, które organizują synapsy wokół neuronu wysyłającego albo odbierającego. Ta abstrakcja pozwala traktować szeroką gamę modeli biologicznych i inżynieryjnych jedną matematyką — od prostych neuronów przeciekowych po bogatsze komórki z adaptacyjnymi progami i złożonymi synapsami.

Sposób oszczędny pamięciowo na śledzenie przyczyn i skutków

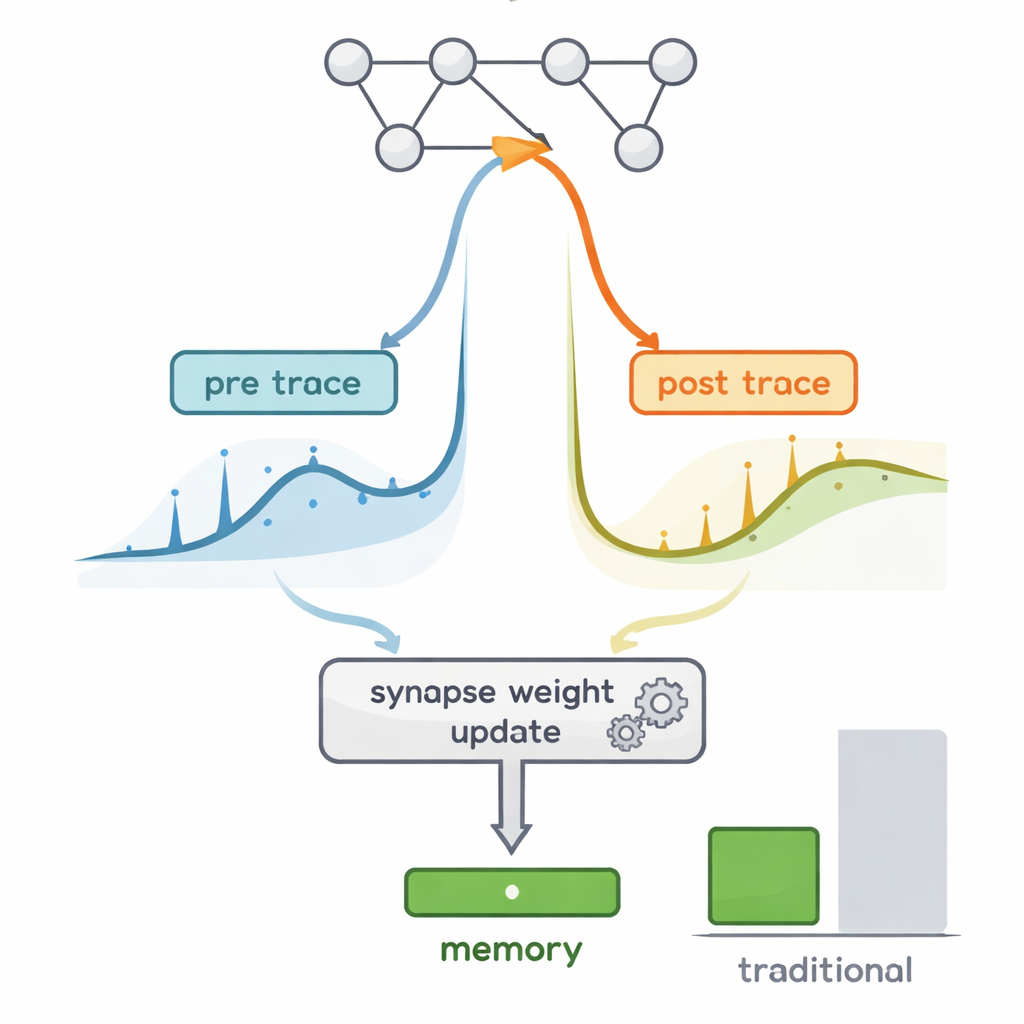

Głównym wyzwaniem w uczeniu online jest śledzenie, jak małe zmiany w każdym połączeniu ostatecznie wpływają na zachowanie sieci — wielkości uchwycone przez tzw. „ślady kwalifikowalności” (eligibility traces). W teorii zachowanie pełnej informacji o kwalifikowalności wymaga śledzenia rozległych macierzy, których rozmiar rośnie z sześcianem liczby neuronów. BrainTrace wykorzystuje trzy kluczowe własności sieci impulsacyjnych: większość neuronów przez większość czasu jest cicha; przeciek i reset własny każdego neuronu dominują przy zmianach jego stanu; oraz impulsy i przewodności synaptyczne są zawsze nieujemne. Bazując na tych faktach, autorzy wykazują, że ciężkie macierze kwalifikowalności można ściśle przybliżyć jako iloczyn zaledwie dwóch kompaktowych śladów na synapsę — jednego podsumowującego aktywność presynaptyczną i drugiego podsumowującego aktywność postsynaptyczną. Ta reguła propagacji pre‑post, nazwana pp‑prop, wymaga pamięci rosnącej jedynie liniowo wraz z rozmiarem sieci, a mimo to generuje gradienty dobrze zgodne z wynikami pełnego backpropagation.

Narzędzia automatyczne ukrywające matematykę

Ponad samą regułą uczenia, BrainTrace dostarcza kompilator pełniący rolę podobną do bibliotek automatycznego różniczkowania w uczeniu głębokim. Użytkownik zapisuje dynamikę swojego modelu impulsacyjnego w wysokopoziomowym języku. Kompilator BrainTrace analizuje wtedy powiązania między stanami i parametrami, konstruuje niezbędne ślady kwalifikowalności i generuje zoptymalizowany kod uruchamiający pp‑prop lub pokrewny algorytm efektywnie na CPU, GPU lub wyspecjalizowanych akceleratorach. Dzięki temu badacze mogą skupić się na pytaniach naukowych zamiast ręcznie pisać delikatny kod gradientowy, jednocześnie korzystając z online’owego, oszczędnego pamięciowo uczenia.

Od małych sensorów po cały mózg muszki

Autorzy testują BrainTrace na standardowych benchmarkach neuromorficznych, gdzie sieci impulsacyjne klasyfikują zdarzeniowe wersje obrazów, dźwięków i gestów. W różnych zestawach danych i architekturach pp‑prop osiąga dokładność porównywalną z pełnym backpropagation, przy użyciu wielokrotnie mniejszej pamięci i działając szybciej niż inne metody online. Co kluczowe, system skaluje się też do wymagających problemów neurobiologicznych. W jednym przykładzie biologicznie szczegółowa sieć impulsacyjna z oddzielnymi populacjami pobudzającymi i hamującymi uczy się zadania akumulacji dowodów i rozwija wzorce aktywności przypominające te rejestrowane w korze myszy. W innym, model impulsacyjny z ponad 125 000 neuronów, połączony zgodnie z connectomem muszki owocowej, jest trenowany do odtworzenia aktywności spoczynkowej zarejestrowanej w całym jej mózgu — osiągnięcie wykraczające poza pojemność pamięciową konwencjonalnego trenowania na pojedynczej karcie graficznej.

Co to oznacza dla przyszłości komputerów wzorowanych na mózgu

Dla osób niebędących specjalistami główny przekaz jest taki: BrainTrace przekształca niegdyś niepraktyczne marzenie — trenowania bogatych, mózgowych sieci impulsacyjnych w czasie rzeczywistym — w realistyczną możliwość. Znalezienie sprytnego sposobu śledzenia przyczyn i skutków przy użyciu niewielkiej ilości pamięci oraz opakowanie tego w narzędzia automatyczne przybliża obliczenia inspirowane mózgiem do codziennego zastosowania zarówno w sztucznej inteligencji, jak i w podstawowej neurologii. Wskazuje drogę ku maszynom, które uczą się i adaptują z efektywnością i precyzją czasową rzeczywistych układów nerwowych, bez wymogu zasobów na poziomie superkomputerów.

Cytowanie: Wang, C., Dong, X., Ji, Z. et al. Model-agnostic linear-memory online learning in spiking neural networks. Nat Commun 17, 1745 (2026). https://doi.org/10.1038/s41467-026-68453-w

Słowa kluczowe: sieci impulsacyjne, uczenie online, komputery neuromorficzne, symulacja mózgu, trenowanie oparte na gradientach