Clear Sky Science · nl

Chirurgische RARP-copiloot: een vision language model voor robot-geassisteerde radicale prostatectomie

Slimmere hulp in de operatiekamer

Moderne prostaatkankeroperaties worden uitgevoerd met geavanceerde robots en camera’s, maar chirurgen moeten nog steeds complexe beslissingen nemen, snel wisselende beelden verwerken en constant vragen van trainees en personeel beantwoorden. Dit artikel introduceert een kunstmatige intelligentie–"copiloot" die de live operatievideo kan bekijken en gesproken vragen ter plekke kan beantwoorden, vergelijkbaar met een zeer goed geïnformeerde assistent. Voor patiënten wijst dit op veiliger en consistenter uitgevoerde ingrepen; voor chirurgen suggereert het een toekomst waarin deskundige begeleiding en onderwijs in elke operatiekamer beschikbaar zijn.

Een digitale assistent die kan zien en spreken

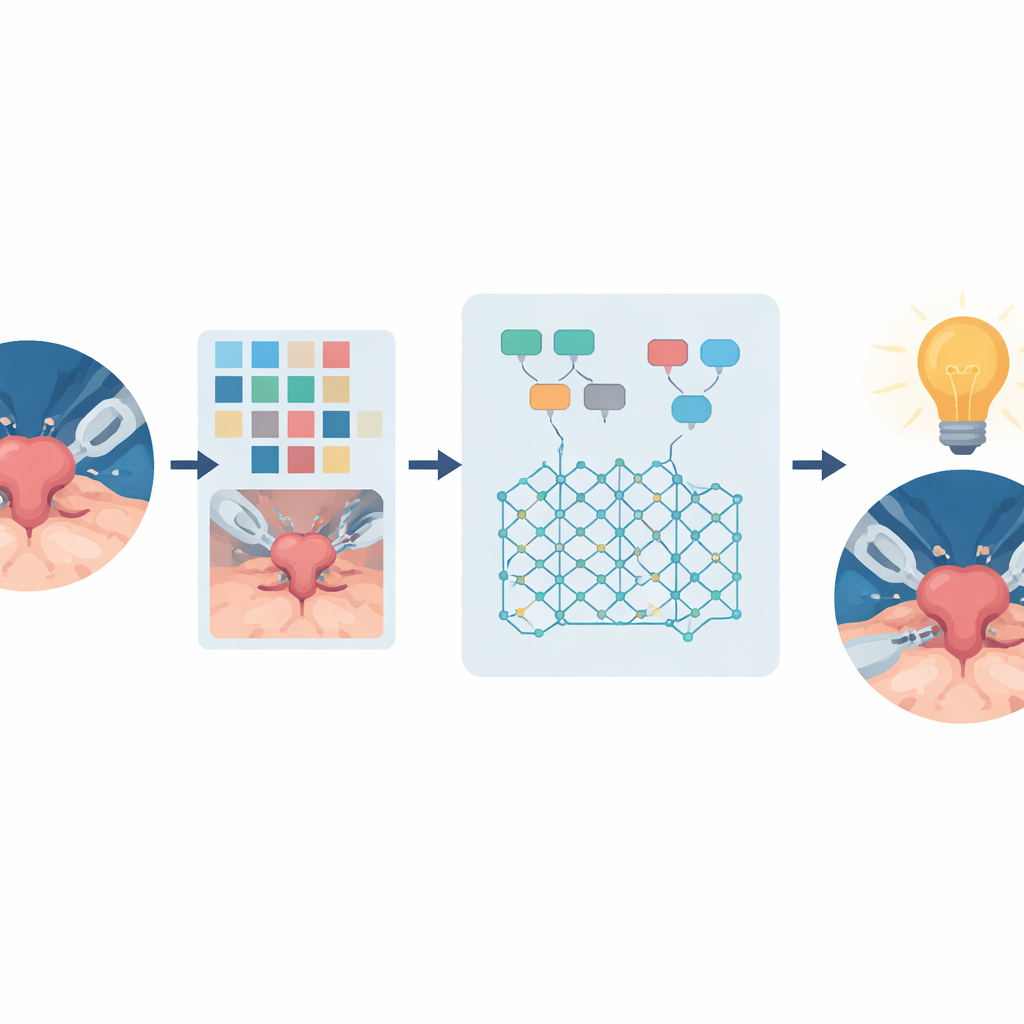

De onderzoekers bouwden de Surgical RARP Copilot voor één specifieke ingreep: robot-geassisteerde radicale prostatectomie, de standaardoperatie voor veel mannen met gelokaliseerde prostaatkanker. Bij deze procedure verwijdert een door de chirurg bediend robotsysteem de prostaat via kleine sleutelgrootte incisies, begeleid door een hoge-resolutie camera in het lichaam. Traditionele op tekst gebaseerde AI-systemen verwerken alleen tekst en kunnen daarom niet interpreteren wat de chirurgische camera laat zien. De Copilot combineert daarentegen computervisie met een groot taalmodel, waardoor hij het operatieveld kan "zien" en natuurlijke taalantwoorden kan genereren over wat er gebeurt, welke instrumenten zichtbaar zijn of wat de volgende stappen in de operatie zouden moeten zijn.

De Copilot chirurgische knowhow bijbrengen

Om de Copilot zinvolle chirurgische expertise te geven, stelde het team een gespecialiseerd trainingsdataset samen in plaats van te vertrouwen op algemene internetbeelden. Ze verzamelden bijna 20.000 gelabelde frames uit opgenomen prostaatoperaties en markeerden de posities van instrumenten, organen en de huidige stap van de procedure. Ze voegden ook schattingen van diepte-informatie toe, zodat het systeem kon afleiden welke objecten voor of tegen elkaar liggen. Met door experts ontworpen regels werden deze labels omgezet in gedetailleerde geschreven bijschriften die beschrijven wat elk frame toonde en waar in de operatie het zich voordeed. Grote taalmodellen werden vervolgens geprikkeld, in de stem van verschillende "persona’s" variërend van seniore chirurgen tot nieuwsgierige kinderen, om op basis van die bijschriften meer dan een miljoen vraag–antwoordparen te genereren. Een apart model controleerde deze paren op logische consistentie en gebrekkige voorbeelden werden gefilterd voordat de training begon.

Hoe goed de Copilot presteert

Nadat hij was getraind, werd de Copilot op verschillende manieren getest. Op een apart gehouden set synthetische vraag–antwoordparen verbeterde fine-tuning het vermogen van het model om ten minste gedeeltelijk juiste antwoorden te geven van ongeveer 61% naar 83%, en volledig correcte antwoorden van 0% naar 59%. Menselijke beoordelaars stelden daarna 650 vragen over vooraf opgenomen chirurgische beelden; bijna zeven van de tien antwoorden werden als volledig correct beoordeeld. Het systeem voerde ook klassieke computervisiestaken uit zonder extra hertraining: het identificeerde welke stap van de prostatectomie gaande was op basis van één videoframe met 82% nauwkeurigheid en herkende chirurgische instrumenten met een F1-score van 94%, en schatte tegelijkertijd hoeveel tijd er nog in de operatie resteerde. Deze resultaten suggereren dat één enkel, verenigd model kan concurreren met gespecialiseerde tools op meerdere taken en tegelijkertijd open gesprekken kan voeren.

AI inzetten tijdens een live ingreep

De meest opvallende demonstratie vond plaats in een echte operatiekamer. De Copilot werd ingezet op een krachtige edgecomputer die direct was gekoppeld aan de video-feed van de robotchirurgie. Tijdens een live prostatectomie, uitgevoerd op een ander robotplatform dan dat voor de training, stelden een publiek van chirurgen en ingenieurs 276 vragen via hun smartphones. Na het filteren van irrelevante en dubbele vragen oordeelden experts dat de Copilot ongeveer 77% van de overgebleven vragen correct beantwoorde—vergelijkbaar met zijn offline prestaties. Het systeem reageerde in ongeveer een halve seconde voordat het begon te antwoorden en produceerde tekst snel genoeg om interactief te lijken, terwijl het veiligheidsfilters toepaste en conservatief handelde bij onzekerheid.

Wat dit betekent voor toekomstige chirurgie

Voor leken is de kernboodschap dat een AI-systeem nu in real time een delicate kankeroperatie kan volgen en nuttige, contextbewuste antwoorden kan geven over wat er gebeurt en wat de volgende stappen zouden moeten zijn. Hoewel de huidige Copilot beperkt is tot één type ingreep, steunt op losse snapshots in plaats van volledig videogeheugen en nog geen toegang heeft tot volledige medische dossiers, bewijst hij dat multimodale AI veilig in de operatiekamer kan worden gebracht. Naarmate vergelijkbare systemen op meer procedures worden toegepast, gekoppeld aan rijkere patiëntgegevens en rigoureus getest op klinische impact, kunnen ze training ondersteunen, de communicatie in het team verbeteren en uiteindelijk helpen complexe operaties veiliger en transparanter te maken.

Bronvermelding: Bogaert, W., Remy, F., Tejero, J.G. et al. Surgical RARP copilot: a vision language model for robot-assisted radical prostatectomy. npj Digit. Surg. 1, 3 (2026). https://doi.org/10.1038/s44484-025-00003-1

Trefwoorden: robotchirurgie, prostaatkanker, chirurgische AI, vision language model, assistent in de operatiekamer