Clear Sky Science · nl

Systematische evaluatie en richtlijnen voor het Segment Anything Model in chirurgische videoanalyse

Waarom slimme videotools belangrijk zijn in de operatiekamer

Moderne chirurgie wordt steeds vaker geleid door video: kleine camera’s kijken van binnenuit terwijl chirurgen delicate instrumenten op een scherm hanteren. Deze rijke maar rommelige videobeelden omzetten in duidelijke, gelabelde kaarten van instrumenten en weefsels kan operaties veiliger maken, opleiding effectiever en toekomstige robotondersteuning betrouwbaarder. Deze studie pakt een krachtig, algemeen visiesysteem — oorspronkelijk getraind op alledaagse beelden — en stelt een eenvoudige maar belangrijke vraag: kan het goed genoeg “zien” binnen het menselijk lichaam om nuttig te zijn in echte chirurgie, zonder van nul opnieuw te worden getraind op dure medische data?

Een flexibel visietool gebouwd voor elk tafereel

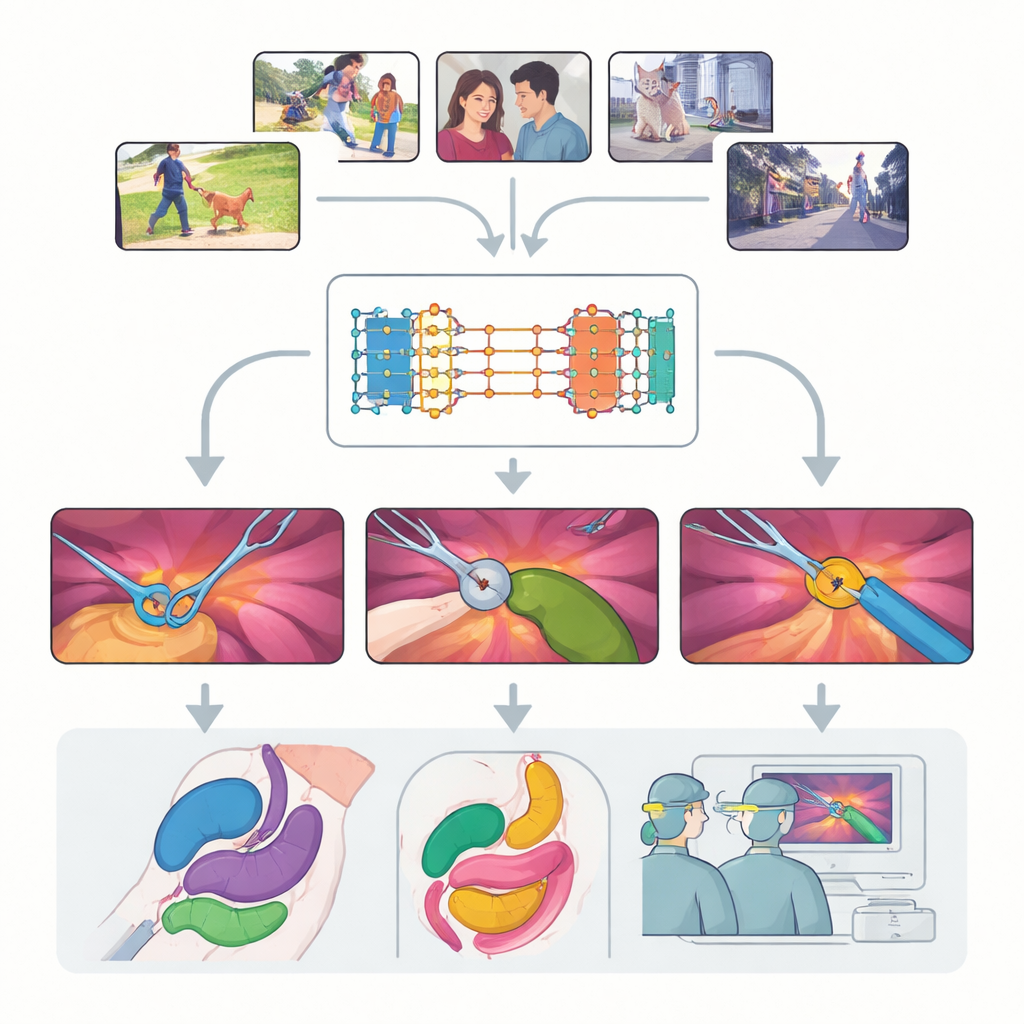

Het onderzoek draait om het Segment Anything Model 2 (SAM2), een groot AI-systeem dat objecten in beelden kan aanwijzen zodra het een aanwijzing of „prompt” krijgt over waarnaar gekeken moet worden. In tegenstelling tot traditionele modellen die vaste categorieën leren, is SAM2 klasse-agnostisch: het maakt niet uit of een object een hond, een auto of een chirurgische grijper is, zolang de gebruiker erop wijst met een punt, een kader of een voorbeeldmasker. Een belangrijke vooruitgang in SAM2 is het geheugenregister, dat onthoudt hoe een object er in eerdere frames uitzag en dat geheugen gebruikt om het in de tijd te volgen. Dit maakt SAM2 bijzonder veelbelovend voor chirurgische video, waar instrumenten in- en uit beeld bewegen en weefsels voortdurend vervormen.

Het model testen over veel operaties heen

De auteurs voeren een grootschalige, systematische evaluatie van SAM2 uit op negen uiteenlopende datasets die zeventien soorten ingrepen bestrijken, van laparoscopische galblaasverwijdering tot robotgeassisteerde prostaatoperaties en endoscopie. Ze onderzoeken drie belangrijke uitdagingen: het volgen van instrumenten, het segmenteren van meerdere organen en het begrijpen van scènes die gereedschap en weefsel door elkaar hebben. Voor elk van deze testen ze verschillende manieren om het model te prompten — enkele punten, meerdere punten, begrenzingskaders en volledige maskers — en verkennen ze hoe vaak de prompts ververst moeten worden naarmate de video doorloopt. Ze vergelijken ook het kant-en-klare model met verschillende methoden om het licht bij te stellen op chirurgische beelden om te zien hoever de prestaties kunnen worden opgeschroefd zonder enorme nieuwe datasets.

Wat het beste werkt binnen het lichaam

Al met al blijkt SAM2 verrassend sterk in deze onbekende omgeving. Zonder chirurgische hertraining segmenteert het al instrumenten en veel organen op competitief niveau vergeleken met gespecialiseerde medische modellen, vooral wanneer het rijke prompts krijgt zoals begrenzingskaders of maskers. Periodiek de prompts „herinitialiseren” elke 30 frames — in wezen het systeem eraan herinneren wat waar is — verbetert het volgen sterk bij lange, complexe opnames. Wanneer de onderzoekers slechts specifieke onderdelen van SAM2 fijn afstemmen, zoals de module die prompts omzet in maskers, stijgt de nauwkeurigheid in multi-orgaan scènes sterk terwijl de trainingsbehoefte bescheiden blijft. Daarentegen kan het proberen het volledige beeldencoder-gedeelte met beperkte chirurgische data aan te passen de prestaties juist schaden, wat suggereert dat het grootste deel van SAM2’s algemene visuele kennis ongemoeid gelaten moet worden.

Beperkingen in rommelige, snel veranderende scènes

De studie legt ook duidelijke zwakke punten bloot. SAM2 heeft moeite wanneer het camerabeeld smal is, de beeldkwaliteit ruisig of slecht belicht is, of wanneer weefsels geen scherpe grenzen hebben, zoals in sommige endoscopische procedures. Fijne vertakkende structuren zoals bloedvaten en afvoergangen zijn moeilijk te scheiden wanneer ze overlappen of hetzelfde ruwe silhouet delen. Het gebruik van videogeheugen helpt niet altijd: in zeer dynamische scènes met snelle camerapunten kunnen de temporele signalen het model misleiden in plaats van stabiliseren. Deze bevindingen benadrukken dat, hoewel een algemeen foundation-model veel aankan, sommige chirurgische realiteiten nog steeds domeinspecifieke afstemming en beter omgaan met beweging en verschijningsveranderingen vereisen.

Richtlijnen voor toekomstige slimme chirurgiesystemen

Uit deze uitgebreide tests destilleren de auteurs praktische adviezen voor onderzoekers en clinici die SAM2 in chirurgische projecten willen gebruiken. Ze raden aan te beginnen met masker- of kaderprompts en eenvoudige, beeldgebaseerde fijnafstemming gericht op de maskerdecodeerder, periodieke promptverversingen toe te voegen voor lange video’s, en alleen meer geavanceerde videotraining te verkennen wanneer scènes relatief stabiel zijn. Ze tonen aan dat zelfs spaarzaam gelabelde clips — slechts enkele geannoteerde frames — voldoende kunnen zijn om het model effectief aan te passen. Simpel gezegd is de conclusie bemoedigend: één enkel, breed getraind visiemodel kan veel verschillende chirurgische segmentatietaken aan, waardoor de noodzaak om voor iedere ingreep een nieuw hulpmiddel te bouwen drastisch vermindert. Met doordachte prompting en lichte aanpassingen zouden systemen zoals SAM2 krachtige bouwstenen kunnen worden voor de volgende generatie van chirurgische navigatie-, automatiserings- en opleidingshulpmiddelen.

Bronvermelding: Yuan, C., Jiang, J., Yang, K. et al. Systematic evaluation and guidelines for segment anything model in surgical video analysis. npj Digit. Surg. 1, 2 (2026). https://doi.org/10.1038/s44484-025-00002-2

Trefwoorden: analyse van chirurgische video, beeldsegmentatie, foundation-modellen, computerondersteunde chirurgie, medische AI