Clear Sky Science · nl

Verklaarbaar meergranaat‑toekenning redeneerkader voor het detecteren van nepnieuws

Waarom het moeilijker wordt om nepnieuws te herkennen

Elke dag razen miljoenen berichten met woorden en afbeeldingen door sociale media. Sommige zijn onschuldig, sommige waar en sommige zorgvuldig vervaardigde vervalsingen bedoeld om aandacht te trekken, emoties op te roepen of meningen te beïnvloeden. Nu beeldbewerkingsprogramma's en AI‑generatoren goedkoper en makkelijker te gebruiken zijn, is nepnieuws geraffineerder en gevaarlijker geworden. Dit artikel introduceert een nieuwe manier om in systemen voor nepnieuwsdetectie te kijken, zodat we niet alleen kunnen zien of een bericht waarschijnlijk onjuist is, maar ook waarom.

Hoe nepnieuws onze ogen en geest misleidt

Makers van nepnieuws spelen in op de manier waarop mensen snel koppen en afbeeldingen scannen. Ze kunnen foto’s vervalsen of bewerken, deels ware details in een onmogelijk verhaal weven, stukken uit verschillende gebeurtenissen aan elkaar plakken of locaties en tijdlijnen mengen die niet bij elkaar horen. Een enkel bericht over een actueel voorval kan een dramatische afbeelding tonen van een ander incident jaren eerder, of een overtuigende foto kan volledig door AI zijn gegenereerd. Traditionele detectiesystemen behandelen meestal alle valse berichten op dezelfde manier en persen tekst en beeld in één gemengde “kenmerkensoep.” Die benadering kan redelijk werken, maar gedraagt zich als een zwarte doos: het is moeilijk voor journalisten, platforms of gewone gebruikers om de specifieke aanwijzingen te begrijpen die het alarm veroorzaakten.

Een nieuwe vraag: “Waarom is dit nep?”

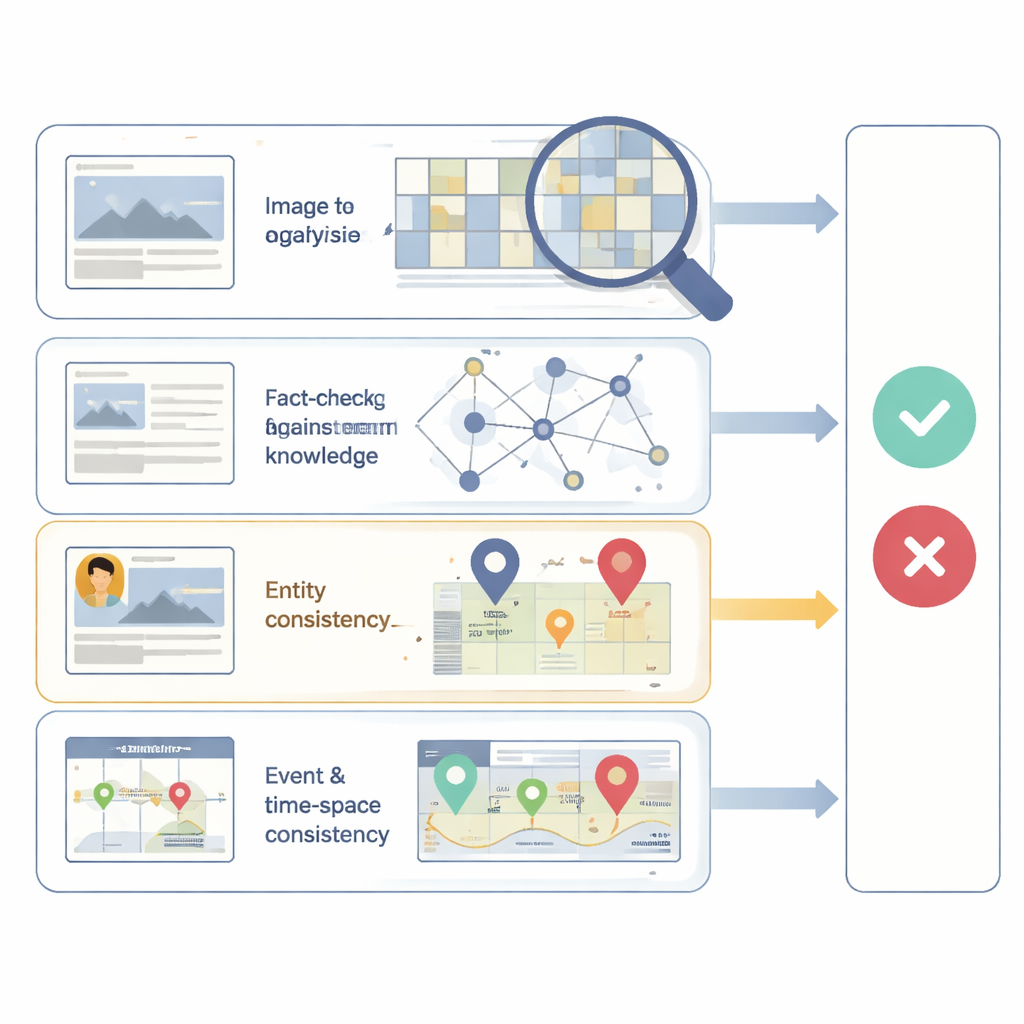

De auteurs stellen een verklaarbaar kader voor genaamd EMAR‑FND dat nieuwsberichten vanuit vier verschillende invalshoeken bekijkt, elk gekoppeld aan een gangbare manier waarop vervalsingen worden gemaakt. Ten eerste onderzoekt het of de afbeelding zelf tekenen van manipulatie of synthetische generatie vertoont, door te letten op subtiele camera‑niveau ruispatronen die veranderen wanneer een afbeelding is aangepast. Ten tweede controleert het of de feiten van het verhaal overeenkomen met vertrouwde externe kennis, zoals bekende relaties tussen mensen, plaatsen en gebeurtenissen. Ten derde kijkt het of de sleutelentiteiten in de tekst—zoals een publieke figuur of een stad—echt overeenkomen met wat op de bijbehorende afbeelding te zien is. Ten vierde beoordeelt het of het beschrevene gebeurtenis qua tijd en ruimte samenhangt, bijvoorbeeld door een mismatch te signaleren tussen een beweerde locatie en visuele aanwijzingen op de foto, of tussen een gerapporteerde tijdlijn en ander bewijsmateriaal.

Sporen bij elkaar brengen vanuit meerdere hoeken

Elk van deze vier controles wordt afgehandeld door een eigen redeneermodule, die een gedeeltelijk oordeel vormt over of dat specifieke aspect betrouwbaar lijkt. De ene module concentreert zich op visuele manipulatie; een andere redeneert over externe kennissystemen; een derde bouwt een rijk netwerk dat woorden, objecten in de afbeelding en geëxtraheerde gebeurtenissen verbindt; en een vierde vergelijkt het bericht met gerelateerd bewijs over tijd en ruimte. In plaats van deze signalen te verbergen in één gefuseerde representatie, houdt EMAR‑FND hun bijdragen apart en combineert ze vervolgens via een definitieve beslissingsstap die kan wegen hoe belangrijk elk perspectief is voor een specifiek geval. Het resultaat is niet alleen een uiteindelijke echt‑of‑nep score, maar ook een toewijzing die bijvoorbeeld laat zien dat een bericht vooral wordt gemarkeerd omdat de afbeelding vervalst lijkt, of omdat het beschrevene nooit overeenstemt met bekende feiten.

Het systeem in de praktijk testen

Om te zien hoe goed deze aanpak werkt, pasten de onderzoekers EMAR‑FND toe op twee publiek beschikbare verzamelingen van echte en valse nieuwsberichten met zowel tekst als afbeeldingen. Over deze datasets presteerde hun methode beter dan verschillende sterke bestaande systemen, met hogere nauwkeurigheid en een betere balans tussen het vinden van valse berichten en het vermijden van valse alarmen. Toen ze keken naar hoe berichten binnen het model clusterden, vormde echt nieuws doorgaans strakke, consistente groepen, terwijl nepnieuws meer verspreid was—wat de vele verschillende trucs van vervalsers weerspiegelt. De toewijzingsuitvoer bleek ook nuttig in lastige, real‑world voorbeelden: berichten waar tekst en afbeelding op het eerste gezicht consistent leken, werden ontmaskerd als nep omdat de afbeelding verborgen manipulatiesporen vertoonde of omdat externe kennis de beweerde feiten tegensprak.

Wat dit betekent voor alledaagse lezers

Kort gezegd toont de studie aan dat het mogelijk is nepnieuwsdetectoren te bouwen die minder als orakels en meer als zorgvuldige onderzoekers functioneren. In plaats van een kaal ja‑of‑nee‑antwoord, benadrukt EMAR‑FND welk deel van een bericht verdacht is: de afbeelding, de feiten, de genoemde personen, of de gebeurtenis zelf. Dit soort verklaring kan factcheckers, platforms en lezers helpen het systeem te vertrouwen en veelvoorkomende patroon van misleiding te leren herkennen. Naarmate nepnieuws zich blijft ontwikkelen, zullen tools die zowel manipulatie kunnen opsporen als uitleggen cruciaal zijn om online informatie‑ecosystemen gezonder en transparanter te houden.

Bronvermelding: Ji, W., Lv, H., Zhao, H. et al. Explainable multi-granularity attribution reasoning framework for fake news detection. npj Artif. Intell. 2, 38 (2026). https://doi.org/10.1038/s44387-026-00093-3

Trefwoorden: detectie van nepnieuws, multimodale misinformatie, verklaarbare AI, integriteit van sociale media, analyse van beeldvervalsing