Clear Sky Science · nl

DeepKoopFormer: een Koopman-verrijkte transformer-gebaseerde architectuur voor tijdreeksvoorspelling

Waarom slimmer voorspellen ertoe doet

Van weer- en energieplanning tot financiële markten: veel van onze belangrijkste beslissingen hangen af van de voorspelling van hoe zaken in de tijd zullen veranderen. Deze "tijdreeksen"—stromen van metingen zoals windsnelheid, elektriciteitsproductie of cryptoprijzen—worden langer, rumoeriger en complexer. Moderne AI-instrumenten genaamd Transformers kunnen deze data verwerken, maar ze gedragen zich vaak als black boxes en kunnen onstabiel worden wanneer ze ver in de toekomst moeten voorspellen. Dit artikel introduceert DeepKoopFormer, een voorspellingsmethode die het voorspellende vermogen van Transformers behoudt en tegelijkertijd wiskundige structuur toevoegt om hun gedrag op lange termijn stabieler, beter interpreteerbaar en betrouwbaarder te maken.

Een nieuwe manier om krachtige modellen te stabiliseren

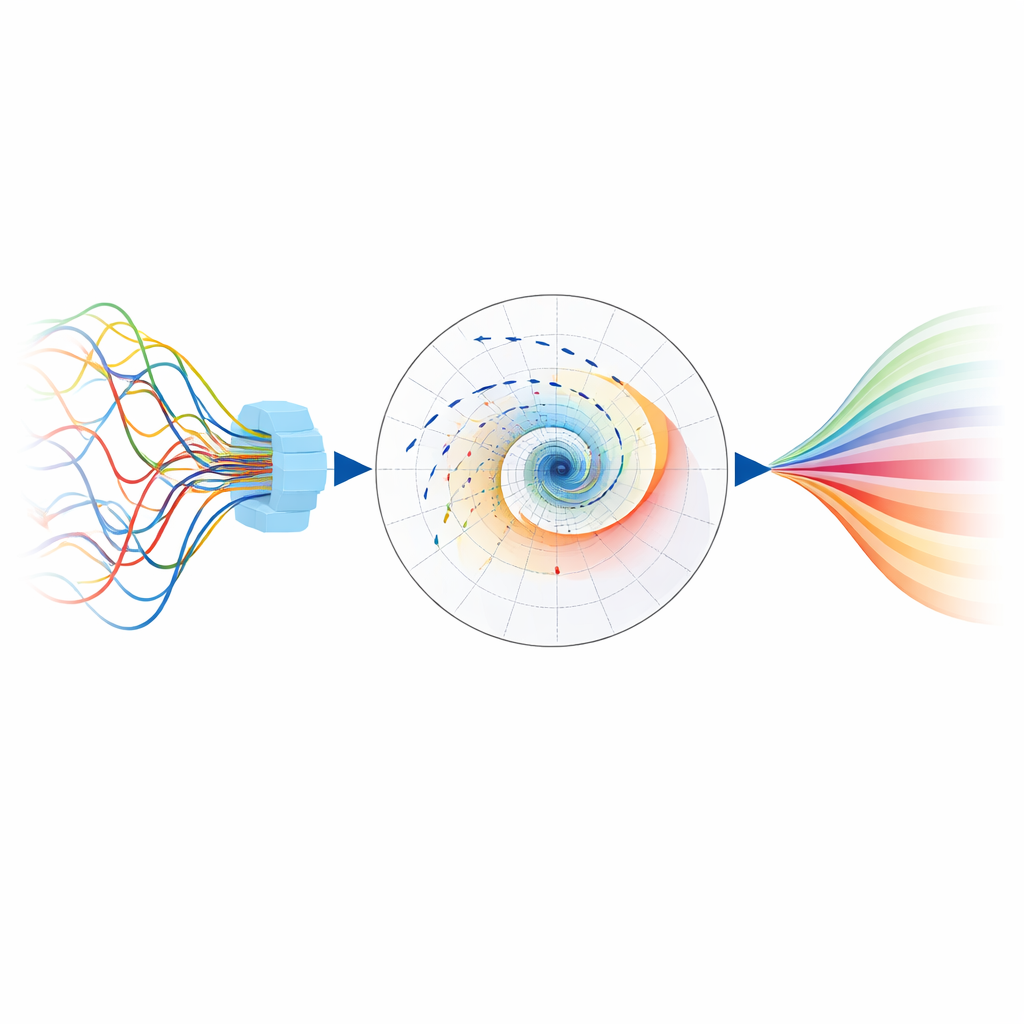

De auteurs vertrekken van een bekend idee in de huidige AI: gebruik een Transformer om ruwe tijdreeksen om te zetten in een rijke interne representatie. DeepKoopFormer voegt vervolgens een zorgvuldig ontworpen middellaag toe, geïnspireerd op een begrip uit de dynamische systemen: de Koopman-operator. In plaats van het model in een ingewikkelde, volledig niet-lineaire evolutie te laten bewegen, werkt deze middellaag de interne toestand vooruit met een eenvoudige lineaire transformatie in een verborgen ruimte. Cruciaal is dat deze transformatie zo is opgebouwd dat haar invloed in de loop van de tijd geleidelijk afneemt in plaats van explosief te versterken, wat wiskundig garandeert dat voorspellingen op lange termijn niet uit de hand lopen of ongecontroleerd gaan oscilleren.

Hoe het model zijn evenwicht bewaart

Om deze stabiliteit af te dwingen construeert DeepKoopFormer de lineaire stap met meerdere beperkingen. De transformatie wordt gefactoriseerd in drie delen: twee orthogonale matrices (die lengtes en hoeken behouden) rondom een diagonaalmatrix van schaalfactoren die allemaal dwingend kleiner dan één zijn. Dit betekent dat de verborgen toestand bij elke update zachtjes wordt samengedrukt in plaats van versterkt. Een tweede ingrediënt, Lyapunov-regularisatie, voegt een strafterm tijdens training toe wanneer de energie van de verborgen toestand van de ene stap naar de volgende toeneemt. Samen zorgen deze mechanismen ervoor dat de interne dynamica rustig en goed gedisciplineerd blijven, terwijl de Transformer voor en de lineaire decoder na deze stap vrij blijven om expressief te zijn. De capaciteit van het model om rijke patronen te leren en de stabiliteit ervan worden door afzonderlijke instellingen beheerst, zodat gebruikers de ene kunnen afstemmen zonder de andere te breken.

De methode aan de tand gevoeld

De onderzoekers evalueren DeepKoopFormer op zowel gecontroleerde als reële problemen. Eerst testen ze het op klassieke chaotische systemen zoals de Lorenz-attractor, waar kleine verschillen tot sterk uiteenlopende toekomsten kunnen leiden, en voegen ze willekeurige ruis toe om echte meetcondities te imiteren. Over verschillende Transformer-backbones volgen de Koopman-verrijkte versies nauwgezet de ware trajecten en blijven ze interne stabiliteit behouden bij veel kortetermijnvoorspellingen. De auteurs gaan vervolgens naar veeleisende reële datasets: klimaatprojecties en reanalyses over Duitsland (windsnelheid en oppervlakte‑druk), cryptovalutaprijzen en elektriciteitsopwekking uit meerdere bronnen in Spanje. In deze gevallen worden DeepKoopFormer-varianten vergeleken met een standaard long short-term memory (LSTM)-netwerk en eenvoudigere lineaire baselines, over veel keuzes van invoervensterlengte, voorspellingshorizon en modelgrootte.

Wat de experimenten aantonen

Over klimaat-, financiële- en energietaken behalen de Koopman-augmenteerde Transformer-modellen over het algemeen lagere voorspellingsfouten en meer stabiel gedrag dan de LSTM-baseline, vooral bij veel stappen vooruit voorspellen of werken met hoge-dimensionale data. Voor wind en druk over Duitsland en voor elektriciteitsproductie blijken de PatchTST- en Informer-versies van DeepKoopFormer vaak het beste te presteren, waarbij zowel zachte trends als snelle fluctuaties betrouwbaar worden vastgelegd. In enkele speciale gevallen waarin de onderliggende patronen vrijwel volledig lineair zijn, wint een zeer eenvoudige lineaire methode nog steeds op testnauwkeurigheid, wat benadrukt dat geen enkel model universeel optimaal is. De Koopman-gebaseerde ontwerpen tonen echter consequent soepelere foutpatronen naarmate de voorspellingshorizon groeit, wat wijst op betere beheersing van langetermijnonzekerheid en minder neiging om zich vast te klampen aan eigenaardigheden in de trainingsdata.

Waarom deze benadering veelbelovend is

Uiteindelijk laat DeepKoopFormer zien dat het mogelijk is de flexibiliteit van deep learning te combineren met de garanties uit de klassieke theorie van dynamische systemen. Door een gestructureerde, stabiele lineaire stap in een anderszins standaard Transformer‑pipeline in te voegen, verkrijgen de auteurs voorspellingen die nauwkeurig zijn, robuust tegen ruis en wiskundig eenvoudiger te analyseren. Voor praktijkmensen die afhankelijk zijn van langetermijnvoorspellingen in klimaatwetenschap, energiesystemen of financiën—waar stabiliteit en interpreteerbaarheid even belangrijk zijn als ruwe nauwkeurigheid—biedt dit kader een manier om krachtige neurale modellen iets meer te vertrouwen en te begrijpen hoe en waarom hun voorspellingen zich in de tijd gedragen.

Bronvermelding: Forootani, A., Khosravi, M. & Barati, M. DeepKoopFormer: a Koopman enhanced transformer based architecture for time series forecasting. npj Artif. Intell. 2, 35 (2026). https://doi.org/10.1038/s44387-026-00085-3

Trefwoorden: voorspelling van tijdreeksen, transformer-modellen, Koopman-operator, stabiele dynamica, klimaat- en energiedata