Clear Sky Science · nl

Een variatiekader voor residu-gebaseerde adaptiviteit in neurale PDE-oplossers en operatorleren

Slimmere AI voor lastige vergelijkingen

Veel van de wetenschappelijke doorbraken van vandaag—van klimaatmodellering tot het ontwerpen van nieuwe materialen—hangen af van het oplossen van complexe vergelijkingen die beschrijven hoe vloeistoffen stromen, golven zich voortplanten of chemische fronten bewegen. Neurale netwerken zijn recent krachtige hulpmiddelen geworden voor deze vergelijkingen, maar ze hebben vaak moeite wanneer de fysica lastig wordt: scherpe schokken, kleine structuren en voorspellingen op lange termijn kunnen ertoe leiden dat ze falen. Dit artikel introduceert een systematische manier om deze AI-oplossers hun inspanningen precies te laten richten op de plekken waar ze het meeste moeite hebben, zodat ze zowel sneller als nauwkeuriger worden.

Waarom neurale netwerken richting nodig hebben

In scientific machine learning worden neurale netwerken getraind om ofwel de oplossing van één vergelijking te reproduceren (zoals bij physics-informed neural networks, of PINN's) of om een volledige mapping van inputs naar oplossingen te leren (bekend als operatorleren). In beide gevallen wordt het netwerk beoordeeld aan de hand van een "residu", een maat voor hoe sterk het zich op elk punt in ruimte en tijd van de onderliggende vergelijking verwijdert. Standaardtraining behandelt alle punten gelijk en minimaliseert de gemiddelde fout. Dat werkt voor eenvoudige problemen, maar bij vergelijkingen met steile gradiënten, bewegende fronten of gelokaliseerde structuren kan een laag gemiddelde ernstige fouten in kritieke gebieden verbergen. Onderzoekers hebben gereageerd met ad‑hoc regels die meer trainingspunten plaatsen waar het residu groot is, maar tot nu toe bleven die regels heuristisch en marginaal gerechtvaardigd.

Een uniforme receptuur voor adaptieve aandacht

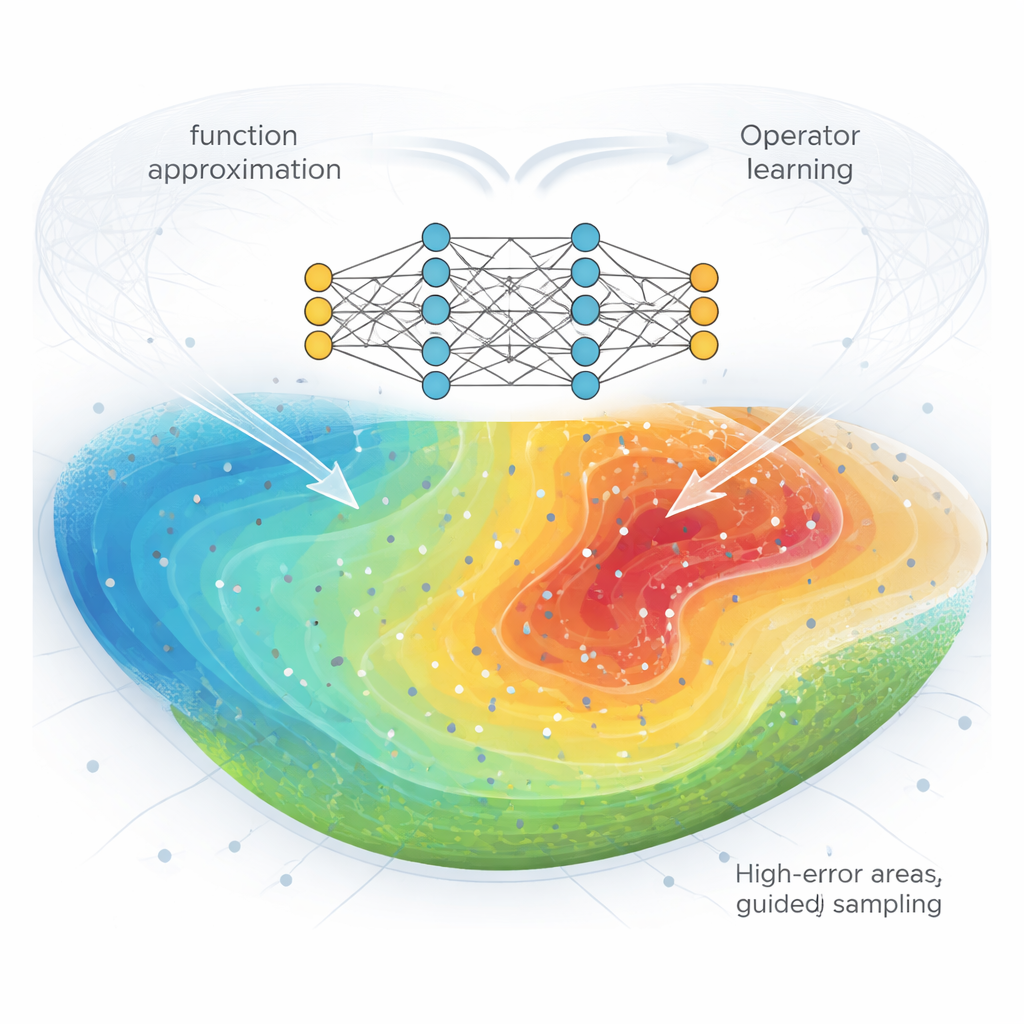

De auteurs ontwikkelen een variatiekader dat deze heuristieken verandert in een principiële receptuur. Het kernidee is om sampling en weging te zien als keuzes over welke kansverdeling over de ruimte (en over trainingsvoorbeelden) het netwerk het meest zou moeten verzorgen. Ze introduceren een familie van "potentiaal"-functies die het residu transformeren naar een nieuw objectief. Verschillende keuzes van potentiaal komen overeen met verschillende prioriteiten: een exponentiële potentiaal drijft het netwerk ertoe zijn grootste enkele fout te verminderen, terwijl een kwadratische potentiaal het verminderen van de spreiding, of variantie, van de fout over het domein benadrukt. Wiskundig leidt het optimaliseren van deze getransformeerde objectieven er vanzelf toe dat er vaker gesampled wordt in gebieden waar het huidige residu groot is. De resulterende methode, variational residual-based attention (vRBA), omvat vele bestaande adaptieve schema's en biedt een duidelijke manier om nieuwe te bedenken.

Uitbreiden naar het leren van volledige fysica-mappen

Moderne AI-oplossers streven steeds vaker niet slechts één oplossing te leren maar een gehele operator: een mapping van inputs zoals beginvoorwaarden of externe krachten naar volledige ruimte‑tijdvelden. Dit is het doel van neurale operatorarchitecturen zoals DeepONet, Fourier Neural Operators (FNO) en tijd-geconditioneerde U‑Nets. Hier verdubbelt de uitdaging zich: er is variatie tussen verschillende inputfuncties en variatie over ruimte en tijd binnen elk voorbeeld. De auteurs passen hun kader aan deze productinstelling aan door twee niveaus van adaptiviteit te combineren. Ten eerste herwegen ze ruimtelijke punten binnen elk voorbeeld zodat gebieden met hoge residuen zwaarder wegen. Ten tweede gebruiken ze de geaccumuleerde residuen om geheel moeilijkere trainingsvoorbeelden preferentieel opnieuw te bemonsteren. Dit hybride schema kan direct in populaire operator‑learning modellen worden geplaatst zonder hun architectuur te herontwerpen.

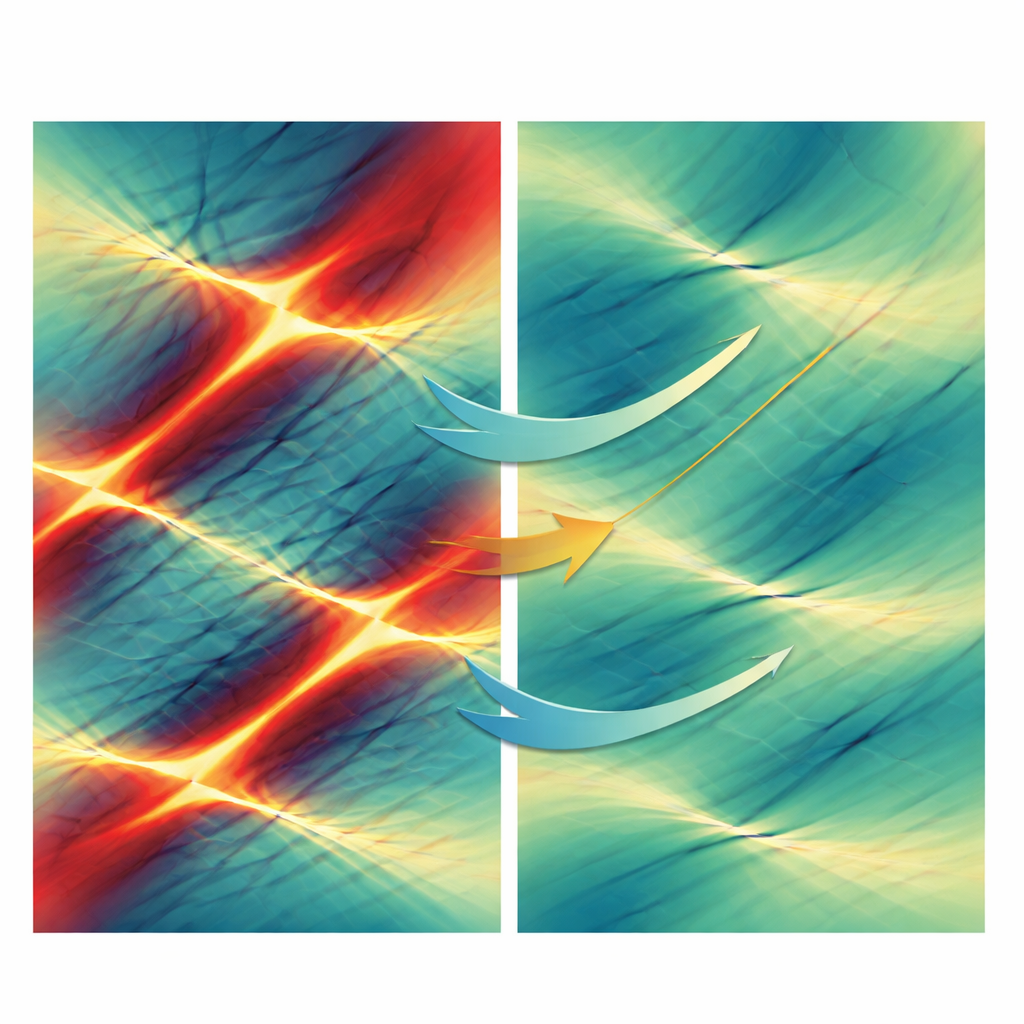

Scherpere details, tragere fouttoename

Over een breed scala aan benchmarks presteert de vRBA-aanpak consequent beter dan traditionele training. Voor PINN's test het team klassieke niet-lineaire vergelijkingen zoals de Allen–Cahn-, Burgers'- en Korteweg–De Vries-vergelijkingen. Sommige van deze problemen zijn bekend omdat ze standaard PINN's verslaan, hetzij door scherpe interne lagen of door interacties van golfpulses. Met vRBA convergeren dezelfde netwerken sneller en bereiken ze aanzienlijk lagere fouten, en in moeilijke gevallen waar de basislijn vrijwel faalt, herstellen de adaptieve methoden nauwkeurige oplossingen. Voor operatorlernen passen ze vRBA toe op bubbelgroei in vloeistoffen, hogedruk schokbuisstromen, tweedimensionale turbulentie en golfvoortplanting. Hier is het belangrijkste voordeel niet alleen een betere uiteindelijke fout, maar een veel tragere accumulatie van fouten in de tijd, wat cruciaal is wanneer de output van een model herhaaldelijk als zijn eigen input wordt teruggevoerd.

Ruis in het leersignaal opruimen

De auteurs schrijven deze winst toe aan twee hoofdeffecten. Ten eerste vermindert vRBA, door te veranderen hoe trainingspunten gesampled of gewogen worden, de statistische ruis in de geschatte loss: willekeurige batches punten geven een betrouwbaarder beeld van hoe goed het netwerk het in het algemeen doet. Dit vermindert rechtstreeks de discretisatiefout, de kloof tussen het continue ideale objectief en de eindige set punten die in de praktijk worden gebruikt. Ten tweede verbetert de methode de signaal‑tegen‑ruisverhouding van de gradiënten die het leren aansturen, zodat verschillende regio's van het domein vaker "overeenkomen" over welke richting de parameters op moeten bewegen. Daardoor ontsnappen netwerken veel eerder aan trage, besluiteloze fases van training en komen ze in een regime waar de fout snel daalt. Het kader verduidelijkt ook wanneer agressieve strategieën—die de grootste residuen sterk bestraffen—kunnen helpen en wanneer ze de training kunnen destabiliseren.

Wat dit betekent voor toekomstige wetenschappelijke AI

Voor niet‑experts is de boodschap dat slimme aandacht voor waar een AI‑oploper fout zit, het tot een veel betrouwbaarder instrument voor wetenschap en techniek kan maken. In plaats van te vertrouwen op vallen‑en‑opstaan regels biedt dit werk een wiskundig stappenplan om neurale netwerken te sturen naar de meest informatieve delen van een probleem, of dat nu schokfronten, fijne oscillaties of langetermijngedrag betreft. Naarmate wetenschappelijke modellen groter worden en in veiligheidskritische toepassingen worden gebruikt, zullen zulke principiële strategieën om fouten te verminderen en het leren te stabiliseren essentieel zijn om krachtige neurale netwerken om te vormen tot betrouwbare wetenschappelijke instrumenten.

Bronvermelding: Toscano, J.D., Chen, D.T., Ooomen, V. et al. A variational framework for residual-based adaptivity in neural PDE solvers and operator learning. npj Artif. Intell. 2, 32 (2026). https://doi.org/10.1038/s44387-026-00084-4

Trefwoorden: physics-informed neural networks, operator learning, adaptive sampling, scientific machine learning, partiële differentiaalvergelijkingen