Clear Sky Science · nl

AI-agent in de gezondheidszorg: toepassingen, evaluaties en toekomstige richtingen

Waarom slimme digitale hulp in de geneeskunde ertoe doet

Ziekenhuizen verdrinken in data, artsen zijn overbelast en patiënten willen duidelijkere antwoorden over hun gezondheid. Een nieuw type kunstmatige intelligentie, gebaseerd op grote taalmodellen die kunnen lezen en schrijven als mensen, wordt nu omgezet in “AI-agents” die redeneerwerk over meerstaps taken kunnen uitvoeren. Dit overzichtsartikel legt uit hoe deze digitale helpers beginnen te ondersteunen bij diagnose, behandelkeuzes, administratie, patiëntgesprekken en zelfs medische opleiding—en waarschuwt tegelijk wat er nodig is om ze nauwkeurig, eerlijk en veilig te houden.

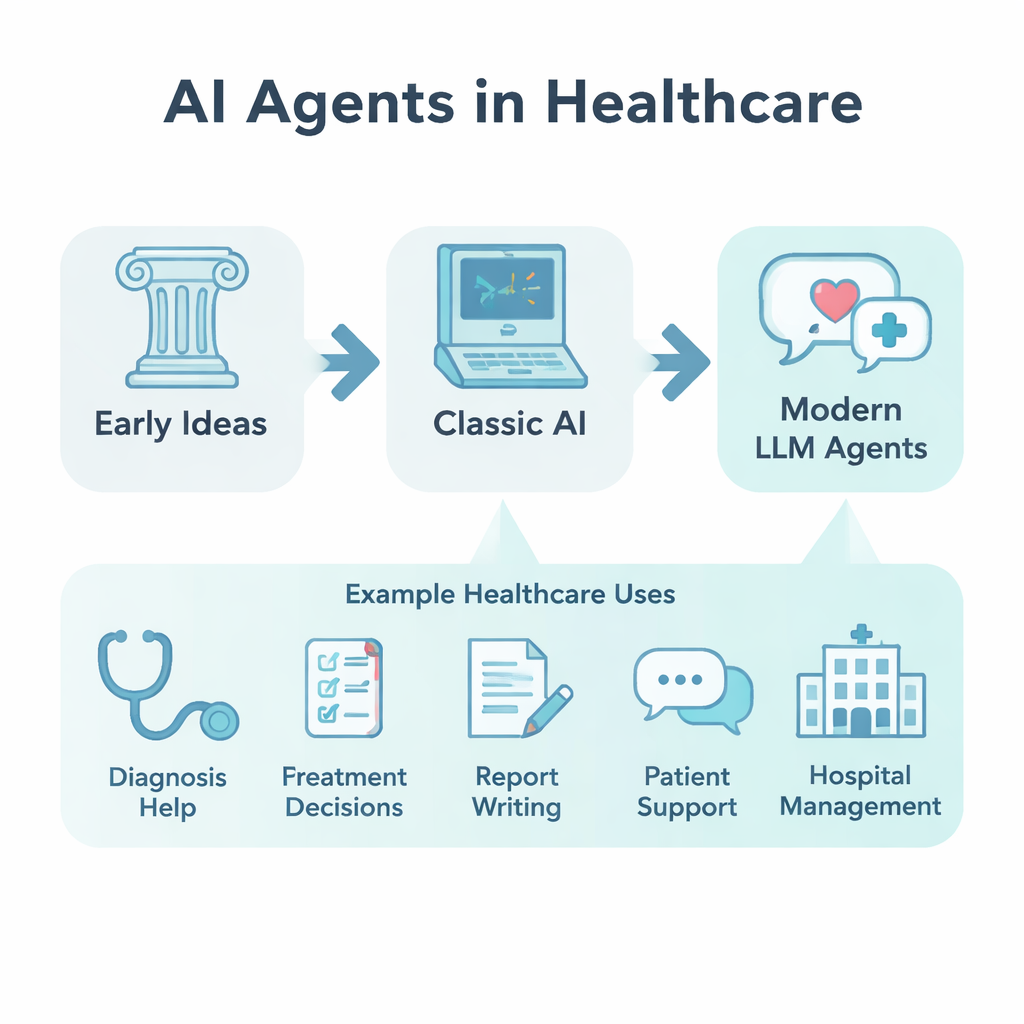

Van gedachte-experimenten naar directe digitale collega’s

Het idee van een “agent” die kan handelen met doelen en intenties gaat terug tot de oude filosofie. Moderne varianten verschenen met vroege kunstmatige intelligentie, expertensystemen en later machine learning en deep learning, waarmee computers patronen uit data konden leren. De doorbraak van grote taalmodellen (LLM’s) na 2022 bracht dit verder: in plaats van alleen vragen te beantwoorden, kunnen deze modellen nu plannen maken, eerdere stappen onthouden en andere softwaretools aanroepen. In de gezondheidszorg betekent dat een AI-agent medische dossiers kan lezen, richtlijnen kan raadplegen, notities kan opstellen en volgende stappen kan voorstellen, en zich daarmee minder gedraagt als een zoekmachine en meer als een junior digitale collega.

Wat deze agents anders maakt dan gewone AI

Volgens de in het artikel gehanteerde definitie is een AI-agent in de gezondheidszorg meer dan één enkel model. Hij heeft een LLM in de kern, omringd door vier kernvermogens: plannen, geheugen, het gebruik van tools en zelfreflectie. Plannen stelt hem in staat een complexe medische taak op te delen in kleinere stappen. Geheugen laat hem het verhaal van een patiënt of een lang besluitvormingsproces bijhouden. Toolgebruik betekent dat hij bijvoorbeeld laboratoriumresultaten uit een elektronisch dossier kan halen of een medische database kan doorzoeken. Zelfreflectiemodules controleren en herzien zijn eigen antwoorden. Samen met sterke taalvaardigheden en een groeiend vermogen tot logisch redeneren maken deze eigenschappen agents flexibel genoeg om van taak en specialisme te wisselen.

Hoe AI-agents in echte zorg worden getest

Onderzoekers bouwen en simuleren nu veel soorten agents om te zien waar ze het meest helpen. Sommige zijn ontworpen om bij de diagnose te ondersteunen door conversaties tussen virtuele artsen en patiënten na te bootsen, of door meerdere specialist-agents een moeilijk geval te laten bediscussiëren. Anderen richten zich op behandelbeslissingen, waarbij input van virtuele generalisten, specialisten en apothekers wordt gecombineerd om tot een gedeeld plan te komen. Er zijn agents die radiologierapporten opstellen uit thoraxfoto’s, of technische bevindingen vertalen naar eenvoudige, patiëntvriendelijke taal. Chatbot-achtige systemen worden in pilotprojecten uitgeprobeerd voor geestelijke gezondheidszorg, gewichtsverliescoaching en medicijnherinneringen. Extra agents helpen bij het beheren van recepten, het opsporen van bijwerkingen, het stroomlijnen van elektronische dossiers of het opleiden van geneeskundestudenten met realistische gesimuleerde patiënten.

Beoordelen of deze systemen klaar zijn voor patiënten

Aangezien fouten in de geneeskunde levensbedreigend kunnen zijn, betoogt het overzicht dat AI-agents op meer moeten worden geëvalueerd dan alleen slimheid. De auteurs groeperen testen in twee lagen. Basiscontroles vragen: Zijn de antwoorden feitelijk correct? Komt de formulering overeen met deskundige rapporten? Voltooit de agent betrouwbaar de taak, inclusief het aanroepen van de juiste tools? Ontwikkelingsgerichte controles bekijken snelheid, duidelijkheid en hoe goed het systeem met mensen communiceert, inclusief respect, empathie en rechtvaardigheid over verschillende patiëntengroepen heen. Studies vergelijken agents zowel met andere toptaalmodellen als met menselijke artsen, en toezichthouders in Europa, het VK, China en elders beginnen officiële “sandbox”-programma’s te ontwerpen om veiligheid, gelijkheid en klinisch voordeel vóór uitrol te testen.

Volgende stappen: robots, regels en menselijk vertrouwen

Vooruitkijkend benadrukt het artikel zeven prioriteiten: agents koppelen aan fysieke robots die in de echte wereld kunnen handelen; algemene modellen mengen met kleinere expertmodellen; evaluatie uitbreiden met kosten, veiligheidsincidenten en patiënttevredenheid; sterkere waarborgen en toezicht opbouwen; ethiek- en privacybescherming verankeren; ontwerpen voor gebruikersvertrouwen en continue terugkoppeling; en medisch personeel helpen hun loopbanen aan te passen om samen met AI te werken in plaats van erdoor te worden vervangen. De auteurs concluderen dat AI-agents krachtige partners in de gezondheidszorg kunnen worden, maar alleen als ze met dezelfde zorg worden ontwikkeld, getest en gereguleerd die de samenleving van elke nieuwe medische technologie verlangt.

Bronvermelding: Zhao, L., Liu, S., Xin, T. et al. AI agent in healthcare: applications, evaluations, and future directions. npj Artif. Intell. 2, 31 (2026). https://doi.org/10.1038/s44387-026-00076-4

Trefwoorden: AI-agents in de gezondheidszorg, grote taalmodellen, klinische beslissingsondersteuning, medische chatbots, digitale gezondheidszorg