Clear Sky Science · nl

Een evaluatie van schattingsonzekerheid in grote taalmodellen

Waarom vage woorden over risico echt belangrijk zijn

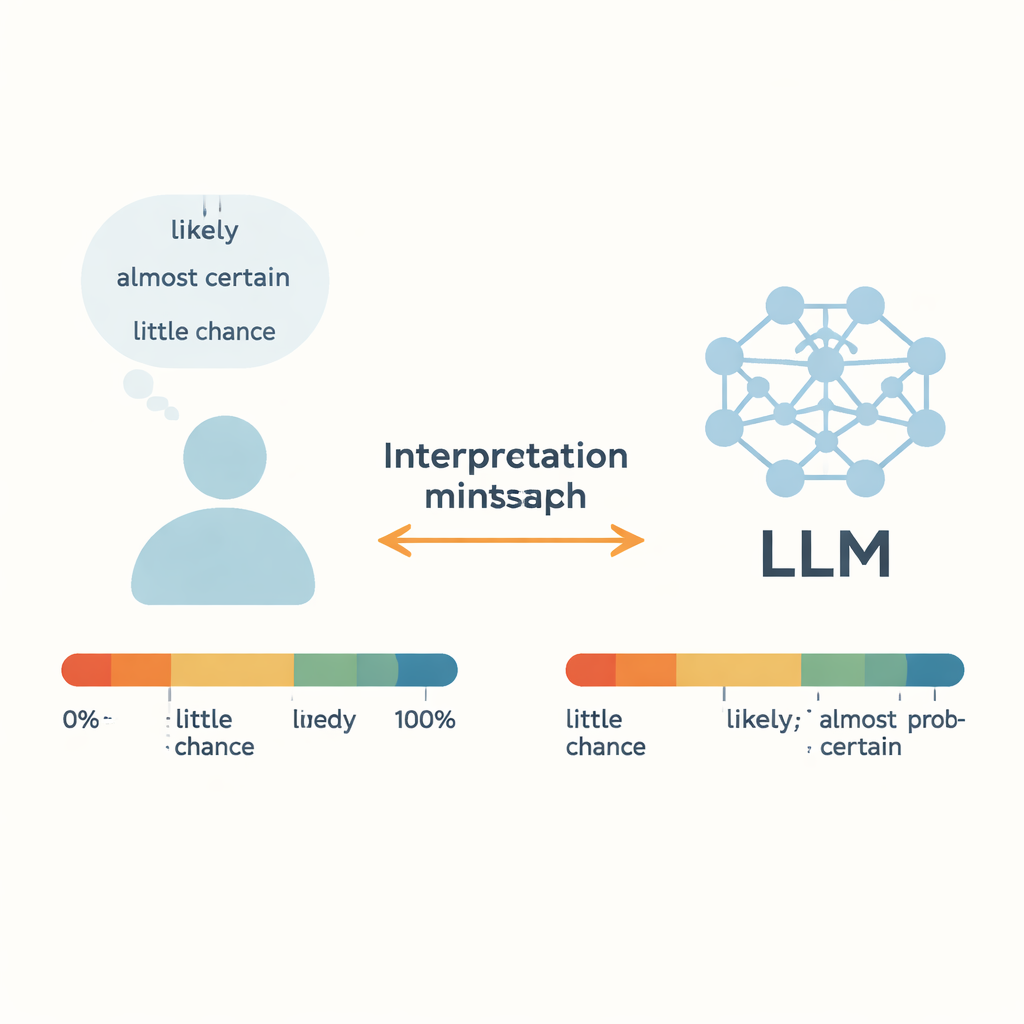

Als een arts zegt dat een behandeling “waarschijnlijk” zal werken, of een weervoorspeller waarschuwt dat er “kleine kans” op een orkaan is, vertrouwen we op die vage woorden om echte beslissingen te nemen. Tegenwoordig gebruiken grote taalmodellen (LLM’s), zoals online chatbots, hetzelfde vocabulaire. Deze studie stelt een eenvoudige maar cruciale vraag: als een AI “waarschijnlijk” zegt, bedoelt die dan hetzelfde als wij — en kan zij betrouwbaar ruwe cijfers omzetten in alledaagse onzekerheidswoorden?

Alledaagse onzekerheid onder de microscoop

De auteurs richten zich op “woorden van schattingswaarschijnlijkheid” (WEP’s) — termen als “bijna zeker”, “waarschijnlijk” en “kleine kans” die mensen gebruiken in plaats van exacte percentages. Eerder werk, teruggaand tot in de jaren zestig bij inlichtingenanalisten, probeerde deze woorden aan numerieke kansen te koppelen door mensen te bevragen. Deze studie vergelijkt die menselijke oordelen met de output van vijf moderne LLM’s, waaronder GPT-3.5, GPT-4, Meta’s Llama-modellen en een Chinees systeem genaamd ERNIE-4.0. Voor 17 veelvoorkomende onzekerheidswoorden kreeg elk model korte, verhaalachtige prompts in het Engels of Chinees en werd gevraagd te reageren met een numerieke kans tussen 0 en 100 procent. Door dit in veel contexten te herhalen bouwden de auteurs volledige kansverdelingen op voor elk woord en elk model, en vergeleken die vervolgens met menselijke enquêtegegevens.

Waar mensen en AI dezelfde taal spreken

Voor de meest extreme uitdrukkingen — zoals “bijna zeker” aan de hoge kant en “bijna geen kans” aan de lage kant — komen LLM’s en mensen verbazingwekkend goed overeen. Zowel mensen als modellen plaatsen deze uitdrukkingen meestal binnen smalle, hoge- of lage-kansbereiken, wat suggereert dat deze sterke termen relatief stabiele betekenissen hebben over contexten heen. Hetzelfde geldt voor “ongeveer gelijk”, dat de meeste mensen en de modellen als ruwweg een 50–50 kans behandelen. Statistische toetsen laten weinig wezenlijk verschil zien tussen menselijke en modelverdelingen voor deze specifieke woorden, wat impliceert dat LLM’s heldere gevallen van bijna-zekerheid of bijna-onmogelijkheden met menselijke precisie kunnen vatten.

Waar betekenissen stilletjes uit elkaar drijven

Vage, middenweg-woorden vertellen een ander verhaal. Voor uitdrukkingen zoals “waarschijnlijk”, “aannemelijk”, “we twijfelen” en “kleine kans” verschillen de numerieke interpretaties van de modellen significant van menselijke oordelen. GPT-4, hoewel algemeen capabeler dan GPT-3.5, vertoont vaak grotere kloven. De auteurs suggereren dat dit komt omdat zulke woorden twee dingen mengen: een gevoel van kans en de houding of stance van de spreker. In echte gesprekken kan “waarschijnlijk” voorzichtig of zelfverzekerd klinken afhankelijk van toon en context, en “we twijfelen” kan scepsis uitdrukken in plaats van een precieze kans. Getraind op enorme, gemengde tekstverzamelingen van het internet, kunnen LLM’s over veel tegenstrijdige gebruikswijzen middelen, waardoor deze subtiliteiten vervagen. Het resultaat is een verborgen mismatch: mensen en AIs kunnen dezelfde zin zien en stilletjes verschillende cijfers aan hetzelfde woord toekennen.

Geslacht, taal en culturele echo’s

De onderzoekers onderzochten ook hoe gendergebonden woordkeus en verschillende talen deze waarschijnlijkheidswoorden vormen. Wanneer prompts verwezen naar “hij” of “zij” in plaats van genderneutrale aanduidingen, produceerden GPT-3.5 en GPT-4 vaak minder variabele, meer “vastgezette” kansschattingen, soms samenvallend op één enkel punt. Dit suggereert dat de modellen rigide patronen uit stereotypen in hun trainingsdata hebben kunnen overnemen, ook al waren de algemene gemiddelden voor mannelijke en vrouwelijke prompts vergelijkbaar. Bij vergelijking van Engelse en Chinese prompts toonden GPT-modellen merkbare verschuivingen in hoe ze dezelfde onzekerheidswoorden interpreteerden. ERNIE-4.0, voornamelijk op Chinese tekst getraind, leek dichter bij Chineessprekende mensen te liggen voor veel termen maar overschatte of onderschatte bepaalde uitdrukkingen nog steeds. Deze bevindingen benadrukken dat hoe een AI over onzekerheid spreekt niet alleen door het gekozen woord wordt bepaald, maar ook door de taal- en culturele patronen in haar training.

Kunnen AI’s cijfers in alledaagse twijfel omzetten?

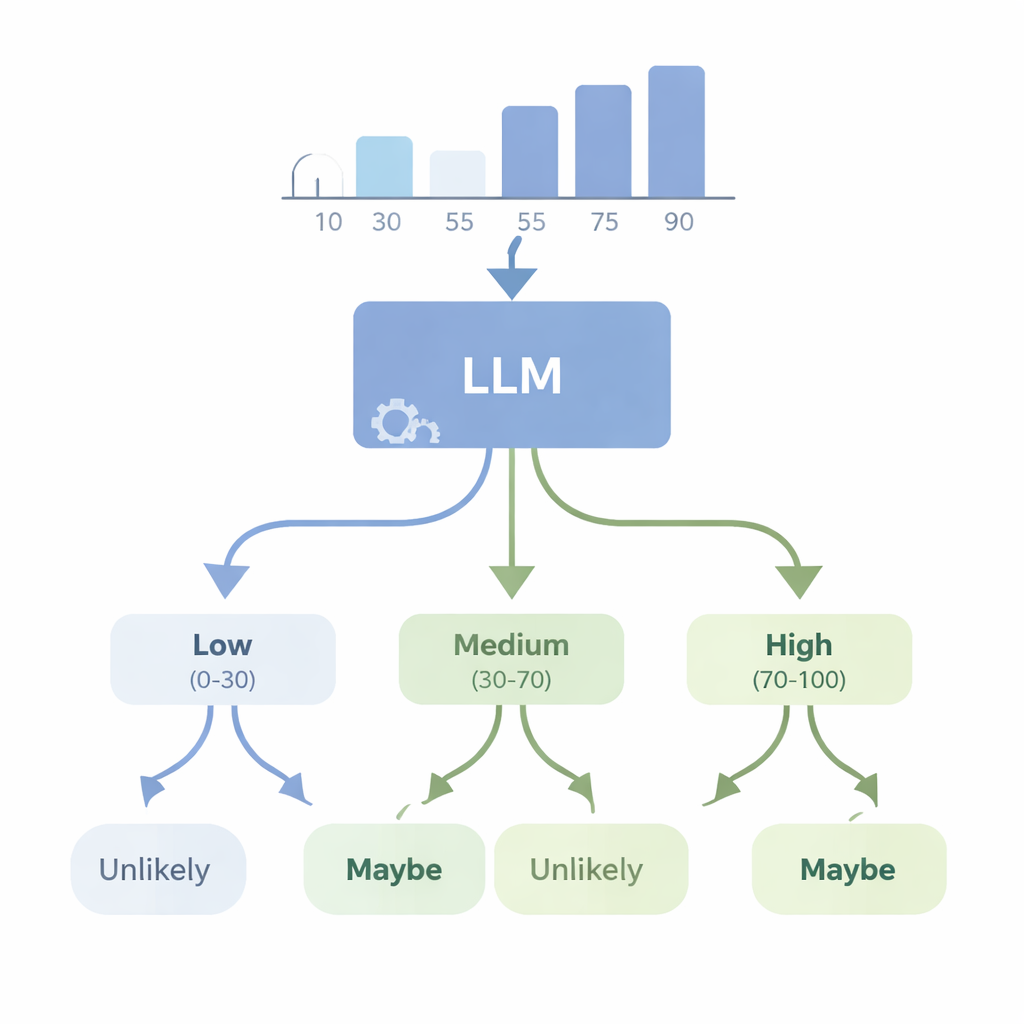

In een tweede reeks experimenten bekeken de auteurs het omgekeerde probleem: kan een geavanceerd model zoals GPT-4 beginnen bij numerieke data en een passend onzekerheidswoord kiezen? Ze voerden het model eenvoudige datasets toe — zoals lijsten met lengtes of toetsresultaten — en vroegen het de best passende WEP te kiezen (bijvoorbeeld “bijna zeker”, “waarschijnlijk”, “misschien”, “onwaarschijnlijk” of “bijna zeker niet”) voor uitspraken over toekomstige uitkomsten. Daarna evalueerden ze GPT-4 met vier nieuwe “consistentie”-scores die nagaan of zijn woordkeuzes logisch zijn wanneer kansen stijgen of dalen, wanneer complementaire gebeurtenissen worden beschreven en wanneer de onderliggende cijfers op gecontroleerde manieren veranderen. GPT-4 deed het veel beter dan willekeurig raden en kon vaak ruwe veranderingen in waarschijnlijkheid volgen, maar het bleef ver van perfecte consistentie. In sommige tests reageerde het model bijna hetzelfde over verschillende betrouwbaarheidsniveaus, wat suggereert dat het deze woorden soms als brede labels beschouwt in plaats van als een fijn afgestemde schaal gekoppeld aan de werkelijke data.

Wat dit betekent voor beslissingen in de echte wereld

Voor lezers is de boodschap voorzichtig maar niet alarmerend. LLM’s kunnen onze sterkste uitdrukkingen van zekerheid en onmogelijkheid al nabootsen, en ze kunnen vaak data samenvatten in redelijke “waarschijnlijk” of “onwaarschijnlijk” uitspraken. Maar deze studie toont aan dat voor veel alledaagse onzekerheidswoorden hun interne kalibratie niet volledig overeenkomt met menselijke intuïtie, en dat hun mapping van cijfers naar taal inconsistent kan zijn. In domeinen zoals geneeskunde, beleid of wetenschapscommunicatie — waar kleine verschuivingen in de manier waarop we risico of vertrouwen formuleren ertoe kunnen doen — hoeft het “waarschijnlijk” van een model niet hetzelfde te betekenen als dat van jou. De auteurs betogen dat om deze systemen veilig te gebruiken we onzekerheidswoorden als een gedeeld codex moeten behandelen die nog zorgvuldige afstemming, testen en mogelijk expliciete numerieke onderbouwing vereist, in plaats van automatisch aan te nemen dat mens en machine hetzelfde bedoelen.

Bronvermelding: Tang, Z., Shen, K. & Kejriwal, M. An evaluation of estimative uncertainty in large language models. npj Complex 3, 8 (2026). https://doi.org/10.1038/s44260-026-00070-6

Trefwoorden: onzekerheid taal, grote taalmodellen, waarschijnlijkheidswoorden, mens-AI communicatie, risico-interpretatie