Clear Sky Science · nl

Alle ogen, geen IMU: de vlieghouding leren enkel uit visie

Zien als een insect

Kleine vliegende robots vertrouwen doorgaans op miniatuur bewegingssensoren om zichzelf rechtop te houden, een beetje zoals een binnenoor voor machines. Insecten daarentegen halen behendige vlucht uit veel eenvoudiger hardware en leunen sterk op wat ze zien. Deze studie toont aan dat een drone iets soortgelijks kan: stabiel vliegen met alleen een speciaal soort camera en een compacte kunstmatige ‘hersenen’, zonder de gebruikelijke bewegingssensoren. Die omslag kan toekomstige palmdikke en insect-schaal drones lichter, goedkoper en robuuster maken.

Waarom de gebruikelijke sensoren verwijderen?

Houdingsregeling—het zorgen dat een drone correct gekanteld blijft ten opzichte van de zwaartekracht—is normaal gesproken in handen van een boordunit die versnelling en rotatie meet. Deze inertiële sensoren werken goed, maar ze voegen gewicht toe, verbruiken energie en kunnen een enkel storingspunt vormen. Veel vliegende insecten hebben daarentegen geen speciale zwaartekrachtsensor en halen in plaats daarvan aanwijzingen over hun helling uit de manier waarop de wereld langs hun ogen beweegt. Als robots dit truukje zouden kunnen nadoen, zouden zeer kleine vliegers alleen visie nodig hebben om zowel te zien als te balanceren, wat het ontwerp vereenvoudigt en het makkelijker maakt ze naar insectformaat te verkleinen.

Een camera die alleen verandering ziet

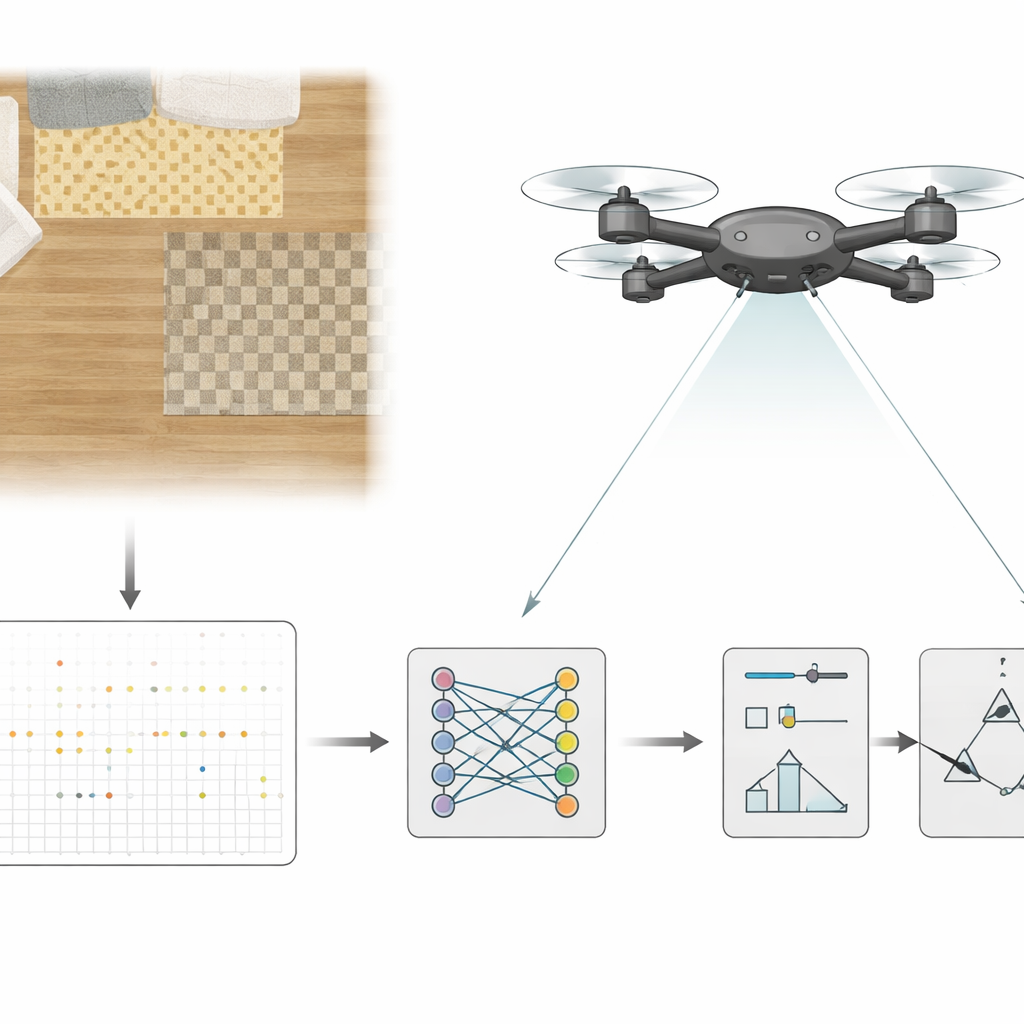

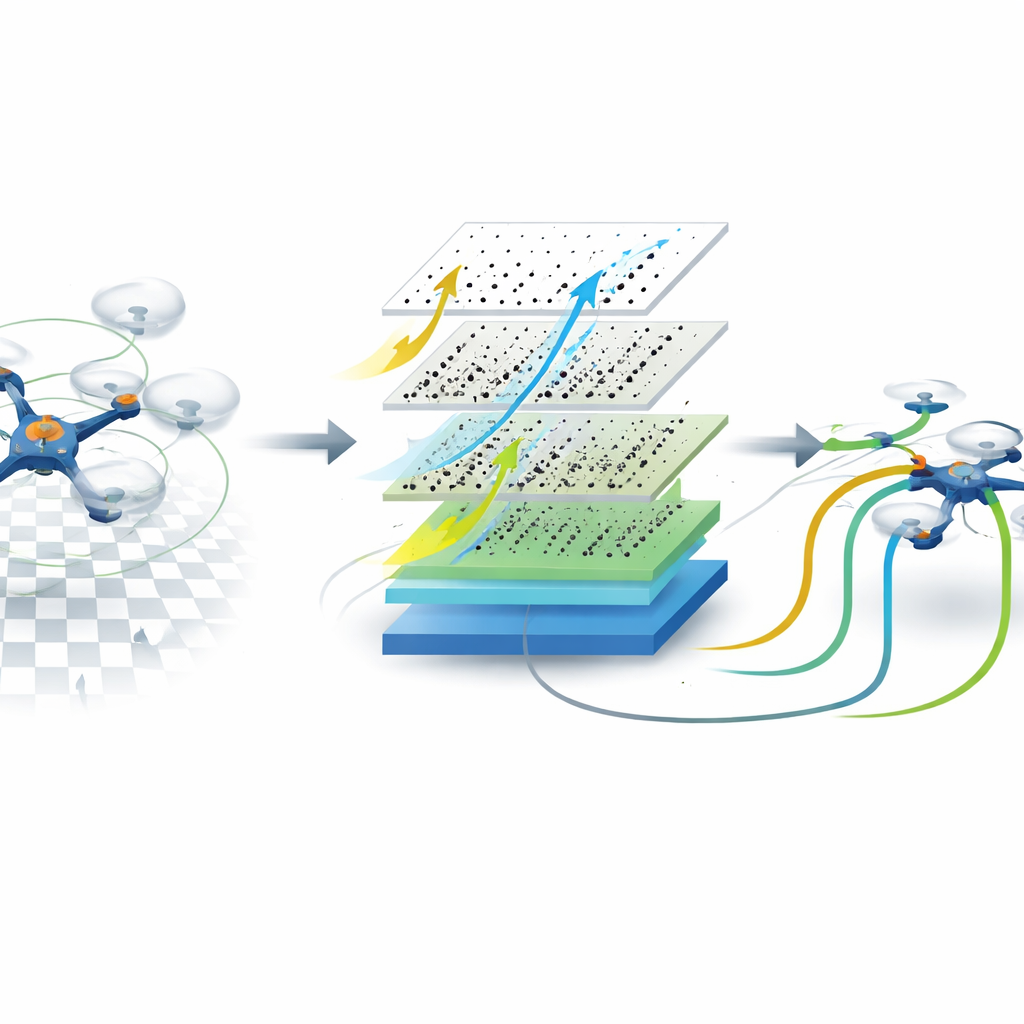

In plaats van een standaard videocamera gebruiken de onderzoekers een event‑gebaseerde camera die naar beneden gericht is vanaf de drone. In plaats van volledige beelden op vaste intervallen te sturen, rapporteert deze sensor alleen kleine helderheidsveranderingen op elke pixel, en dat zeer snel. De stroom van events wordt gebundeld in korte segmenten, elk van slechts vijf duizendsten van een seconde, en deze segmenten worden gevoed aan een kleine recurrente convolutionele neurale netwerk dat draait op een boord‑graphicschip. In de loop van de tijd leert het netwerk patronen van visuele verandering om te zetten in schattingen van de helling van de drone en hoe snel die roteert, en vervangt daarmee effectief de traditionele bewegingsunit in de regelkring.

Een drone leren balanceren met alleen visie

Om deze kunstmatige ‘hersenen’ te trainen vloog het team eerst hun quadrotor in een binnenarena terwijl nog gebruik werd gemaakt van een conventioneel sensorpakket. Tijdens deze vluchten registreerden ze de eventstroom van de camera samen met de kantel‑ en rotatiewaarden die door de standaardcontroller werden geschat. Vervolgens trainden ze het netwerk onder supervisie om die waarden alleen uit de visuele data te reproduceren. In latere tests werden de rollen omgedraaid: de drone vloog met de schattingen van het netwerk die de lus sloten, terwijl onafhankelijke motion‑capture of boordmetingen alleen dienden om te meten hoe goed het ging. Het systeem hield de drone minutenlang hoverend en volgde pilootopdrachten, met de meeste hellingsfouten binnen enkele graden en rotatiefouten binnen beperkte marges—voldoende voor stabiele vlucht.

Inzicht in de aangeleerde visuele vaardigheid

De onderzoekers onderzochten wat deze visie‑enkel‑regeling het beste laat werken. Ze vergeleken verschillende netwerkontwerpen, voegden extra inputs toe of haalden ze weg zoals motortoerentallen of gyro‑signalen, en varieerden hoeveel van het gezichtsveld van de camera werd gebruikt. Netwerken met geheugen—die visuele informatie over tijd kunnen integreren—bleken cruciaal om snelle rotaties nauwkeurig te volgen, terwijl geheugenloze versies daar moeite mee hadden. Een breed gezichtsveld, dat op de randen verafgelegen horizonachtige aanwijzingen blootlegt, gaf de laagste ruwe fouten in vertrouwde scènes. Verrassend genoeg dwong het netwerk, wanneer het alleen naar het centrale deel van het beeld mocht kijken waar zulke statische aanwijzingen ontbreken, meer te vertrouwen op bewegingspatronen in plaats van op scene‑uiterlijk. Hoewel dit de absolute nauwkeurigheid verminderde, verbeterde het hoe soepel het systeem zich aanpaste bij verplaatsing naar zeer verschillende omgevingen, wat suggereert dat er een intern zintuig voor beweging werd aangeleerd.

Op weg naar kleine, op visie‑gerichte vliegende robots

Al met al laat dit werk zien dat een drone zichzelf rechtop en bestuurbaar kan houden met alleen wat het ziet, zonder inertiële sensor in de lus. Door een eventcamera te koppelen aan een compact neuraal netwerk bereikt het systeem de snelheid en reactievermogen die nodig zijn voor real‑time regeling, terwijl hardwaregewicht en complexiteit worden verminderd. Voor de algemene lezer is de kernboodschap dat toekomstige zwermen van kleine, insectachtige vliegende robots mogelijk kunnen balanceren en navigeren met één slimme ‘oog’, net zoals insecten dat doen, en daarmee de deur openen naar lichtere, energiezuinigere machines die veilig verstopte en onvoorspelbare ruimtes kunnen verkennen.

Bronvermelding: Hagenaars, J.J., Stroobants, S., Bohté, S.M. et al. All eyes, no IMU: learning flight attitude from vision alone. npj Robot 4, 21 (2026). https://doi.org/10.1038/s44182-026-00081-4

Trefwoorden: visie-gebaseerde vluchtregeling, eventcamera-drone, bio-geïnspireerde robotica, neurale netwerken als besturders, insect-schaal UAV's