Clear Sky Science · nl

Machine learning-gefaciliteerde realtime akoestische verankering in tijdsvariërende meerlagige media richting MRI-geleid microbelmanipulatie

Gidsen van kleine medicijndragers met geluid en scans

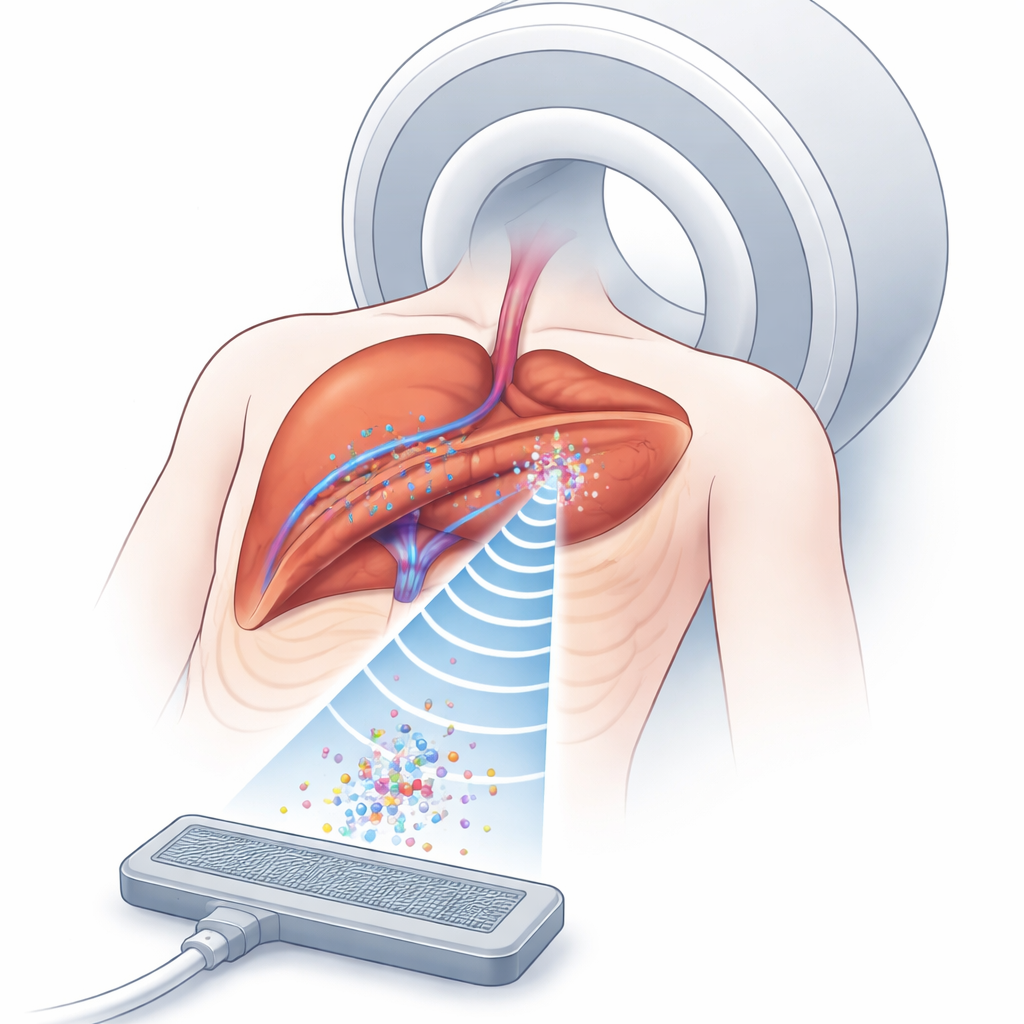

Moderne kankerbehandelingen vertrouwen steeds vaker op slimme medicijndragers die geneesmiddelen rechtstreeks naar tumoren kunnen brengen terwijl gezond weefsel wordt gespaard. Deze studie onderzoekt een futuristische manier om zulke dragers in het lichaam te sturen met behulp van ultrasone "vallen" die worden geleid door magnetische resonantiebeeldvorming (MRI). Door geluidsgolven, medische beeldvorming en machine learning te combineren, streven de onderzoekers ernaar microscopische belletjes met medicijnlading vlak bij bewegende tumoren te parkeren, zelfs terwijl het lichaam met elke ademhaling verschuift.

Waarom het vangen van microscopische belletjes belangrijk is

Microbelletjes die medicijnen vervoeren reizen door bloedvaten en kunnen hun lading vrijgeven wanneer ze worden geactiveerd met ultrasone golven. De uitdaging is om voldoende van deze belletjes lange genoeg op de juiste plek te houden, diep in het lichaam. Ultrasoon kan onzichtbare krachtputten creëren—akoestische vallen—die kleine deeltjes in vloeistof vasthouden zonder ze aan te raken. MRI kan ondertussen zowel het weefsel als het patroon van ultrasone effecten visualiseren, zelfs binnen organen. Het combineren van deze twee instrumenten biedt een manier om medicijndragers rond tumoren nauwkeuriger te concentreren dan alleen met geneesmiddelen mogelijk is. Maar in echte mensen buigen en vervormen weefsels van verschillende typen—vet, spier, organen en bewegende longen—geluidsgolven, waardoor het erg moeilijk wordt om een stabiele val precies op de tumorlocatie te vormen en te behouden.

Het probleem van een bewegend, gelaagd lichaam

In eenvoudige omgevingen zoals lucht of water weten ingenieurs al hoe ze gefaseerde arrays van ultrasoonzenders kunnen gebruiken om kleine objecten te duwen, trekken en draaien. In het lichaam echter moet geluid meerdere lagen met verschillende dichtheden en snelheden doorkruisen, en de grenzen daartussen veroorzaken breking en vervorming. Traditionele rekenmethoden kunnen dit in principe corrigeren door te berekenen hoe lang geluid erover doet om van elke zender naar het doelpunt te reizen. Maar zulke benaderingen verdelen het lichaam in miljoenen kleine blokjes en simuleren golfvoortplanting door elk blok—een extreem tijdrovend proces dat alleen werkt als de weefsels vrijwel volledig stil blijven. Alleen al ademhaling kan abdominale weefsels enkele millimeters verplaatsen, waardoor elke vooraf berekende oplossing snel veroudert.

Een model leren geluidspaden te voorspellen

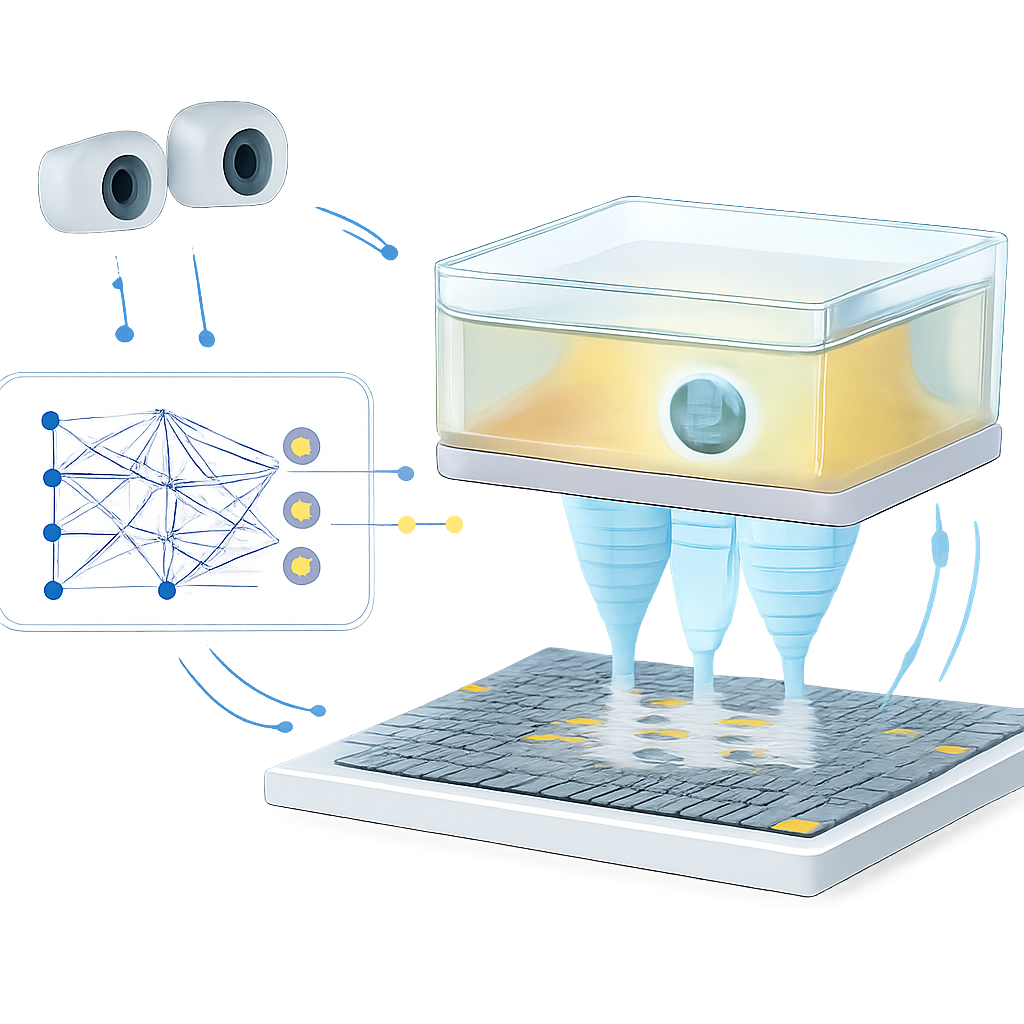

De auteurs tackelen deze bottleneck met een leergebaseerd model dat fungeert als een snelle omweg: in plaats van elke keer geluidsgolven te simuleren, trainen ze een neuraal netwerk om te voorspellen hoe lang elke ultrasone puls nodig heeft om een doelpunt te bereiken. Ze bouwen eerst een gedetailleerde virtuele omgeving met een gasgevulde kamer gescheiden van lucht door een dunne plastic film, waarmee ze nabootsen hoe geluid door verschillende weefsellagen gaat. Met een op fysica gebaseerde simulator genereren ze een trainingsset van geluidstijdverlopen tussen veel doelpunten en een 14-by-14 ultrasoonarray. Ze laten de kamer ook in twee richtingen verschuiven om beweging na te bootsen, en beschrijven de positie door drie visuele markers te volgen, vergelijkbaar met hoe in de toekomst MRI-zichtbare markers de ademhaling van een patiënt zouden volgen. Het getrainde netwerk leert de gewenste valpositie plus de kamerlokatie direct om te zetten in het vereiste timingpatroon voor alle 196 zenders, en bereikt microseconde-nauwkeurigheid in slechts ongeveer 26 milliseconden.

De lus sluiten met visie en snelle updates

Snelheid alleen is niet voldoende; de val moet zich ook aanpassen wanneer de omgeving onverwacht verandert. Om dit aan te tonen bouwen het team een gesloten regelsysteem. Stereocamera’s volgen een klein polystyreenbolletje dat door de akoestische val in de bewegende kamer in de lucht wordt gehouden. Wanneer het bolletje voorbij een ingestelde drempel van zijn doel afwijkt, past het systeem de doelpositie aan, voert de bijgewerkte coördinaten en kamerpose in het leermodel in en ververst snel het fasepatroon dat de array aanstuurt. In experimenten kan het systeem het fasepatroon tot 15 keer per seconde bijwerken en stuurt het bolletje langs H-, K- en U-vormige trajecten met ongeveer 1 millimeter gemiddelde fout—vergelijkbaar met de positioneernauwkeurigheid van sommige klinische gefocusseerde ultrasoonsystemen. Hetzelfde terugkoppelprincipe verkort ook de tijd die het bolletje van zijn bedoelde plek afblijft wanneer de kamer beweegt, wat aantoont dat de regelslus kan compenseren voor beweging en niet-gemodelleerde effecten van de plastic film en ondersteuningsstructuur.

Wat dit betekent voor toekomstige behandelingen

Voor een niet-specialist komt de kernboodschap neer op dat de onderzoekers een soort op afstand bestuurbare, contactloze “tractorstraal” hebben gebouwd die op een dag beladen belletjes bij een tumor zou kunnen parkeren en daar zou kunnen houden, zelfs terwijl de patiënt ademt. Hun machine learning-model vervangt zware simulaties door een snelle voorspeller, terwijl camera’s (en uiteindelijk MRI-markers) het systeem vertellen hoe het lichaam beweegt zodat de val dynamisch kan worden bijgestemd. Al gebruikt het huidige werk lucht, gassen en plastic in plaats van echte weefsels, en wordt een plastic bolletje geleekt in plaats van echte microbellen, het demonstreert realtime controle in een bewegend, gelaagd medium. Met krachtigere hardware, hogere ultrasone frequenties en MRI-gebaseerde bewegingsregistratie zou deze aanpak kunnen uitgroeien tot een klinisch instrument voor MRI-geleide, robotondersteunde ultrasone therapieën die geneesmiddelen dieper in het lichaam nauwkeuriger en veiliger afleveren.

Bronvermelding: Wu, M., Li, X. & Tang, T. Machine learning-facilitated real-time acoustic trapping in time-varying multi-medium environments toward magnetic resonance imaging-guided microbubble manipulation. Commun Eng 5, 52 (2026). https://doi.org/10.1038/s44172-026-00600-z

Trefwoorden: akoestische verankering, MRI-geleide therapie, microbel-geneesmiddelafgifte, machine learning in echografie, niet-invasieve robotmanipulatie