Clear Sky Science · nl

Wanneer grote taalmodellen betrouwbaar zijn bij het beoordelen van empathische communicatie

Waarom machine-empathie voor jou van belang is

Steeds vaker wenden mensen zich tot chatbots en digitale assistenten wanneer ze gestrest, eenzaam of voor lastige beslissingen staan. Deze systemen kunnen zorgzaam en begripvol klinken — maar kunnen ze ook beoordelen of een bericht echt ondersteunend en vriendelijk is? Dit artikel onderzoekt wanneer grote taalmodellen (LLM’s), de technologie achter veel chatbots, betrouwbaar kunnen inschatten hoe empathisch een geschreven reactie aanvoelt, en wat dat betekent voor alledaagse tools zoals welzijnsapps, virtuele therapeuten en klantenservicebots.

Onderzoek naar ondersteunende gesprekken

De onderzoekers analyseerden 200 echte tekstgebaseerde gesprekken waarin de ene persoon een persoonlijk probleem beschreef — zoals werkstress, familieconflicten, geldzorgen of problemen met geestelijke gezondheid — en een ander persoon probeerde ondersteunend te reageren. Deze gesprekken kwamen uit vier bestaande datasets, elk gekoppeld aan een andere set vragen om empathie te beoordelen. Sommige richtten zich op of de respondent begrip toonde of emotionele troost bood; andere keken of men praktisch advies gaf, de spreker aanspoorde om meer te vertellen, of juist het gesprek op zichzelf concentreerde. Samen ontleden deze kaders “empathisch zijn” in 21 specifieke gedragingen die op schalen beoordeeld kunnen worden, vergelijkbaar met een klanttevredenheidsenquête.

Experts, menigten en machines

Om te bepalen hoe goed LLM’s empathie kunnen beoordelen, vergeleek het team drie soorten beoordelaars: communicatiedeskundigen, online crowdworkers en moderne taalmodellen. Drie ervaren onderzoekers op het gebied van empathische communicatie beoordeelden onafhankelijk elk gesprek op alle 21 gedragingen. Crowdworkers — alledaagse internetgebruikers — hadden al beoordelingen voor dezelfde berichten geleverd via eerdere studies. Ten slotte werden drie vooraanstaande taalmodellen zorgvuldig geprompt met richtlijnen in gewone taal en voorbeeldbeoordelingen van de experts, en werd hen gevraagd elk gesprek op dezelfde schalen te scoren. Deze opzet stelde de auteurs in staat te meten hoe nauw elke groep overeenkwam, niet alleen met een "juiste" antwoord, maar ook met elkaar.

Hoe nauw komen ze overeen?

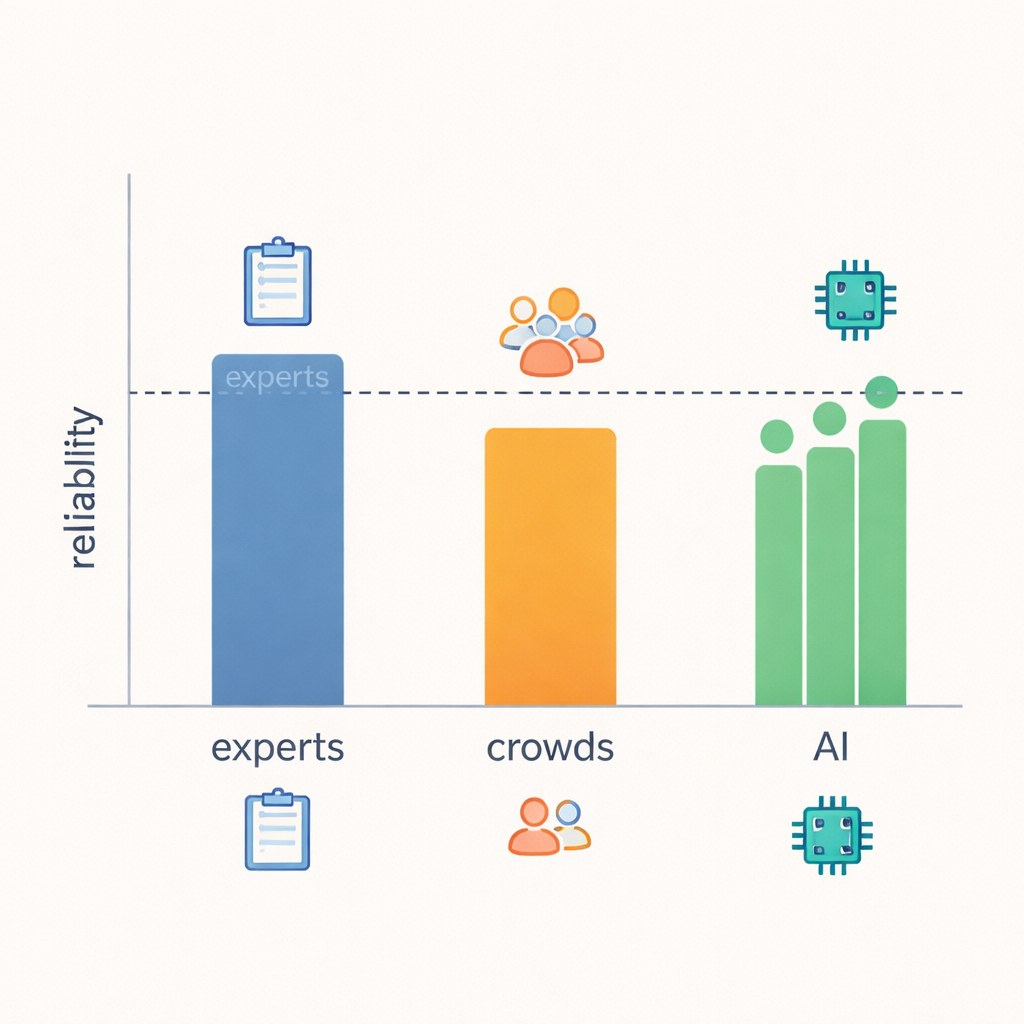

De kernbevinding is dat LLM’s verrassend dicht bij het betrouwbaarheidsniveau van experts kwamen. Toen de onderzoekers maten hoe vaak beoordelingen overeenkwamen en hoe groot de meningsverschillen waren, matchten de modellen in de meeste van de 21 gedragingen met of kwamen ze bijna overeen met de experts, en ze presteerden duidelijk beter dan de crowdworkers. Op gebieden met duidelijke, observeerbare signalen — zoals of een reactie praktisch advies gaf, vervolgvragen stelde, of de aandacht terug naar de spreker bracht — waren experts, LLM’s en zelfs de menigte vaker eens. Maar bij het beoordelen van vagere begrippen, zoals of een reactie echt "begrip toonde" of wat de intenties van de respondent waren, waren zelfs experts vaker oneens, en daalde ook de betrouwbaarheid van LLM’s. Dit suggereert dat sommige aspecten van empathie simpelweg moeilijker vast te stellen zijn uit alleen tekst, ongeacht wie de beoordeling uitvoert.

Waarom eenvoudige scores misleidend kunnen zijn

Veel AI-studies melden succes met behulp van bekende classificatiescores — waarbij elke expertbeoordeling onbetwist als waarheid wordt behandeld en wordt gemeten hoe vaak een model hiermee overeenkomt. De auteurs tonen aan dat deze aanpak een vertekend beeld kan geven bij subtiele menselijke oordelen. Bijvoorbeeld: een systeem kan goed scoren door meestal te raden wat de meerderheidsbeoordeling is op een onevenwichtige schaal, zelfs als het moeite heeft met zeldzamere maar belangrijke gevallen. Evenzo kan een methode die meestal "bijna goed" scoort — net één punt ernaast — slecht lijken op een strikte matchmetric, hoewel het zich vrijwel als een menselijke expert gedraagt. Door te focussen op interbeoordelaarsbetrouwbaarheid — hoe consistent verschillende beoordelaars hetzelfde inschatten — biedt de studie een eerlijker beeld van wat zowel mensen als machines betrouwbaar kunnen beoordelen.

Wat dit betekent voor alledaagse AI

Voor de leek is de conclusie zowel bemoedigend als waarschuwend. Goed geconfigureerde LLM’s kunnen nu helpen controleren of geschreven reacties — van menselijke hulpverleners of andere bots — voldoen aan deskundige normen voor empathische communicatie, en ze doen dat vaak consistenter dan ongetrainde menselijke beoordelaars. Dat kan het gemakkelijker maken om chatbots te monitoren en verbeteren die worden gebruikt in de gezondheidszorg, het onderwijs en de klantenservice. Tegelijk waarschuwt de studie dat niet alle "empathietests" gelijk zijn: vage of overlappende vragen leiden tot wankele menselijke overeenstemming en daarmee tot wankele machinebeoordelingen. Voordat we AI vertrouwen om iets delicaats als emotionele ondersteuning te beoordelen, moeten we eerst zeker weten dat experts het eens kunnen worden over hoe "goed" eruitziet — en dat als maatstaf gebruiken om te bepalen waar machines veilig kunnen ondersteunen en waar menselijke beoordeling essentieel blijft.

Bronvermelding: Kumar, A., Poungpeth, N., Yang, D. et al. When large language models are reliable for judging empathic communication. Nat Mach Intell 8, 173–185 (2026). https://doi.org/10.1038/s42256-025-01169-6

Trefwoorden: empathische communicatie, grote taalmodellen, AI-metgezellen, ondersteuning voor geestelijke gezondheid, mens–AI-interactie