Clear Sky Science · nl

Simulatiegebaseerde inferentie voor precisieneutrinofysica via neurale Monte Carlo-afstemming

Het fijn afstellen van de ogen van neutrino-telescopen

Toekomstige neutrino-experimenten willen grote vragen over het universum beantwoorden, zoals hoe de lichte neutrino’s qua massa geordend zijn en hoe sterren exploderen. Om dat te bereiken moeten hun reusachtige detectoren energie meten met buitengewone precisie—veel beter dan wat eenvoudige handboekenformules aankunnen. Dit artikel laat zien hoe moderne machine-learninginstrumenten kunnen helpen bij het afstemmen en valideren van de complexe simulaties die koppelen wat er in een detector gebeurt aan de lichtflitsen die we daadwerkelijk registreren.

Waarom het begrijpen van de detectorrespons zo moeilijk is

In experimenten zoals het Jiangmen Underground Neutrino Observatory (JUNO) in China wisselen neutrino’s interacties uit in een enorme tank met vloeistof die licht produceert wanneer deeltjes erdoorheen gaan. Dat licht wordt door duizenden fotomultiplicatoren opgevangen als kleine elektrische pulsen, geteld als “foto-elektronen”. De uitdaging is die tellingen terug te vertalen naar de oorspronkelijke deeltjesenergie. In werkelijkheid is deze relatie geen nette rechte lijn: ze hangt af van de geometrie van de detector, het gedrag van de vloeistof en verschillende onderling verweven fysische effecten. Traditionele benaderingen vertrouwden op handmatig afstemmen van simulatieparameters totdat de gesimuleerde spectra globaal leken op de kalibratiegegevens—een methode die onhandelbaar wordt voor moderne, zeer precieze experimenten.

Neurale netwerken leren de simulator te emuleren

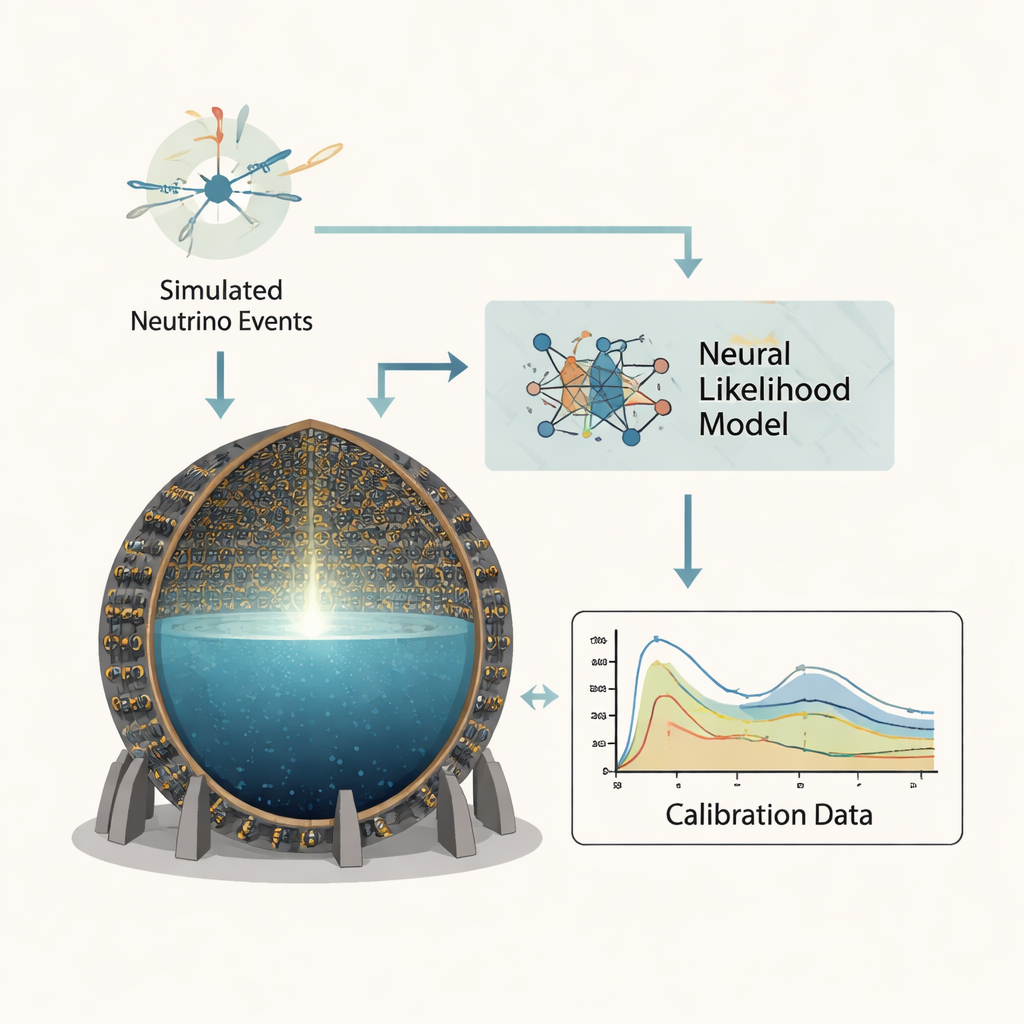

De auteurs hanteren een strategie die bekend staat als simulatiegebaseerde inferentie, waarbij ze in plaats van te proberen een exacte wiskundige formule voor de detectorrespons op te schrijven, de simulaties en neurale netwerken het zware werk laten doen. Ze richten zich op drie sleutelparameters die bepalen hoe JUNO echte energie omzet in gedetecteerd licht: een coëfficiënt die beschrijft hoe de lichtproductie bij hoge ionisatiedichtheid wordt “gedempt” (quenching), een algemene lichtopbrengst die de gemiddelde helderheid instelt, en een factor die de hoeveelheid Cherenkov-licht regelt. Met JUNO’s officiële Monte Carlo-software genereren ze ongeveer een miljard gesimuleerde kalibratiegebeurtenissen van vijf radioactieve bronnen die in het midden van de detector zijn geplaatst, waarbij elk evenement wordt samengevat door één getal: de totale verzamelde lichtopbrengst. Dit vormt het trainingsveld voor neurale netwerken die leren hoe waarschijnlijk elk gegeven lichtsignaal is voor elke keuze van de drie parameters.

Twee complementaire machine-learninglenzen

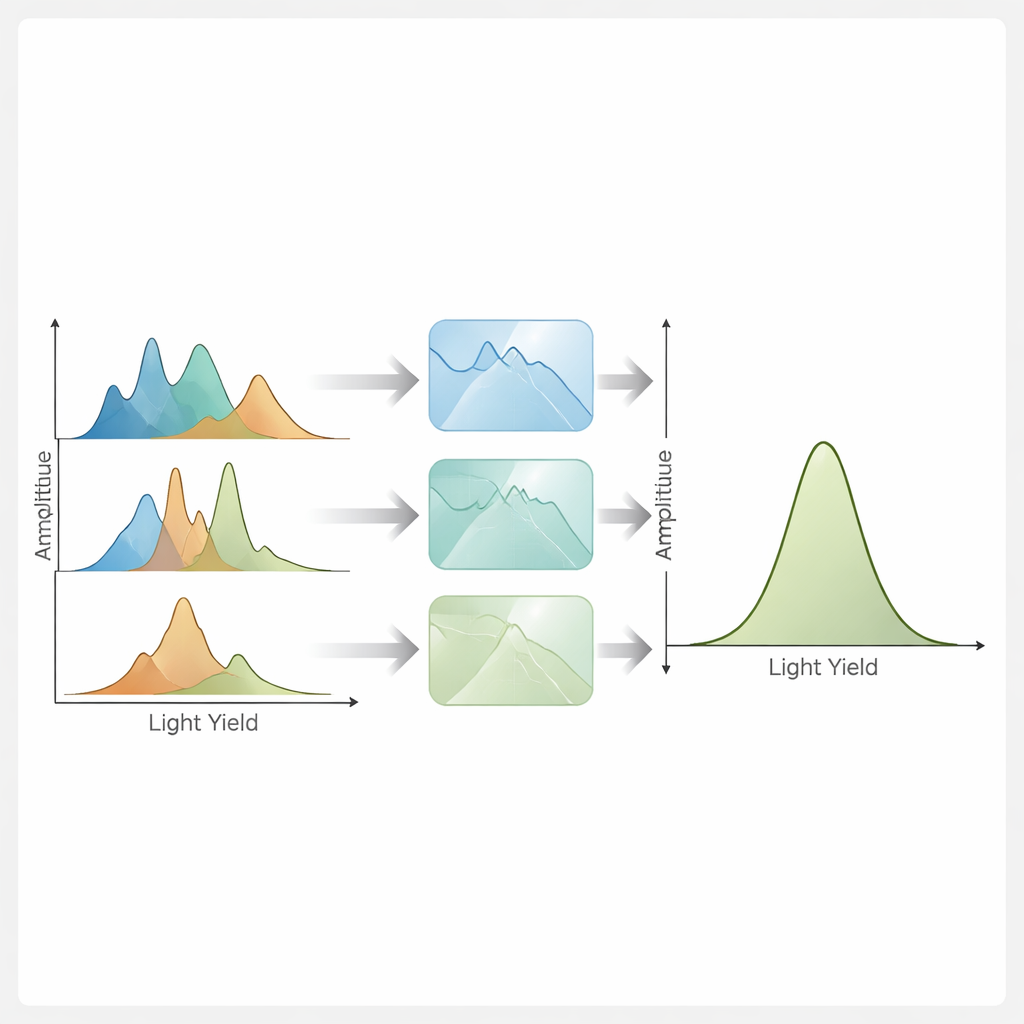

Het team ontwikkelt twee complementaire neurale “likelihood-estimators” die de kans benaderen om een bepaald lichtsignaal te observeren voor specifieke detectorinstellingen. De eerste, een Transformer Encoder Density Estimator genoemd, gebruikt een transformer-architectuur—dezelfde modelfamilie achter veel taaltools—om rechtstreeks een fijn gebinnende histogram van het lichtspectrum te voorspellen voor elke combinatie van parameters en bron. Dit ondersteunt natuurlijke traditionele gebinde statistische analyses. De tweede, een Normalizing Flows Density Estimator genoemd, gebruikt een keten van inverteerbare transformaties om de ingewikkelde, meerpiekige spectra naar een eenvoudige klokvormige verdeling te transformeren. Omdat deze transformaties wiskundig beheerst zijn, kan de methode de exacte kans voor elk ongebinnen evenement evalueren, waardoor analyses mogelijk zijn die de volledige informatie in de data benutten.

Controleren van nauwkeurigheid, precisie en robuustheid

Om te bewijzen dat deze neurale hulpmiddelen betrouwbaar zijn, onderwerpen de auteurs ze aan rigoureuze tests. Eerst controleren ze of de modellen de gesimuleerde spectra kunnen reproduceren voor duizenden combinaties van de drie parameters, met behulp van verschillende statistische afstanden die voorspelde en “ware” verdelingen vergelijken. Beide methoden volgen scherpe pieken en subtiele spectrale kenmerken buitengewoon goed, met afwijkingen op het niveau van enkele delen per duizend. Vervolgens pluggen ze de geleerde likelihoods in gevestigde statistische motoren—Bayesiaanse nested sampling, Markov chain Monte Carlo en klassieke minimalisatie—om de oorspronkelijke simulatieparameters uit nagebootste datasets terug te vinden. Over een breed bereik van parameterwaarden en eventstatistieken zijn de teruggevonden parameters niet vertekend en komen de opgegeven onzekerheden overeen met de werkelijke spreiding van de resultaten. Onzekerheden krimpen met meer data precies zoals verwacht uit eenvoudige telstatistiek, en de methoden vangen sterke correlaties tussen de parameters betrouwbaar op.

Van maanden rekentijd naar seconden

Een opvallend resultaat is de versnellingswinst in rekentijd. Het draaien van volledige detectorsimulaties met genoeg gebeurtenissen om elk parameterpunt te karakteriseren kan op een conventionele processor vele uren per instelling kosten. Zodra ze echter getraind zijn, kan het transformer-model een voorspeld spectrum genereren in enkele milliseconden, en kan het normalizing-flow-model kansen evalueren voor tienduizenden gebeurtenissen in ruim minder dan een tiende van een seconde. Hierdoor wordt het realistisch om grote parameterruimten te doorzoeken en systematische onzekerheden te kwantificeren die anders prohibitief duur zouden zijn, wat de deur opent naar meer gedetailleerde en betrouwbare detectorcalibraties.

Wat dit betekent voor toekomstige neutrino-experimenten

Voor niet-specialisten is de kernboodschap dat dit werk ingewikkelde, trage detectorsimulaties verandert in snelle, nauwkeurige surrogaten zonder fysische betekenis op te offeren. De drie afgestemde parameters komen nog steeds rechtstreeks overeen met reële eigenschappen van de detector en de vloeistof, zodat de resultaten interpreteerbaar blijven voor fysici. De studie toont aan dat beide neurale benaderingen deze parameters met uiterst kleine bias kunnen bepalen en met fouten die voornamelijk worden begrensd door de hoeveelheid beschikbare data. Nu aanstaande experimenten zoals JUNO, DUNE en Hyper-Kamiokande naar subprocentprecisie in neutrinometingen streven, zullen methoden als deze essentieel zijn om te verzekeren dat wat we over het universum afleiden niet wordt beperkt door hoe goed we onze detectoren begrijpen.

Bronvermelding: Gavrikov, A., Serafini, A., Dolzhikov, D. et al. Simulation-based inference for precision neutrino physics through neural Monte Carlo tuning. Commun Phys 9, 63 (2026). https://doi.org/10.1038/s42005-026-02499-6

Trefwoorden: neutrino-detectoren, machine learning, Monte Carlo-afstemming, normalizing flows, simulatiegebaseerde inferentie