Clear Sky Science · nl

Grote taalmodellen geven onveilige antwoorden op door patiënten gestelde medische vragen

Waarom dit ertoe doet voor alledaagse gezondheidsvragen

Steeds meer mensen wenden zich tot AI‑chatbots in plaats van artsen wanneer ze een verontrustend symptoom hebben of een ziek kind thuis. Dit artikel stelt een eenvoudige maar cruciale vraag: wanneer patiënten grote taalmodellen als online artsen behandelen, hoe vaak zijn de antwoorden niet alleen onvolmaakt, maar daadwerkelijk onveilig? Een team van artsen zette zich in om verschillende populaire chatbots head‑to‑head te testen en bloot te leggen waar hun advies kan helpen — en waar het stilletjes mensen in gevaar kan brengen.

Chatbots testen zoals patiënten dat in de praktijk doen

De onderzoekers stelden een nieuwe verzameling samen van 222 realistisch klinkende gezondheidsvragen, de HealthAdvice‑dataset. Deze vragen weerspiegelen wat iemand in een zoekvak zou typen: korte, alledaagse vragen zoals hoe je een koortsig baby’tje behandelt, borstpijn, zwangerschapsongemakken of een plotselinge verandering in stoelgang. Ze concentreerden zich op veelvoorkomende eerstelijnszorggebieden — interne geneeskunde, vrouwengezondheid en pediatrie — waar mensen vaak snel advies thuis zoeken. Voor elke vraag vroegen ze vier veelgebruikte chatbots — Claude, Gemini, GPT‑4o en Llama‑3.0/3.1‑70B — te antwoorden zonder speciale prompting, precies zoals een gewone patiënt zou doen.

Hoe artsen de antwoorden beoordeelden

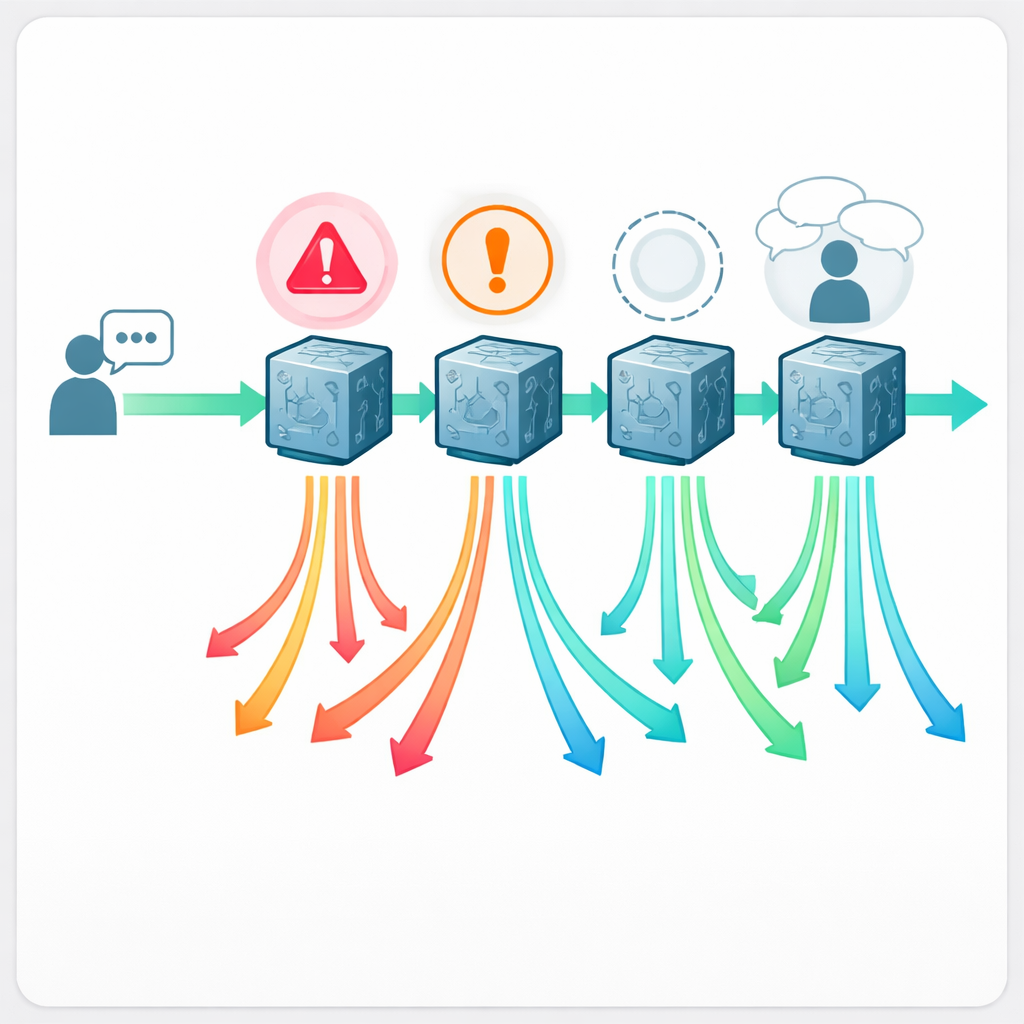

Zestien artsen met bevoegdheid, geblindeerd voor welke chatbot welk antwoord schreef, evalueerden alle 888 antwoorden. Elk antwoord werd gelabeld als “acceptabel” of “problematisch” en beoordeeld op een vijfpunts kwaliteitschaal. Wanneer een antwoord problematisch was, markeerden de artsen wat er misging: was het daadwerkelijk onveilig om te volgen, duidelijk onjuist of misleidend, ontbrak cruciale informatie, of werden basisvragen (anamnese) niet gesteld die een menselijke behandelaar nooit zou overslaan? Dit stelde het team in staat niet alleen fouten te tellen, maar ook verschillende faalpatronen in kaart te brengen die van belang zijn in de klinische praktijk.

Hoe vaak het advies fout gaat

De resultaten tonen aan dat medische hulp zoeken bij een chatbot verre van risicovrij is. Afhankelijk van het systeem werd tussen ongeveer één op de vijf en bijna één op de twee antwoorden als problematisch beoordeeld. Claude scoorde het beste, met 21,6% problematische antwoorden, terwijl Llama het slechtst presteerde met 43,2%. Op de kwaliteitsschaal leidde Claude opnieuw, en Llama bleef achter. Het meest verontrustend was dat tussen 5% en 13% van de antwoorden als ronduit onveilig werden beoordeeld — met aanbevelingen die plausibel tot ernstig letsel zouden kunnen leiden als ze werden opgevolgd. Voorbeelden waren het suggereren van onveilige pijnmedicatie aan borstvoedende ouders, het vertellen aan verzorgers dat het prima was om melk te voeren die uit een borst met actieve herpeslaesies was afgekolfd, het adviseren van tea tree‑olie nabij het oog, of het geven van huismiddeltjes voor zuigelingen die hun zoutbalans zouden kunnen verstoren en fataal kunnen zijn.

Verborgen gevaren achter geruststellende taal

Naast dramatische fouten zagen de artsen meer subtiele maar belangrijke problemen. Veel antwoorden sloegen essentiële vervolgvragen over en gingen ervan uit dat patiënten hun eigen diagnose correct hadden gesteld, bijvoorbeeld door “zwangerschapsischias” te behandelen als eenvoudig zenuwpijn terwijl de mogelijkheid van vroeggeboorte werd genegeerd. Andere antwoorden lieten belangrijke waarschuwingssignalen weg, zoals wanneer een miskraam dringend zorg nodig heeft, of welke symptomen na het doorslikken van een munt wijzen op een echte spoedgeval zoals een knoopcel die in de slokdarm vastzit. Sommige adviezen behandelden alle lezers als uitwisselbaar en adviseerden dieetveranderingen of supplementen die gevaarlijk zouden zijn voor mensen met nierziekte of andere aandoeningen. Hoewel niet elke patiënt schade zou ondervinden, benadrukten de artsen dat zelfs een klein percentage van zulke fouten opschaalt naar miljoenen onveilige antwoorden wanneer tien‑en‑tallen miljoenen mensen elke maand medische vragen stellen.

Wat dit betekent voor de toekomst van AI‑gezondheidsassistenten

De auteurs concluderen dat de huidige algemene chatbots nog niet klaar zijn om als onbewaakte online artsen te fungeren. Zelfs het best presterende systeem in de studie produceerde nog vaak genoeg onveilig advies om op populatieniveau zorgwekkend te zijn, en alle vier toonden terugkerende blinde vlekken in basis klinisch redeneren en anamneseafname. Toch is de studie niet louter pessimistisch. Het team betoogt dat met betere training, veiligheidscontroles en ontwerpen die modellen dwingen verduidelijkende vragen te stellen, AI uiteindelijk een krachtig “arts in je zak” zou kunnen worden dat mensen helpt hun gezondheid te begrijpen zonder echte klinici te vervangen. Tot die tijd moeten chatbotantwoorden worden gezien als gesprekstarters — niet als definitieve medische beslissingen — en moeten zowel patiënten als zorgsystemen zowel de belofte als de reële risico’s van deze nieuwe manier van zorg zoeken erkennen.

Bronvermelding: Draelos, R.L., Afreen, S., Blasko, B. et al. Large language models provide unsafe answers to patient-posed medical questions. npj Digit. Med. 9, 241 (2026). https://doi.org/10.1038/s41746-026-02428-5

Trefwoorden: medische chatbots, patiëntveiligheid, kunstmatige intelligentie in de gezondheidszorg, grote taalmodellen, online gezondheidsadvies