Clear Sky Science · nl

Onafhankelijke en samenwerkende prestaties van grote taalmodellen en zorgprofessionals bij diagnose en triage

Waarom dit ertoe doet voor uw volgende doktersbezoek

Wanneer u uw klachten in een online chatbot typt of een AI‑app vraagt wat er mis zou kunnen zijn, gebruikt u hetzelfde soort technologie dat artsen tegenwoordig in ziekenhuizen testen: grote taalmodellen, of LLM’s. Deze studie stelt een eenvoudige maar cruciale vraag: hoe goed kunnen deze hulpmiddelen daadwerkelijk ziekten diagnosticeren en beoordelen hoe urgent een geval is, vergeleken met echte zorgprofessionals — en wat gebeurt er wanneer beide samenwerken?

Hoe de onderzoekers het geheel bekeken

De auteurs testten niet één enkele chatbot in één kliniek. In plaats daarvan combineerden ze bewijs uit 50 afzonderlijke studies die tussen 2020 en 2025 wereldwijd werden uitgevoerd. Deze studies besloegen vele specialismen, van oogziekten en hersenscans tot spoedeisende hulp. In elk geval kregen artsen en één of meer LLM’s dezelfde beschrijvingen van echte of zorgvuldig ontworpen patiëntcases. De LLM’s moesten mogelijke diagnoses suggereren of bepalen hoe snel een patiënt zorg nodig had, terwijl de artsen hetzelfde deden. In sommige onderzoeken kregen artsen ook de AI‑suggesties te zien om te beoordelen of dat hun prestaties verbeterde.

Hoe goed zijn AI‑systemen op zichzelf?

Over alle studies heen konden de AI‑hulpmiddelen vaak de juiste diagnose ergens op hun lijst plaatsen, maar wanneer ze gedwongen werden één antwoord te kiezen, bleven ze meestal achter op artsen. Als alleen de eerste gok telde, waren LLM’s gemiddeld ongeveer 11% minder nauwkeurig dan zorgprofessionals. Naarmate de lijst met toegestane gissingen langer werd, werd die kloof kleiner en verdween uiteindelijk — zodra er tot tien mogelijke diagnoses werden toegestaan, waren de AI‑systemen even waarschijnlijk als artsen om de juiste diagnose op te nemen. Voor triagebeslissingen — het inschatten van urgentie en het benodigde zorgniveau — presteerden AI en mensen in het algemeen vergelijkbaar. De resultaten verschilden echter sterk tussen individuele modellen en testopzetten, wat erop wijst dat sommige hulpmiddelen veel betrouwbaarder zijn dan andere.

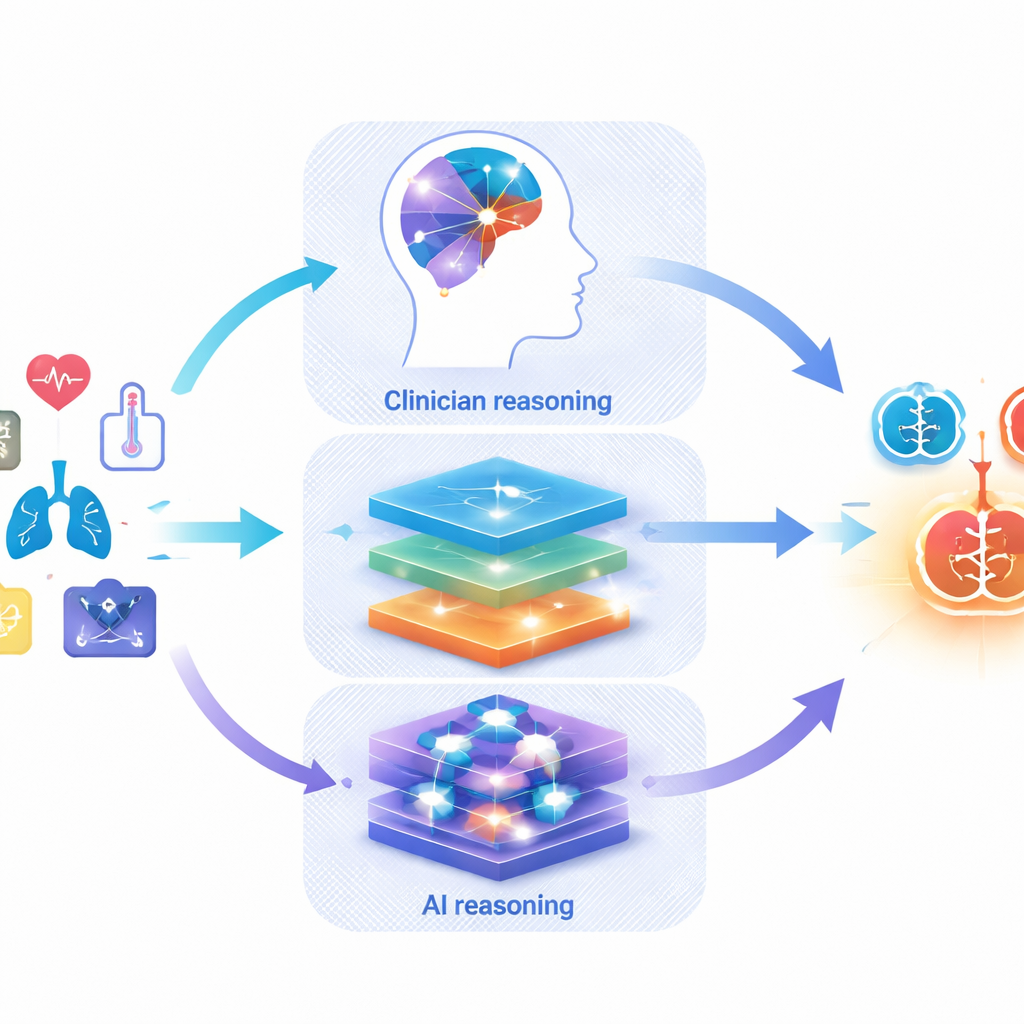

Wat gebeurt er als artsen AI als teamgenoot gebruiken?

Negentien studies bekeken directe samenwerking: artsen werkten eerst alleen en voerden de taak vervolgens opnieuw uit met hulp van een LLM. Het nieuws hier was bemoedigend. Met AI‑ondersteuning waren artsen in het algemeen nauwkeuriger, vooral wanneer ze meerdere mogelijke diagnoses mochten opgeven. Bijvoorbeeld: met hulp van een LLM verbeterde hun nauwkeurigheid voor korte kandidatenlijsten met ongeveer 10–40%, afhankelijk van het aantal overwogen opties. Dit suggereert dat AI bijzonder nuttig is als een brainstormpartner die het aantal mogelijkheden vergroot en clinici aanspoort minder voor de hand liggende aandoeningen te overwegen, terwijl de menselijke expert de uiteindelijke beslissing neemt.

Waarom de resultaten van vandaag beter kunnen lijken dan in de praktijk

Hoewel de cijfers veelbelovend klinken, waarschuwen de auteurs dat de meeste bestaande onderzoeken verre van perfect zijn. Velen vertrouwden op keurig gepresenteerde, tekstboekachtige casussamenvattingen of zeldzame onderwijsgevallen, niet op de rommelige, onvolledige verhalen waarmee patiënten zich in echte klinieken melden. Slechts een klein aantal studies gebruikte realtime patiënten. Details over hoe cases werden geselecteerd, hoe de AI‑hulpmiddelen waren geconfigureerd en hoe antwoorden werden beoordeeld, ontbraken vaak. Visuele informatie zoals scans of huidfoto’s werd minder vaak gebruikt, en wanneer alleen afbeeldingen werden getest, presteerden ervaren clinici duidelijk beter dan de AI. De onderzoekers benadrukken ook dat beginnende clinici en experts anders op AI‑advies kunnen reageren, en dat kwesties zoals gegevensprivacy, verborgen vooringenomenheid en oververtrouwen in machineadviezen grotendeels ongetest blijven in de dagelijkse praktijk.

Wat dit betekent voor patiënten en de toekomst van zorg

Alles bij elkaar suggereert de studie dat huidige chatbots en LLM’s nog niet klaar zijn om uw arts te vervangen, maar dat ze mogelijk binnenkort waardevolle assistenten worden. Verstandig gebruikt kunnen ze helpen bredere lijsten met mogelijke diagnoses te genereren en nauwkeuriger besluitvorming ondersteunen, vooral wanneer artsen aan het roer blijven en AI als tweede opinie behandelen in plaats van als definitief oordeel. Voordat deze hulpmiddelen in routinematige zorg worden geïntegreerd, pleiten de auteurs echter voor beter ontworpen, real‑world proeven, duidelijkere rapportagestandaarden en sterke waarborgen op het gebied van veiligheid, eerlijkheid en privacy. Voor patiënten betekent dit dat AI uiteindelijk uw zorgteam kan helpen breder te denken en sneller te handelen, maar dat elk betrouwbaar systeem even rigoureus getest moet worden als een nieuw geneesmiddel of medisch hulpmiddel.

Bronvermelding: Chen, M., Wu, Y., Ma, J. et al. Independent and collaborative performance of large language models and healthcare professionals in diagnosis and triage. npj Digit. Med. 9, 222 (2026). https://doi.org/10.1038/s41746-026-02409-8

Trefwoorden: AI medische diagnose, klinische triage, grote taalmodellen, arts-AI samenwerking, digitale gezondheid veiligheid