Clear Sky Science · nl

Groot-schalig zelfgestuurd video-foundationmodel voor intelligente chirurgie

Slimmere hulp in de operatiekamer

Moderne chirurgen vertrouwen steeds vaker op camera’s en computers om hun werk te begeleiden, maar de kunstmatige intelligentie van vandaag worstelt nog met een volledig begrip van wat er tijdens een operatie gebeurt. Dit artikel presenteert een nieuwe manier om AI te trainen op duizenden operatievideo’s zodat deze beter de stappen van een ingreep kan volgen, instrumenten en weefsels kan herkennen en kan beoordelen hoe veilig en vakkundig de operatie vordert. Op de lange termijn zou dit soort technologie chirurgen in realtime kunnen ondersteunen, de opleiding verbeteren en bijdragen aan veiligere chirurgie voor patiënten.

Waarom het moeilijk is machines chirurgie te leren

Computers leren begrijpen wat er bij chirurgie gebeurt is niet zo eenvoudig als ze een paar gelabelde afbeeldingen voeren. Elke ingreep omvat bewegende camera’s, wisselende gezichtspunten, rook, bloed en handen en instrumenten die elkaar voortdurend blokkeren. Daarbovenop bestaan er duizenden verschillende soorten operaties, waarvan veel zeldzaam zijn. Video-gegevens zorgvuldig frame voor frame labelen vereist schaars deskundig tijd en wordt snel te duur. Eerdere AI-systemen probeerden deze last te verlichten met trucs om van ongelabelde beelden te leren, maar die keken meestal naar stilstaande frames en voegden pas later een tijdsdimensie toe. Daardoor misten ze vaak het zich ontvouwende verhaal van een ingreep: wat eraan voorafging, wat nu gebeurt en wat waarschijnlijk daarna zal gebeuren.

Direct leren van chirurgische films

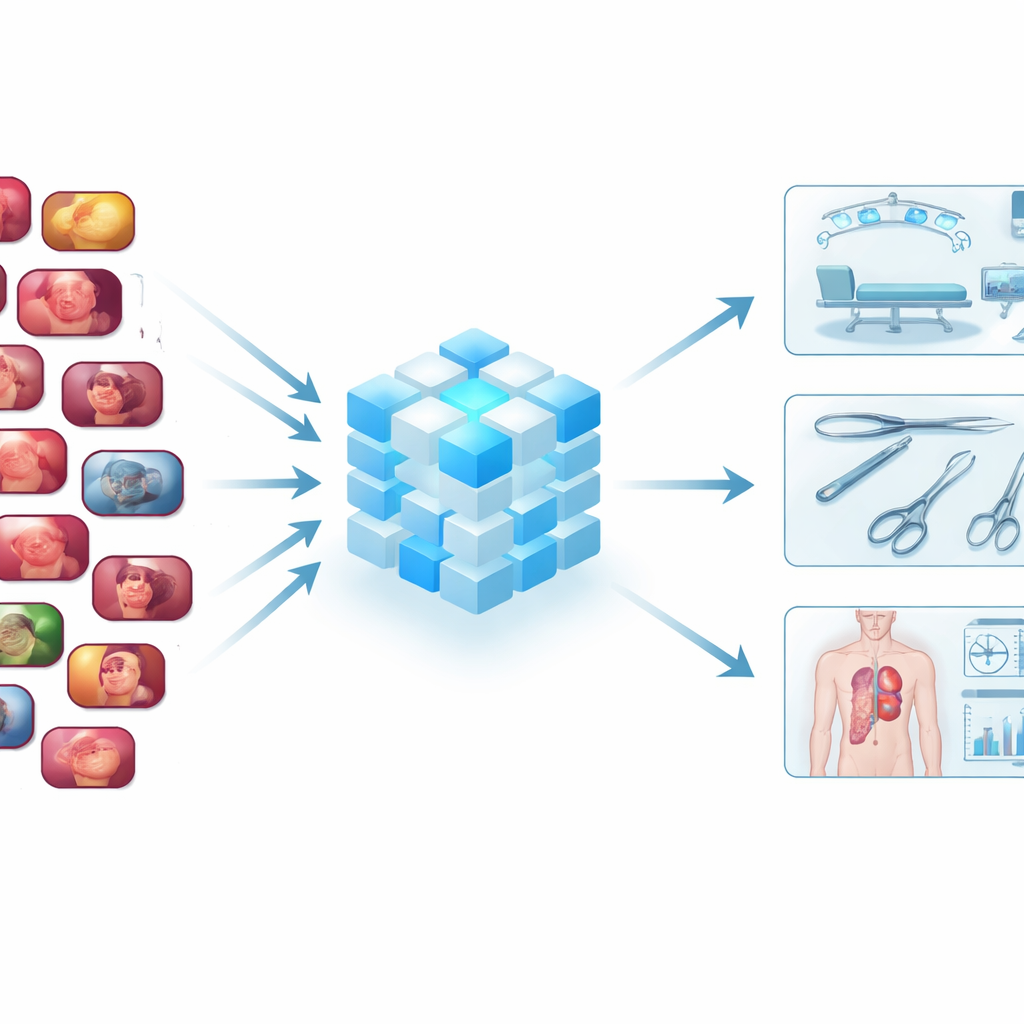

De auteurs beargumenteren dat een AI bedoeld om bij chirurgie te assisteren op video’s in plaats van op geïsoleerde beelden getraind moet worden. Om dit te bereiken stelden ze een van de grootste verzamelingen endoscopische chirurgie-video’s tot nu samen: 3.650 opnamen met 3,55 miljoen frames, afkomstig uit openbare onderzoeksdatasets en een brede selectie online chirurgische opnames. Deze video’s beslaan meer dan 20 soorten procedures en meer dan 10 anatomische regio’s, van galblaasverwijdering tot leveroperaties en gynaecologische ingrepen. Die diversiteit stelt de AI in staat veel manieren te zien waarop een procedure er in de praktijk uit kan zien, inclusief verschillende ziekenhuizen, instrumenten en camerastijlen.

Een nieuw leerplan gericht op video

Voortbouwend op deze data-schatz ontwierp het team SurgVISTA, een “foundation model” dat specifiek is afgestemd op chirurgie-video’s. In plaats van te proberen elk frame te labelen, leert SurgVISTA door te reconstrueren wat ontbreekt. Tijdens de training worden delen van elke videoclip verborgen en moet het model de ontbrekende regio’s reconstrueren. Dit dwingt het om te letten op hoe weefsels, instrumenten en bewegingen in de tijd veranderen. Tegelijkertijd wordt een tweede tak van het systeem getraind om de gedetailleerde visuele aanwijzingen van een krachtig op beelden gebaseerd expertmodel te matchen, dat al veel weet over chirurgische scènes. Deze combinatie helpt SurgVISTA zowel de fijne details binnen elk frame als de bredere flow van de hele ingreep te begrijpen, allemaal binnen één uniform netwerk.

Het model op de proef stellen

Om te onderzoeken of deze aanpak echt resultaat oplevert, testten de auteurs SurgVISTA op 13 verschillende datasets met zes typen chirurgie en vier praktische taken. Deze taken omvatten het herkennen in welke fase van een operatie men zich bevindt, het identificeren van specifieke chirurgische handelingen, het vastleggen van de driehoekrelatie tussen instrument, handeling en doelweefsel, en het beoordelen hoe veilig belangrijke stappen zijn uitgevoerd. Over de hele linie versloeg SurgVISTA toonaangevende modellen die op alledaagse video’s waren getraind, evenals de beste bestaande chirurgie-gerichte systemen die vooral op stilstaande beelden waren gebaseerd. Het presteerde sterk zelfs op procedures die het nooit tijdens de training had gezien, wat aantoont dat de patronen die het leerde niet gebonden waren aan één orgaan, instrumentenset of ziekenhuis.

Waarom meer en rijkere videodata ertoe doet

De studie onderzocht ook hoe de prestaties veranderden naarmate er meer trainingsdata werden toegevoegd. Naarmate de auteurs de omvang en variëteit van de videocollectie geleidelijk vergrootten, verbeterden de resultaten van SurgVISTA vrijwel overal, ook bij procedures die helemaal niet in de trainingsset voorkwamen. Interessant genoeg profiteerde het model niet alleen van meer voorbeelden van dezelfde ingreep, maar ook van verschillende soorten operaties: blootstelling aan gevarieerde chirurgische “verhalen” hielp het algemene visuele en bewegingspatronen te herkennen die over specialismen heen overdraagbaar zijn. Extra experimenten toonden aan dat de aanvullende begeleiding door het op beelden gebaseerde expertmodel de mogelijkheid van het model verder aanscherpte om fijne anatomische details te behouden, wat cruciaal is om bijvoorbeeld een vitaal structuur van omringend weefsel te onderscheiden.

Wat dit betekent voor toekomstige chirurgie

Kort gezegd laat dit werk zien dat een AI die op grote hoeveelheden echte chirurgie-video’s is getraind, met zowel ruimte als tijd in het vizier, een veel dieper begrip kan opbouwen van wat er in de operatiekamer gebeurt. SurgVISTA is nog geen instrument dat zelfstandig beslissingen neemt, maar het levert een krachtige ruggengraat waar andere toepassingen op kunnen aansluiten—of het nu gaat om het volgen van chirurgische voortgang, het signaleren van risicomomenten, ondersteuning van opleiding, of het vergelijken van technieken tussen ziekenhuizen. De auteurs wijzen erop dat bredere data en klinische testen nog nodig zijn, maar hun resultaten suggereren dat videobased foundationmodellen een belangrijke component kunnen worden in toekomstige intelligente chirurgiesystemen die gericht zijn op veiligere, consistenter en beter op de patiënt afgestemde ingrepen.

Bronvermelding: Yang, S., Zhou, F., Mayer, L. et al. Large-scale self-supervised video foundation model for intelligent surgery. npj Digit. Med. 9, 220 (2026). https://doi.org/10.1038/s41746-026-02403-0

Trefwoorden: chirurgische video-AI, zelfgestuurd leren, operatief werkproces, computerondersteunde chirurgie, spatiotemporaal modelleren