Clear Sky Science · nl

Mensen–grote taalmodel‑samenwerking in de klinische geneeskunde: een systematische review en meta‑analyse

Waarom dit ertoe doet in de dagelijkse gezondheidszorg

Artsen wenden zich steeds vaker tot krachtige AI‑chatbots, bekend als grote taalmodellen, om hen te helpen complexe gevallen te analyseren, aantekeningen te schrijven en medische tests te interpreteren. Deze studie stelt een eenvoudige maar cruciale vraag: hebben patiënten werkelijk baat wanneer artsen samenwerken met deze hulpmiddelen? Door de beste beschikbare proeven samen te brengen laten de auteurs zien dat het antwoord gecompliceerder is dan de hype doet vermoeden—soms helpt de samenwerking, soms doet het weinig en in een paar situaties kan het zelfs in de weg zitten.

Wat de onderzoekers hebben onderzocht

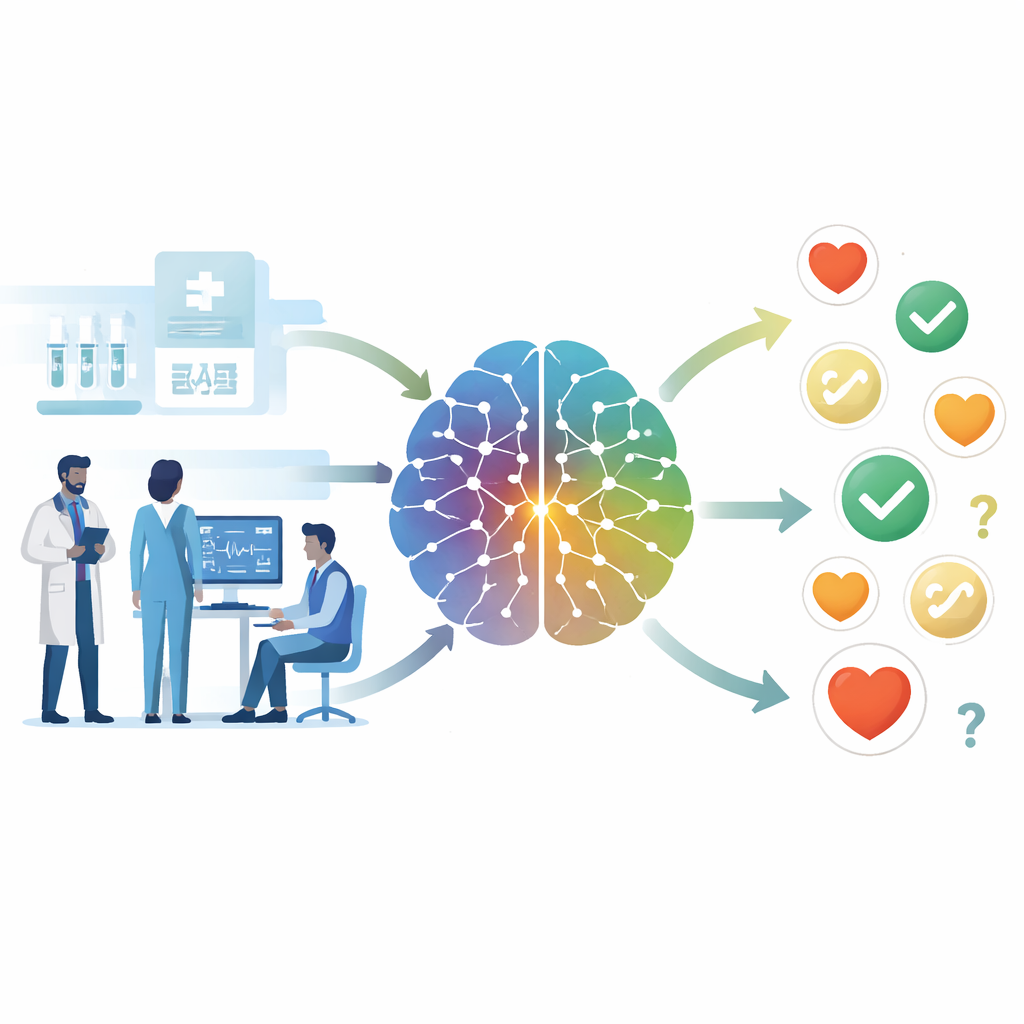

Het team doorzocht systematisch de belangrijkste medische databanken naar studies waarin clinici werkten met of zonder hulp van een AI‑systeem gebaseerd op grote taalmodellen zoals GPT‑4. Om te worden opgenomen moest een studie een “arts plus AI”‑workflow direct vergelijken met de gebruikelijke zorg door alleen artsen, en soms ook met de AI die zelfstandig opereerde. De klinische taken besloegen een reeks reële problemen: vaststellen wat er mis kan zijn bij een kritisch zieke patiënt, het interpreteren van hersenscans, het schrijven en lezen van poliklinische notities, en beslissen hoe borstpijn en andere veelvoorkomende klachten te behandelen. In totaal vormden 10 peer‑reviewed proeven de ruggengraat van de analyse, met een paar extra preprints die alleen werden gebruikt om na te gaan hoe robuust de conclusies waren.

Hoe goed de arts–AI‑teams presteerden

Over deze studies genomen lieten teams van artsen met AI kleine maar merkbare verbeteringen zien in sommige maten van diagnostische en managementkwaliteit. In twee gerandomiseerde proeven die gedetailleerde scoringssystemen voor casusbeslissingen gebruikten, scoorden de arts–AI‑teams ongeveer vijf procentpunt hoger dan artsen alleen. Simpel gezegd: als artsen alleen ongeveer 100 belangrijke beslissingen zouden nemen, zou toevoeging van AI er ruwweg vijf van die beslissingen van fout kunnen weerhouden. De auteurs benadrukken echter dat de onderliggende gegevens schaars zijn: slechts een paar proeven droegen bij aan deze schattingen, en het bereik van plausibele resultaten in de echte wereld is breed genoeg om geen voordeel—of zelfs schade—in andere contexten te omvatten.

Snelheid, documentatie en verborgen fouten

Velen hopen dat AI artsen tijd zal opleveren. Het bewijs hiervoor was teleurstellend. Toen de onderzoekers drie proeven combineerden die maten hoe lang taken duurden, vonden ze feitelijk geen algemene tijdwinst. In sommige gesimuleerde oefeningen waren artsen iets sneller met AI; in een echte poliklinische studie was het netto‑effect op de consultduur bijna nihil, hoewel sommige subgroepen bescheiden winst zagen. Documentatie liet een vergelijkbaar "gemengd" beeld zien. AI‑assistentie maakte notities vaak duidelijker en beter gestructureerd, en het hielp niet‑specialisten technische oogzorgrapporten beter te begrijpen. Toch vonden onderzoekers bij feitelijke controle dat ongeveer één op de drie AI‑ondersteunde notities nog steeds fouten bevatte. Deze kloof—mooier ogende dossiers die toch onjuist kunnen zijn—roept duidelijke veiligheidszorgen op.

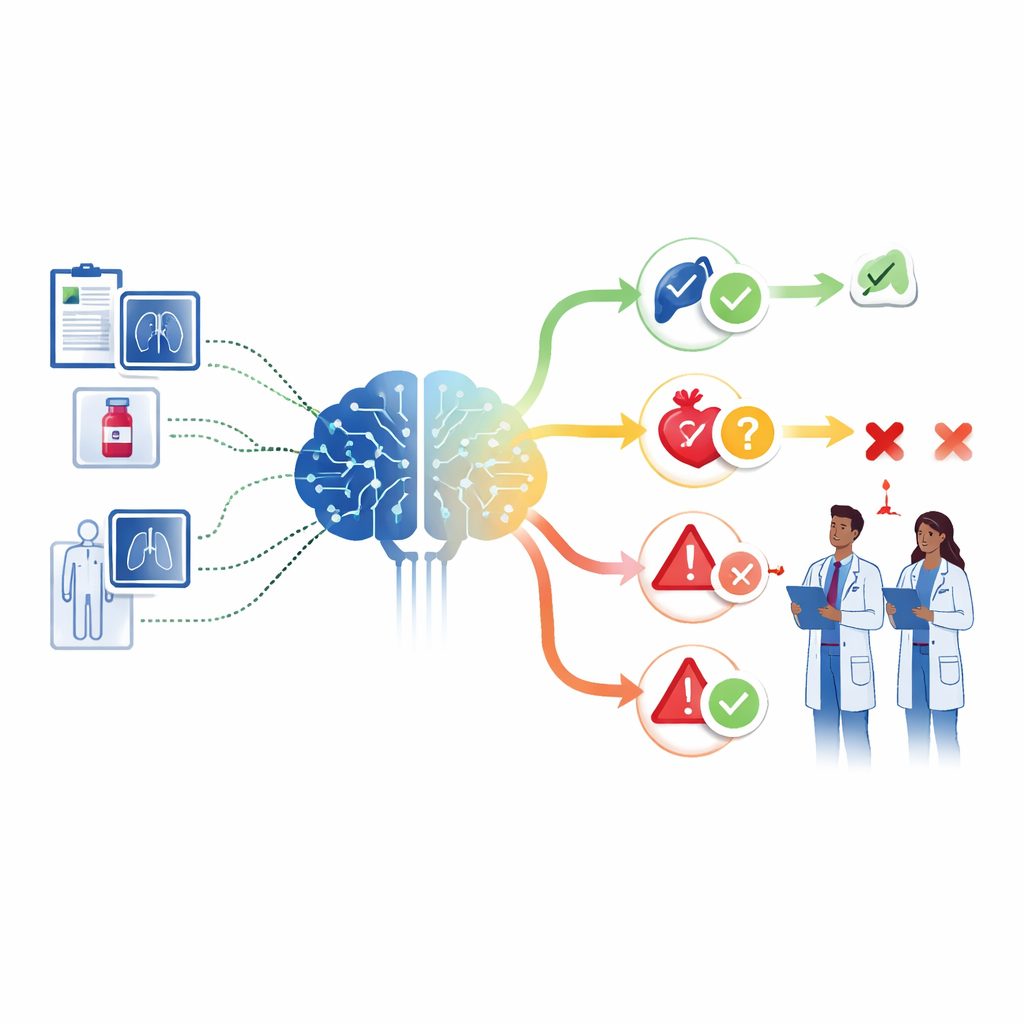

Wanneer samenwerken er niet in slaagt het systeem te overtreffen

Een opvallende bevinding kwam uit proeven die ook de AI zelfstandig testten. In één studie bij kritiek zieke patiënten deed de AI op zichzelf ongeveer even goed als het arts–AI‑team, en beter dan veel artsen die alleen werkten. In een andere studie waren door AI gegenereerde testrapporten duidelijk slechter dan die geproduceerd door menselijke experts, ongeacht of de AI als assistent werd ingezet. Samen onthullen deze resultaten wat de auteurs een "samenwerkingsparadox" noemen: het enkel toevoegen van een mens in de lus garandeert geen verbetering ten opzichte van een sterke AI, en in sommige situaties kan de samenwerking de sterke punten van beide verzwakken. Factoren zoals hoe advies wordt gepresenteerd, hoeveel vertrouwen artsen erin stellen of juist wantrouwen, en hoe het hulpmiddel in de dagelijkse workflow is ingebed bepalen allemaal of samenwerking helpt of juist hindert.

Wat dit betekent voor de toekomst van arts–AI‑teams

Al met al schetst de review een beeld van voorzichtige belofte in plaats van een reeds voltooide revolutie. Arts–AI‑teams kunnen bepaalde beslisscores bescheiden verbeteren en medische teksten leesbaarder maken, maar ze besparen niet betrouwbaar tijd en genereren nog steeds een zorgwekkend aantal feitelijke fouten. De auteurs pleiten ervoor dat zorgsystemen deze hulpmiddelen geleidelijk invoeren, met sterke waarborgen die zich richten op het opsporen van fouten in plaats van alleen op efficiëntieverbetering. Ze roepen ook op tot grotere, praktijkgerichte klinische proeven die AI‑assistentie testen in drukke ziekenhuizen en poliklinieken, niet alleen in gecontroleerde casussimulaties. Totdat zulk bewijs beschikbaar is, is het meest veilige pad om grote taalmodellen te behandelen als krachtige maar feilbare assistenten—en workflows te ontwerpen waarin clinici optreden als kritische beoordelaars en poortwachters, niet als passieve ontvangers van AI‑advies.

Bronvermelding: Wang, G., Zhang, K., Jiang, J. et al. Human–large language model collaboration in clinical medicine: a systematic review and meta-analysis. npj Digit. Med. 9, 195 (2026). https://doi.org/10.1038/s41746-026-02382-2

Trefwoorden: mens–AI samenwerking, klinische besluitvormingsondersteuning, grote taalmodellen, diagnostische nauwkeurigheid, medische documentatie