Clear Sky Science · nl

Melan-Dx: een kennisverrijkte visie-taal architectuur verbetert differentiële diagnose van melanocytaire neoplasie-pathologie

Waarom slimmere melanoomdiagnose belangrijk is

Melanoom, een gevaarlijke vorm van huidkanker, kan vaak genezen worden als het vroeg wordt ontdekt—maar alleen als artsen die weefselmonsters onder de microscoop bekijken het correct herkennen. Helaas verschillen zelfs ervaren specialisten soms van mening over wat ze zien, vooral bij grensgevallen die bijna, maar net niet, kwaadaardig lijken. Dit artikel beschrijft Melan‑Dx, een nieuw systeem voor kunstmatige intelligentie (AI) dat huidkankerexperts wil ondersteunen door duizenden door experts gelabelde microscoopbeelden te combineren met gestructureerde medische kennis, en zo snellere, consistentere en transparantere diagnoses mogelijk te maken.

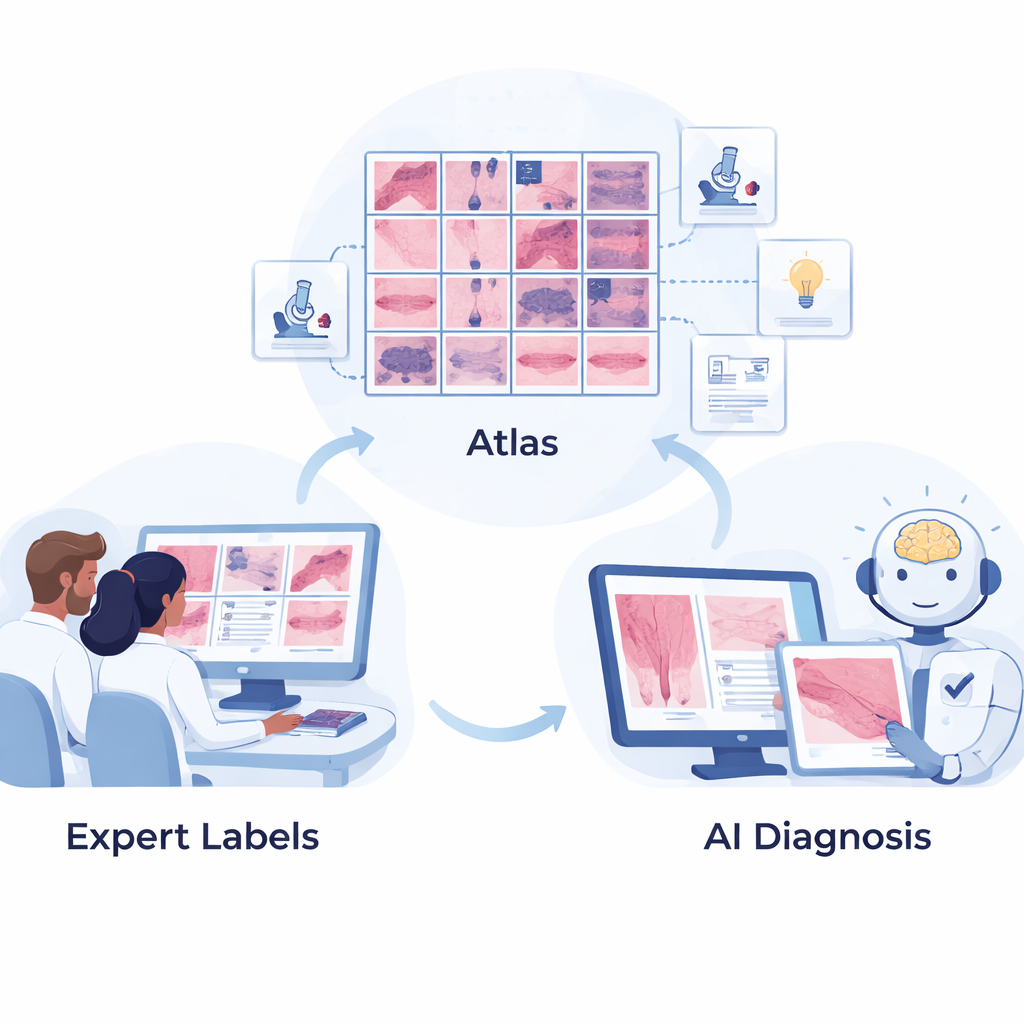

Het bouwen van een rijk atlas van huidtumorbeelden

De eerste stap was het samenstellen van een hoogwaardige "atlas" van melanocytaire tumoren—de brede familie van gezwellen die goedaardige moedervlekken en levensbedreigende melanomen omvat. Dermatopathologen van de University of Pennsylvania selecteerden en labelden zorgvuldig 2.893 microscoopbeelden die 44 verschillende typen melanocytaire laesies beslaan, van veelvoorkomende goedaardige naevi tot zeldzame, agressieve melanomen. Elk beeld richt zich op een regio van belang en is gekoppeld aan een drieledige hiërarchie gebaseerd op de tumorklassificaties van de Wereldgezondheidsorganisatie (WHO), waarbij ziekten eerst per brede categorie, vervolgens per subtype en ten slotte per specifieke diagnose worden gegroepeerd. Deze gestructureerde opzet weerspiegelt hoe specialisten over deze laesies nadenken in de dagelijkse praktijk.

AI trainen met medische kennis, niet alleen pixels

Melan‑Dx gaat verder dan typische beeld‑alleen AI door beelden te koppelen aan tekstbeschrijvingen afkomstig uit gezaghebbende medische bronnen. Voor elk ziektebeeld stelde het team korte, gestructureerde vermeldingen samen die beschrijven waar pathologen op letten—zoals celvorm, groeipatroon en resultaten van speciale kleuringen—en hoe die kenmerken het ene letsel van het andere onderscheiden. Een groot taalmodel hielp bij het organiseren van deze informatie, maar menselijke experts controleerden het op juistheid. Samen worden de beelden en teksten omgezet in numerieke "embeddings" en opgeslagen in een doorzoekbare database. Dit stelt de AI in staat niet alleen visuele patronen te herkennen, maar ze ook te koppelen aan expliciete diagnostische criteria, vergelijkbaar met een arts die een goed geïndexeerd, geïllustreerd naslagwerk raadpleegt.

Hoe het Melan‑Dx-systeem redeneert over een nieuw geval

Wanneer Melan‑Dx een nieuwe biopsie ziet, verwerkt het deze via twee gecoördineerde takken. In de beeldtak codeert een visiemodel de afbeelding en haalt het de meest vergelijkbare voorbeelden uit de atlas op, waarbij de beste overeenkomsten worden benadrukt en samengevoegd tot een verrijkte representatie. In de kennistak wordt dezelfde afbeelding gebruikt om de meest relevante tekstfragmenten over mogelijke diagnoses naar boven te halen. Speciale "expert"-modules voor elk ziektebeeld wegen welke referentiebeelden en kennisvermeldingen het meest van belang zijn, en fusieblokken combineren deze aanwijzingen. Het systeem is zo getraind dat bij een correcte diagnose de verrijkte beeld‑ en tekstrepresentaties nauw overeenkomen, terwijl niet‑overeenkomende paren uit elkaar worden geduwd. Dit contrastieve leren helpt de AI tientallen subtiel verschillende tumortypen te onderscheiden terwijl het geworteld blijft in medische kennis.

Testen van nauwkeurigheid, veiligheid en efficiëntie

De onderzoekers vergeleken Melan‑Dx vervolgens met verschillende toonaangevende pathologie‑AI‑modellen over meerdere taken. Voor de eenvoudige vraag "melanoom of niet?" behaalde Melan‑Dx tot 87% nauwkeurigheid en overtrof daarmee zowel licht aangepaste modellen als modellen die volledig opnieuw waren getraind. In een zwaardere 40‑weg classificatie over vele melanoom‑ en moedervleksubtypen bereikte het systeem bijna 70% nauwkeurigheid voor de beste gok en meer dan 87% wanneer drie gissingen werden toegestaan, wederom beter dan concurrerende benaderingen. Het systeem respecteerde ook de ziektehiërarchie: wanneer het fout zat, verwarde het vaker nauwe verwante aandoeningen dan dat het goedaardige en kwaadaardige categorieën door elkaar haalde, wat beter aansluit bij de klinische risico’s in de echte wereld. Op whole‑slide‑beelden—grote digitale scans van volledige weefselsecties—verbeterde Melan‑Dx de kankerdetectie zowel wanneer trainingsdata schaars waren als wanneer er veel voorbeelden beschikbaar waren, en deed dit terwijl de trainingstijd met bijna 90–97% werd verkort omdat het kernvisiemodel niet opnieuw hoeft te worden getraind.

Wat dit betekent voor patiënten en artsen

Voor patiënten is de belofte van Melan‑Dx geen alwetende robotdokter, maar een slimmer second opinion die kan helpen gemiste melanomen te verminderen en onnodige onrust door overdiagnose te beperken. Voor clinici biedt het systeem niet alleen een label maar ook bewijs: het toont vergelijkbare eerdere gevallen en de belangrijkste schriftelijke criteria die de suggestie ondersteunen, waardoor de redenering beter controleerbaar wordt. Hoewel het huidige werk zich richt op melanocytaire tumoren en vertrouwt op een zorgvuldig gecureerde dataset uit één centrum, kan dezelfde strategie—beelden koppelen aan gestructureerde medische kennis en retrieval gebruiken om AI te sturen—worden uitgebreid naar veel andere ziekten. Als een lichtgewicht, uitlegbaar hulpmiddel ontworpen voor mens‑AI‑samenwerking wijst Melan‑Dx op een toekomst waarin pathologen aan het roer blijven, maar beter uitgerust zijn om nauwkeurige, tijdige huidkankerdiagnoses te stellen.

Bronvermelding: Yao, J., Li, S., Liang, P. et al. Melan-Dx: a knowledge-enhanced vision-language framework improves differential diagnosis of melanocytic neoplasm pathology. npj Digit. Med. 9, 171 (2026). https://doi.org/10.1038/s41746-026-02357-3

Trefwoorden: melanoomdiagnose, computationele pathologie, medische AI, visie-taalmodellen, huidkanker detectie