Clear Sky Science · nl

Schaalvergroting van regelgevende wetenschap voor medische hulpmiddelen met grootschalige taalmodellen

Waarom dit belangrijk is voor patiënten en artsen

De moderne geneeskunde raakt snel gevuld met "slimme" apparaten die kunstmatige intelligentie gebruiken om scans te lezen, vitale functies te volgen en artsen te ondersteunen bij besluitvorming. Alleen al in de Verenigde Staten zijn meer dan duizend van zulke hulpmiddelen al door de Food and Drug Administration (FDA) vrijgegeven of goedgekeurd. Elk apparaat laat een papieren spoor achter van complexe rapporten en veiligheidsdossiers. Vandaag de dag wordt het merendeel van die informatie nog steeds handmatig doorgenomen, wat traag, duur is en al snel achterhaald raakt. Dit artikel onderzoekt of grootschalige taalmodellen—dezelfde soort AI achter geavanceerde chatbots—die documenten betrouwbaar op grote schaal kunnen lezen en omzetten in bruikbare gegevens om toezichthouders, onderzoekers en het publiek te helpen begrijpen hoe goed deze apparaten zijn gebouwd en hoe veilig ze presteren.

Het probleem van te veel complexe documenten

Elk AI-ondersteund medisch hulpmiddel gaat vergezeld van dikke beslissingssamenvattingen, veiligheidsrapporten en terugroepingsmeldingen. Deze documenten zijn lang, geschreven in dicht jargon en bevatten vaak tabellen, afbeeldingen en inconsistente opmaak. Eerdere onderzoeken hebben aangetoond dat het beantwoorden van eenvoudige vragen—zoals hoe een apparaat vóór goedkeuring werd getest, of wat er precies misging bij een storing—teams van experts vereiste die honderden pdf’s regel voor regel moesten lezen. Eenvoudige zoekhulpmiddelen en patroonherkenning vinden duidelijke details zoals identificatienummers, maar worstelen met diepere vragen die oordeel vereisen, zoals of een studie over meerdere ziekenhuizen heen is uitgevoerd of of een apparaat daadwerkelijk heeft bijgedragen aan de verwonding of het overlijden van een patiënt. Nu het aantal AI-gestuurde apparaten explosief is gegroeid, is deze handmatige aanpak onhoudbaar geworden.

Een AI-pijplijn die leest als een expert

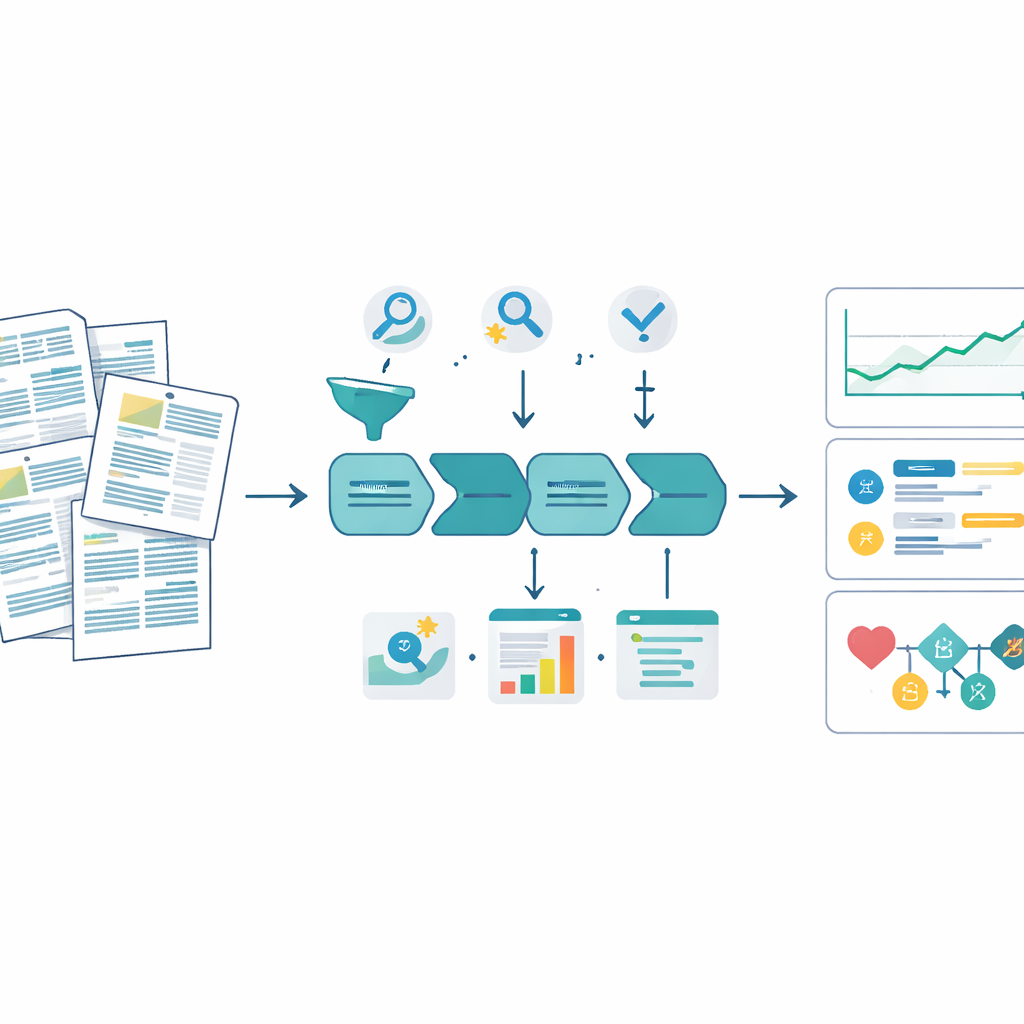

De auteurs bouwden een algemene pijplijn op basis van een state-of-the-art grootschalig taalmodel om deze uitdaging aan te pakken. Eerst verzamelden ze alle openbaar beschikbare FDA-beslissingssamenvattingen en veiligheidsrapporten voor 1.247 AI- of machine-learningapparaten en 1.852 gerelateerde meldingen van nadelige voorvallen tot medio 2025, waarbij ze de pdf’s opschonken en optische tekenherkenning gebruikten waar nodig. In plaats van het model te vragen om in één keer brede vragen te beantwoorden, verdeelden ze het werk in kleinere, goed afgebakende subtaken. Voor elk documenttype kreeg het model gedetailleerde instructies gebaseerd op officiële FDA-richtlijnen plus voorbeelden van hoe mensen informatie zouden labelen. Het model werd gevraagd stap voor stap te redeneren en zijn antwoorden in een strikte, gestructureerde vorm uit te voeren, waardoor vrije tekst werd omgezet in duidelijke velden zoals “aantal onderzoeksplaatsen”, “type veiligheidsgebeurtenis” of “soort apparaatwijziging”.

Controleren van nauwkeurigheid bij echte regelgevende vragen

Om te beoordelen of dit systeem te vertrouwen was, voerden de onderzoekers drie casestudies uit waarbij eerdere teams al maanden handmatig hadden gereviewd. Eerst heronderzoekten ze hoe apparaten vóór goedkeuring worden getest door te vragen of proeven prospectief werden uitgevoerd (gegevens vooruit verzamelend) en of ze meerdere ziekenhuizen omvatten. Bij vergelijking van modeluitkomsten met expertslabels zagen ze overeenkomsten vaak boven de 80 tot 90 procent, vergelijkbaar met de overeenstemming tussen menselijke annotatoren onderling. Ten tweede gebruikten ze het model om veiligheidsrapporten over storingen, verwondingen of sterfgevallen opnieuw te labelen en te classificeren wat er misging met het apparaat. Toen menselijke beoordelaars de oorspronkelijke codes van de fabrikant vergeleken met die door het model voorgestelde—zonder te weten welke welke waren—gaven ze de voorkeur aan de keuzes van het model in grote meerderheid van de gevallen, vooral voor gevoelige categorieën zoals overlijden versus storing. Ten derde koppelden de onderzoekers details uit documenten vóór goedkeuring aan latere veiligheidsrapporten om te onderzoeken welke vroege keuzes—zoals het kiezen van een voorganger met eerdere terugroepingen of het aanbrengen van grote hardwarewijzigingen—statistisch samenhingen met een hoger risico op toekomstige problemen.

Wat de bevindingen onthullen over veiligheid en toezicht

Nadat de pijplijn gevalideerd was, kon het team deze analyses opschalen van tientallen apparaten naar de gehele bekende populatie van AI-gestuurde medische hulpmiddelen. Ze ontdekten bijvoorbeeld dat prospectieve klinische evaluaties relatief zeldzaam zijn gebleven over drie decennia, rond één op de tien apparaten, terwijl vermeldingen van multisite-testen aanzienlijk zijn toegenomen. In veiligheidsrapporten ontmaskerde het model patronen waarbij het type in de tekst beschreven probleem niet overeenkwam met de code die bij de FDA werd ingediend—bijvoorbeeld situaties waarin hardwarefouten als afbeeldingskwaliteitsproblemen werden gelabeld. Toen ze kenmerken vóór goedkeuring koppelden aan latere veiligheidsgebeurtenissen, hadden apparaten waarvan voorgangers al terugroepingen of eerdere nadelige voorvallen hadden, veel hogere risico’s op nieuwe meldingen, terwijl apparaten die ondersteund werden door klinisch onderzoek doorgaans een lager risico toonden. Deze resultaten zijn verkennend maar illustreren het soort vragen dat nu routinematig gesteld kan worden in plaats van als eenmalige projecten.

Beperkingen, waarborgen en de weg vooruit

De auteurs benadrukken dat hun aanpak niet foutloos is en het oordeel van experts niet moet vervangen. Een nauwkeurigheid rond de 80 procent kan voldoende zijn om trends op hoofdlijnen te analyseren, maar niet om beslissingen te nemen over een individueel apparaat of patiënt. De prestaties kunnen variëren tussen apparaattype en jaargang, en de kwaliteit van de onderliggende FDA-documenten en veiligheidsdatabases blijft een grote bottleneck. Toch toont deze studie aan dat zorgvuldig ontworpen taalmodelsystemen bergen ongestructureerde regelgevende tekst in dagen in gestructureerde, controleerbare data kunnen veranderen in plaats van jaren. Voor niet‑specialistische lezers is de conclusie dat dezelfde AI-technologieën die consumentenchatbots aandrijven ook toezichthouders en onderzoekers kunnen helpen bij het volgen hoe AI‑medische hulpmiddelen worden gebouwd, getest en gemonitord—mogelijk leidend tot snellere detectie van problemen en betere bewijslast om veiligere regels en producten te vormen.

Bronvermelding: Li, H., He, X., Subbaswamy, A. et al. Scaling medical device regulatory science using large language models. npj Digit. Med. 9, 221 (2026). https://doi.org/10.1038/s41746-026-02353-7

Trefwoorden: AI medische hulpmiddelen, regelgevende wetenschap, grootschalige taalmodellen, FDA veiligheidsrapporten, toezicht op gezondheidstechnologie