Clear Sky Science · nl

Een ensemble van vision- en swin-transformers met LLM-gebaseerde verklaringen voor de diagnose van suikerrietbladziekten

Waarom het belangrijk is zieke suikerrietbladeren te herkennen

Suikerriet is een steunpilaar voor suiker, biobrandstoffen en veel plattelandsgemeenschappen, maar de bladeren zijn kwetsbaar voor diverse ziekten die ongemerkt opbrengst verminderen. Boeren vertrouwen meestal op visuele inspectie, wat traag, inconsistent en moeilijk op grote velden schaalbaar kan zijn. Deze studie onderzoekt hoe moderne kunstmatige intelligentie bladfoto’s automatisch kan lezen om meerdere suikerrietziekten met hoge nauwkeurigheid te detecteren, en vervolgens een taalmodel gebruikt om die voorspellingen om te zetten in begrijpelijke adviezen voor boeren.

Hoe de bladfoto’s tot data worden gemaakt

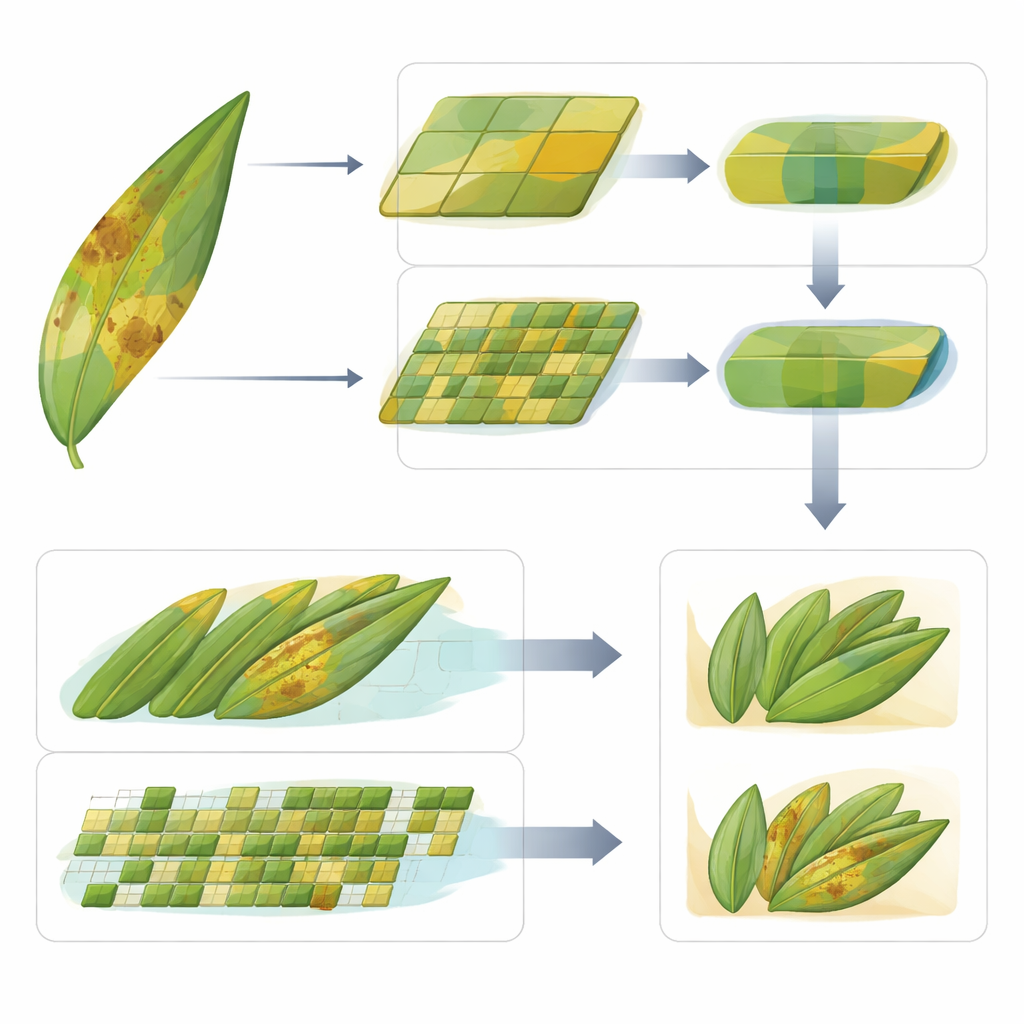

De onderzoekers bouwden hun systeem met een open beeldverzameling van suikerrietbladeren van Kaggle, met bijna twintigduizend kleurenfoto’s. Elke afbeelding behoort tot één van zes categorieën: gezond of één van vijf veelvoorkomende ziekten, waaronder Bacterial Blight, Mosaic, Red Rot, Rust en Yellow Leaf Disease. De foto’s zijn onder realistische veldomstandigheden genomen, met wisselend licht, schaduwen en rommelige achtergronden. Voor de datavoorbereiding verwijderde het team duplicaten en corrupte beelden en splitste vervolgens de dataset in trainings-, validatie- en testsets, waarbij de verhoudingen van de ziektetypen in elke set behouden bleven. Tijdens het trainen werden alleen de trainingsafbeeldingen geaugmenteerd met rotaties, flips en zoom om verschillende camerahoeken en afstanden na te bootsen, waardoor het systeem robuuster wordt zonder de testprestaties kunstmatig op te blazen.

Twee aanvullende manieren om een blad te bekijken

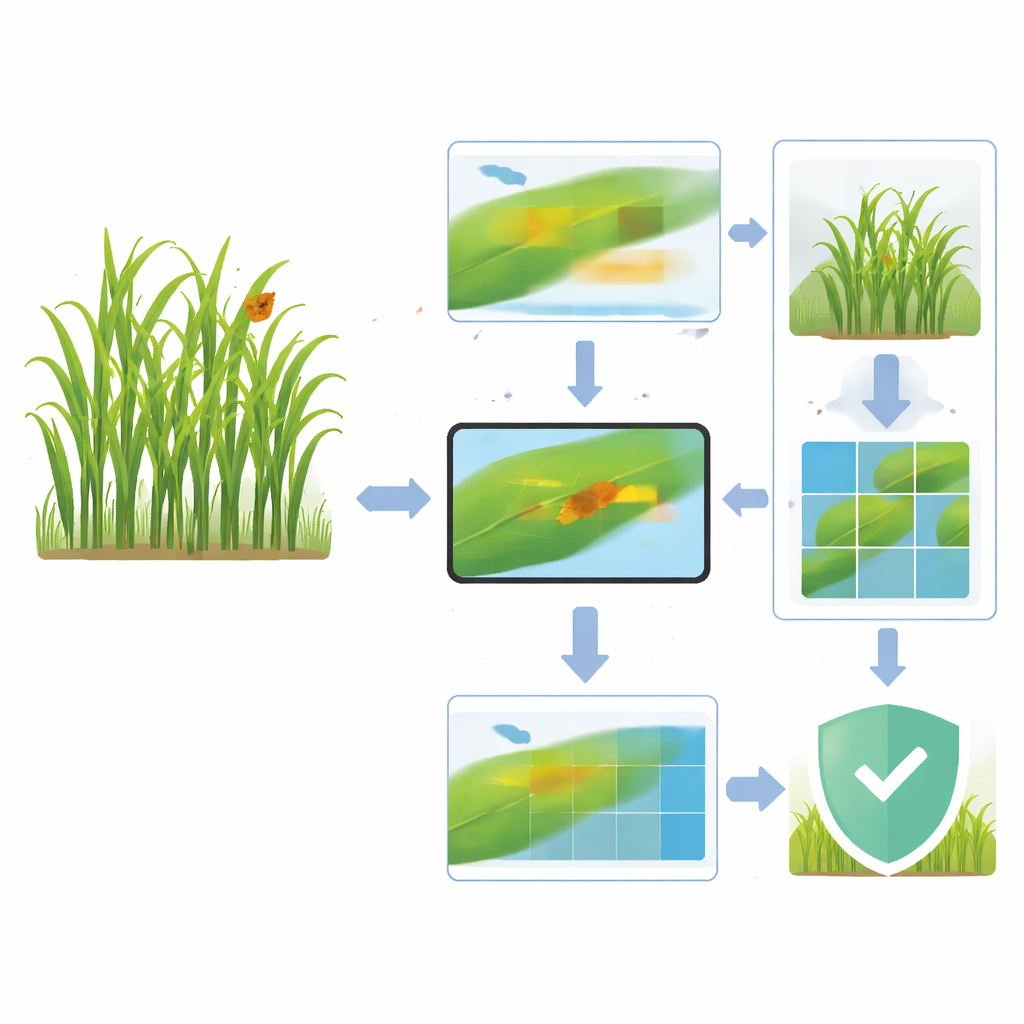

Centraal in de studie staat een “ensemble” dat twee geavanceerde vision-modellen combineert, bekend als transformers. De ene, de Vision Transformer (ViT), bekijkt elke afbeelding als een verzameling patches en leert patronen over het hele blad tegelijk. Dit globale perspectief is goed geschikt voor ziekten die zich uiten als grote, diffuse verkleuringen. De andere, de Swin Transformer genoemd, werkt met kleinere overlappende vensters die over de afbeelding schuiven en zo een gelaagde interpretatie van fijne texturen en kleine vlekjes opbouwen. Deze lokale focus helpt bij ziekten die verschijnen als kleine laesies, strepen of stipjes. Van nature is ViT gevoelig voor brede kleurveranderingen terwijl Swin let op kleine, gegroepeerde details—twee kanten van hoe echte bladziekten in het veld zichtbaar worden.

Hoe de twee modellen de krachten bundelen

In plaats van een ingewikkeld nieuw netwerk te bouwen, combineren de auteurs ViT en Swin op een eenvoudige en transparante manier. Elk model onderzoekt eerst dezelfde bladafbeelding en produceert zijn eigen waarschijnlijkheidsscores voor de zes klassen. Deze scores worden vervolgens gemiddeld, zonder extra trainbare gewichten, en de hoogste gecombineerde waarschijnlijkheid bepaalt de uiteindelijke diagnose. Deze gemiddelde-strategie balanceert de sterke punten van elk model en voorkomt overfitting op een dataset die, hoewel redelijk groot, nog steeds een specifieke reeks regio’s en omstandigheden weerspiegelt. Experimenten tonen aan dat het vervangen van Swin door een traditioneel convolutioneel netwerk cruciale lokale details verwijdert, en dat alleen ViT subtiele aanwijzingen mist—bewijs dat de winst voortkomt uit de echte synergie van globale en lokale aandacht, en niet alleen uit het stapelen van meer modellen.

Hoe goed het systeem in de praktijk werkt

Op de apart gehouden testset van bijna drieduizend afbeeldingen bereikt het ensemble een nauwkeurigheid van ongeveer 97 procent, met vergelijkbaar hoge precisie-, recall- en F1-scores over alle zes klassen. Het presteert beter dan sterke convolutionele basismodellen zoals ResNet, EfficientNet, MobileNet en DenseNet, evenals beter dan de individuele ViT- en Swin-modellen. De verwarringsmatrix toont dat de meeste fouten optreden tussen visueel vergelijkbare ziekten, zoals Yellow Leaf en Mosaic, maar over het algemeen blijven de foutclassificatiepercentages laag. Receiver operating characteristic-curves voor elke klasse zijn bijna perfect, wat aangeeft dat het ensemble zeer zeker en consistent is in het scheiden van gezonde en zieke bladeren en tussen verschillende ziektetypen.

Voorspellingen omzetten in boer-vriendelijke adviezen

Om verder te gaan dan ruwe labels koppelen de auteurs hun beeldensemble aan een online gehost groot taalmodel (LLM). Zodra een bladfoto is geclassificeerd, wordt de voorspelde ziektenaam naar het LLM gestuurd, dat een korte uitleg teruggeeft over waarschijnlijke symptomen en algemene beheersingssuggesties, bedoeld voor boeren en voorlichters. Een webinterface gebouwd op het Hugging Face-platform stelt gebruikers in staat een bladafbeelding te uploaden, de voorspelde ziekte te zien en binnen enkele seconden de door AI gegenereerde adviezen te lezen. De auteurs benadrukken dat deze aanbevelingen adviserend zijn en met agronomie-experts gecontroleerd moeten worden, omdat LLM’s soms overmatig zelfverzekerde of onvolledige adviezen kunnen geven. Toch maakt deze taallaag het systeem toegankelijker voor niet-specialisten.

Wat dit betekent voor toekomstige slimme landbouwtools

Kort gezegd laat de studie zien dat het combineren van twee “wijze van zien” van hetzelfde blad—één die het geheel ziet, één die de details ziet—kan leiden tot een zeer betrouwbare digitale verkenner voor suikerrietziekten. Het ensemble van ViT- en Swin-transformers vangt zowel brede als fijnmazige symptomen, terwijl het gekoppelde taalmodel helpt technische voorspellingen om te zetten in mensvriendelijke suggesties. Hoewel de modellen nog getest moeten worden op meer regio’s, lichtomstandigheden en apparaten, en de taaluitvoer door experts geverifieerd moet worden, wijst dit werk op praktische telefoon- of tablettools die boeren kunnen helpen problemen vroeg te signaleren, giswerk te verminderen en het preciezer gebruik van behandelingen bij suikerriet en uiteindelijk ook andere gewassen te ondersteunen.

Bronvermelding: Saritha, M., Rasane, K. An ensemble of vision and swin transformers with LLM-based explanations for sugarcane leaf disease diagnosis. Sci Rep 16, 10707 (2026). https://doi.org/10.1038/s41598-026-45453-w

Trefwoorden: detectie van suikerrietziekten, transformer-vision-modellen, precisie-landbouw, plantbladbeeldvorming, AI-besluitvorming