Clear Sky Science · nl

Instrumentsegmentatie in chirurgie, onafhankelijk van domein, met zwak toezicht

Waarom slimmer zicht op chirurgische instrumenten belangrijk is

Moderne chirurgen opereren steeds vaker met hulp van camera’s, microscopen en geavanceerde scanners. Om robots te sturen, 3D-weergaven uit te lijnen of instrumenten in bepaalde beelden te verbergen, moeten computers in elke frame betrouwbaar elk chirurgisch instrument vinden — een taak die segmentatie wordt genoemd. Vandaag de dag vereist dat meestal duizenden nauwkeurige, pixel-perfecte annotaties van medische experts — en zelfs dan falen systemen vaak wanneer de beeldopstelling of procedure verandert. Deze studie introduceert een manier waarop krachtige visiemodellen instrumenten kunnen vinden in zeer verschillende soorten medische beelden, zonder dat van tevoren gedetailleerde tekeningen van elk hulpmiddel nodig zijn.

De uitdaging van het vinden van instrumenten in uiteenlopende beelden

Chirurgen gebruiken een breed scala aan beeldvormingssystemen: kleurvideo’s van laparoscopische camera’s in de buikholte, microscoopbeelden van het oog tijdens staaroperaties en doorsnedescans zoals optische coherentie-tomografie (OCT) of echografie. In elk van deze beelden zien chirurgische instrumenten er heel anders uit — glanzende metalen staven in kleurbeelden, dunne heldere lijnen of halvemaanvormige structuren in OCT, of korrelige vlekken in echografie. Bestaande deep-learningmethoden kunnen zeer goed werken, maar alleen nadat ze zijn getraind op grote, zorgvuldig gelabelde datasets uit een specifieke situatie. Wanneer het beeldvormingsapparaat, de anatomie of het type instrument verandert, daalt de prestatie vaak scherp, en het verzamelen van nieuwe annotaties is traag, duur en gebonden aan privacy- en expertisebeperkingen.

Een nieuw idee: behandel instrumenten als uit-de-context objecten

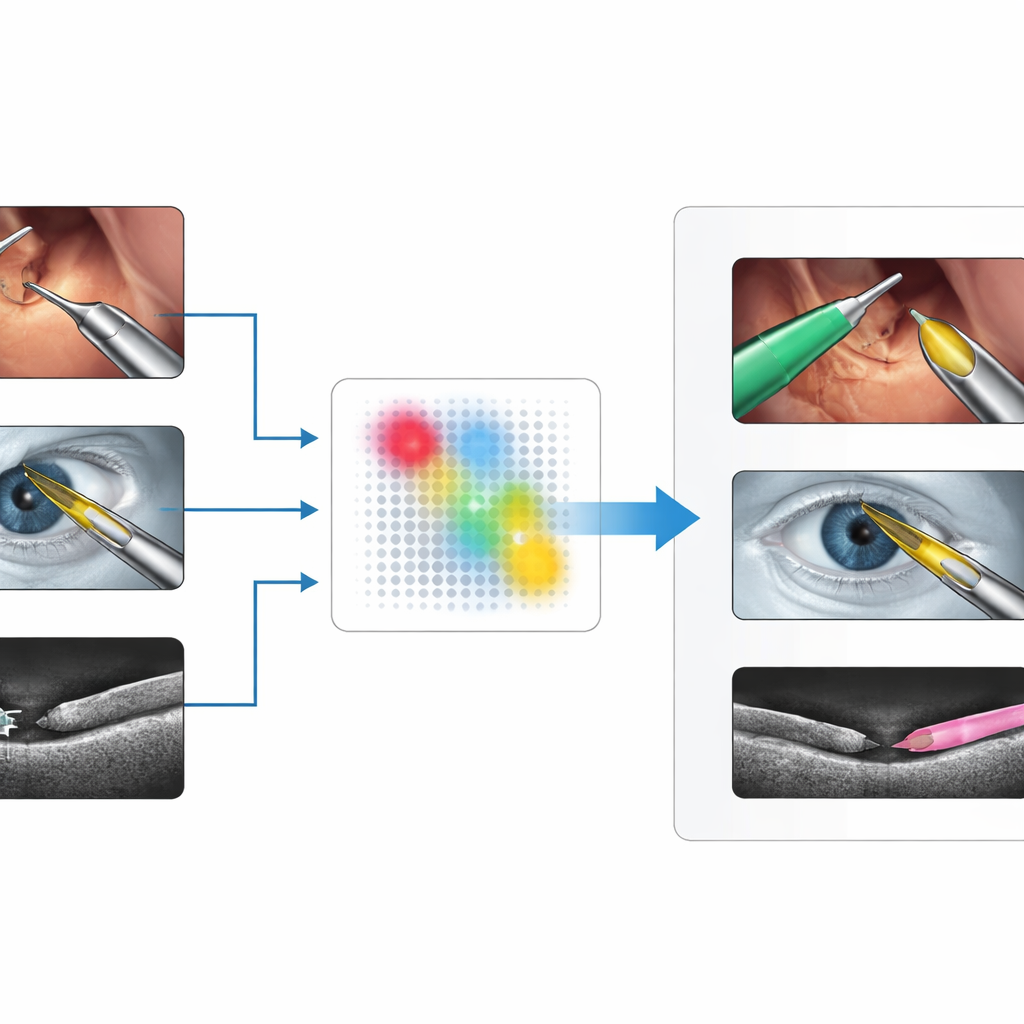

De auteurs stellen een methode voor die ze SAM4SIS noemen en die het probleem omdraait. In plaats van het systeem precies te leren wat elk instrument eruitziet, laten ze het eerst beelden zonder instrumenten zien, zodat het kan leren hoe “normaal” weefsel eruitziet. Ze gebruiken een anomaliedetector genaamd PatchCore om een geheugen van deze normale patronen op te bouwen. Wanneer een nieuw beeld binnenkomt, markeert PatchCore regio’s waarvan het uiterlijk niet bij dat geheugen past — gebieden die waarschijnlijk chirurgische instrumenten bevatten. Deze stap heeft alleen eenvoudige afbeelding-niveau informatie nodig over de aanwezigheid van een instrument, niet pixelgewijze tekeningen van de omtrek, wat de opzet veel eenvoudiger maakt.

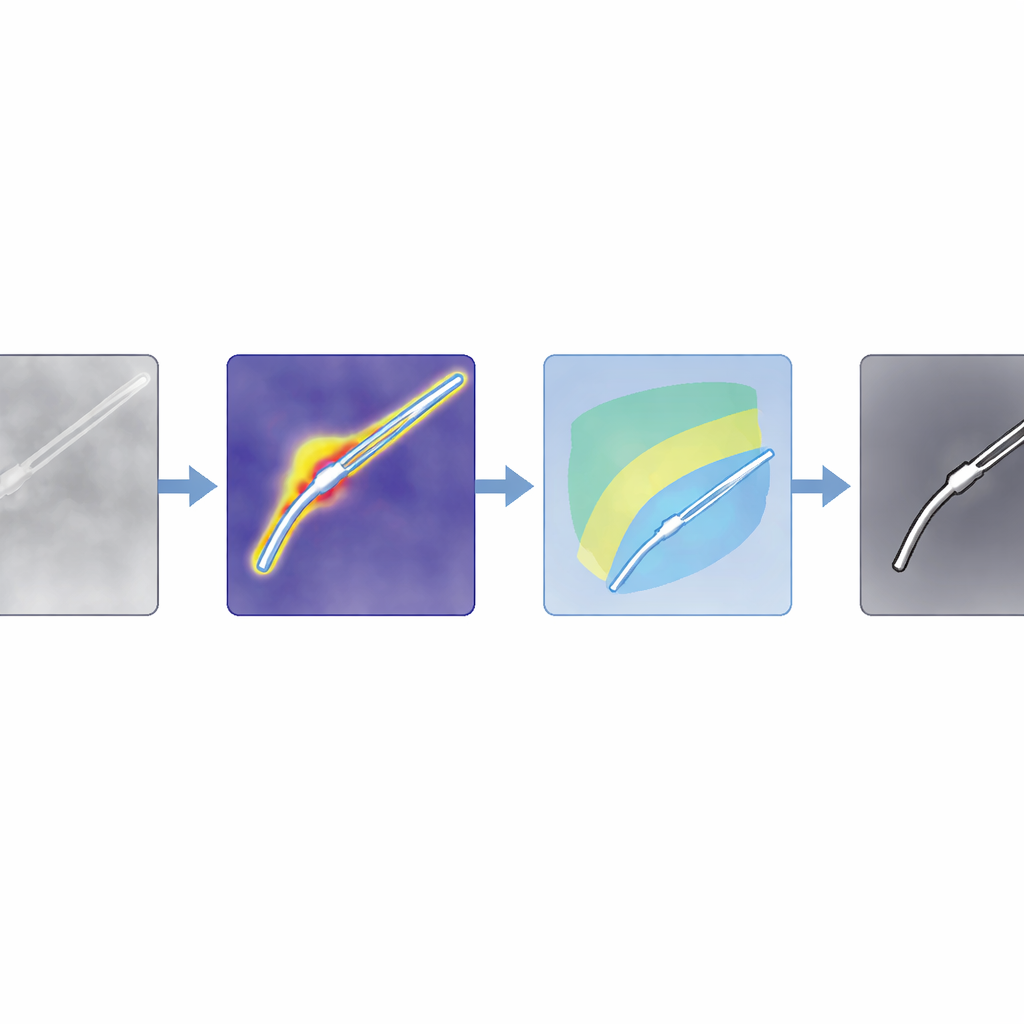

Van ruwe aanwijzingen naar precieze omtrekken

Anomaliekaarten zijn grof, dus combineert het team ze met een krachtig fundatiemodel, Segment Anything Model 2 (SAM2), dat scherpe omtrekken kan tekenen als het een punt binnen het object van belang krijgt. De sleuteltruc is die punten automatisch te kiezen uit de anomaliekaart, in plaats van een mens te laten klikken. De auteurs ontwerpen filters die zijn afgestemd op gewone kleurbeelden en op intensiteitsgebaseerde scans zoals OCT, waarbij regio’s worden versterkt die waarschijnlijk instrumenten bevatten en schaduwen en heldere artefacten worden onderdrukt. Vervolgens scoren ze potentiële instrumentgebieden en kiezen de sterkste plekken als prompts voor SAM2. Omdat SAM2 meerdere kandidaat-omtrekken teruggeeft, introduceren de auteurs een nieuwe scoreringsregel, SAM4SIS, die meet hoe goed elke kandidaat overeenkomt met de anomalie-gebaseerde kaart en de best passende mask selecteert.

Werkt bij veel verschillende operaties en scanners

De onderzoekers testen hun aanpak op drie veeleisende datasets: buikoperaties met robotte hulp (EndoVis2017), microscoopbeelden van staaroperaties (CaDIS) en doorsnede-OCT-scans van varkensoogjes met kleine instrumenten (PASO-SIS). Deze bestrijken zeer verschillende gezichtspunten, kleuren en ruispatronen. Zonder ooit het grote segmentatiemodel opnieuw te trainen of nieuwe maskers te tekenen, bereikt SAM4SIS rand-accuratesse-scores tussen ongeveer 53% en 73%, wat kan concurreren met of beter is dan tekstgebaseerde promptingmethoden en in de buurt komt van sommige supervisie-gebaseerde systemen. Het presteert vooral goed waar traditionele methoden moeite hebben, zoals in OCT- en echografiegegevens, en heeft minder dan een minuut opzettijd nodig. Het team laat ook zien dat hetzelfde idee andere vreemde objecten kan markeren, zoals watjes in hersenechografiebeelden, wat suggereert dat het concept niet beperkt is tot instrumenten.

Wat dit betekent voor de toekomst van slimme chirurgie

De kernboodschap voor lezers is dat computers nu kunnen leren om “alles nieuws te segmenteren” in chirurgische scènes door eerst te begrijpen hoe normaal weefsel eruitziet en vervolgens onbekende vormen te markeren als waarschijnlijke instrumenten, die daarna worden verfijnd door een algemeen visiemodel. Deze aanpak voorkomt omvangrijke annotatiewerkzaamheden, past zich aan verschillende beeldvormingstechnologieën aan en kan in chirurgische workflows worden geïntegreerd met minimale voorbereiding. Hoewel zorgvuldig getrainde, gespecialiseerde modellen nog steeds winnen wanneer veel gelabelde data beschikbaar zijn, biedt SAM4SIS een praktische alternatieve oplossing voor nieuwe procedures, zeldzame beeldopstellingen of vroegonderzoek, en brengt het robuuste, geautomatiseerde detectie van instrumenten dichter bij dagelijkse klinische praktijk.

Bronvermelding: Peter, R., Pham, D.X.V., Matten, P. et al. Domain-agnostic weakly supervised surgical instrument segmentation. Sci Rep 16, 9337 (2026). https://doi.org/10.1038/s41598-026-43054-1

Trefwoorden: segmentatie van chirurgische instrumenten, AI voor medische beeldvorming, anomaliedetectie, fundamentele visiemodellen, robotchirurgie