Clear Sky Science · nl

Ontwikkeling en evaluatie van een multistaps transfer-learningkader voor robuuste medische beeldanalyse

Waarom slimmer beeldlezen belangrijk is

De moderne geneeskunde leunt sterk op beeldmateriaal — van mammogrammen tot thoraxfoto’s — om ziekten vroeg te ontdekken en behandelingen te sturen. Computers leren deze beelden even nauwkeurig te lezen als menselijke experts vergt echter meestal enorme, zorgvuldig gelabelde datasets die veel ziekenhuizen simpelweg niet hebben. Deze studie introduceert een nieuwe manier om kunstmatige-intelligentiesystemen te trainen die bestaande beelden beter benut, waaronder goedkope laboratoriummicrofoto’s van kankercellen, om de prestaties op echte scans te verbeteren en tegelijk de eisen aan privacy en data te verlichten.

Van alledaagse foto’s naar ziekenhuisscans

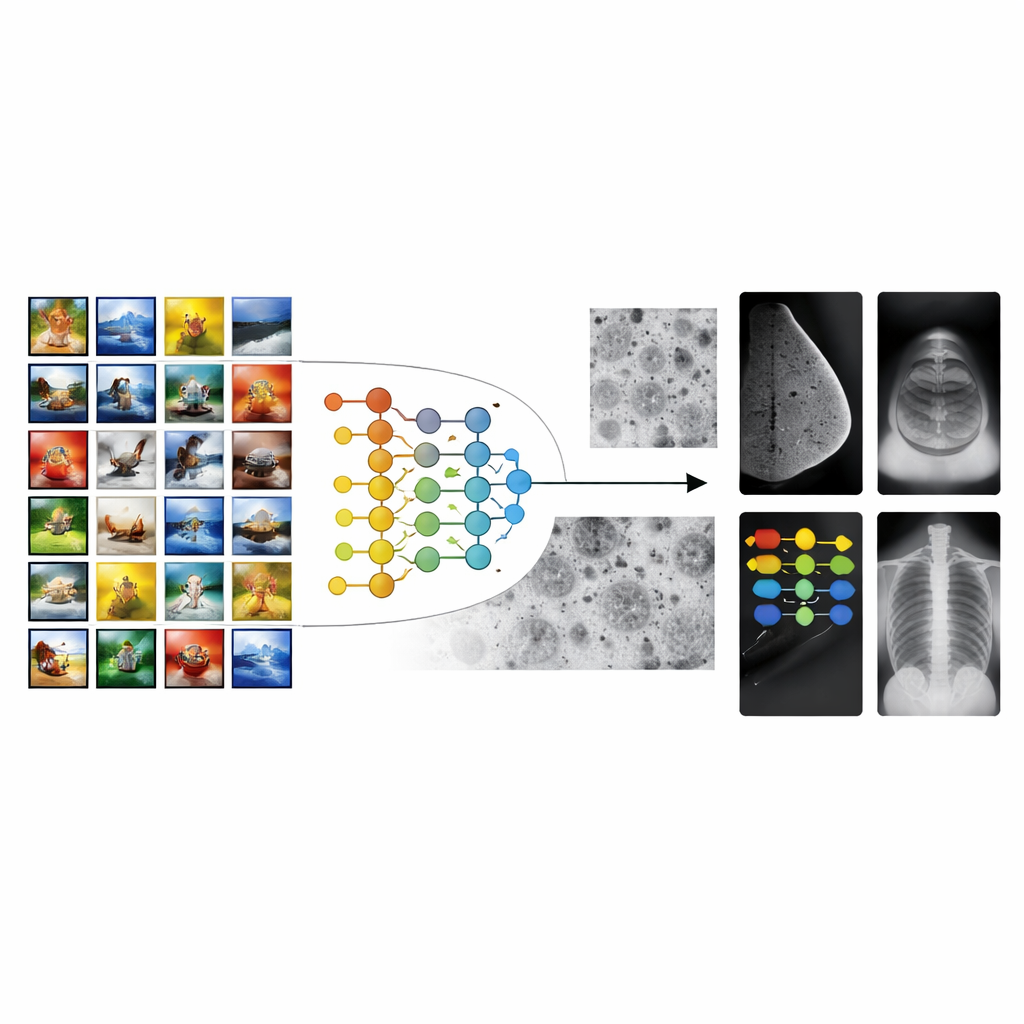

De meeste medische imaging-AI-systemen beginnen met modellen die getraind zijn op miljoenen alledaagse foto’s, zoals dieren, voorwerpen en landschappen. Deze strategie, bekend als transfer learning, geeft algoritmen een ‘voorsprong’ bij het herkennen van vormen en texturen. Er bestaat echter een grote kloof tussen vakantiefoto’s en medische scans. De patronen die tellen in een mammogram of röntgenfoto — kleine vlekjes, zwakke schaduwen of subtiele weefseltexturen — lijken helemaal niet op objecten in gewone foto’s. Daardoor kan conventionele transfer learning vastlopen, wat leidt tot tools die in het lab goed presteren maar moeite hebben in verschillende ziekenhuizen, op verschillende machines of bij uiteenlopende patiëntengroepen.

Een brug bouwen met celbeelden

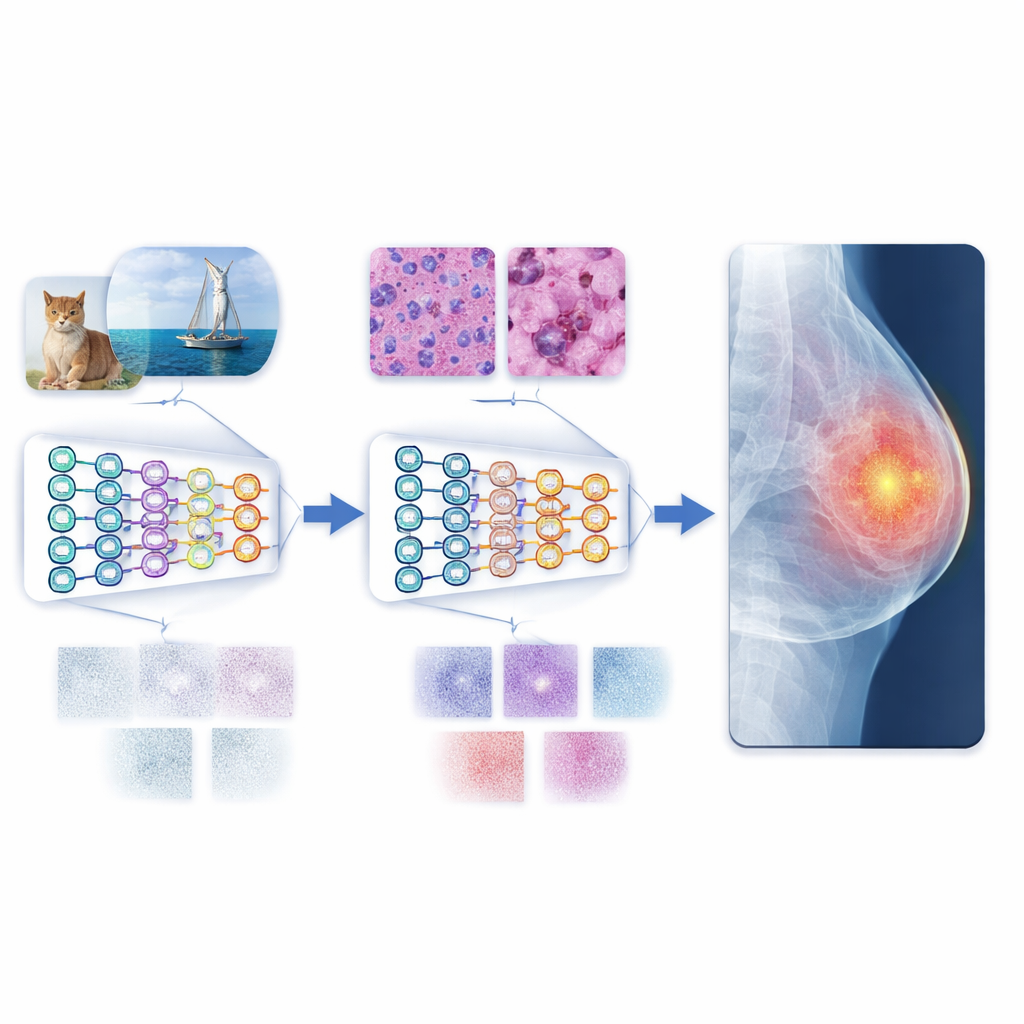

De auteurs stellen een multistaps transfer-learning (MSTL)-kader voor dat een belangrijke tussenstap toevoegt tussen algemene afbeeldingen en klinische scans. Nadat het model eerst getraind is op een grote collectie natuuropnamen, wordt het fijn afgesteld op microscopische beelden van in het laboratorium gekweekte kankercellijnen. Deze celbeelden delen veel visuele kenmerken met medische scans: dichte, compacte structuren; fijnmazige texturen; en subtiele helderheidsvariaties. Ze zijn bovendien relatief goedkoop te produceren, in grote aantallen te genereren en brengen niet de privacyzorgen met zich mee die verbonden zijn aan patiëntgegevens. Door eerst aan deze wereld van celbeelden te wennen, leert het model kenmerken die relevanter zijn voor ziektepatronen voordat het ooit een mammogram, echo of röntgenfoto ziet.

Testen over verschillende scan types

Om deze strategie te evalueren, trainden de onderzoekers zowel traditionele convolutionele neurale netwerken als nieuwere vision transformers op drie veelvoorkomende beeldtaken: borstkankerdetectie in mammogrammen, analyse van borstlaesies in echografie en pneumoniedetectie in thoraxfoto’s. Ze vergeleken drie trainingsstijlen: vanaf nul trainen, conventionele transfer learning vanaf natuuropnamen en de nieuwe multistapsmethode met kankercelbeelden als brug. De multistapsaanpak leverde consequent de beste resultaten en bracht de nauwkeurigheid op de geteste datasets vaak dicht bij perfect. Vision transformers, die langbereikspatronen over een hele afbeelding kunnen vastleggen, presteerden in bijna alle gevallen beter dan standaard convolutionele netwerken, vooral in combinatie met de multistaptraining.

Meten hoe goed kennis overdraagt

Naast eenvoudige nauwkeurigheidsscores onderzochte het team hoe makkelijk kenmerken die in een fase geleerd zijn naar de volgende fase overgedragen kunnen worden. Ze gebruikten drie meetmethoden voor transferability die weergeven hoe compatibel de geleerde beeldpatronen zijn met nieuwe taken. Voor mammogrammen en thoraxfoto’s in het bijzonder liepen deze maatstaven sterk in de pas met de werkelijke prestaties, vooral voor het krachtigste model, een basis vision transformer (ViTB-16). Deze nauwe relatie suggereert dat de tussenstap met celbeelden meer doet dan alleen de cijfers verbeteren; ze genereert representaties die daadwerkelijk beter ‘passen’ bij medische beelden. Aanvullende experimenten toonden aan dat het halveren van het aantal celbeelden de prestaties schaadt, en dat vervanging door andere medische modaliteiten (zoals endoscopie of oogbeelden) minder effectief was, wat de bijzondere waarde van kankercellijnen als brug onderstreept.

Op weg naar betrouwbaardere geautomatiseerde diagnose

In eenvoudige bewoordingen laat de studie zien dat het een AI-systeem eerst leren lezen van in het laboratorium gekweekte celbeelden voordat het ziekenhuisscans te zien krijgt, het een vaardigere en betrouwbaardere ‘lezer’ van medische beelden maakt. Dit multistapstraject verkleint de mismatch tussen kleurrijke alledaagse foto’s en de gedempte, complexe patronen in klinische beelden, waardoor het model beter generaliseert, zelfs als er maar bescheiden hoeveelheden gelabelde medische data beschikbaar zijn. In combinatie met moderne vision transformers levert de aanpak state-of-the-art prestaties op verschillende benchmarkdatasets. Hoewel meer diverse data en bredere tests nog nodig zijn, wijst het kader op schaalbare, privacyvriendelijke tools die artsen wereldwijd zouden kunnen ondersteunen bij het nauwkeuriger en consistenter diagnosticeren van ziekte.

Bronvermelding: Ayana, G., Park, Sy., Jeong, K.C. et al. Development and evaluation of a multistage transfer learning framework for robust medical image analysis. Sci Rep 16, 8873 (2026). https://doi.org/10.1038/s41598-026-42157-z

Trefwoorden: medische beeldanalyse, transfer learning, deep learning, vision transformers, beeldvorming van kankercellen