Clear Sky Science · nl

Ontwerp en implementatie van een deep learning-framework voor geautomatiseerde gewassclassificatie en gezondheidsdiagnose in precisielandbouw

Slimmere akkers voor een hongerige wereld

Om een groeiende wereldbevolking te voeden moet er meer voedsel per hectare worden geproduceerd, terwijl er minder water, kunstmest en arbeid wordt verspild. Toch lopen boeren nog steeds talloze uren over hun land om bladeren en bodem visueel te inspecteren. Dit artikel introduceert een geautomatiseerde manier om gewassen te bewaken met vliegende drones, satellieten in een baan om de aarde en ingebedde sensoren, allemaal gekoppeld aan een deep learning-systeem dat problemen vroeg signaleert en snelle acties kan voorstellen.

Lucht en bodem samenbrengen

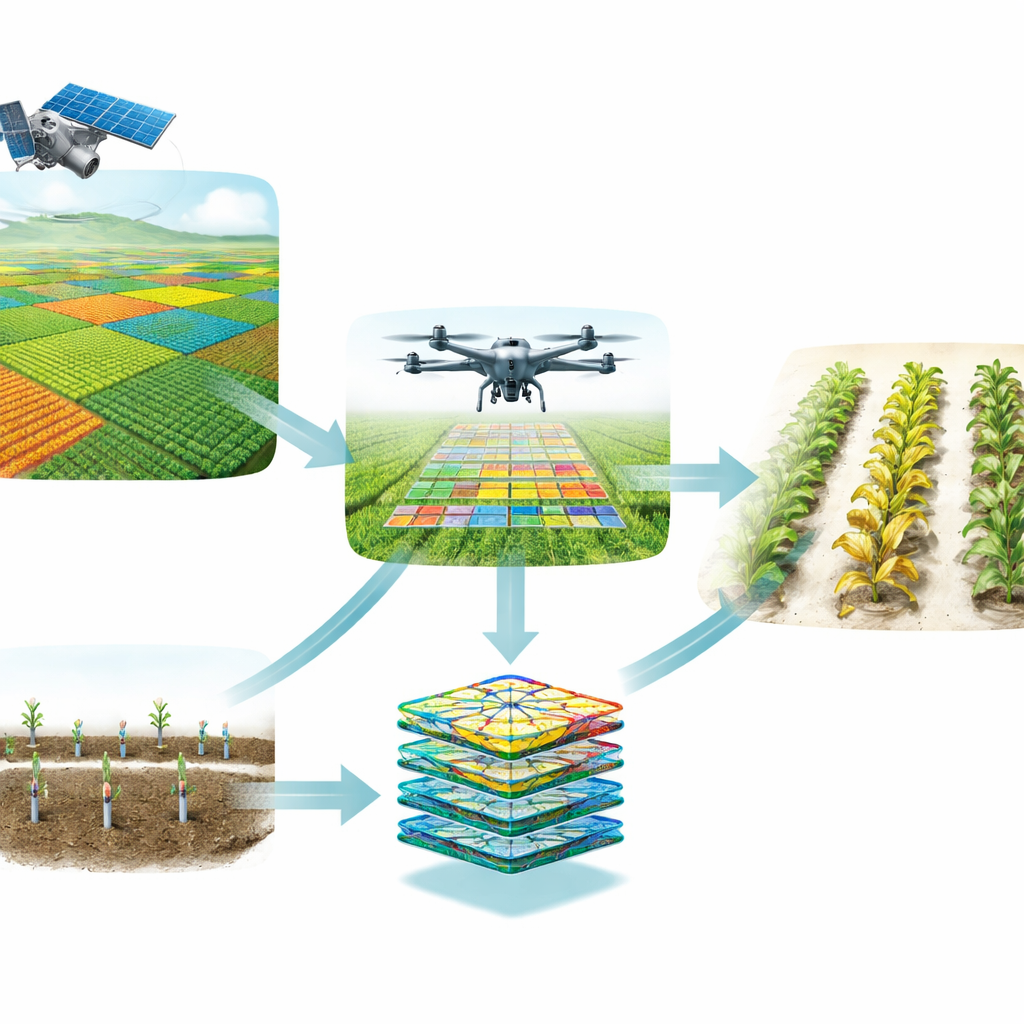

De meeste geavanceerde landbouwhulpmiddelen bekijken slechts één deel van de puzzel: close-upfoto’s van bladeren of ruwe waarden van bodemsondes. De auteurs betogen dat dit ‘gesiloode’ beeld belangrijke aanwijzingen mist. Hun framework combineert daarom drie gezichtspunten. Vanuit de ruimte tonen satellietbeelden patronen op grote schaal, zoals welke delen van een perceel onder stress staan. Vanuit de lucht leggen drones gedetailleerde kleur- en nabij-infraroodbeelden van individuele planten vast. In de grond volgen internet-verbonden sensoren vocht, nutriënten, temperatuur en andere omstandigheden. Door deze gegevensbronnen in tijd en locatie op elkaar af te stemmen, kan het systeem verbinden wat het op de bladeren ziet met wat er in de bodem en de omgeving gebeurt.

Hoe de digitale gewasarts leert

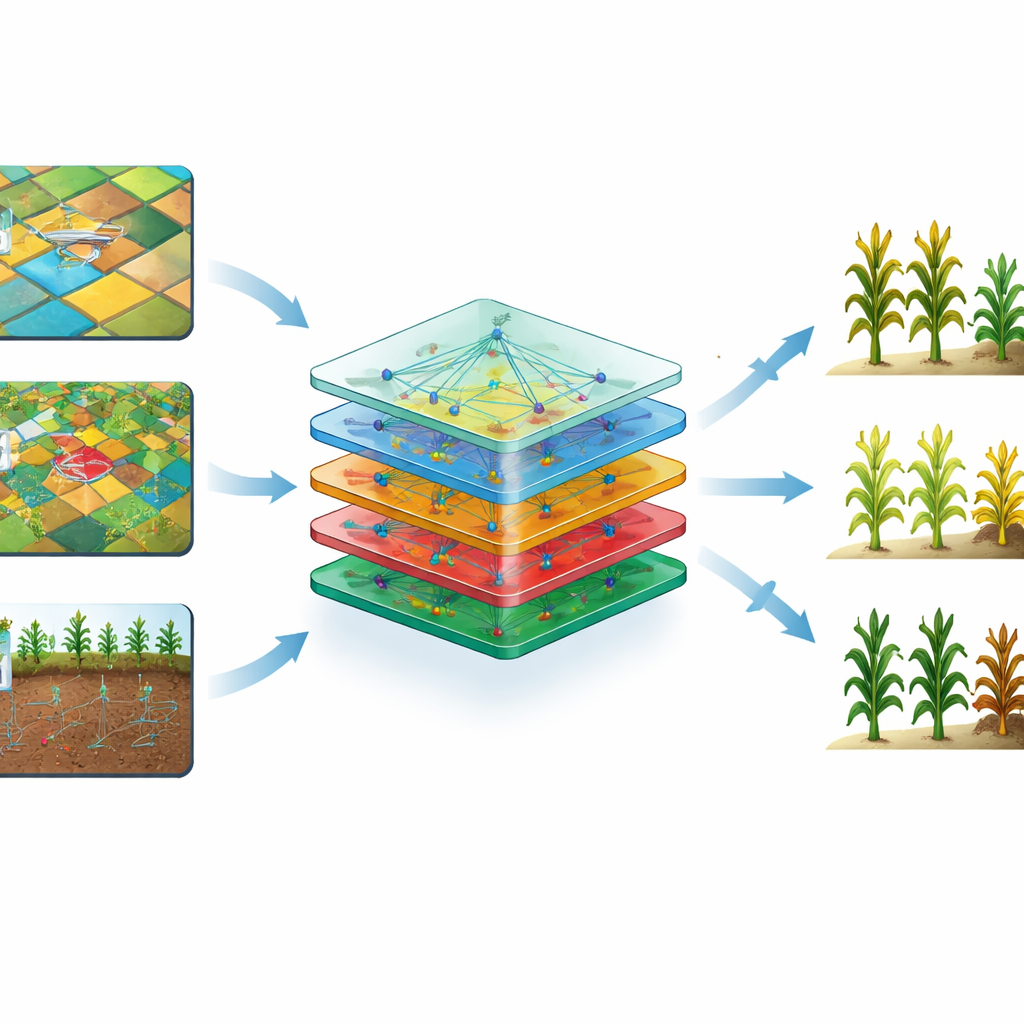

De kern van het framework is een deep learning-model dat getraind is om gewastypen en gezondheidscondities te herkennen. Eerst worden alle binnenkomende gegevens opgeschoond en gestandaardiseerd: bewolkte satellietbeelden worden genormaliseerd, dronefoto’s worden verkleind en aangepast voor veranderend licht en gaten in weersregistraties worden aangevuld. Het systeem vergroot ook de beeldgegevens door foto’s te roteren en te spiegelen zodat het model leert om camerahoek te negeren en zich te richten op echte plantenkenmerken. Vervolgens haalt een gespecialiseerd beeldanalyseto netwerk, bekend als een convolutioneel neuraal netwerk, patronen naar boven zoals bladtextuur, kleurveranderingen en laesievormen, terwijl aanvullende lagen de numerieke sensorgegevens verwerken. Een ‘attention’-mechanisme helpt het model zich te concentreren op de meest informatieve regio’s — zoals een plekje met gevlekte bladeren — terwijl achtergrondgrond of lucht wordt onderdrukt.

Van ruwe data naar realtime beslissingen

Eenmaal getraind werkt het model als een altijd-aan gewasarts. Meerdere databronnen worden gestreamd in het systeem en samengevoegd tot één interne voorstelling. De door attention geleide lagen vergelijken wat ze zien met duizenden eerdere voorbeelden; het uiteindelijke classificatieblok beslist vervolgens of een plant gezond is of tekenen van ziekte, plaagschade of stress vertoont. In plaats van een veld simpelweg als goed of slecht te labelen, koppelt het framework zijn visuele diagnose aan de huidige bodemvochtigheid en nutriëntenniveaus. Die combinatie stelt het in staat waarschuwingen te prioriteren: bijvoorbeeld kan een ziekted patroon in combinatie met vochtige omstandigheden een hoge-urgentie waarschuwing activeren, wat onmiddellijke, gerichte bespuiting oproept in plaats van een algehele behandeling over het hele bedrijf.

Het systeem op de proef stellen

Om te onderzoeken of deze aanpak buiten de theorie werkt, trainden en evalueerden de auteurs hun framework op een openbaar precisielandbouw-dataset met satellietbeelden, dronefoto’s en grondsensorgegevens voor belangrijke basisgewassen: maïs, aardappel en tarwe. Ze verdeelden de data in trainings-, validatie- en testsets om overfitting te voorkomen en vergeleken hun model met standaard deep learning- en traditionele machine learning-technieken. Hun multimodale systeem bereikte consequent meer dan 90 procent nauwkeurigheid bij het identificeren van gewastype en gezondheidstoestand, terwijl het ook snellere voorspellingen maakte dan de basisreferentiemodellen. Belangrijk is dat wanneer één gegevensbron verslechterde — bijvoorbeeld dronebeelden die door schaduwen werden beïnvloed — het systeem nog steeds hoge nauwkeurigheid kon behouden door zwaarder te leunen op bodem- en satellietinformatie.

Wat dit betekent voor boeren

De kernconclusie van de studie is dat het combineren van gezichten van lucht tot bodem computers in staat stelt gewasgezondheid betrouwbaarder te beoordelen dan menselijke inspecteurs of enkelvoudige sensorsystemen. Voor boeren kan dat eerdere waarschuwingen voor ziektedoorbraken betekenen, nauwkeuriger gebruik van water en chemische middelen, lagere arbeidskosten en uiteindelijk hogere opbrengsten met minder milieu-impact. Hoewel het huidige systeem nog afhankelijk is van goede connectiviteit om data naar de cloud te sturen, zouden toekomstige versies direct op drones of edge-apparaten in het veld kunnen draaien. Als dit op schaal wordt gerealiseerd, zouden zulke slimme, multi-oog bewakers van het erf een hoeksteen kunnen worden van echt duurzame, datagedreven landbouw.

Bronvermelding: Pal, A.K., Patro, B.D.K. & Chaube, S. Design and implementation of a deep learning framework for automated crop classification and health diagnosis in precision agriculture. Sci Rep 16, 11436 (2026). https://doi.org/10.1038/s41598-026-42151-5

Trefwoorden: precisielandbouw, detectie van gewasziekten, deep learning, drone- en satellietbeeldvorming, slimme landbouw