Clear Sky Science · nl

GWKNN: een verbeterd k-nearest neighbor-algoritme met G-metriekreconstructie en Grey Wolf Optimizer

Slimmere patroonherkenning voor de huidige gegevensovervloed

Van medische scans tot banktransacties: het moderne leven genereert enorme hoeveelheden gegevens. Veel van die informatie moet automatisch in categorieën worden ingedeeld: gezond of ziek, frauduleus of normaal, spam of echt. Een klassieker voor dit soort taken is het k-nearest neighbors (KNN)-algoritme, dat een nieuw geval labelt door te kijken naar de meest vergelijkbare eerdere voorbeelden. Maar naarmate datasets groter, complexer en meer onevenwichtig worden, begint dit eenvoudige idee te haperen. Dit artikel introduceert GWKNN, een vernieuwde versie van KNN die slimmer met afstanden tussen punten omgaat en zeldzame maar belangrijke gevallen eerlijker behandelt.

Waarom simpele gelijkenis tekortschiet

Conventionele KNN gaat ervan uit dat alle kenmerken van een datapunt evenveel bijdragen en meet gelijkenis met een standaard euclidische afstand. Dat werkt goed als gegevens laag-dimensionaal en netjes gescheiden zijn, maar echte wereldgegevens zijn vaak hoog-dimensionaal, ruisig en een mix van verschillende typen informatie. In die gevallen kan de gebruikelijke afstand misleidend zijn, waardoor het algoritme niet-helpende buren kiest. Tegelijkertijd zijn veel datasets onevenwichtig: veelvoorkomende klassen domineren, terwijl zeldzame maar cruciale klassen, zoals een vroeg stadium van een ziekte, ondervertegenwoordigd zijn. Wanneer KNN stemt over nabijgelegen voorbeelden, verdringt de meerderheid vaak deze minderheidscases, wat leidt tot bevooroordeelde en soms gevaarlijke beslissingen.

Het algoritme een beter gevoel voor afstand leren

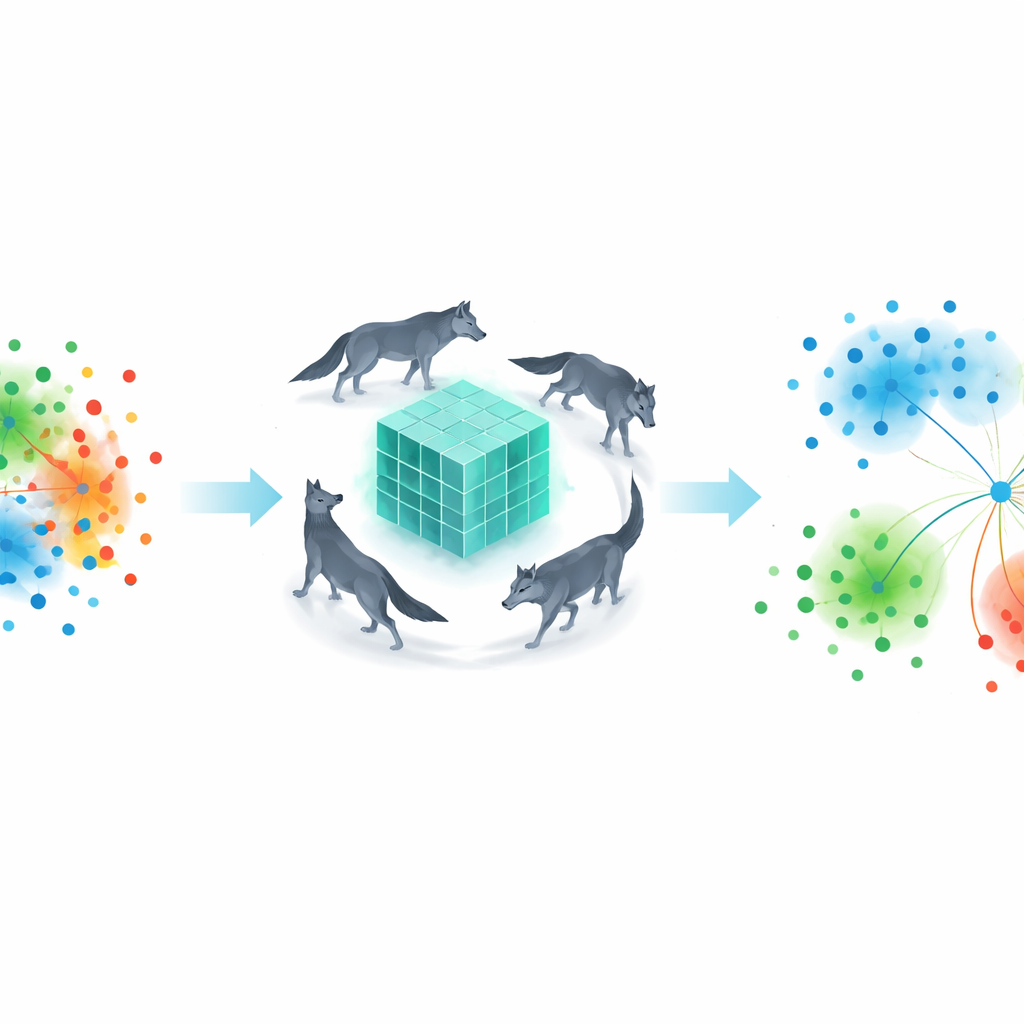

De eerste belangrijke innovatie in GWKNN is een aangeleerde afstandsmaat. In plaats van vast te houden aan de gebruikelijke rechte-lijnregel, laten de auteurs het algoritme ontdekken hoe ver punten van elkaar moeten liggen op een manier die de klassen het beste scheidt. Ze coderen dit als een flexibele "G-metriek" die de ruimte hervormt zodat informatieve kenmerken zwaarder wegen en redundante kenmerken minder. Om deze metriek af te stemmen, put de methode inspiratie uit het jachtgedrag van grijze wolven. Een zwermintelligentieprocedure, de Grey Wolf Optimizer, verkent vele mogelijke manieren om de dataspace uit te rekken en samen te drukken, waarbij die manieren behouden blijven die de classificatiefouten verminderen en tegelijk wiskundige stabiliteit behouden. Over vele iteraties convergeren de virtuele "wolven" naar een afstandsregel die vergelijkbare punten betrouwbaarder doet clusteren, zelfs in hoog-dimensionale, verwarde datasets.

Zeldzame gevallen een luidere stem geven

De tweede verbetering pakt stemvooroordeel aan. Standaard KNN telt simpelweg hoeveel van de k buren tot elke klasse behoren en kiest de meerderheid. GWKNN weegt in plaats daarvan elke stem naar hoe vaak die klasse in de volledige trainingsdata voorkomt. Klassen die minder vaak voorkomen krijgen sterkere gewichten; zeer frequent voorkomende klassen krijgen zwakkere gewichten. Een kleine gladstrijkterm voorkomt dat extreem zeldzame categorieën de beslissing overweldigen. Op deze manier, als een nieuw datapunt dicht bij enkele voorbeelden uit een minderheidsklasse en veel voorbeelden uit de meerderheidsklasse ligt, worden de signalen van de minderheid niet automatisch overstemd. Het schema is eenvoudig te berekenen maar heeft een krachtig effect: het dwingt de classifier om meer aandacht te besteden aan zeldzame maar betekenisvolle patronen, wat de eerlijkheid en recall voor minderheidsklassen verbetert.

De nieuwe methode op de proef stellen

Om te onderzoeken of GWKNN in de praktijk echt helpt, evalueerden de auteurs het op 12 benchmarkdatasets uit de bekende UCI-repository. Deze verzamelingen bestrijken financiële gegevens, medische metingen, handschrift, plantzaden en verschillende hoog-dimensionale kanker- en genexpressie-datasets, met zowel twee-klasse als multi-klasse problemen. Ze vergeleken vier versies van KNN: de eenvoudige baseline, een versie met alleen de nieuwe afstandsmetriek, een versie met alleen de nieuwe stemgewichten, en de volledige GWKNN die beide ideeën combineert. Ze zetten GWKNN ook af tegen zeven veelgebruikte classifiers, waaronder support vector machines, beslisbomen, random forests, logistieke regressie, naive Bayes en een neuraal netwerk. Over herhaalde train–test-splits hielden ze niet alleen gemiddelde nauwkeurigheid bij, maar ook hoe sterk de resultaten fluctueerden.

Resultaten: nauwkeuriger en consistenter

De gecombineerde GWKNN-aanpak eindigde op de meeste datasets bovenaan of gedeeld bovenaan wat betreft prestaties, vooral bij datasets met veel kenmerken en ongelijke klassegroottes. Bij relatief eenvoudige taken presteerden alle methoden goed en waren de winstpunten bescheiden, maar GWKNN wist toch meestal de nauwkeurigheid licht te verbeteren en de variabiliteit te verminderen. Bij moeilijkere genexpressie-datasets met duizenden kenmerken waren de voordelen duidelijker: de aangeleerde afstandsmetriek hielp het algoritme meer betekenisvolle buurten te vormen en het gewogen stemmen verbeterde de herkenning van ondervertegenwoordigde klassen. Statistische tests over alle datasets bevestigden dat de rangschikking van GWKNN significant beter was dan die van standaard KNN en sommige klassieke modellen, wat aangeeft dat de verbeteringen geen toevallige fluctuaties zijn maar robuust over verschillende gegevenscondities.

Wat dit betekent voor alledaagse gegevensbeslissingen

Voor niet-specialisten is de kernboodschap dat GWKNN een zeer intuïtief idee — "kijk naar vergelijkbare eerdere gevallen" — verfijnt om beter aan te sluiten bij de rommelige realiteit van moderne data. Door te leren hoe gelijkenis data-gedreven te meten en door de invloed van zeldzame categorieën tijdens het stemmen te versterken, streeft de methode ernaar zowel nauwkeuriger als rechtvaardiger te zijn. Hoewel deze extra verfijning gepaard gaat met hogere rekenkosten, vooral voor zeer grote en hoog-dimensionale datasets, toont GWKNN veelbelovende toepassingen voor taken waarbij correcte classificatie van minderheidscases echt telt, zoals vroege ziekte-detectie of fraudeopsporing. Het werk laat zien hoe klassieke algoritmen kunnen worden verbeterd met inzichten uit optimalisatie en eerlijkheid om gelijke tred te houden met de schaal en complexiteit van hedendaagse informatie.

Bronvermelding: Guo, Z., Liu, G., Liu, W. et al. GWKNN: an enhanced k-nearest neighbor algorithm with G metric reconstruction and Grey Wolf Optimizer. Sci Rep 16, 8857 (2026). https://doi.org/10.1038/s41598-026-41851-2

Trefwoorden: k-nearest neighbors, afstandsmatriс learning, klasse-imbalance, zwermintelligentie, gegevensclassificatie