Clear Sky Science · nl

Stochastisch Poisson-ingebed kader voor privacy bij gefedereerd leren met veilige homomorfe encryptie in medische AI

Patiëntgegevens veilig houden terwijl machines leren

Ziekenhuizen verzamelen grote aantallen röntgenbeelden die artsen kunnen helpen ziektes zoals COVID-19 eerder en nauwkeuriger te herkennen. Die beelden zijn echter ook zeer persoonlijk, en strikte privacyregels bemoeilijken het samenbrengen van gegevens op één plek om krachtige kunstmatige intelligentie (AI)-tools te trainen. Deze studie laat een methode zien waarmee ziekenhuizen kunnen samenwerken aan een gedeeld röntgendiagnosesysteem zonder ooit hun ruwe beelden aan anderen te overhandigen, met als doel patiëntgegevens te beschermen terwijl toch topnauwkeurigheid wordt bereikt.

Waarom het delen van medische gegevens zo moeilijk is

Moderne AI floreert op grote, gevarieerde datasets, maar ziekenhuizen bewaren beelden meestal lokaal en zijn terughoudend — of wettelijk verhinderd — om ze naar een centrale server te sturen. Traditionele benaderingen waarbij alle data in één grote database worden gekopieerd, lopen het risico op lekken en cyberaanvallen, ondermijnen het publieke vertrouwen en schenden regelgeving. Zelfs nieuwere methoden waarin ziekenhuizen gezamenlijk een model trainen in een opzet die "gefedereerd leren" wordt genoemd, zijn niet volledig veilig: slimme aanvallers kunnen soms uit modelupdates terugrekenen hoe patiëntbeelden eruitzagen. Tegelijkertijd zijn medische gegevens vaak ongelijk verdeeld en rommelig, waarbij sommige ziekenhuizen veel meer gevallen van een bepaalde aandoening hebben dan andere, wat het trainen kan destabiliseren en de betrouwbaarheid kan verminderen.

Een samenwerkend netwerk dat nooit ruwe röntgenfoto’s deelt

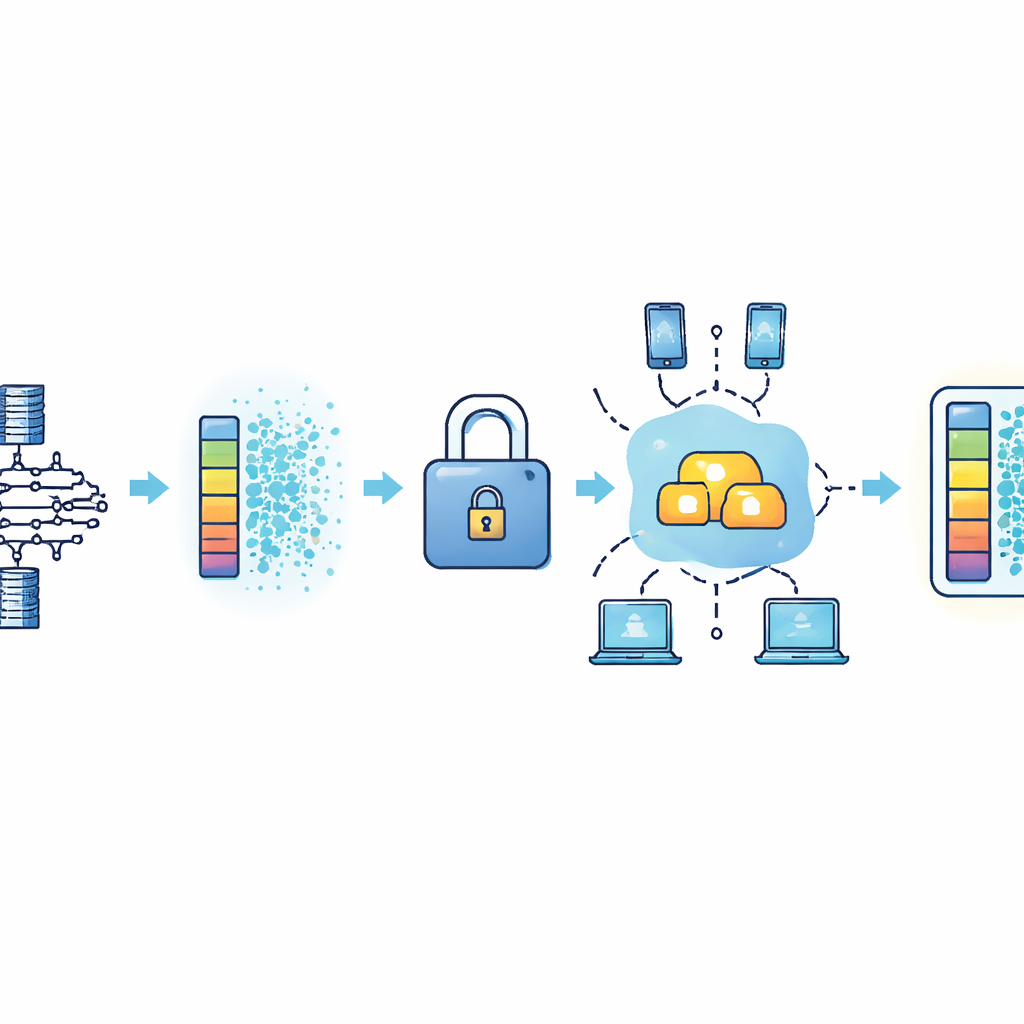

De auteurs ontwerpen een gefedereerd leerraamwerk rond een sterk beeldherkenningsmodel, bekend als ResNet-50, om COVID-19 te onderscheiden van normale thoraxröntgenfoto’s. Elk ziekenhuis traint een eigen kopie van dit model op zijn lokale beelden en houdt alle röntgenfoto’s op locatie. In plaats van plaatjes te verzenden, sturen ziekenhuizen alleen numerieke updates die beschrijven hoe hun lokale model moet veranderen. Een centrale server gemiddeld deze updates om een verbeterd globaal model te vormen en stuurt het verfijnde model vervolgens terug naar elk ziekenhuis. Door deze cyclus te herhalen profiteert het gedeelde model van de gecombineerde ervaring van alle deelnemers zonder individuele scans bloot te leggen.

Digitale "ruis" en sloten voor extra privacy

Om te voorkomen dat aanvallers patiëntbeelden reconstrueren uit modelupdates, legt het raamwerk twee privacytechnieken over gefedereerd leren heen. Ten eerste voegt elk ziekenhuis zorgvuldig gekalibreerde willekeurige ruis toe aan zijn modelupdates, een beetje zoals het toevoegen van statische ruis aan een radiosignaal zodat individuele stemmen moeilijker te onderscheiden zijn terwijl de algemene boodschap nog steeds doorkomt. Ten tweede worden updates voordat ze over het netwerk reizen versleuteld met een methode die de server toestaat ze op te tellen terwijl ze versleuteld blijven — vergelijkbaar met het optellen van waarden in verzegelde enveloppen. Alleen een vertrouwde sleutelhouder kan het gecombineerde resultaat ontsluiten, en de centrale server ziet geen enkele individuele update in onversleutelde vorm. Gezamenlijk zijn deze stappen bedoeld om pogingen tot het terugrekenen van patiëntgegevens te frustreren terwijl de bruikbaarheid van het gedeelde model behouden blijft.

Het systeem aan de tand voelen

Het team evalueert hun raamwerk op een gebalanceerde set van COVID-19 en normale thoraxröntgenfoto’s en simuleert meerdere ziekenhuizen als afzonderlijke trainingslocaties. Ze vergelijken drie opstellingen: klassieke gecentraliseerde training met alle data samengevoegd, standaard gefedereerd leren zonder extra beschermingen, en hun privacy-versterkte benadering. Ondanks de toegevoegde ruis en encryptie bereikt het beschermde systeem opvallend hoge scores — ongeveer 99,6% nauwkeurigheid, met vergelijkbaar sterke precisie-, recall- en F1-waarden — en evenaart of overtreft daarmee zowel de samengevoegde als de onbeveiligde gefedereerde versies. Metingen van communicatie-ronden, trainingsverlies en rekentijd laten zien dat de nauwkeurigheid gestaag verbetert naarmate de sites samenwerken, terwijl de extra tijdskosten door encryptie beperkt blijven. Ablatie-experimenten, waarbij delen van het systeem aan- en uitgezet worden, bevestigen dat de gekozen ruisniveaus en de combinatie van encryptie en compressie sterke privacy bieden met slechts geringe prestatie-invloeden.

Wat dit betekent voor toekomstige zorg

Voor niet-experts is de kernboodschap dat dit werk een praktisch recept laat zien om AI te trainen met röntgenbeelden van vele ziekenhuizen zonder ooit ruwe beelden bloot te leggen of privacywetgeving te verzwakken. Door een hoogpresterend beeldmodel te combineren met digitale "ruis" en versleutelde aggregatie, toont het raamwerk dat ziekenhuizen gezamenlijk nauwkeurige diagnostische hulpmiddelen kunnen bouwen terwijl patiëntendossiers lokaal blijven en buiten het bereik van nieuwsgierige blikken. Hoewel getest op een relatief kleine dataset en gericht op COVID-19-röntgenfoto’s, zouden dezelfde ideeën zich kunnen uitstrekken tot andere ziekten, beeldvormende modaliteiten en zelfs andere gevoelige gebieden zoals financiën. Kortom, de studie wijst op een toekomst waarin krachtige AI en sterke medische privacy elkaar kunnen versterken in plaats van tegenwerken.

Bronvermelding: Gomathi, R., Saranya, K., Mahaboob John, Y.M. et al. Stochastic Poisson-embedded privacy framework for federated learning with secure homomorphic encryption in medical AI. Sci Rep 16, 10931 (2026). https://doi.org/10.1038/s41598-026-41469-4

Trefwoorden: gefedereerd leren, medische beeldvorming, gegevensprivacy, homomorfe encryptie, röntgendiagnostiek