Clear Sky Science · nl

Menselijke versus kunstmatige intelligentie bij diagnose in de orale pathologie: een vergelijkende studie van ChatGPT, Grok en MANUS

Waarom dit belangrijk is voor uw volgende tandartsbezoek

Wanneer een tandarts een verdachte plek in uw mond ontdekt, komt het eindoordeel over onschadelijkheid of gevaar meestal van een specialist die weefsel onder de microscoop bestudeert. Dit werk is zorgvuldig, tijdrovend en in veel delen van de wereld zijn er onvoldoende experts. Deze studie stelt een actuele vraag: kunnen moderne systemen voor kunstmatige intelligentie deze microscopische beelden van mondweefsel met een nauwkeurigheid analyseren die dicht bij die van menselijke specialisten ligt, waardoor diagnose sneller, consistenter en breder beschikbaar zou kunnen worden?

Wat de onderzoekers wilden testen

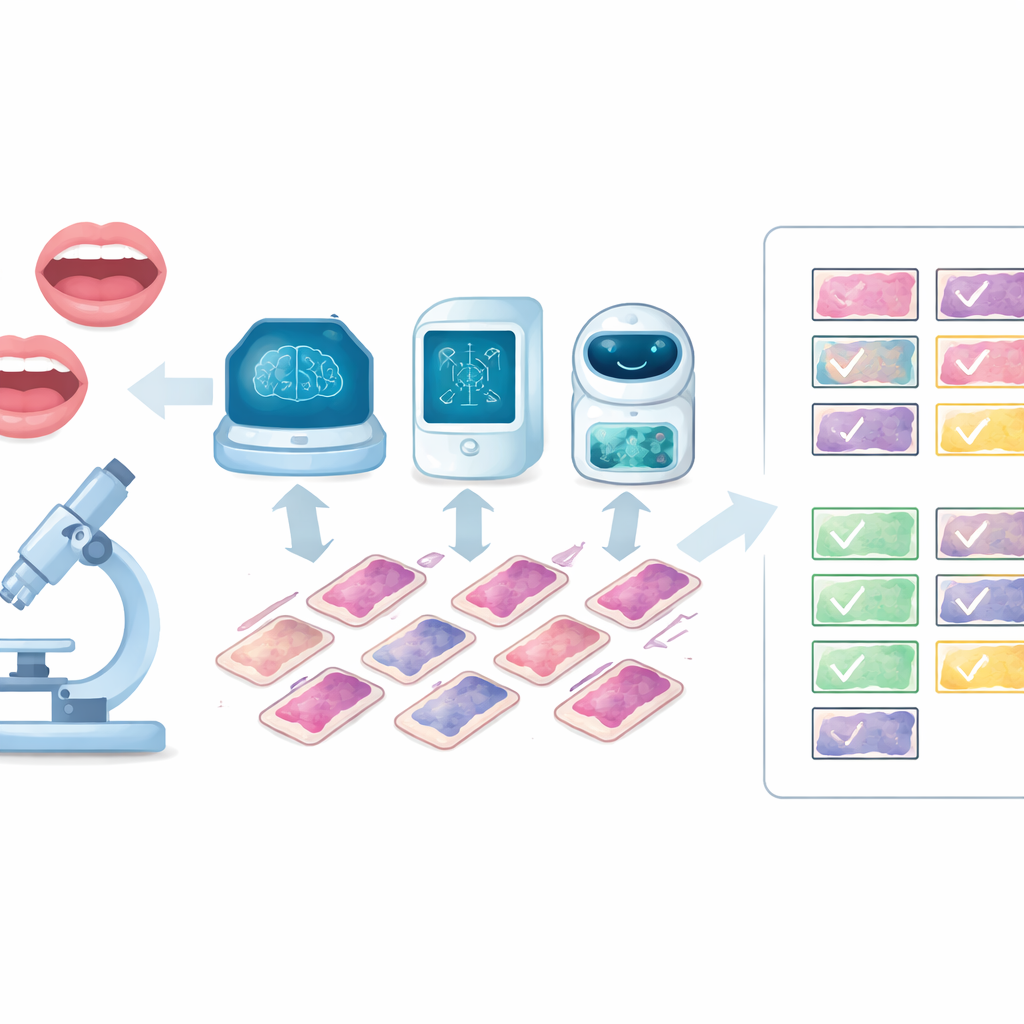

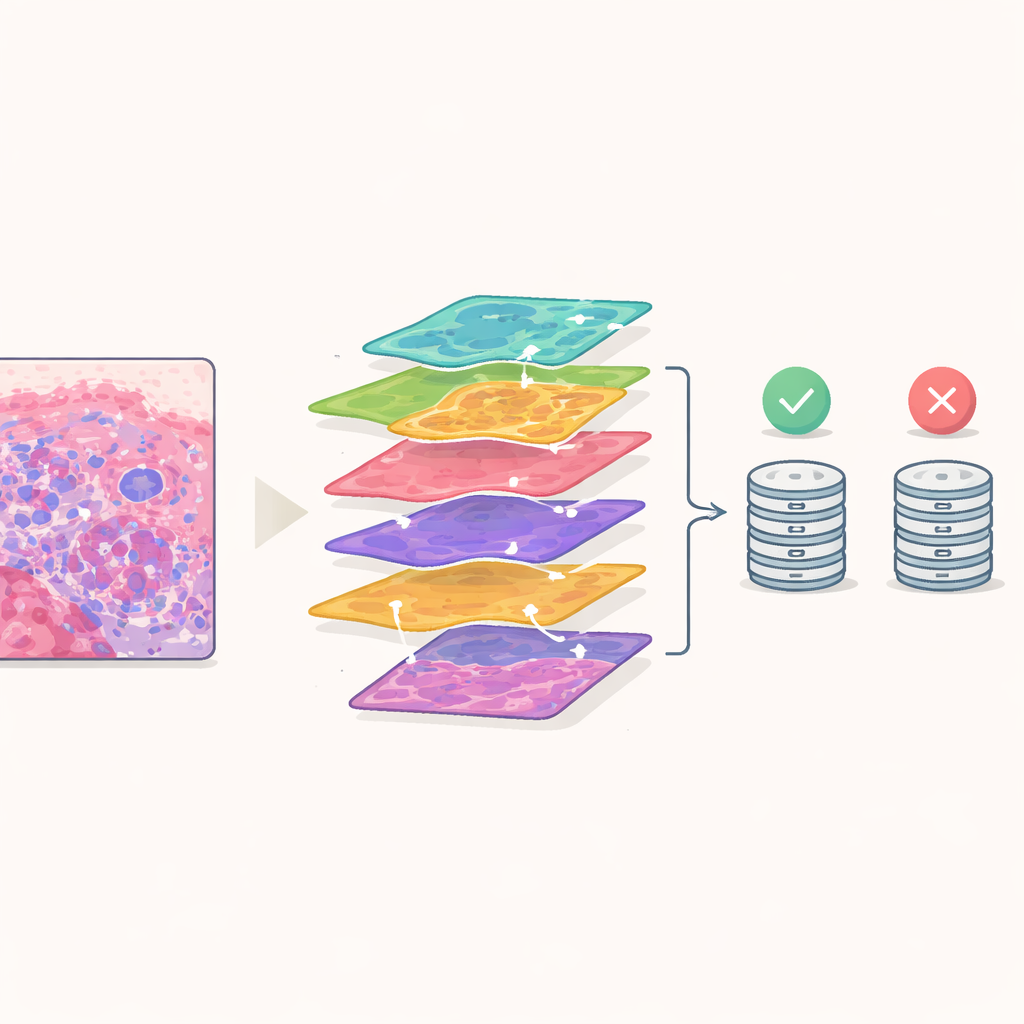

Het team richtte zich op drie geavanceerde computerprogramma’s die bekendstaan om hun begrip van zowel afbeeldingen als taal: ChatGPT, Grok en een medisch systeem genaamd MANUS. In plaats van echte patiëntgegevens gebruikten zij 100 duidelijke, hoogwaardige microscoopbeelden uit een standaard leerboek over orale aandoeningen. Elke afbeelding toonde een ander type afwijking, variërend van vroege precancereuze veranderingen tot tumoren, cysten en reactieve groei. Twee ervaren orale pathologen kwamen eerst overeen wat de juiste diagnose voor elke slide was, waarmee een sterk menselijk referentiepunt werd gecreëerd om de machines mee te vergelijken.

Hoe de directe vergelijking werkte

Elke van de 100 slides werd aan alle drie de AI-systemen getoond met hetzelfde korte bericht waarin de casus werd beschreven en met dezelfde digitale afbeelding. De modellen werden gevraagd de enige meest waarschijnlijke diagnose te noemen, net zoals een specialist zou doen bij het opstellen van een rapport. Om te zien of de systemen stabiele antwoorden gaven in de tijd, herhaalden de onderzoekers het hele proces twee weken later met dezelfde slides en instructies. Ondertussen lazen de twee menselijke pathologen de slides onafhankelijk van elkaar zonder de AI-uitkomsten te zien, en bespraken ze eventuele verschillen totdat ze het eens werden over een definitieve beslissing. Deze deskundige beslissingen werden behandeld als het best beschikbare antwoord.

Hoe goed de machines en mensen presteerden

Alle drie de AI-hulpmiddelen presteerden opvallend goed. In de tweede testronde identificeerde Grok 97 van de 100 gevallen correct, MANUS 96 en ChatGPT 94. Het tweetal menselijke specialisten scoorde iets hoger en classificeerde 98 slides correct. ChatGPT viel op doordat het vrijwel identieke antwoorden gaf in beide rondes, wat wijst op zeer sterke interne consistentie, terwijl MANUS en Grok ook solide en stabiele prestaties lieten zien. Wanneer de systemen onderling werden vergeleken, waren ze het in de grote meerderheid van de gevallen eens, wat suggereert dat verschillende AI-ontwerpen toch tot zeer vergelijkbare oordelen kunnen komen wanneer ze dezelfde hoogwaardige beelden krijgen voorgeschoteld.

Hoe nauwkeurig AI overeenkwam met deskundig denken

Het vinden van het juiste antwoord is slechts een deel van het verhaal; het doet er ook toe of de computers geneigd zijn menselijk redeneergedrag te volgen. Hier toonde MANUS de grootste overeenstemming met de beslissingen van de pathologen, zelfs wanneer het niet beter presteerde dan Grok qua ruwe nauwkeurigheid. Grok, hoewel iets nauwkeuriger in het algemeen, kwam in enkele moeilijke gevallen soms tot andere keuzes dan de experts. De meeste fouten van alle drie systemen ontstonden in slides die visueel verwarrend waren, zelfs voor getrainde ogen, waar weefselveranderingen overlappen of grensgevallen tussen twee aandoeningen vertonen. Toch waren er geen grote prestatieverschillen tussen de modellen, en toonden alle drie niveaus van overeenstemming met mensen die de auteurs omschrijven als matig tot substantieel.

Wat dit zou kunnen betekenen voor toekomstige zorg

De studie suggereert dat de multimodale AI-systemen van vandaag al in staat zijn te fungeren als betrouwbare hulp bij de microscopische diagnose van orale aandoeningen. Ze vervangen pathologen niet — die nog steeds de beste algehele nauwkeurigheid hebben en essentieel klinisch oordeel leveren — maar ze zouden kunnen optreden als snelle second readers, ondersteuning bieden bij de opleiding van nieuwe specialisten of deskundige hulp verlenen in gebieden met beperkte toegang tot dentale pathologiediensten. Omdat het onderzoek zorgvuldig gekozen leerboekafbeeldingen gebruikte in plaats van rommelige praktijkvoorbeelden, benadrukken de auteurs dat meer tests nodig zijn op grotere, gevarieerdere klinische verzamelingen en met aanvullende patiëntinformatie. Als deze vervolgcontroles de vroege belofte bevestigen, kan AI diagnose van mondziekten nauwkeuriger, consistenter en toegankelijker maken voor patiënten overal.

Bronvermelding: Alshammari, A.F., Madfa, A.A. & Anazi, B.A. Human versus artificial intelligence in oral pathology diagnosis: a comparative study of ChatGPT, Grok, and MANUS. Sci Rep 16, 11057 (2026). https://doi.org/10.1038/s41598-026-40792-0

Trefwoorden: orale pathologie, digitale pathologie, kunstmatige intelligentie, grote taalmodellen, histopathologie diagnose