Clear Sky Science · nl

Beoordeling van AI-taalmodellen bij het beantwoorden van zwangerschapsvragen, geëvalueerd door verloskundespecialisten

Waarom dit belangrijk is voor aanstaande ouders

Zwangerschap roept veel vragen op, en steeds meer mensen zoeken online tools en chatbots voor snelle antwoorden. Deze studie stelde een eenvoudige maar belangrijke vraag: hoe goed zijn de huidige populaire kunstmatige-intelligentie (AI) chatbots bij het geven van duidelijke, accurate en geruststellende informatie over veelvoorkomende zwangerschapszorgen—informatie die artsen zouden vertrouwen?

Vergelijking van drie digitale “antwoordmachines”

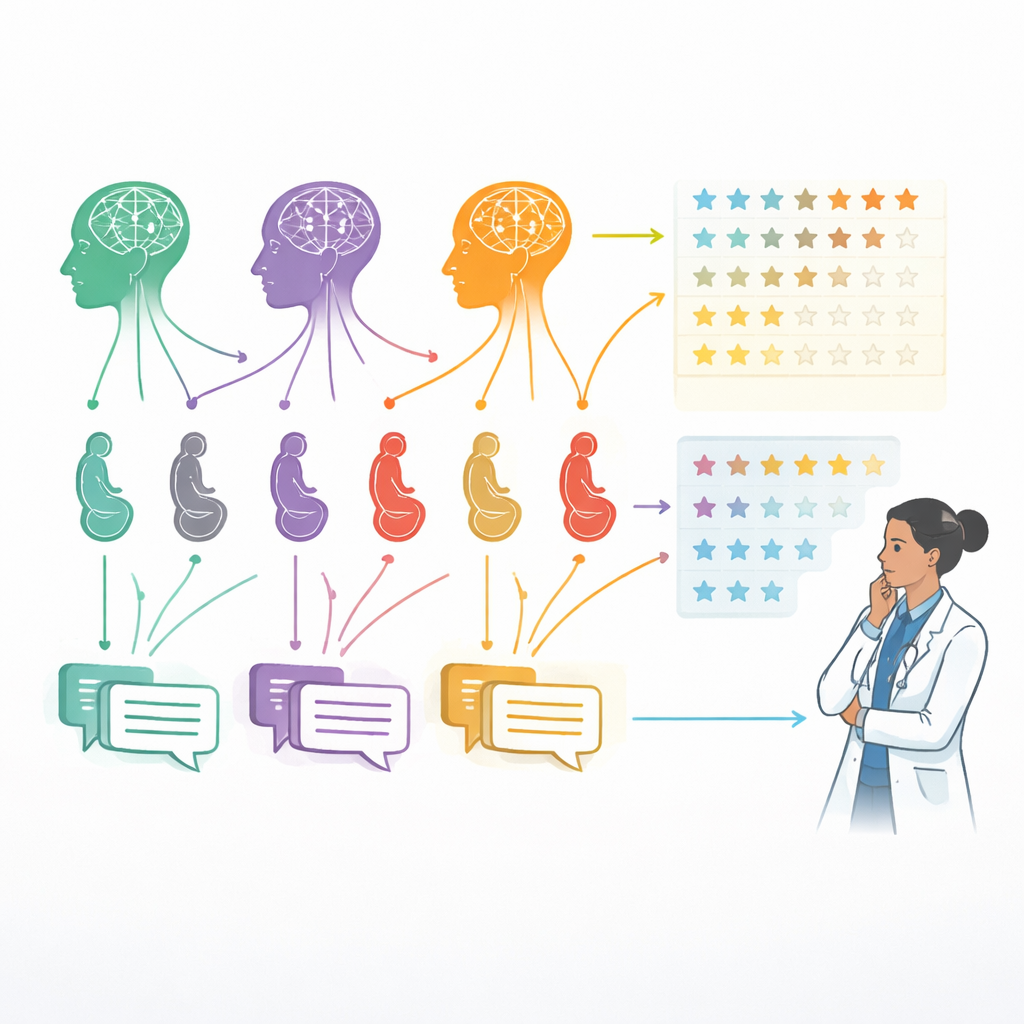

Onderzoekers in Turkije vergeleken drie bekende AI-taalmodellen—een eerdere versie van ChatGPT (3.5), een nieuwere versie (4.0) en Google’s Gemini. Ze richtten zich op tien alledaagse vragen die zwangere personen vaak stellen, zoals welke voedingsmiddelen te vermijden, of beweging en seks veilig zijn, wat vroeg bloedverlies kan betekenen, hoe je bewegingen van de foetus moet interpreteren en welke waarschuwingssignalen directe zorg vereisen. Elke vraag werd met dezelfde eenvoudige instructies in alle drie de systemen ingevoerd, met instellingen om willekeur te verminderen zodat de antwoorden consequent waren in plaats van uitgesproken chatty of creatief.

Elk model genereerde één antwoord per vraag, in het Turks, zonder vervolgprompts of bewerking. De reacties werden vervolgens ontdaan van aanwijzingen die konden verraden welk systeem ze had geschreven en in willekeurige volgorde geschud. Op die manier beoordeelden de menselijke beoordelaars—specialisten in verloskunde en gynaecologie—uitsluitend wat op de pagina stond, niet het merk of de schrijfstijl waarvan ze dachten dat ze die herkenden.

Hoe artsen de antwoorden beoordeelden

Vijfenzeventig verloskundig specialisten, variërend van artsen in de beginfase tot zeer ervaren clinici, beoordeelden alle 30 geanonimiseerde antwoorden. Voor elk antwoord gebruikten zij een vijfpuntschaal om vier eigenschappen te scoren: nauwkeurigheid (komt het overeen met actuele medische kennis en richtlijnen?), betrouwbaarheid (is de boodschap intern consistent en vrij van onveilige adviezen?), patiëntvriendelijkheid (is de toon geschikt en geruststellend voor leken?) en begrijpelijkheid (is de taal helder, goed gestructureerd en makkelijk te volgen?). In totaal leverden de experts 9.000 individuele beoordelingen—een grote dataset waarmee de onderzoekers betekenisvolle verschillen tussen de drie AI-tools konden opsporen.

Het team gebruikte vervolgens statistische methoden die zijn ontworpen voor beoordelingsschalen om de modellen te vergelijken. Ze controleerden ook hoe consistent verschillende artsen dezelfde antwoorden beoordeelden en onderzochten of meer ervaren clinici anders scoorden dan hun jongere collega’s. Het doel was niet om een werkende chatbot te bouwen, maar om onder gecontroleerde omstandigheden een zorgvuldige momentopname te maken van hoe deze systemen reageren op realistische zwangerschapsvragen.

Welk chatbot presteerde het beste?

Over het geheel genomen kwam het nieuwere ChatGPT-4.0 als winnaar uit de bus. Artsen beoordeelden de antwoorden als het meest nauwkeurig en het meest patiëntvriendelijk, en het presteerde ook het beste op betrouwbaarheid. Gemini bevond zich over het algemeen in het midden: de antwoorden waren vaak duidelijk en makkelijk leesbaar, en qua begrijpelijkheid vergelijkbaar met ChatGPT-4.0, maar ze waren doorgaans iets minder gedetailleerd en precies. ChatGPT-3.5, het oudere model, kreeg consequent de laagste scores en gaf vaak kortere of minder volledige uitleg. Interessant genoeg leken alle drie de modellen op het gebied van basishelderheid en structuur meer op elkaar, wat suggereert dat teksten leesbaar maken makkelijker kan zijn dan ervoor zorgen dat elk medisch detail correct en goed afgewogen is.

De beoordelingen van de artsen waren sterk consistent met elkaar, wat aangeeft dat de resultaten niet door enkele uitschieters werden gedomineerd. Er was een bescheiden trend dat meer ervaren clinici iets hogere betrouwbaarheidscores gaven, maar hun mening verschilde weinig over hoe vriendelijk of makkelijk te begrijpen de antwoorden waren.

Wat dit betekent voor gebruik in de praktijk

Voor leken is de conclusie dat moderne AI-tools—vooral ChatGPT-4.0—al zwangerschapsinformatie kunnen bieden die veel verloskundig specialisten als redelijk accuraat, veilig en leesbaar beschouwen. Dat gezegd hebbende benadrukt de studie ook een belangrijke beperking: zelfs het best presterende systeem is geen arts. De onderzoekers vergeleken de chatbotantwoorden niet met officiële richtlijn-"gouden standaarden", en ze testten ook niet hoe patiënten de adviezen daadwerkelijk interpreteren of opvolgen. Omdat het werk volledig in het Turks werd uitgevoerd, kan de prestatie in andere talen en culturen verschillen.

Noch in eenvoudige termen: deze AI-chatbots kunnen nuttige hulpmiddelen zijn om over zwangerschap te leren, vooral wanneer een bezoek aan de kliniek ver weg is of de tijd bij een zorgverlener beperkt is. Ze kunnen gesprekken ondersteunen, maar mogen geen vervanging zijn voor overleg met zorgprofessionals. De auteurs benadrukken dat deskundig toezicht essentieel blijft om fouten te ontdekken, valse geruststelling te vermijden en ervoor te zorgen dat genuanceerde of risicovolle situaties de persoonlijke, face-to-face zorg krijgen die ze vereisen.

Bronvermelding: Keyif, B., Yurtçu, E., Başbuğ, A. et al. Evaluation of AI language models in answering pregnancy-related questions assessed by obstetrics specialists. Sci Rep 16, 9322 (2026). https://doi.org/10.1038/s41598-026-40609-0

Trefwoorden: zwangerschapsvoorlichting, AI-chatbots, online medisch advies, verloskunde, kwaliteit van patiëntinformatie