Clear Sky Science · nl

Verklaarbare AI in het onderwijs: integratie van domeinkennis uit het onderwijs in het deep learning-model voor betere voorspelling van leerlingprestaties

Waarom slimmere voorspellingen over leerlingen ertoe doen

Scholen zetten steeds vaker kunstmatige intelligentie in om te ontdekken welke leerlingen mogelijk moeite hebben en wie extra ondersteuning nodig heeft. Maar wanneer die systemen functioneren als gesloten zwarte dozen, kunnen ze vreemde patronen laten zien — bijvoorbeeld suggereren dat iemands liefdesleven zwaarder weegt dan studietijd — waardoor leraren en ouders onzeker worden over de betrouwbaarheid van de uitkomsten. Dit artikel laat zien hoe je een systeem voor het voorspellen van leerlingprestaties bouwt dat niet alleen betere voorspellingen van wiskundecijfers maakt, maar ook op manieren "redeneert" die passen bij wat tientallen jaren onderwijsonderzoek ons al leren.

Van ruwe data naar risicomeldingen

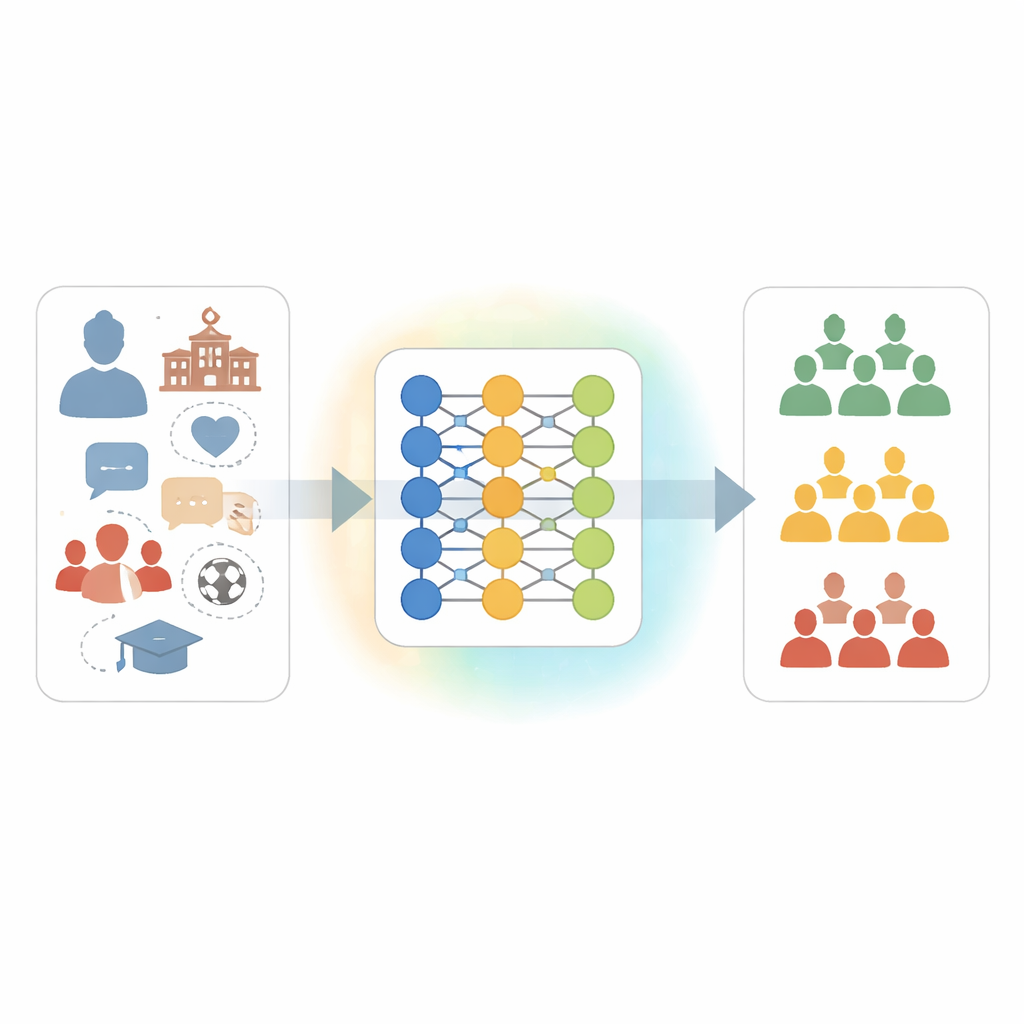

De onderzoekers werkten met een bekende openbare dataset van 395 Portugese middelbare scholieren, elk beschreven door 30 gegevenspunten. Deze varieerden van basisdemografie (leeftijd, geslacht, gezinsgrootte) tot schoolgerelateerde details (studietijd, verzuim, bijlessen) en aspecten van sociaal leven en welzijn (familierelaties, vrije tijd, uitgaan met vrienden). Het doel was het eindcijfer voor wiskunde van elke leerling te voorspellen en ze vervolgens in drie praktische categorieën in te delen: waarschijnlijk zakken, op schema, of uitmuntend presteren. Een deep learning-model, een zogenaamd artificieel neuraal netwerk (ANN), werd getraind om subtiele patronen over al deze factoren heen op te pikken.

Wanneer de zwarte doos het fout heeft

Hoewel het oorspronkelijke ANN een redelijke nauwkeurigheid behaalde, bracht nader onderzoek iets zorgwekkends aan het licht. Met een moderne verklaringsmethode bekend als SHAP onderzochten de auteurs op welke kenmerken het model het meest vertrouwde. Sommige van de sterkste signalen botsten met goed onderbouwde onderwijsbevindingen. Zo leken de school die een leerling bezocht, hun romantische status en hoe vaak ze uitgingen ongewoon invloedrijk, terwijl door onderzoek ondersteunde factoren zoals de opleiding van ouders, het beroep van de moeder, vroegschoolse opvang, gezinsgrootte en wekelijkse studietijd verrassend weinig gewicht kregen. Deze mismatch suggereerde dat het ANN zich vasthield aan eigenaardigheden van deze specifieke dataset in plaats van aan relaties die onderwijsprofessionals zinvol of rechtvaardig vinden.

Het netwerk leren wat onderwijsprofessionals al weten

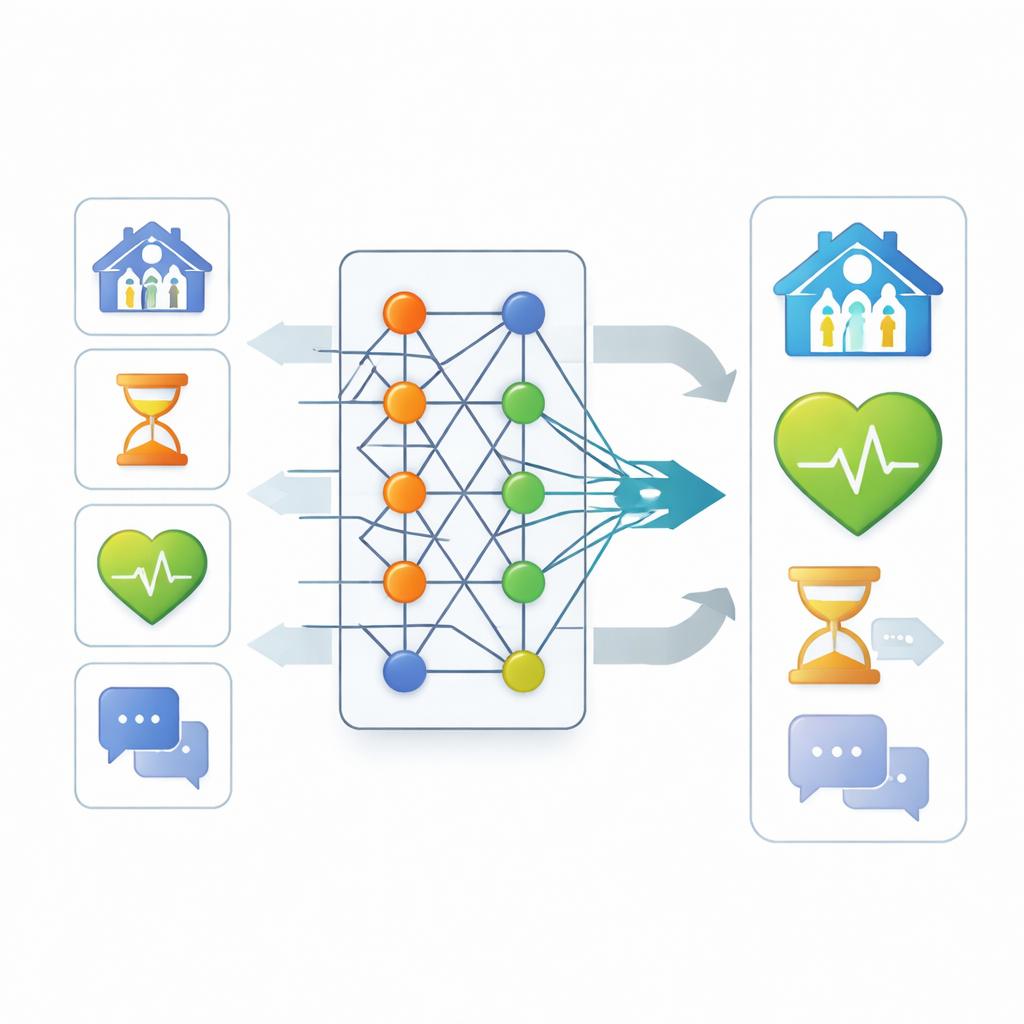

Om het model opnieuw op één lijn te brengen met onderwijsinzichten, stelden de auteurs een nieuwe trainingsstrategie voor, het Students’ Performance Prediction Explanation (SPPE)-algoritme. Eerst doorzochten ze de onderwijsliteratuur om kenmerken grofweg in twee groepen te verdelen: die consistent gekoppeld zijn aan prestaties (zoals studietijd, opleiding van ouders en ambitie voor hoger onderwijs) en die zwakkere of onzekerere voorspellers zijn (zoals romantische status of algemene beoordelingen van familierelaties). Tijdens het trainen stimuleert SPPE het neurale netwerk om meer te leunen op de eerste groep en minder op de tweede. Dat doet het door te monitoren hoeveel elke feature bijdraagt aan voorspellingen en een milde straf toe te voegen telkens wanneer het patroon van geleerde belangrijkheid afwijkt van deze domeinkennis.

Heldere verklaringen en scherpere voorspellingen

Na de SPPE-aanpassingen veranderde het interne redeneergedrag van het model op manieren die beter aansloten bij de verwachtingen van onderwijsprofessionals. Studietijd, de achtergrond van ouders, gezinsgrootte en vroegschoolse воспитание (PK: vroegschoolse opvang) klommen op de ladder van belangrijkheid, terwijl schoolidentiteit, uitgaan en romantische status minder dominant werden. Even belangrijk is dat deze heroriëntatie niet ten koste van de nauwkeurigheid ging — het verbeterde de nauwkeurigheid zelfs. Bij het voorspellen in welke van de drie cijfercategorieën een leerling zou vallen, classificeerde het verbeterde netwerk ongeveer tweederde van de leerlingen correct, vergeleken met iets meer dan een derde bij het oorspronkelijke model. Standaardmaatregelen zoals precision, recall en de gecombineerde F1-score stegen aanzienlijk, en statistische toetsen bevestigden dat de verbeteringen waarschijnlijk niet door toeval verklaard konden worden. De auteurs toonden ook aan dat dezelfde SPPE-strategie verschillende andere ontwerpen van neurale netwerken verbeterde, wat suggereert dat de aanpak robuust is en geen eenmalige truc.

Wat dit betekent voor klaslokalen en AI

Voor onderwijsprofessionals en beleidsmakers biedt de studie een uitweg uit de ongemakkelijke keuze tussen nauwkeurige maar ondoorzichtige modellen en transparante maar zwakkere modellen. Door menselijke expertise in het leerproces zelf te verweven, levert SPPE voorspellingen die zowel betrouwbaarder als gemakkelijker te verantwoorden zijn: tijd besteed aan studeren en langetermijnonderwijsambities wegen zwaarder dan welke school een leerling toevallig bezoekt. Hoewel het werk zich richt op één wiskundedataset uit Portugal, is de bredere boodschap dat verklaarbare, kennisgestuurde AI betere, eerlijkere beslissingen over leerlingondersteuning kan ondersteunen — mits lokale context en deskundig oordeel vanaf het begin worden ingebouwd.

Bronvermelding: Qiang, M., Liu, Z. & Zhang, R. Explainable AI in education: integrating educational domain knowledge into the deep learning model for improved student performance prediction. Sci Rep 16, 9515 (2026). https://doi.org/10.1038/s41598-026-40538-y

Trefwoorden: voorspelling van leerlingprestaties, verklaarbare AI, educational data mining, neurale netwerken in het onderwijs, integratie van domeinkennis