Clear Sky Science · nl

Toewijzing van broncamera met een regelgebaseerd uitlegbaar convolutioneel neuraal netwerk

Waarom je foto’s meer kunnen verraden dan je denkt

Elke foto die je maakt draagt verborgen aanwijzingen over de camera die hem heeft vastgelegd. Voor digitale onderzoekers kunnen die aanwijzingen helpen bevestigen of een afbeelding echt is, achterhalen van welk toestel het afkomstig is, of foto’s over verschillende plaatsdelicten met elkaar te verbinden. Tegenwoordig kunnen krachtige kunstmatige-intelligentie (AI-)hulpmiddelen deze patronen beter herkennen dan mensen—maar ze werken vaak als mysterieuze “zwarte dozen.” Dit artikel presenteert een manier om die doos te openen: een regelgebaseerde methode die uitlegt hoe een deep-learningmodel besluit welke camera een foto heeft gemaakt, in een vorm die een menselijke onderzoeker kan begrijpen en vertrouwen.

De uitdaging om slimme forensische tools te vertrouwen

Moderne digitale forensica moet enorme hoeveelheden data doorzoeken—van smartphones, cloudback-ups en sociale media—ver buiten wat menselijke analisten handmatig kunnen inspecteren. Deep-learning systemen kunnen snel afbeeldingen markeren of aangeven welke relevant zijn, maar hun interne werking is berucht ondoorzichtig. In gevoelige settings zoals rechtszalen is het simpelweg zeggen “het neurale netwerk denkt van wel” niet voldoende. Bestaande uitlegtools benadrukken meestal beeldregio’s die het model belangrijk vond, wat nuttig is voor taken als gezichts- of objectherkenning. Voor broncamera-identificatie is het cruciale signaal echter geen zichtbaar kenmerk maar een zwakke sensorvingerafdruk—subtiele ruispatronen die mensen niet kunnen zien. Daardoor tonen de huidige visuele uitlegtools niet duidelijk waarom een model denkt dat een afbeelding van een bepaalde camera komt, en helpen ze onderzoekers niet om te zien wanneer het model het mis heeft.

Een nieuwe manier om een neuraal netwerk te zien ‘denken’

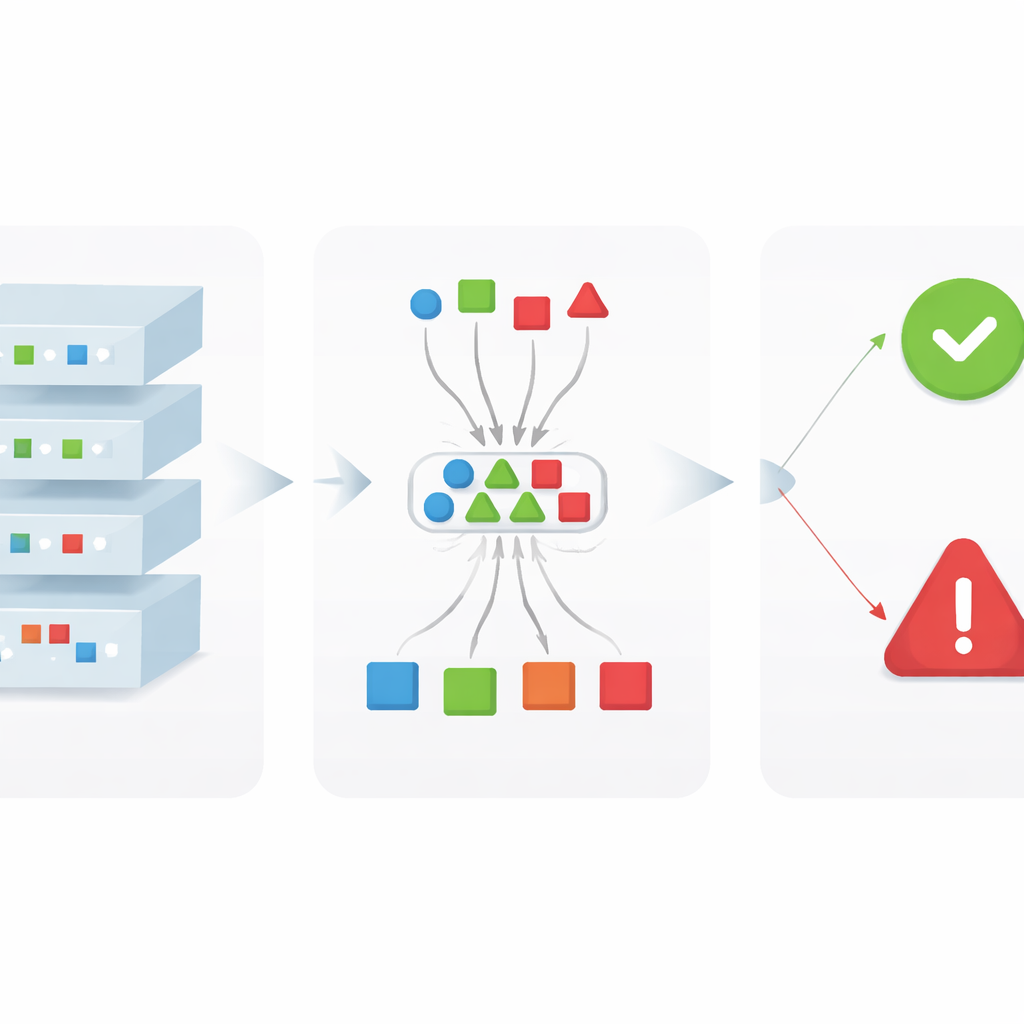

De auteurs introduceren xDFAI, een kader speciaal ontworpen voor digitale forensica dat uitlegt hoe een convolutioneel neuraal netwerk (CNN) tot zijn beslissingen komt zonder het oorspronkelijke model te veranderen. In plaats van het netwerk als één ondoordringbare doos te behandelen, kijkt xDFAI laag voor laag binnenin. Voor elke laag en elke cameraklasse identificeert het een set terugkerende interne patronen, “sporen” genoemd, die consequent oplichten wanneer het model denkt dat een afbeelding bij die camera hoort. Deze sporen worden uit een getraind model geëxtraheerd met bestaande attributiemethoden en vervolgens gefilterd om alleen die patronen te behouden die betrouwbaar verschijnen in veel trainingsafbeeldingen. Samen vormen deze sporen een gestructureerde kaart van hoe aanwijzingen over camera-identiteit zich ontwikkelen terwijl het beeld door het netwerk stroomt.

De lagen laten stemmen en stemmen in regels omzetten

Zodra de sporen bekend zijn, gebruikt xDFAI ze om nieuwe, ongeziene afbeeldingen te onderzoeken. Voor een gegeven testfoto meet het kader hoe gelijk de interne activaties zijn aan de opgeslagen sporen voor elke camera in elke laag. Elke laag brengt in feite stemmen uit voor de cameramodellen waarvan de sporen het meest overeenkomen. Een laag-overschrijdende “meerderheidsstem” vat vervolgens samen hoe sterk het netwerk als geheel elk kandidaat-model ondersteunt. Cruciaal is dat de auteurs deze stem niet gebruiken om de voorspelling van het model te vervangen; in plaats daarvan gebruiken zij hem als controle. Eenvoudige logische regels vergelijken de meerderheidstem met de oorspronkelijke voorspelling: als de voorspelde camera ook sterke steun van veel lagen krijgt, wordt de beslissing bevestigd; als stemmen verspreid zijn of een andere camera bevoordelen, wordt het gedrag als abnormaal gemarkeerd en aan de onderzoeker getoond als een potentiële modelfout.

Het kader op de proef stellen

Om xDFAI te demonstreren passen de auteurs het toe op een zevenlaagse CNN die is getraind om te identificeren welke van 27 cameramodellen een afbeelding heeft gemaakt, met behulp van een bekende forensische dataset. De basis-CNN presteert op zichzelf al zeer goed en classificeert ongeveer 97% van de testafbeeldingen correct. Wanneer de regels van xDFAI bovenop worden toegepast, markeert het systeem automatisch 27 van de 37 foutieve voorspellingen als verdacht. Die gemarkeerde gevallen worden niet langer als zelfverzekerde identificaties meegeteld, waardoor de precisie—het aandeel aanvaarde beslissingen dat daadwerkelijk correct is—stijgt van 97,33% naar 99,2%, terwijl de totale nauwkeurigheid slechts licht daalt. Voor forensisch werk, waar één verkeerde toewijzing ernstige gevolgen kan hebben, is deze afweging zeer wenselijk: minder fout-positieve conclusies onder de besluiten die analisten kiezen te vertrouwen.

Wat dit betekent voor onderzoek in de praktijk

Dit werk laat zien dat het mogelijk is de volledige kracht van een modern deep-learningmodel te behouden en tegelijk mensvriendelijke uitleg toe te voegen die forensische integriteitsregels respecteert—geen hertraining, geen manipulatie van het originele model en geen afhankelijkheid van vage hittekaarten alleen. Door stabiele interne sporen bloot te leggen, ze te aggregëren via een transparant stemschema en het resultaat als eenvoudige regels te presenteren, geeft xDFAI onderzoekers een manier om AI-gegenereerde camera-toewijzingen te bevestigen of in twijfel te trekken. Hoewel de studie zich richt op identificatie van de camerabron, zouden dezelfde ideeën kunnen worden uitgebreid naar andere forensische attributietaken. Op de lange termijn kunnen benaderingen als deze helpen de kloof te overbruggen tussen zeer accurate AI-systemen en het niveau van transparantie en betrouwbaarheid dat in rechtbanken en onderzoekspraktijk vereist is.

Bronvermelding: Nayerifard, T., Amintoosi, H. & Ghaemi Bafghi, A. Source camera attribution using a rule-based explainable convolutional neural network. Sci Rep 16, 9137 (2026). https://doi.org/10.1038/s41598-026-40387-9

Trefwoorden: digitale forensica, uitlegbare AI, camera-identificatie, convolutionele neurale netwerken, beeldforensica