Clear Sky Science · nl

Beeldkleurgeving met diepe transferlearning met VGG19 en CLAHE

Oude foto’s nieuw leven inblazen

Velen van ons hebben dozen met zwart‑wit familiealbums of genieten van klassieke films en vintage documentaires. Zich voorstellen hoe die scènes er in het echt uitzagen — blauwe luchten, groene velden, warme huidtinten — kan het verleden directer en tastbaarder doen aanvoelen. Dit artikel onderzoekt een nieuwe computermethode die automatisch realistische kleuren en aangenaam contrast toevoegt aan grijswaardenbeelden, waardoor het eenvoudiger wordt om oude foto’s te herstellen, zwart‑wit films op te frissen en zelfs medische scans te verbeteren, zonder dat een expert elke tint met de hand hoeft in te vullen.

Van handkleur tot slimme machines

Beeldkleurgeving is lastiger dan het lijkt omdat één grijstint veel verschillende kleuren kan vertegenwoordigen: een middelgrijze toon kan een rode baksteen, een groen blad of een blauw overhemd zijn. Vroegere hulpmiddelen vertrouwden sterk op menselijke aanwijzingen. Kunstenaars konden snel kleurige “krabbels” op delen van een afbeelding zetten, en software verspreidde die aanwijzingen over soortgelijke gebieden. Andere systemen haalden kleuren uit een referentiefoto met vergelijkbare inhoud. Hoewel deze methoden overtuigend konden zijn, faalden ze wanneer de aanwijzingen schaars waren, de referentiefoto geen perfecte match was of de scène complex was. Toen deep learning opkwam, leerden nieuwe programma’s kleuren rechtstreeks te ‘raden’ uit grote verzamelingen voorbeeldfoto’s, waardoor handmatig werk afnam maar de trainingskosten en rekenkracht sterk toenamen.

Een netwerk leren hoe de wereld eruitziet

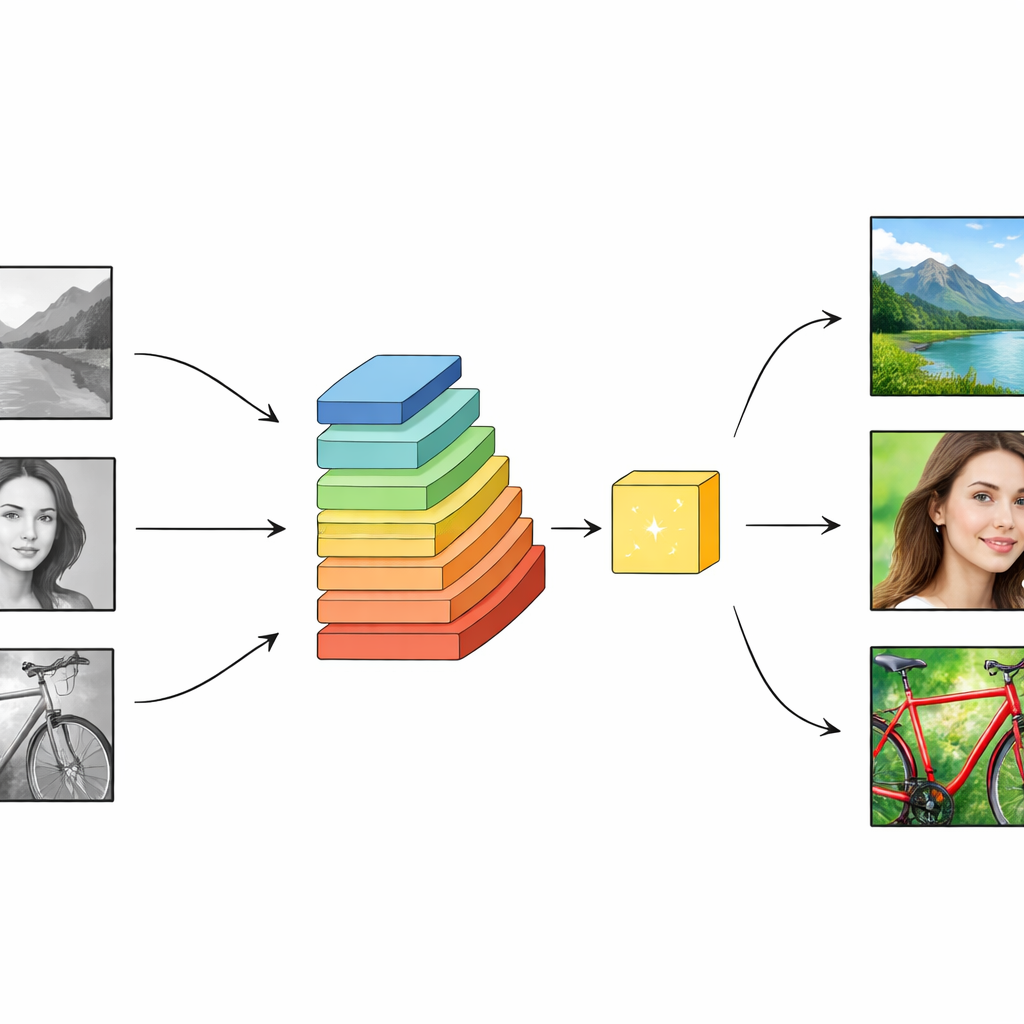

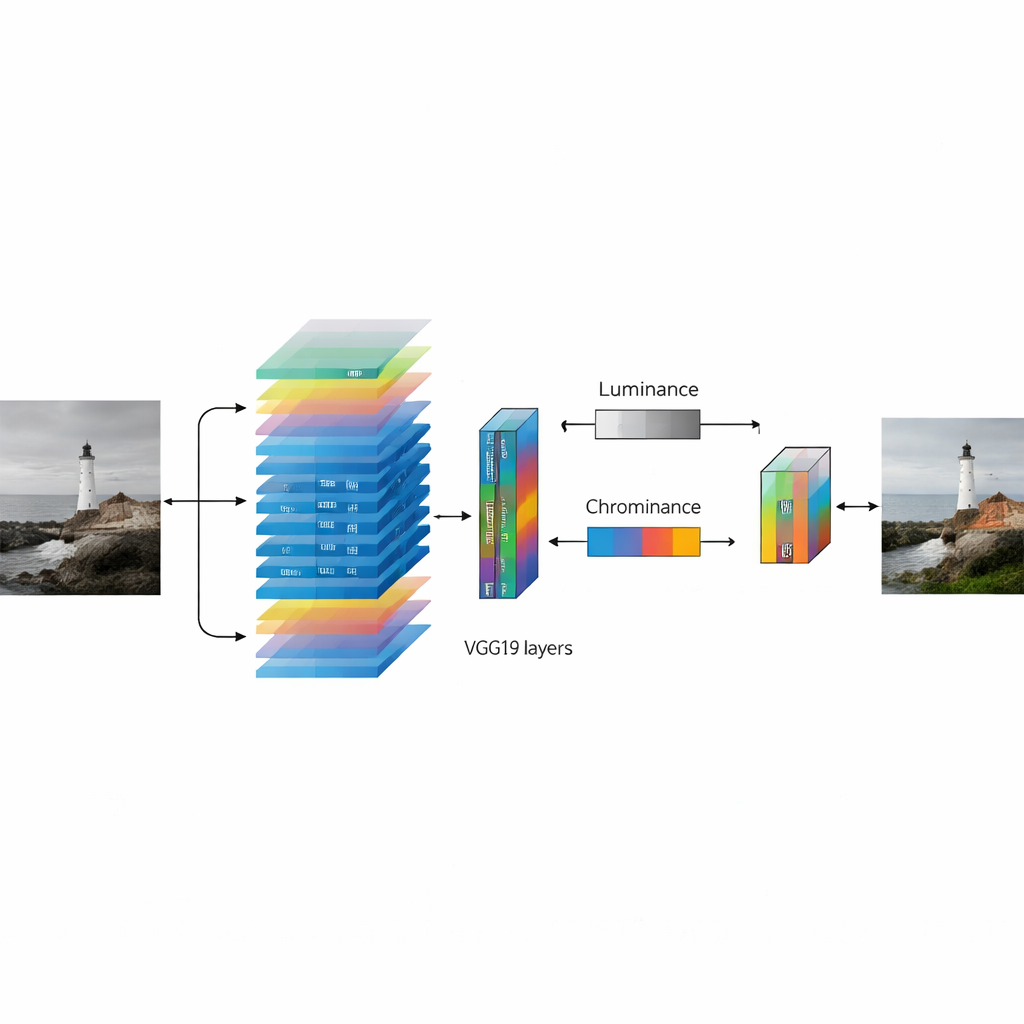

De auteurs bouwen voort op deze vooruitgang met een strategie die transfer learning wordt genoemd. In plaats van een nieuw systeem vanaf nul te trainen, hergebruiken ze een krachtig visienetwerk genaamd VGG19 dat al op miljoenen kleurenfoto’s is getraind. Dit netwerk heeft vele lagen die geleidelijk verschuiven van eenvoudige patronen zoals randen en texturen naar hele objecten en scènes: gezichten, bomen, gebouwen, luchten. Het kleurgevingssysteem voert een grijsversie van een beeld in VGG19 en verzamelt kenmerken uit meerdere lagen tegelijk, waardoor er voor elke pixel een rijke “stapel” aan informatie ontstaat. Dit helpt het model zowel fijne details — zoals haardragende lokken of bladranden — als de bredere context te begrijpen, bijvoorbeeld of de scène een strand, een stadsstraat of een bos is. Met deze context kan het netwerk geloofwaardigere kleuren kiezen, niet alleen wiskundig plausibele.

Licht en schaduw omzetten in kleur en contrast

Om kleurkeuzes stabieler te maken, representeert de methode beelden in een kleurensysteem dat helderheid scheidt van kleurinformatie. De grijswaardeninvoer dient als de helderheids‑ (luminantie) kanaal, terwijl de taak van het netwerk is om de twee resterende kanalen te voorspellen die subtiele verschuivingen tussen rood en groen en tussen blauw en geel coderen. Door de helderheid vast te houden behoudt het systeem de oorspronkelijke belichting en structuur van het beeld. Nadat het netwerk zijn beste schatting van de ontbrekende kleurinformatie heeft geproduceerd, wordt een laatste verbeteringsstap toegepast. Hiervoor gebruiken de auteurs een techniek genaamd adaptieve histogramnormalisatie (CLAHE), die lokaal het bereik tussen donkere en lichte gebieden oprekt. Dit maakt texturen duidelijker, randen scherper en kleuren levendiger, zonder gewoon heldere gebieden uit te laten lezen of details in schaduwen te verliezen.

De methode op de proef stellen

Om te beoordelen hoe goed hun aanpak in de praktijk werkt, trainden en evalueerden de onderzoekers het op verschillende bekende beeldverzamelingen met objecten, scènes, mensen en alledaagse omgevingen. Ze vergeleken hun resultaten met diverse concurrerende methoden, waaronder systemen die door gebruikersaanduidingen werden gestuurd, generatieve modellen die realistische beelden proberen te creëren, en nieuwere transformer‑gebaseerde modellen. Met behulp van standaard maatstaven voor beeldkwaliteit produceerde hun methode consequent scherpere, trouwere kleuren en duidelijkere structuren, met bijzonder sterke prestaties op een uitdagende set landschaps‑ en scènesfoto’s. Visuele vergelijkingen tonen dat hun gekleurde outputs vaak dichter bij de originele kleurenfoto’s liggen, met rijkere maar gecontroleerde verzadiging en beter uitgebalanceerd contrast. Ze wijzen ook op waar de methode moeite mee heeft: zeer donkere of overbelichte beelden, of scènes met ongewone texturen en zeldzame kleuren kunnen nog steeds leiden tot vreemde tinten of ongelijkmatige belichting.

Wat dit betekent voor alledaagse beelden

Simpel gezegd laat deze studie zien dat een kleurgevingssysteem dat een sterke voorkennis over de visuele wereld krijgt — en vervolgens zorgvuldig wordt nabehandeld — beelden kan opleveren die natuurlijker lijken voor het menselijk oog. Door gebruik te maken van een groot, voorgetraind netwerk en een slimme contrastversterkende stap toe te voegen, leveren de auteurs een praktisch hulpmiddel dat historische foto’s nieuw leven kan inblazen, zwart‑wit films kan verrijken en bepaalde medische beelden makkelijker te interpreteren maakt. Hoewel het niet perfect is en kan struikelen bij extreme belichting of zeer ongebruikelijke scènes, brengt deze aanpak geautomatiseerde kleurgeving dichterbij iets waarop niet‑experts kunnen vertrouwen, en maakt realistische kleur binnen bereik voor een breed scala aan alledaagse toepassingen.

Bronvermelding: Ghosh, N., Mandal, G. Deep transfer learning based image colorization using VGG19 and CLAHE. Sci Rep 16, 9528 (2026). https://doi.org/10.1038/s41598-026-40292-1

Trefwoorden: beeldkleurgeving, deep learning, transfer learning, fotorestauratie, contrastverbetering