Clear Sky Science · nl

Een geïntegreerd kader voor proactieve mitigatie van deepfakes via aandachtgestuurde watermerken en blockchain-gebaseerde authenticiteitsverificatie

Waarom vervalste video’s iedereen aangaan

Video’s die er echt uitzien en klinken kunnen nu met kant-en-klare software worden vervalst, waardoor de grens tussen waarheid en fictie online vervaagt. Deze zogenaamde deepfakes worden al gebruikt voor oplichting, intimidatie en politieke trucs. In plaats van te proberen fakes te herkennen nadat ze zich hebben verspreid, stelt deze studie een andere vraag: wat als we echte video’s stilletjes kunnen beschermen op het moment dat ze worden gemaakt, zodat elke latere manipulatie duidelijk wordt?

Van het najagen van fakes naar het beschermen van originelen

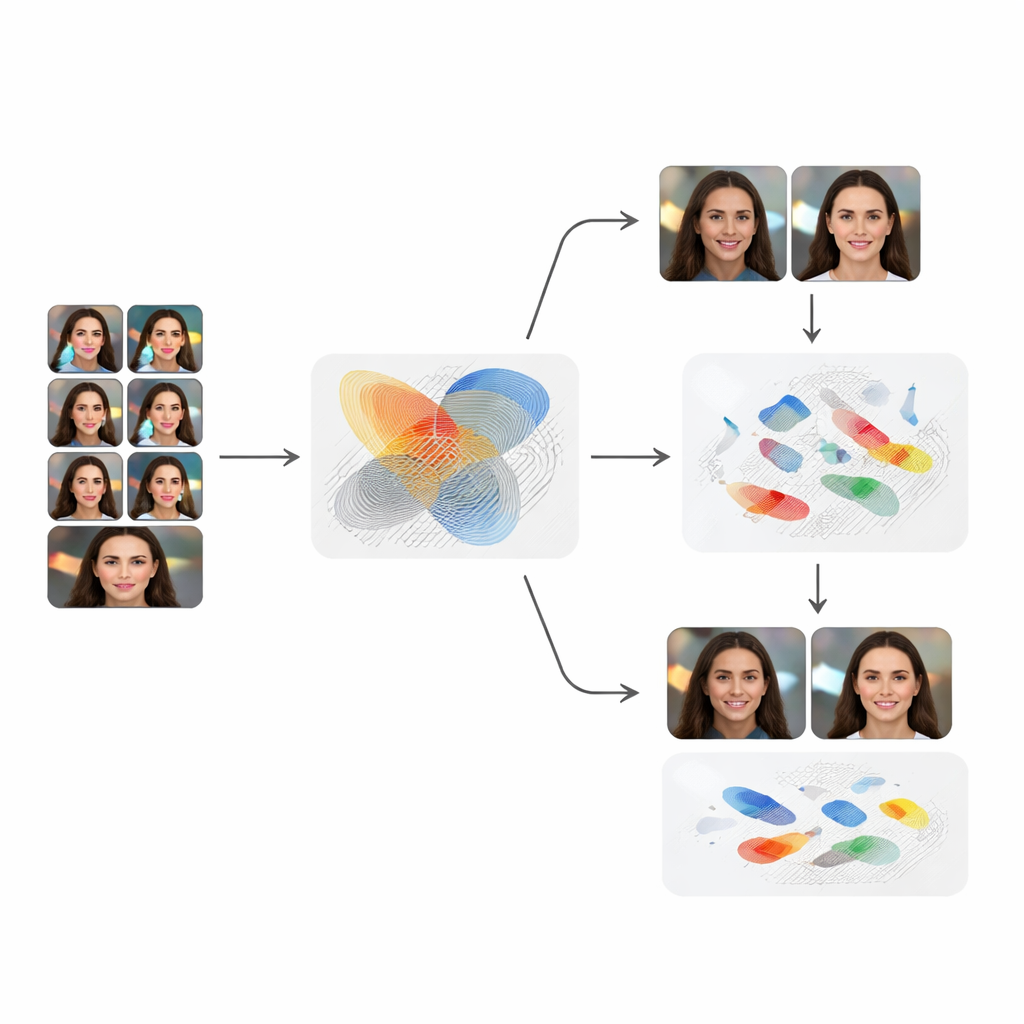

De meeste huidige onderzoeken proberen deepfakes achteraf te vangen, door algoritmes te trainen om kleine foutjes te detecteren die generatieve modellen achterlaten. Maar naarmate die modellen verbeteren, wordt dit kat-en-muisspel steeds moeilijker te winnen. De auteurs pleiten voor een proactieve benadering: bescherm authentiek beeldmateriaal bij opname, zodat kijkers en platforms later kunnen verifiëren of wat ze zien het ongewijzigde origineel is. Hun kader combineert drie lagen: een slimme video-analyse die bepaalt waar bescherming het meest belangrijk is, een onzichtbaar digitaal teken dat in elk frame wordt verweven, en een blockchain-registratie die de identiteit van het bestand als geheel vastlegt.

Het systeem leren wat echt telt in een video

De eerste laag is een aandachtmodel dat leert welke delen van een video over de tijd de meest betekenisvolle beweging en details bevatten. Het team traint een compact maar krachtig netwerk op duizenden alledaagse clips van mensen die handelingen uitvoeren. Een deel van het netwerk bekijkt elk frame als een stilstaande foto, terwijl een ander deel kijkt naar hoe dingen bewegen over segmenten van 16 frames. Samen bereiken ze meer dan 97% nauwkeurigheid op een standaard test voor actieherkenning, wat aantoont dat het systeem rijke patronen heeft geleerd over hoe mensen en scènes in de tijd veranderen. Deze patronen worden vervolgens omgezet in attentiekaarten die regio’s markeren waar elke manipulatie het verhaal dat de video vertelt het meest zou aantasten.

Een geheim merkteken verbergen waar vervalsers het meeste schade aanrichten

Vervolgens wordt een onzichtbaar digitaal merkteken — een watermerk — in elk frame ingebed, maar niet op een eenvoudige, uniforme manier. Een generatief netwerk creëert een subtiel, ruisachtig patroon dat sterker wordt gemengd in regio’s die het aandachtmodel als belangrijk aanwijst, zoals gezichten of bewegende handen, en zwakker elders om de visuele kwaliteit te behouden. Kijkers merken geen verschil en kwaliteitsmetingen bevestigen dat de gemarkeerde frames bijna niet van de originelen te onderscheiden zijn. Toch is het patroon sterk en complex genoeg dat een begeleidend netwerk, getraind als een soort decoder, later de verborgen handtekening uit echt materiaal frame voor frame kan terugvinden.

Deepfakes en alledaagse vervormingen op de proef stellen

Om te kijken of deze bescherming in de praktijk standhoudt, voeren de auteurs een reeks stresstests uit. Ze watermerken eerst een gevarieerde set korte stockvideo’s en voeren die vervolgens in DeepFaceLab, een van de meest gebruikte face-swapping tools, om overtuigende deepfakes te maken. In elk van de 50 gemanipuleerde clips wordt het verborgen merkteken ofwel vernietigd of ernstig verstoord, en het systeem markeert de video correct als gemanipuleerd. De methode houdt ook goed stand tegen veelvoorkomende bewerkingen zoals sterke recompressie, wijzigen van formaat en vervaging die vaak optreden wanneer clips online worden gedeeld, hoewel zeer sterke willekeurige ruis uiteindelijk het verborgen signaal kan overweldigen. Zorgvuldige experimenten tonen aan dat zowel de attentie-aansturing als het gebruik van beweging in de tijd cruciaal zijn; het weghalen van een van beide componenten maakt de bescherming merkbaar zwakker.

Vertrouwen vastleggen met een permanente vingerafdruk

De laatste laag gaat verder dan de inhoud van de frames en beveiligt het videobestand zelf. Na het watermerken wordt het volledige bestand door een cryptografische functie gehaald die een korte digitale vingerafdruk produceert. Die vingerafdruk, samen met basisinformatie over de clip, wordt geschreven naar een blockchain-ledger, waar het niet kan worden gewijzigd zonder een spoor achter te laten. Later kan iedereen een kopie van de video uploaden: het systeem probeert het watermerk te herstellen en berekent ook de vingerafdruk opnieuw. Als zowel het verborgen merkteken als de cryptografische vingerafdruk overeenkomen met de oorspronkelijke gegevens, kan de video met grote zekerheid als authentiek worden beschouwd; als een van beide faalt, weten kijkers dat het beeldmateriaal is aangepast.

Wat dit betekent voor de video’s die je ziet

Kort gezegd toont dit werk aan dat we kunnen verschuiven van raden of een video nep is naar bewijzen dat een video echt is. Door op subtiele wijze een intelligent, moeilijk te vervalsen merkteken in de meest betekenisvolle delen van elk frame te weven en dit te ondersteunen met een onveranderlijke grootboekvermelding, pakt het kader alle geteste face-swap-aanvallen aan en weerstaat het veel alledaagse vervormingen. Hoewel het nog steeds moeite heeft met extreme visuele ruis en breder testen nodig is, wijst het op een toekomst waarin camera’s, platforms en redacties video’s met ingebouwde bewijzen van authenticiteit kunnen leveren — waardoor het veel moeilijker wordt voor deepfakes om als waarheid door te gaan.

Bronvermelding: Hajjej, F., Hamid, M. & Alluhaidan, A.S. An integrated framework for proactive deepfake mitigation via attention-driven watermarking and blockchain-based authenticity verification. Sci Rep 16, 9545 (2026). https://doi.org/10.1038/s41598-026-40166-6

Trefwoorden: deepfake-bescherming, video-authenticiteit, digitale watermerken, blockchain-verificatie, mediasecurity