Clear Sky Science · nl

De impact van generatieve AI op sociale media: een experimentele studie

Waarom dit ertoe doet voor uw online leven

Dagelijks wordt een steeds groter deel van wat we lezen en schrijven op sociale media stilletjes gevormd door kunstmatige intelligentie. Deze studie stelt een vraag die iedereen raakt die iets post, reageert of door feeds scrollt: als AI mensen helpt met schrijven, maakt dat gesprekken beter, of alleen luider? Door een discussieruimte in sociale-mediasfeer na te bouwen met honderden alledaagse gebruikers laten de onderzoekers zien dat AI-tools meer mensen bij het gesprek kunnen trekken — maar die gesprekken ook generieker, minder betrouwbaar en minder menselijk kunnen doen aanvoelen.

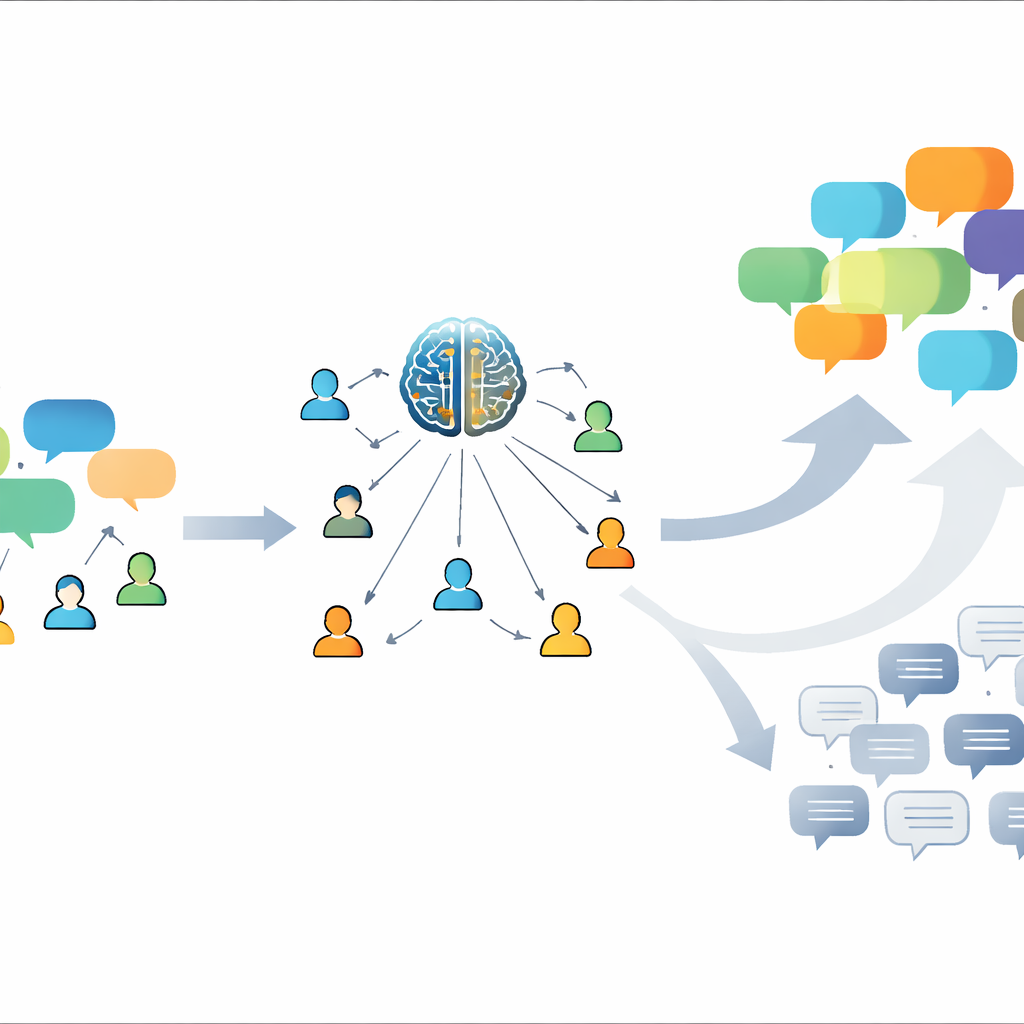

Een realistische online conversatie opzetten

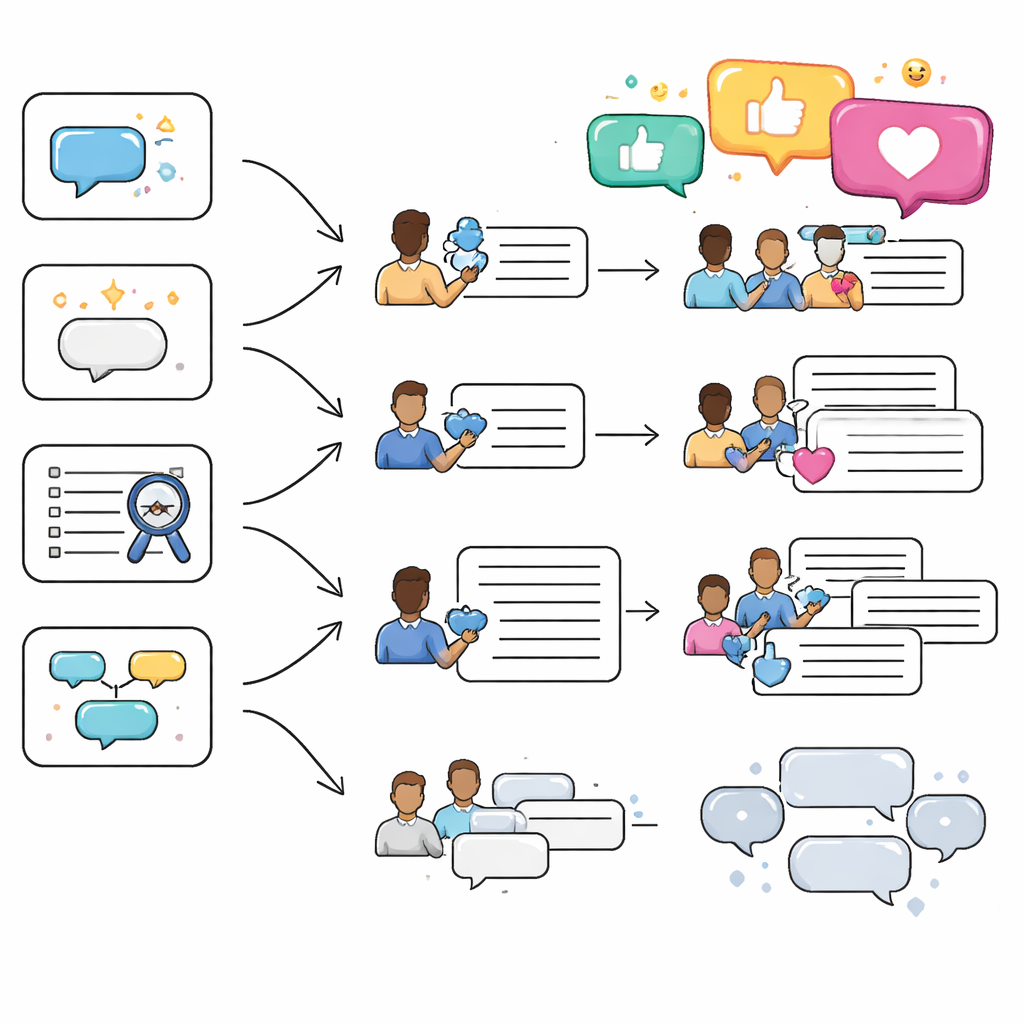

Om deze vragen te onderzoeken bouwde het team een eigen discussieplatform naar het model van populaire fora. Zeshonderd tachtig volwassenen uit de Verenigde Staten werden in kleine groepen van vijf geplaatst en gevraagd over drie soorten onderwerpen te debatteren: een luchtig onderwerp (katten versus honden), een wetenschappelijk onderwerp (gezondheidsvoordelen van haver) en een politiek onderwerp (onvoorwaardelijk basisinkomen). Sommige groepen kregen geen technologische hulp. Andere groepen gebruikten een van vier verschillende AI-tools: een open chatassistent, korte door AI geschreven gespreksopeners, suggesties voor reacties of feedback op door mensen zelf geschreven concepten. Deze opzet stelde de onderzoekers in staat om te vergelijken hoe mensen zich gedroegen en hoe ze de discussie ervoeren met en zonder AI-ondersteuning.

Meer stemmen en langere posts, maar gemengde gevoelens

Op één vlak deden de AI-tools precies wat ontwerpers zouden hopen. Deelnemers met AI-ondersteuning schreven meer en langere opmerkingen dan degenen in de controlegroepen. Sommige tools zorgden ook voor bredere deelname, waardoor de discussie minder werd gedomineerd door één of twee mensen. Zo hielpen door AI gegenereerde openingsprompts stillere gebruikers makkelijker mee te doen en zorgde de chatassistent ervoor dat mensen zich meer geneigd voelden iets te plaatsen door ideeën, feiten of formuleringen aan te reiken wanneer ze niet goed wisten wat ze moesten zeggen.

Wanneer behulpzaam hol wordt

Toch veranderde het beeld wanneer dezelfde gesprekken vanuit het perspectief van lezers werden beoordeeld. In de meeste AI-condities beoordeelden mensen wat ze zagen als minder informatief en van lagere kwaliteit dan in discussies zonder AI. Ze reageerden met meer “dislikes” en beschreven veel door AI beïnvloede opmerkingen als “robotisch” of “generiek”. Hoewel reactiesuggesties soms werden gewaardeerd, deden andere tools mensen het gevoel krijgen dat de toon van de discussie minder authentiek was. Zelfs degenen die de AI zelf niet gebruikten, konden de aanwezigheid ervan voelen zodra die in een draadje verscheen, omdat het de algehele spreekstijl naar langere maar minder zinvolle reacties duwde — een soort “semantisch afval” dat de ruimte vervuilt zonder veel inhoud toe te voegen.

Hoe mensen de tools daadwerkelijk gebruikten

Nauwkeurige gedragsanalyse liet zien dat deelnemers niet alle AI-hulp op dezelfde manier behandelden. De chatassistent werd veel gebruikt, vooral om feiten te controleren bij het wetenschapsonderwerp en om argumenten te verkennen bij het politieke onderwerp. Feedback op concepten werd omarmd wanneer de inzet hoger voelde — bijvoorbeeld bij gezondheid of politiek — en leidde vaak tot sterkere structuur en argumentatie. Gespreksopeners verlaagden de drempel om deel te nemen, maar werden even vaak genegeerd als ze niet aansloten bij de intentie van de gebruiker. Reactiesuggesties werden matig gebruikt en bij beladen onderwerpen gaven mensen sterk de voorkeur aan suggesties die instemden in plaats van tegenspraken, wat erop wijst dat AI gesprekken voorzichtig naar veiliger, minder confronterend terrein kan sturen.

Ontwerpprincipes voor een menselijkere online toekomst

Uit deze experimenten concluderen de auteurs dat de weg vooruit niet is om AI op sociale media te verwerpen, maar om het zorgvuldiger te ontwerpen. Mensen waardeerden AI als optionele hulp, vooral voor brainstormen, het checken van informatie en het overwinnen van een “writer’s block”, maar ze wilden tools die persoonlijker aanvoelden en beter afgestemd waren op het onderwerp en op hun eigen stem. De onderzoekers adviseren duidelijke labeling wanneer tekst rechtstreeks uit AI is gekopieerd, slimmere personalisatie die zich aan elke gebruiker aanpast, contextbewust gedrag dat de toon verschuift tussen informeel, wetenschappelijk en politiek, en simpele, vertrouwde interfaces. Zonder zulke waarborgen waarschuwen ze dat sociale platforms het risico lopen publieke ruimtes te vullen met gladde maar oppervlakkige praat die vertrouwen aantast. Met die waarborgen zou AI juist de drempel voor deelname kunnen verlagen en meer inclusieve, doordachte gesprekken kunnen ondersteunen die nog steeds klinken en voelen alsof ze van echte mensen komen.

Bronvermelding: Møller, A.G., Romero, D.M., Jurgens, D. et al. The impact of generative AI on social media: an experimental study. Sci Rep 16, 9376 (2026). https://doi.org/10.1038/s41598-026-40110-8

Trefwoorden: sociale media, generatieve AI, online discussie, authenticiteit, mens-computerinteractie