Clear Sky Science · nl

Robuuste plaatsherkenning bij lichtveranderingen met pseudo-LiDAR uit omnidirectionele beelden

Robots die nooit verdwalen in het donker

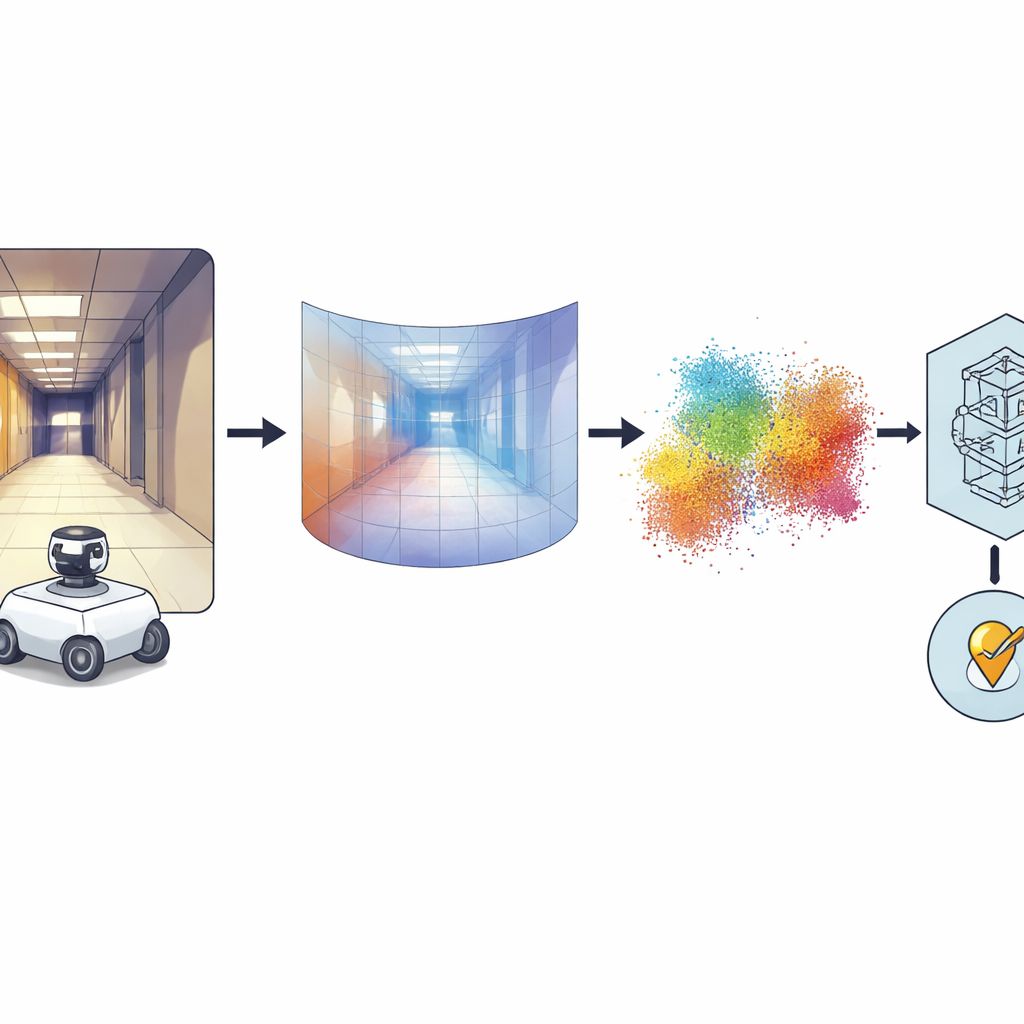

Stel je een robot voor die kan herkennen waar hij zich in een gebouw bevindt, of het nu midden op de dag is met zonnestralen door de ramen of laat in de avond met slechts enkele lampen aan. Dit artikel presenteert een nieuwe methode om robots zo’n betrouwbare plaatszin te geven met slechts één relatief goedkope camera. Door platte beelden om te zetten in 3D-informatie maken de onderzoekers robotnavigatie veel minder gevoelig voor schaduwen, schittering en andere lastige lichtveranderingen die zichtgebaseerde systemen normaal gesproken in de war brengen.

Waarom hetzelfde plekje twee keer vinden moeilijk is

Voor een robot betekent “plaatsherkenning” beseffen: “Ik ben hier eerder geweest,” zodat hij zich op een kaart kan lokaliseren en veilig kan navigeren. Traditionele systemen vertrouwen op gewone camera’s of op lasersensoren die bekendstaan als LiDAR. Camera’s zijn goedkoop en leggen rijke kleur- en textuurinformatie vast, maar hun beeld verandert sterk tussen bewolkte, zonnige en nachtelijke scènes. LiDAR is veel stabieler omdat het rechtstreeks afstanden meet, maar het is omvangrijk en duur. Sommige robots combineren meerdere sensoren, maar dat verhoogt prijs en complexiteit van het systeem. De auteurs van dit werk kiezen een andere weg: ze houden de hardware eenvoudig met slechts één omnidirectionele camera die rondom de robot kijkt, en verbeteren de software zodat de robot redeneert over 3D-structuur in plaats van ruwe verschijning.

Van all-around foto’s naar 3D-vormen

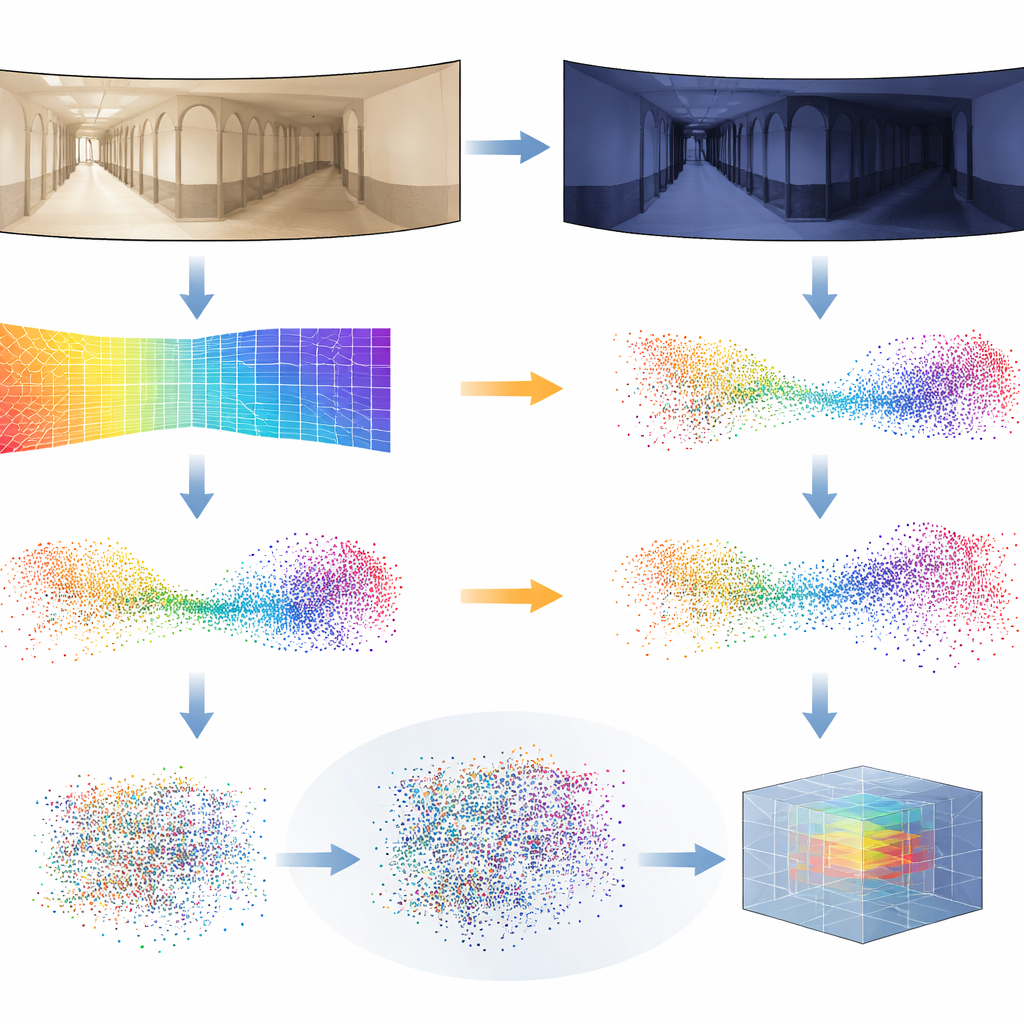

Het kernidee is elk panoramisch beeld om te zetten in een dicht dieptebeeld, waarbij elke pixel codeert hoe ver dat deel van de scène van de camera verwijderd is. Hiervoor vertrouwen de auteurs op een krachtig “foundation”-model genaamd Distill Any Depth, dat geleerd heeft diepte af te leiden uit enorme verzamelingen beelden. De resulterende dieptekaart wordt vervolgens omgezet in een wolk van 3D-punten—een soort virtuele LiDAR, of pseudo-LiDAR—zonder een echte laserscanner nodig te hebben. Extra verwerking ruimt artefacten op die zijn geïntroduceerd door de speciale spiegel voor de 360-graden camera, zodat ontbrekende of verborgen gebieden worden ingevuld. Ten slotte comprimeert een neuraal netwerk genaamd MinkUNeXt, dat ontworpen is om direct op 3D-puntenwolken te werken, elke wolk tot een compact vingerafdruk die de algemene lay-out van de plaats vastlegt.

Het systeem leren om lichttrucs te negeren

Diepteschattingen zijn niet perfect, vooral wanneer de belichting sterk verandert van het ene moment op het andere. Om het systeem robuust te maken, introduceren de onderzoekers een nieuwe trainingstruc die ze Distilled Depth Variations noemen. In plaats van op één dieptemodel te vertrouwen, mengen ze opzettelijk dieptevoorspellingen van meerdere kleinere, minder nauwkeurige versies van de diepte-estimator. Deze gecontroleerde “ruis” bootst de soorten vervormingen na die onder verschillende lichtomstandigheden optreden, waardoor het 3D-netwerk leert wat echt belangrijk is voor de geometrie van een plaats en wat veilig kan worden genegeerd. Ze verrijken ook elk 3D-punt met informatie over beeldranden en textuursterkte—kenmerken die doorgaans stabieler zijn bij lichtveranderingen dan ruwe kleur.

Bewijzen dat het in de echte wereld werkt

Om hun aanpak te testen, wendde het team zich tot veeleisende openbare datasets van binnenlandse robottrajecten. In deze verzamelingen dwaalt een robot meerdere keren door gangen en kamers onder bewolkt daglicht, fel zonlicht en ’s nachts, terwijl meubels en mensen bewegen. De auteurs trainden hun systeem uitsluitend met bewolkte beelden uit één gebouw en evalueerden het daarna over alle gebouwen en lichtomstandigheden, inclusief scènes die het systeem nog nooit eerder had gezien. Hun pseudo-LiDAR-methode presteerde consequent op gelijke hoogte met of beter dan toonaangevende 2D beeldgebaseerde technieken en andere 3D-systemen, vooral in de zwaarste gevallen zoals nachtelijke runs of overdrachten naar volledig nieuwe omgevingen. Ze toonden ook aan dat dezelfde pijplijn werkt met gewone voorwaarts gerichte camera’s, niet alleen panoramische, door de passende projectie van diepte naar 3D te gebruiken.

Wat dit betekent voor toekomstige robots

In gewone bewoordingen laat dit werk zien dat een robot LiDAR-achtige bewustheid van zijn omgeving kan verkrijgen met slechts één camera en slimme software. Door te focussen op 3D-structuur in plaats van de grillige details van licht en kleur, kan het systeem plaatsen betrouwbaar herkennen gedurende dag-, nacht- en weersveranderingen, terwijl de hardware eenvoudig en betaalbaar blijft. Dit kan robuuste binnennavigatie toegankelijker maken voor service-robots, magazijnvoertuigen en assistieve apparaten, en het opent de deur naar toekomstige systemen die diepte combineren met hoger-niveau scenebegrip voor nog betrouwbaardere autonomie.

Bronvermelding: Cabrera, J.J., Alfaro, M., Gil, A. et al. Robust place recognition under illumination changes using pseudo-LiDAR from omnidirectional images. Sci Rep 16, 8817 (2026). https://doi.org/10.1038/s41598-026-39848-y

Trefwoorden: robotlokalisatie, 3D-vision, plaatsherkenning, diepte-schatting, omnidirectionele camera's