Clear Sky Science · nl

Een flexibel kader voor hyperparameteroptimalisatie met homotopie en surrogaatmodellen

Waarom het afstellen van AI-instellingen ertoe doet

Moderne kunstmatige-intelligentiesystemen zijn niet alleen afhankelijk van slimme algoritmen en enorme hoeveelheden data, maar ook van een verrassend kieskeurig laagje instellingen dat “hyperparameters” wordt genoemd. Dit zijn de knoppen die bepalen hoe groot een model moet zijn, hoe snel het leert en hoe het omgaat met ruis in de data. Als die verkeerd staan, kan een veelbelovend systeem tegenvallen. Dit artikel introduceert HomOpt, een nieuwe manier om die knoppen efficiënter en betrouwbaarder af te stemmen, vooral wanneer de zoekruimte groot en rommelig is. Dat maakt het aantrekkelijk voor iedereen die AI beter wil laten functioneren met minder proefondervindelijke pogingen.

Een nieuwe manier om de zoektocht te sturen

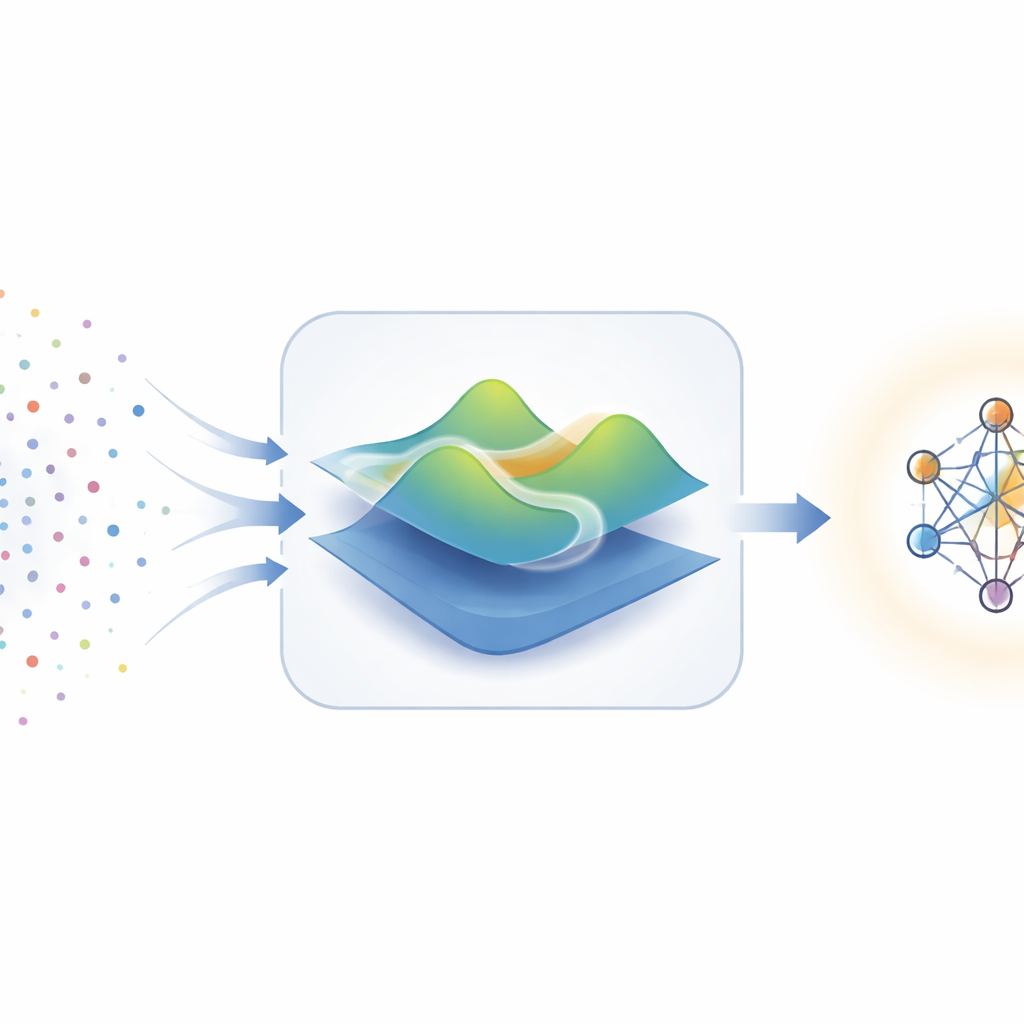

Traditionele benaderingen van hyperparametertuning, zoals grid search of random search, zijn een beetje alsof je recepten probeert door ingrediënten door elkaar te gooien en te hopen dat het goed smaakt. Geavanceerdere methoden, zoals Bayesian optimalisatie, proberen slimmer te zijn door een ruwe modelvorming van te maken hoe instellingen de prestaties beïnvloeden en dat model te gebruiken om de volgende combinatie te kiezen. Maar deze methoden veronderstellen vaak dat het prestatielandschap glad en goedgedragen is, wat in de praktijk vaak niet het geval is door eigenaardigheden, ruis en abrupte sprongen. HomOpt pakt deze uitdaging aan door herhaaldelijk benaderende vervangers van het werkelijke landschap te bouwen — zogenaamde surrogaatmodellen — en vervolgens één surrogaat soepel in het volgende te transformeren naarmate meer data binnenkomt, terwijl het bijhoudt hoe de beste oplossing zich tijdens die transformatie verplaatst.

Modellen geleidelijk vervormen in plaats van opnieuw te beginnen

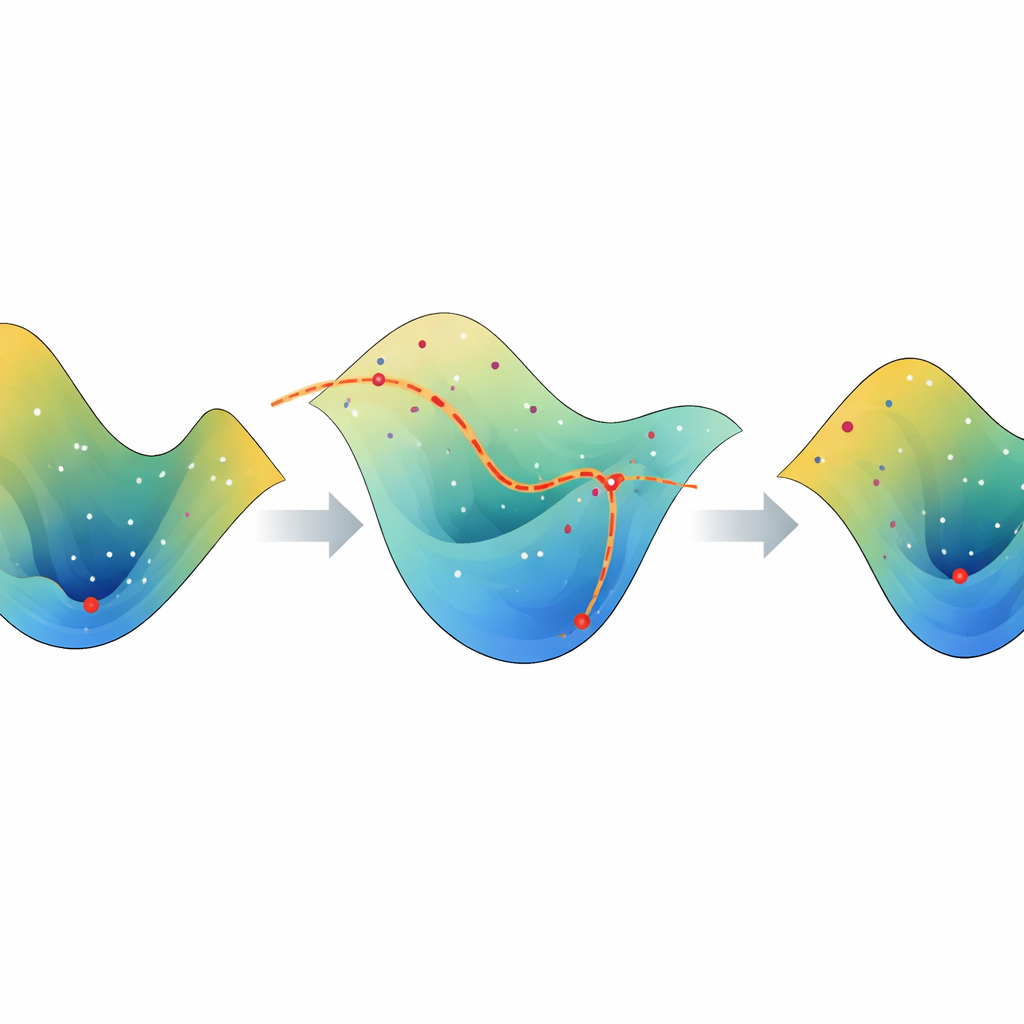

Het kernidee van HomOpt komt uit een wiskundig concept dat homotopie heet, wat in eenvoudige woorden gaat over het geleidelijk vervormen van de ene vorm in de andere zonder te scheuren of te springen. In dit kader is elk surrogaatmodel een verzacht beeld van hoe verschillende hyperparameterinstellingen de prestaties beïnvloeden. Zodra nieuwe experimentele resultaten binnenkomen, bouwt HomOpt een bijgewerkt surrogaat en definieert het een continue transformatie tussen de oude en de nieuwe versie. In plaats van eerder werk weg te gooien en de zoektocht opnieuw te starten, volgt het hoe het beste punt op het oude oppervlak over dit vervormende landschap schuift om uiteindelijk op een goed punt van het nieuwe oppervlak uit te komen. Deze geleide beweging maakt de zoektocht gerichter en minder willekeurig, waardoor de kans toeneemt dat betere instellingen in minder stappen worden gevonden.

Flexibele hulpmiddelen voor verschillende soorten data

Om aan te tonen dat het idee in de praktijk werkt, koppelen de auteurs twee heel verschillende typen surrogaatmodellen aan HomOpt. Ten eerste gebruiken ze Generalized Additive Models, die glad zijn en vrij goed te interpreteren, waardoor ze nuttig zijn wanneer de relaties tussen instellingen en prestaties geleidelijk veranderen. Ten tweede gebruiken ze CatBoost, een krachtig ensemble-algoritme dat goed geschikt is voor ingewikkelde, hoog-dimensionale problemen zoals beeldherkenning. HomOpt bindt zich niet aan één surrogaat; het behandelt de keuze van het surrogaat als een inplugbaar onderdeel dat kan passen bij de moeilijkheidsgraad en structuur van de taak. Het kader kan omgaan met continue, discrete en categorische instellingen en kan bovenop gangbare zoekstrategieën zoals random search, Bayesian optimalisatie of boomgebaseerde methoden worden gezet, waarbij het fungeert als een verfijningslaag in plaats van een vervanging.

De methode op de proef gesteld

De onderzoekers evalueren HomOpt op een diverse set benchmarks. Bij klassieke machine-learningtaken afkomstig van publieke tabeldatasets stemmen ze modellen af zoals support vector machines, random forests, logistieke regressie, multilayer perceptrons en gradient-boosted trees. Ze onderzoeken ook veeleisende open-set herkenningsproblemen, waarbij een systeem moet omgaan met eerder niet-geziene categorieën, met een gespecialiseerde classifier genaamd de Extreme Value Machine. Ten slotte testen ze HomOpt op neural architecture search-tabellen voor bekende beelddatasets zoals CIFAR-10 en ImageNet-achtige verzamelingen, waar de ruimte aan mogelijke ontwerpen bijzonder groot en ruig is. In veel van deze settings versnelt HomOpt ofwel de afdaling naar goede oplossingen, of verbetert het de uiteindelijke prestaties vergeleken met de onderliggende methoden alleen, vaak met minder dure modelbeoordelingen.

Wat dit betekent voor de dagelijkse AI-praktijk

Voor beoefenaars is de belangrijkste boodschap dat HomOpt een gestructureerde manier biedt om hyperparametertuning slimmer te maken in plaats van alleen uitputtender. Door continu een benaderd beeld van het prestatielandschap te verfijnen en soepel te volgen hoe het beste punt verschuift naarmate dat beeld verbetert, vermindert de methode verspilde zoekacties en benut elke modelrun beter. Omdat het werkt met een breed scala aan verliesmaten, modeltypes en zoekstrategieën, kan HomOpt worden behandeld als een algemeen inzetbare add-on voor bestaande optimalisatietools. In eenvoudige bewoordingen belooft het nauwkeurigere, robuustere AI-systemen te leveren binnen hetzelfde compute-budget — en dat op een manier die schaalt van kleine tabelproblemen tot grote, complexe beeldtaken.

Bronvermelding: Abraham, S.J., Maduranga, K.D.G., Kinnison, J. et al. A flexible framework for hyperparameter optimization using homotopy and surrogate models. Sci Rep 16, 9412 (2026). https://doi.org/10.1038/s41598-026-39713-y

Trefwoorden: hyperparameteroptimalisatie, surrogaatmodellen, homotopiemethoden, geautomatiseerde machine learning, zoektocht naar neurale architecturen