Clear Sky Science · nl

AsynDBT: asynchrone gedistribueerde bilevel-afstemming voor efficiënt in-context leren met grote taalmodellen

Waarom slimme prompts ertoe doen voor alledaagse AI

Grote taalmodellen zitten tegenwoordig achter chatbots, zoekmachines en schrijfassistenten die veel mensen dagelijks gebruiken. Toch hangen nuttige antwoorden nog sterk af van hoe we onze vragen formuleren en welke voorbeelden we aan het model laten zien. Dit artikel introduceert een nieuwe manier om die prompts en voorbeelden automatisch te verfijnen over veel apparaten heen, terwijl de data van elke gebruiker privé blijft. Het resultaat is een AI-systeem dat leert om nauwkeuriger en efficiënter te reageren, vooral bij gespecialiseerde taken zoals het onderhoud van telecommunicatienetwerken.

AI lesgeven door te laten zien, niet door opnieuw te trainen

In plaats van voortdurend gigantische AI-modellen opnieuw te trainen, is er een groeiende trend om ze “in het moment” te onderwijzen door een paar zorgvuldig gekozen voorbeelden in de prompt te geven—een proces dat bekendstaat als in-context leren. Om bijvoorbeeld filmrecensies als positief of negatief te classificeren, laat je het model een kleine set gelabelde voorbeelden zien en vraag je het vervolgens een nieuwe recensie te labelen. Het probleem is dat de keuze van voorbeelden en de precieze formulering van de instructies de prestaties van het model dramatisch kunnen beïnvloeden. Goede combinaties met de hand vinden is traag en duur, en het delen van ruwe data tussen organisaties is vaak onmogelijk door privacyvoorschriften.

Samenwerken zonder privégegevens te delen

Om data-uitwisseling te omzeilen bouwen de auteurs voort op federated learning, een opzet waarbij veel afzonderlijke apparaten of organisaties hun data lokaal houden maar samenwerken via een centrale server. Elke deelnemer—bijvoorbeeld een telecombasisstation of een bedrijfsserver—praat met hetzelfde cloudgebaseerde taalmodel, maar uploadt nooit zijn ruwe tekst. In plaats daarvan stuurt hij alleen terug welke feedbacksignalen aangeven hoe goed verschillende prompts en voorbeeldkeuzes werken. Een nieuw algoritme, AsynDBT (asynchrone gedistribueerde bilevel-afstemming), coördineert deze deelnemers zodat zij gezamenlijk een gedeelde promptingstrategie verbeteren, met respect voor privacy en met tolerantie voor traagheid of onbetrouwbare netwerkverbindingen.

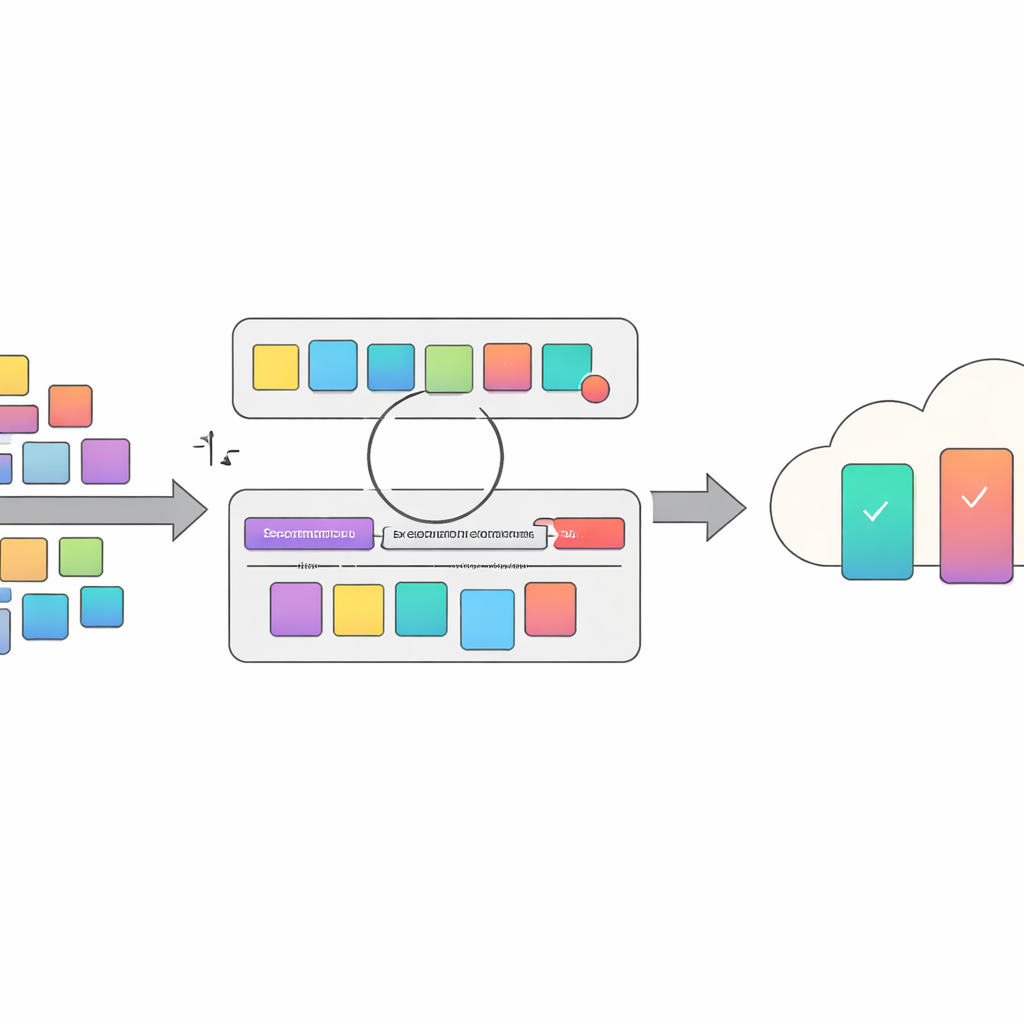

Optimaliseren van zowel de instructie als de voorbeelden

Een centraal idee in het artikel is promptontwerp te behandelen als een tweelaags optimalisatieprobleem. Op het lagere niveau past het systeem korte fragmenten aan die aan de taakomschrijving worden toegevoegd—kleine woordkeuzes die het model in de richting van beter redeneren kunnen duwen. Op het hogere niveau beslist het welke gelabelde voorbeelden als demonstraties meegegeven worden. Deze twee lagen beïnvloeden elkaar: verschillende voorbeeldsets vragen om andere promptaanpassingen, en omgekeerd. AsynDBT formaliseert deze relatie wiskundig en gebruikt een efficiënte benaderingsmethode zodat elke deelnemer geleidelijk zijn lokale keuzes kan bijwerken terwijl een centrale server een consistente globale weergave van de lagere-laagnaarbeslissingen behoudt.

Omgaan met trage apparaten en kwaadaardige deelnemers

In echte netwerken reageren sommige apparaten te laat of haken ze af, waardoor er “stragglers” ontstaan die gesynchroniseerde training kunnen blokkeren. AsynDBT werkt in plaats daarvan asynchroon: de server werkt zijn variabelen bij zodra een subset van de deelnemers rapporteert, zonder op iedereen te wachten. De methode beschermt ook tegen deelnemers die misleidende updates kunnen sturen, opzettelijk of per ongeluk. Door regularisatietechnieken te mengen met robuuste aggregatieregels vermindert het algoritme de impact van vergiftigde of van lage kwaliteit zijnde voorbeeldselecties op de globale strategie, waardoor het geheel stabiel en betrouwbaar blijft, zelfs onder aanval.

Aantoonbare verbeteringen bij taal- en telecomtaken

De onderzoekers testten AsynDBT op zes tekstclassificatietaken, inclusief een veeleisende 5G-netwerkdataset waarin het model moest beoordelen of gespecialiseerde technische termen gerelateerd waren, met alleen fragmenten van telecomstandaarden als context. Vergeleken met een reeks bestaande prompting- en voorbeeldselectiemethoden behaalde de nieuwe aanpak op bijna alle taken de beste of tweede beste nauwkeurigheid. Vooral bij de 5G-taak verbeterde het de nauwkeurigheid met ongeveer tien procentpunten ten opzichte van de sterkste baseline. Tegelijk reduceerde het asynchrone ontwerp de trainingstijd met grofweg 40 procent in vergelijking met een soortgelijke gecentraliseerde methode die het werk niet distribueert.

Wat dit betekent voor toekomstige AI-tools

Voor niet-experts is de conclusie dat betere prompts en slimere voorbeeldkeuzes merkbaar kunnen verbeteren hoe AI-systemen zich gedragen—zonder het onderliggende model te veranderen. AsynDBT biedt een geautomatiseerde, privacybewarende manier om dit over veel samenwerkende apparaten te doen, wat leidt tot nauwkeurigere en efficiëntere taalinstrumenten voor domeinen als telecomoperaties, klantenservice en andere gespecialiseerde velden. Vooruitkijkend plannen de auteurs hun raamwerk te combineren met graf-gebaseerde kennisopvraging zodat prompts ook actuele feitelijke informatie kunnen benutten, waardoor hallucinaties verder verminderen en AI-assistenten betrouwbaarder worden in omgevingen met hoge inzet.

Bronvermelding: Ma, H., Dou, S., Liu, Y. et al. AsynDBT: asynchronous distributed bilevel tuning for efficient in-context learning with large language models. Sci Rep 16, 9381 (2026). https://doi.org/10.1038/s41598-026-39582-5

Trefwoorden: in-context leren, promptoptimalisatie, federated learning, grote taalmodellen, privacybewarende AI