Clear Sky Science · nl

Optimalisatie van interventiemaatregelen bij infectieziekten met reinforcement learning aan de hand van Britse COVID-19-epidemiegegevens

Slimme hulpmiddelen voor moeilijke gezondheidskeuzes

Wanneer een nieuwe ziekte zich door een land verspreidt, moeten leiders snel beslissen hoe strak het dagelijks leven naar beneden wordt gedraaid. Alles sluiten kan levens redden maar de economie verwoesten; te langzaam reageren leidt tot overbelaste ziekenhuizen. Dit artikel onderzoekt of een vorm van kunstmatige intelligentie, reinforcement learning genoemd, overheden kan helpen slimmere, meer gebalanceerde reacties te vinden met behulp van gedetailleerde simulaties van hoe een virus zoals COVID‑19 zich daadwerkelijk door echte gemeenschappen verspreidt.

Een land nabootsen in een computer

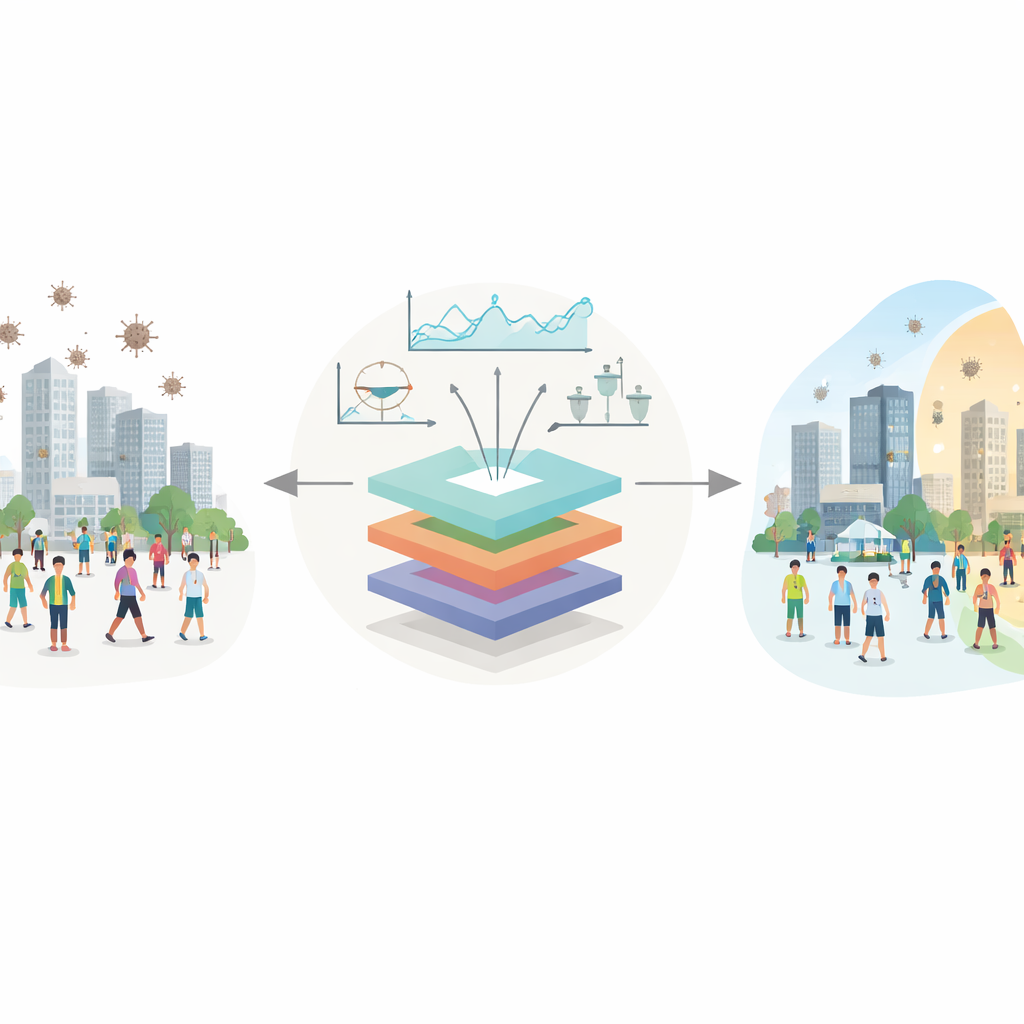

In plaats van eenvoudige vergelijkingen te gebruiken die mensen als identiek behandelen, bouwen de auteurs voort op Covasim, een uitgebreid computermodel dat duizenden virtuele individuen volgt terwijl ze leven, werken, studeren en omgaan met anderen. Elke gesimuleerde persoon heeft een leeftijd, een plek in familie-, school- en werknetwerken, en een gezondheidstoestand die kan veranderen van gezond naar geïnfecteerd naar hersteld of overleden. Door de modelinstellingen zorgvuldig af te stemmen laat het team dit virtuele Verenigd Koninkrijk zich gedragen zoals het echte deed tijdens de eerste COVID‑19-golf, overeenkomend met de officiële tellingen van gevallen en sterfgevallen van begin 2020. Deze kalibratiestap is cruciaal, omdat elke strategie die de computer leert moet werken in een wereld die op de onze lijkt, niet in een speeltjesuniversum.

Een digitale adviseur leren handelen

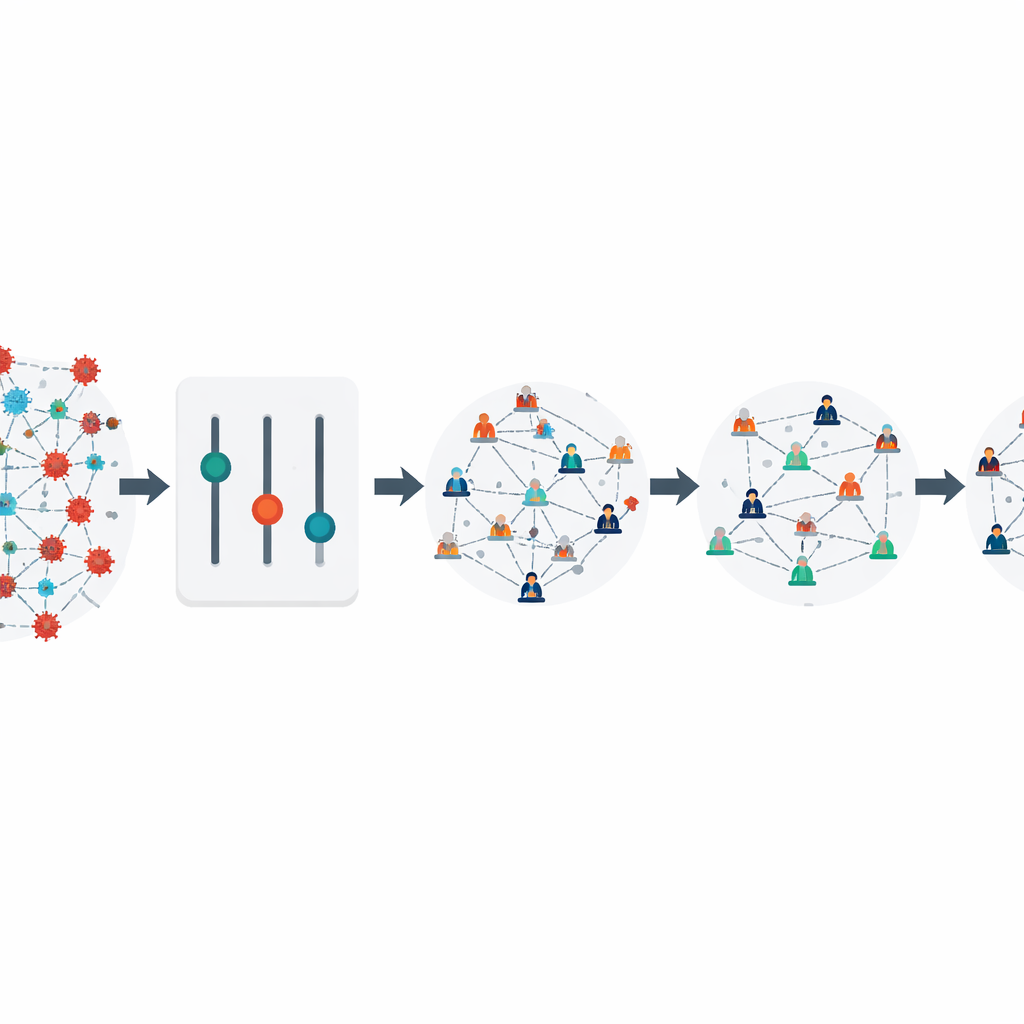

Zodra het model zich als de realiteit gedraagt, koppelen de onderzoekers reinforcement learning in, een tak van AI waarbij een software‑“agent” herhaaldelijk beslissingen uitprobeert en beloond of bestraft wordt op basis van de uitkomsten. Hier kan de agent elke gesimuleerde week drie hoofdknoppen aanpassen: hoe streng gedeeltelijke lockdowns zijn, hoeveel mensen getest worden, en hoe agressief contactopsporing wordt ingezet. Het beloningssysteem is ontworpen om twee concurrerende doelen vast te leggen: het laag houden van infecties, ernstige ziekte en sterfgevallen, en tegelijk de economische schade door het sluiten van werkplekken en isolatie beperken. Door duizenden epidemies te simuleren ontdekt de agent welke combinaties en timing van maatregelen de hoogste totaalscore opleveren.

Een beter evenwicht dan vaste regels vinden

De studie vergelijkt verschillende leermethoden en manieren om de keuzes van de agent te beschrijven. Een methode die acties behandelt als vloeiend instelbare knoppen, in plaats van een klein menu van vaste opties, presteert bijzonder goed. Het leert snel te reageren wanneer het virus begint te verspreiden, door korte maar sterke beperkingen op te leggen in combinatie met intensief testen en traceren. Zodra de gesimuleerde uitbraak onder controle is, versoepelt het de lockdowns maar houdt het een deel van testen en tracering in stand, en verscherpt het tijdelijk weer als infecties dreigen te stijgen. Dit flexibele patroon houdt het totale aantal infecties in het model rond de 300.000, ver onder wat plaatsvond onder het daadwerkelijke Britse beleid in dezelfde periode, en ook lager dan een eenvoudige "zeven dagen open, zeven dagen lockdown"-regel. De economische verliezen in het model worden met meer dan twee derde teruggebracht vergeleken met die rigide afwisselende lockdownstrategie.

Timing doet er echt toe

De auteurs onderzoeken ook hoe deze verschillende strategieën het realtime reproductiegetal beïnvloeden, een maat voor hoeveel nieuwe infecties elke casus genereert. In hun simulaties drukt het door AI ontworpen beleid dit getal ongeveer een maand eerder onder de kritische waarde van één dan de daadwerkelijke Britse respons deed. Die ogenschijnlijk kleine verschuiving reduceert de cumulatieve infecties dramatisch en benadrukt hoeveel verschil vroegtijdige, goed geplande actie kan maken. Ze testen de geleerde strategie verder in een heel andere context, met gegevens van Hongkong’s grote COVID‑19-golf in 2022, en vinden dat dezelfde aanpak nog steeds goed presteert, wat suggereert dat de geleerde regels algemene principes vastleggen in plaats van overaanpassing aan één land.

Wat dit betekent voor toekomstige uitbraken

Voor niet‑specialisten is de hoofdboodschap dat we niet blind hoeven te kiezen tussen levens redden en bestaansmiddelen behouden. Door gedetailleerde simulaties van hoe een virus zich door echte sociale netwerken beweegt te combineren met AI die leert door trial‑and‑error, zouden beleidsmakers op datagedreven draaiboeken kunnen vertrouwen die zich aanpassen naarmate de omstandigheden veranderen. De auteurs benadrukken dat zulke hulpmiddelen niet bedoeld zijn om menselijk oordeel te vervangen, maar dienen als krachtige besluitvormingshulpmiddelen die talloze wat‑als‑scenario’s veel sneller verkennen dan mensen dat kunnen. Wanneer nieuwe epidemieën opduiken kan deze benadering leiders helpen eerder en preciezer te handelen, met gerichte testen, tracering en gedeeltelijke sluitingen om de ziekte onder controle te houden terwijl zoveel mogelijk normaal leven en economische activiteit behouden blijft.

Bronvermelding: Zhang, B., Chen, Y., Li, H. et al. Optimization of infectious disease intervention measures using reinforcement learning with UK COVID-19 epidemic data. Sci Rep 16, 10627 (2026). https://doi.org/10.1038/s41598-026-39377-8

Trefwoorden: COVID-19-beleid, reinforcement learning, epidemiesimulatie, niet-farmaceutische interventies, volksgezondheidsstrategie