Clear Sky Science · nl

Parsing van patiëntadressen via KG-bewuste contrastieve learning en beperkte on-prem LLM-inferentie

Waarom nette patiëntadressen ertoe doen

Achter elk ziekenhuisbezoek staat een eenvoudige regel tekst: het thuisadres van de patiënt. Verre van een administratief detail, vormen deze adressen de motor van ziektekaartvorming, noodplanning en beslissingen over waar klinieken en ambulances moeten worden geplaatst. Toch worden adressen in veel medische dossiers als rommelige, inconsistente tekst opgeslagen, vol afkortingen, typfouten en ontbrekende onderdelen. Dit artikel introduceert AddrKG‑LLM, een nieuwe methode die dergelijke lastige adresgegevens omzet in schone, betrouwbare records, terwijl gevoelige details privé blijven.

Het probleem van rommelige thuisadressen

Als adressen vrij worden ingevoerd, laten mensen wijken weg, wisselen ze de woordvolgorde om of gebruiken lokale bijnamen die officiële kaarten niet herkennen. Oudere computermethodes vergelijken tekenreeksen karakter voor karakter of als eenvoudige woordenlijsten, wat alleen werkt als de invoer al netjes en compleet is. Nieuwere deep learning-systemen begrijpen context intelligenter, maar kunnen nog steeds struikelen over ongebruikelijke formuleringen en vragen om veel rekenkracht. Recente grote taalmodellen tonen een indrukwekkend vermogen om tekst te begrijpen en te genereren. Wanneer ze echter vrij mogen antwoorden, hebben ze ook de neiging te "hallucineren" — details te verzinnen die niet in de gegevens staan — een onaanvaardbaar risico in de gezondheidszorg, waar dossiers precies en controleerbaar moeten zijn.

Een tweestapsroute van chaos naar orde

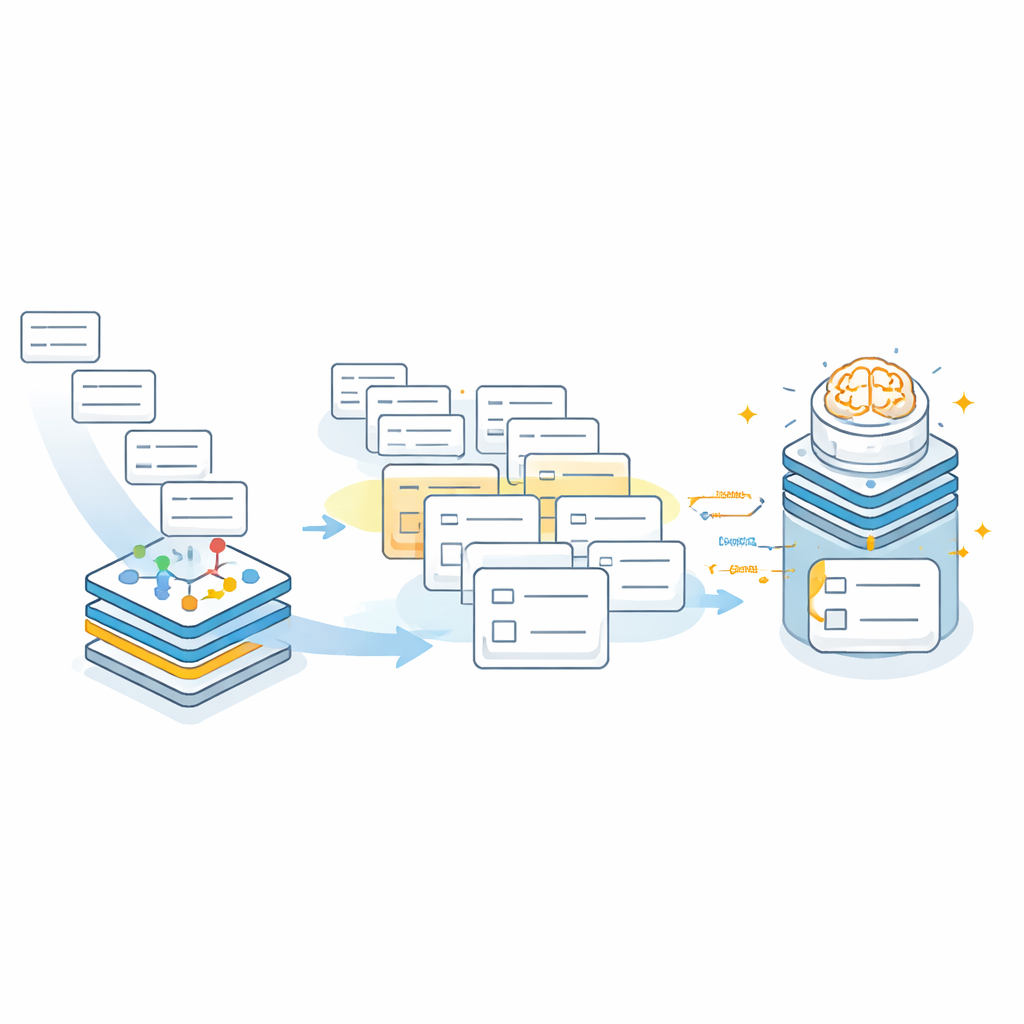

De onderzoekers ontwierpen AddrKG‑LLM als een pijplijn in twee fasen die structuur en voorwaarden rond het taalmodel legt in plaats van het alleen te laten werken. Eerst worden binnenkomende patiëntadressen opgeschoond om sterk identificerende details zoals gebouwen- en kamernummers en telefoongegevens te verwijderen, wat helpt de privacy te beschermen. De overgebleven tekst wordt omgezet in een dichte numerieke representatie die de betekenis vastlegt. Tegelijk bouwt het team een kennisgrafiek — een kaartachtige netwerkstructuur die de officiële relaties tussen steden, wijken, straten en wooncomplexen vastlegt. Met een techniek genaamd contrastive learning trainen ze het systeem zodat adressen die naar dezelfde echte woonplaats verwijzen dicht bij elkaar komen te liggen in deze gedeelde ruimte, terwijl niet-gerelateerde plaatsen verder uit elkaar worden geduwd. Zo kan het systeem snel een korte lijst met waarschijnlijke adreskandidaten ophalen voor elk nieuw patiëntrecord.

Het AI op een korte lijn houden

In de tweede fase opereert het grote taalmodel binnen een zorgvuldig afgebakende zoekruimte. In plaats van een adres uit het niets te verzinnen, krijgt het model de originele opgeschoonde tekst plus de kleine set kandidaat-gemeenschappen die door de kennisgrafiek zijn voorgesteld. De prompt geeft expliciet aan dat het model alleen uit deze kandidaten mag kiezen en resultaten moet outputten in een vaste JSON-structuur met aparte velden voor stad, wijk, straat of dorp en gemeenschap. Als geen van de kandidaten past — bijvoorbeeld wanneer de werkelijke gemeenschap nooit werd opgehaald — krijgt het model de instructie om lege waarden terug te geven in plaats van te gokken. Dit "weigeren-voorop"-gedrag verkleint drastisch het risico dat plausibel klinkende maar onjuiste vermeldingen in ziekenhuisdossiers sluipen.

Hoe goed werkt het in de praktijk?

Het team testte AddrKG‑LLM op tienduizend gedepersonaliseerde echte ziekenhuisadressen die de ruis uit de echte wereld weerspiegelen: afkortingen, ontbrekende wijken, spellingvarianten en zelfs volledig ongeldige invoer. Ze vergeleken hun systeem met klassieke tekenreeksvergelijkingshulpmiddelen, deep learning sequence-labeling modellen, algemene taalmodellen die vrij werden gebruikt, en een commerciële adresstandaardisatiedienst. Op strikte maatstaven die vereisen dat elk veld van een adres tegelijk correct is, overtrof AddrKG‑LLM al deze referenties en verbeterde de totale nauwkeurigheid met meer dan twaalf procentpunten ten opzichte van een sterk BERT-gebaseerd model. De winst was vooral duidelijk bij afgekorte en gedeeltelijk ontbrekende adressen, waarbij de hiërarchie in de kennisgrafiek helpt hiaten op te vullen. De auteurs onderzochten ook hoe de prestatie verandert met verschillende taalmodelgroottes en met verschillende aantallen opgehaalde kandidaten, en lichten toe hoe ziekenhuizen snelheid en nauwkeurigheid voor hun eigen behoeften kunnen afwegen.

Wat dit betekent voor de dagelijkse zorg

Voor niet‑specialisten is de kernboodschap dat AddrKG‑LLM een manier biedt om essentiële maar rommelige patiëntadresgegevens op te schonen, terwijl de controle stevig in menselijke handen blijft. Door een kaartachtige kennisgrafiek te koppelen aan een beperkt taalmodel dat volledig op ziekenhuisservers draait, levert het kader accuratere en consistentere adressen zonder gevoelige details naar externe clouddiensten te sturen of het AI-systeem te laten improviseren. Het resultaat is een praktisch hulpmiddel dat ziektebewaking kan versterken, de planning van middelen kan verbeteren en veiligere, efficiëntere ziekenhuisoperaties kan ondersteunen — simpelweg door ervoor te zorgen dat elke patiënt betrouwbaar op de kaart staat.

Bronvermelding: Li, J., Pan, X. & Jia, Y. Patient address parsing via KG-aware contrastive learning and constrained on-prem LLM inference. Sci Rep 16, 8003 (2026). https://doi.org/10.1038/s41598-026-39348-z

Trefwoorden: parsing patiëntadres, kwaliteit van gezondheidsgegevens, kennisgrafiek, grote taalmodel, medische informatica