Clear Sky Science · nl

Privacybewuste analyse van sprekerkenmerken en multimodale eigenschappen in sollicitatiegesprekken

Waarom je stem in sollicitatiegesprekken nieuwe vragen oproept

Steeds meer bedrijven schakelen over op geautomatiseerde video-interviews, waarbij algoritmen luisteren naar hoe je spreekt en eigenschappen afleiden zoals zelfvertrouwen, betrouwbaarheid of sociabiliteit. Maar je stem draagt veel meer dan een eerste indruk—ze kan wijzen op je identiteit, gezondheid en achtergrond. Dit artikel onderzoekt of het mogelijk is om wie je bent in een opname te verbergen, terwijl computers toch kunnen inschatten hoe je overkomt als sollicitant. Met andere woorden: kunnen we de voordelen van AI-ondersteunde werving behouden zonder heimelijk onze privacy op te geven?

Van eerste indrukken naar geautomatiseerde oordelen

Wervingspsychologen weten al lang dat brede persoonlijkheidspatronen—vaak beschreven als de Big Five: openheid, consciëntieusheid, extraversie, vriendelijkheid en emotionele stabiliteit—belangrijk zijn voor werkprestaties. Recente ontwikkelingen in kunstmatige intelligentie maken het mogelijk dat computers deze eigenschappen schatten aan de hand van hoe mensen spreken in sollicitatiegesprekken, waarbij niet alleen wordt gelet op wat kandidaten zeggen, maar ook op hoe ze het zeggen: toonhoogte, luidheid, ritme en spreekstijl. Deze systemen beloven snellere, consistentere screening van kandidaten. Tegelijkertijd stellen ze een verontrustende vraag: als een bedrijf je stem opslaat, kan diezelfde data later worden gebruikt om je te herkennen, te profileren of gevoelige details af te leiden die je nooit hebt gedeeld?

Hoe je een stem kunt verbergen zonder het karakter te verliezen

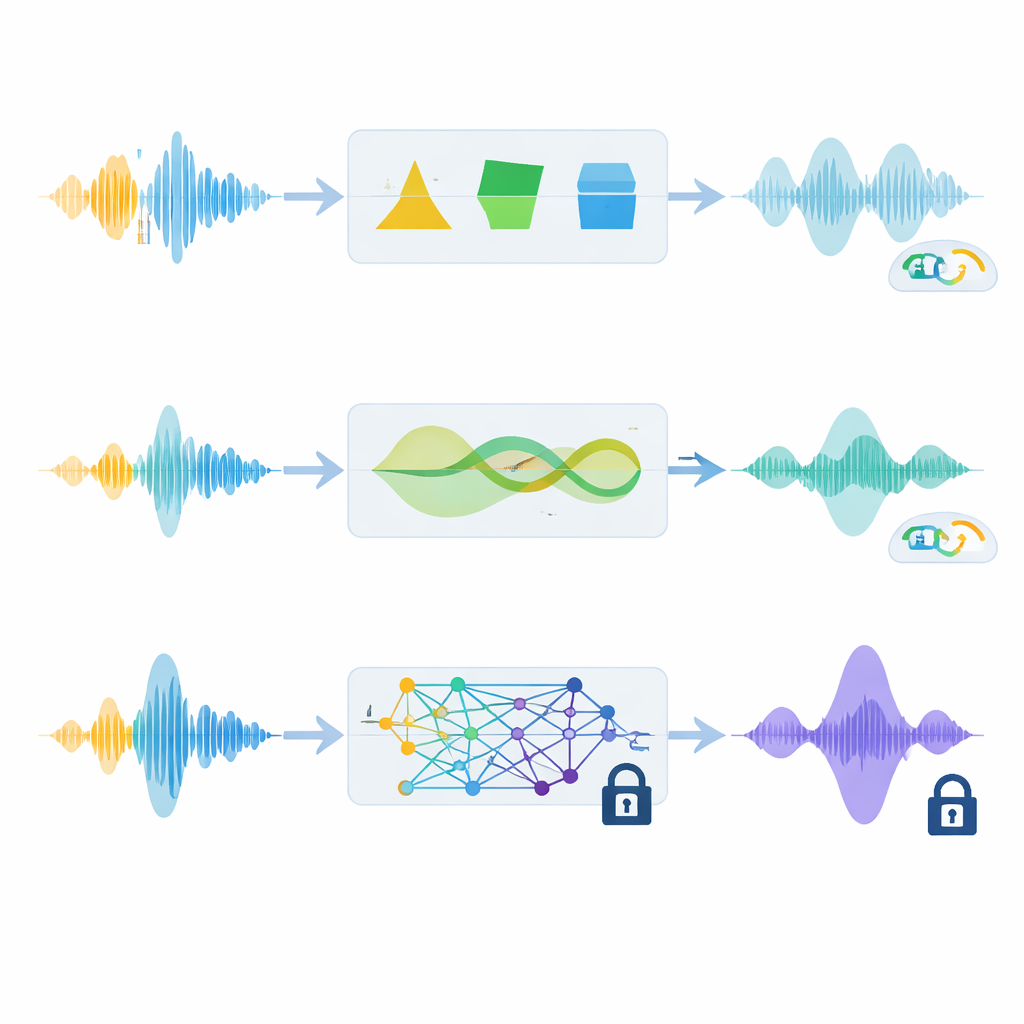

Om dit dilemma te onderzoeken bestudeerden de onderzoekers technieken die iemands stem zodanig veranderen dat die niet meer naar die persoon klinkt, terwijl de aanwijzingen die nodig zijn voor persoonlijkheids- en wervingoordelen behouden blijven. Ze richtten zich op drie anonimisatiemethoden. Twee daarvan gebruiken traditionele audiotrucs, zoals het subtiel herschikken van geluidfrequenties en het uitrekken of verschuiven van de toonhoogte in de tijd. De derde berust op een moderne neurale audio-codec, die de stem comprimeert tot een reeks digitale codes en die vervolgens reconstrueert als een nieuwe, hoogwaardige maar anders klinkende stem. Cruciaal was dat het team alle methoden afstemde zodat het waargenomen geslacht van de spreker gelijk bleef en de geconverteerde stem consistent was over meerdere antwoorden in een lang online interview.

Privacy en bruikbaarheid op de proef stellen

Met bijna 1.900 echte online sollicitatievideo’s van mensen uit de Verenigde Staten stelden de auteurs twee hoofdvragen. Ten eerste: hoe moeilijk zou het voor een aanvaller zijn om geanonimiseerde stemmen met behulp van een geavanceerd spraakherkenningssysteem terug te koppelen aan de oorspronkelijke sprekers? Ten tweede: konden algoritmen na anonimisering nog steeds belangrijke persoonlijkheidsbeoordelingen en aanbevelingen voor werving met vergelijkbare nauwkeurigheid voorspellen? Ze evalueerden privacy met een foutpercentage afkomstig van automatische sprekerverificatie—hogere fout betekent betere bescherming—en maten bruikbaarheid via spraakherkenningsnauwkeurigheid, waargenomen audiokwaliteit en hoe goed machine-learningmodellen eigenschappen en wervingsbeslissingen konden afleiden uit akoestische en taalkundige kenmerken.

Hoe de afweging er echt uitziet

De resultaten tonen een genuanceerd evenwicht tussen veiligheid en prestaties. De eenvoudigste methode, die frequenties van de stem licht herschikt, bood slechts bescheiden privacy en kon vrijwel falen wanneer het systeem van de aanvaller was aangepast aan de geanonimiseerde stemmen. Een geavanceerdere signaalgebaseerde techniek die timing en toonhoogte verandert presteerde veel beter: die verminderde de kans op succesvolle re-identificatie aanzienlijk en behield het ritme en de expressiviteit van spraak. Daardoor bleven wervings- en persoonlijkheidsvoorspellingen dicht bij die gemaakt op basis van de oorspronkelijke opnames. De neurale audio-codec leverde de sterkste privacy en maakte het veel moeilijker om geanonimiseerde stemmen aan echte sprekers te koppelen, en in veel gevallen verwijderde ze ook achtergrondgeluid. Echter, in de rumoerige, realistische interviewopnames verstoorde deze methode ook subtiele prosodische aanwijzingen die bepalen hoe luisteraars eigenschappen waarnemen, wat leidde tot een merkbare daling in de prestaties van eigenschapsschatting en hogere fouten in automatische transcriptie.

Wat dit betekent voor eerlijke en private werving

De studie laat zien dat er geen one-size-fits-all-oplossing bestaat: sterkere privacy gaat vaak ten koste van hoe goed AI persoonlijkheid kan lezen en kandidaten kan aanbevelen. Voor typische wervingssituaties waarin schattingen van eigenschappen en eerlijke beslissingen voorop staan, kunnen verfijnde signaalverwerkingsbenaderingen—met name de hier geteste fasegebaseerde methode—het beste compromis bieden, doordat ze identiteit afschermen terwijl het “gevoel” van iemands stem behouden blijft. In situaties met hogere privacy-eisen, zoals het ruim delen van spraakdata of bescherming tegen krachtige aanvallers, kunnen nieuwere neurale codecmethoden betere bescherming bieden, maar ontwerpers moeten dan enige verlies van nauwkeurigheid in acceptatie van persoonlijkheid en geschiktheid accepteren. Uiteindelijk betogen de auteurs dat het beschermen van de stemmen van kandidaten als een ethische vereiste behandeld moet worden, niet als een sluitpost, en dat toekomstige hulpmiddelen zorgvuldig moeten bepalen welke aspecten van spraak te verbergen en welke te behouden.

Bronvermelding: Mawalim, C.O., Leong, C.W. & Okada, S. Privacy-aware speaker trait and multimodal features relationship analysis in job interviews. Sci Rep 16, 8181 (2026). https://doi.org/10.1038/s41598-026-39322-9

Trefwoorden: spraakanonimisering, AI-werving, sprekerkenmerken, privacy in spraakgegevens, sollicitatiegesprekken