Clear Sky Science · nl

Video-dominante emotieherkenning voor draagbare EEG-apparaten

Waarom uw video’s kunnen weten hoe u zich voelt

Stel je voor dat je een filmtailer bekijkt terwijl een lichtgewicht hoofdband zachtjes je hersenen afluistert en raadt of je je gelukkig, ontspannen, verdrietig of bang voelt. Deze studie onderzoekt hoe dat scenario realistisch te maken is met een klein, draagbaar hersengolvenapparaat (EEG) in plaats van omvangrijke labapparatuur. Het werk is relevant voor iedereen die geïnteresseerd is in slimmere media: van adverteerders die publieksreacties willen begrijpen tot streamingplatforms die programma’s kunnen aanbevelen op basis van hoe kijkers zich daadwerkelijk voelen en niet alleen op wat ze aanklikken.

Gevoelens lezen uit hersengolven

Onze hersenen produceren zwakke elektrische signalen die aan de schedel kunnen worden opgevangen met elektro-encefalografie, of EEG. Deze signalen verschuiven subtiel wanneer we verschillende emoties ervaren. Een veelgebruikt onderzoeksdataset, DEAP genaamd, registreerde iemands EEG terwijl die naar muziekvideo’s keek en vroeg vervolgens om te beoordelen hoe prettig, intens, gecontroleerd en aantrekkelijk elke video aanvoelde. De meeste eerdere studies probeerden de hoogst mogelijke nauwkeurigheid te halen door veel elektroden en krachtige computers te gebruiken, maar onder ideale laboratoriumomstandigheden die niet overeenkomen met het echte leven. Dit artikel stelt in plaats daarvan een praktischer vraag: met een betaalbaar, draagbaar apparaat en minder elektroden, kunnen we nog steeds de belangrijkste emotie vastleggen die een video bij veel mensen oproept?

Een gedeeld emotioneel verhaal vinden

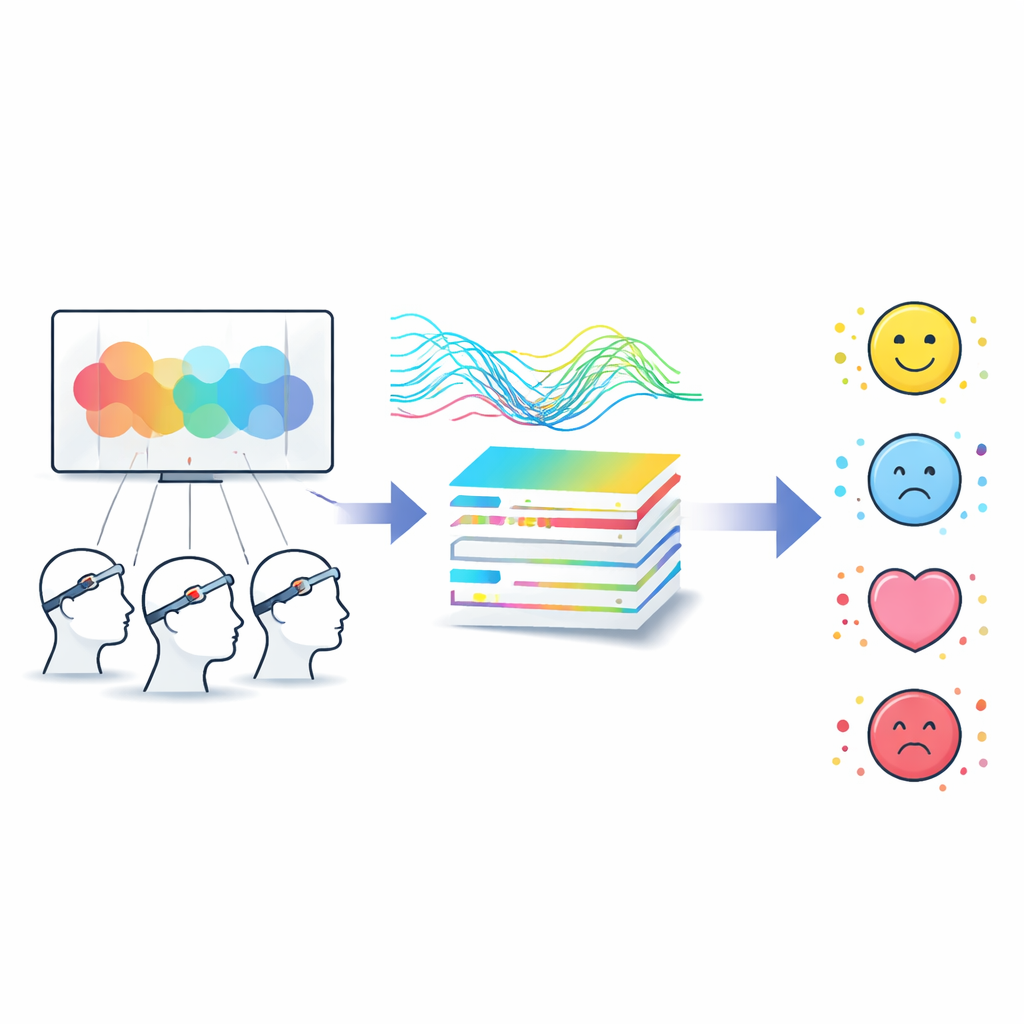

Een obstakel is dat mensen hun gevoelens niet op dezelfde manier beschrijven. Twee kijkers kunnen dezelfde clip zien, de een “opwindend” noemend en de ander “gewoon oké.” De onderzoekers gaan hiermee om door een stapsgewijs labelkalibratiesysteem te bouwen dat patronen over kijkers heen zoekt in plaats van op de beoordeling van één persoon te vertrouwen. Eerst worden alle beoordelingen op een gemeenschappelijke schaal gezet en samengeperst tot een paar sleutelafmetingen. Daarna groepeert unsupervised clustering vergelijkbare emotionele reacties, met als doel de video's in vier brede hoeken van de emotieruimte te verdelen: blij (prettig en intens), ontspannen (prettig en kalm), angstig (onprettig en intens) en verdrietig (onprettig en kalm). Een laatste verfijningsstap schuift onzekere gevallen bij op basis van extra beoordelingsinformatie, wat leidt tot een dominante emotielabel voor elke video dat de algemene indruk van de groep beter weerspiegelt.

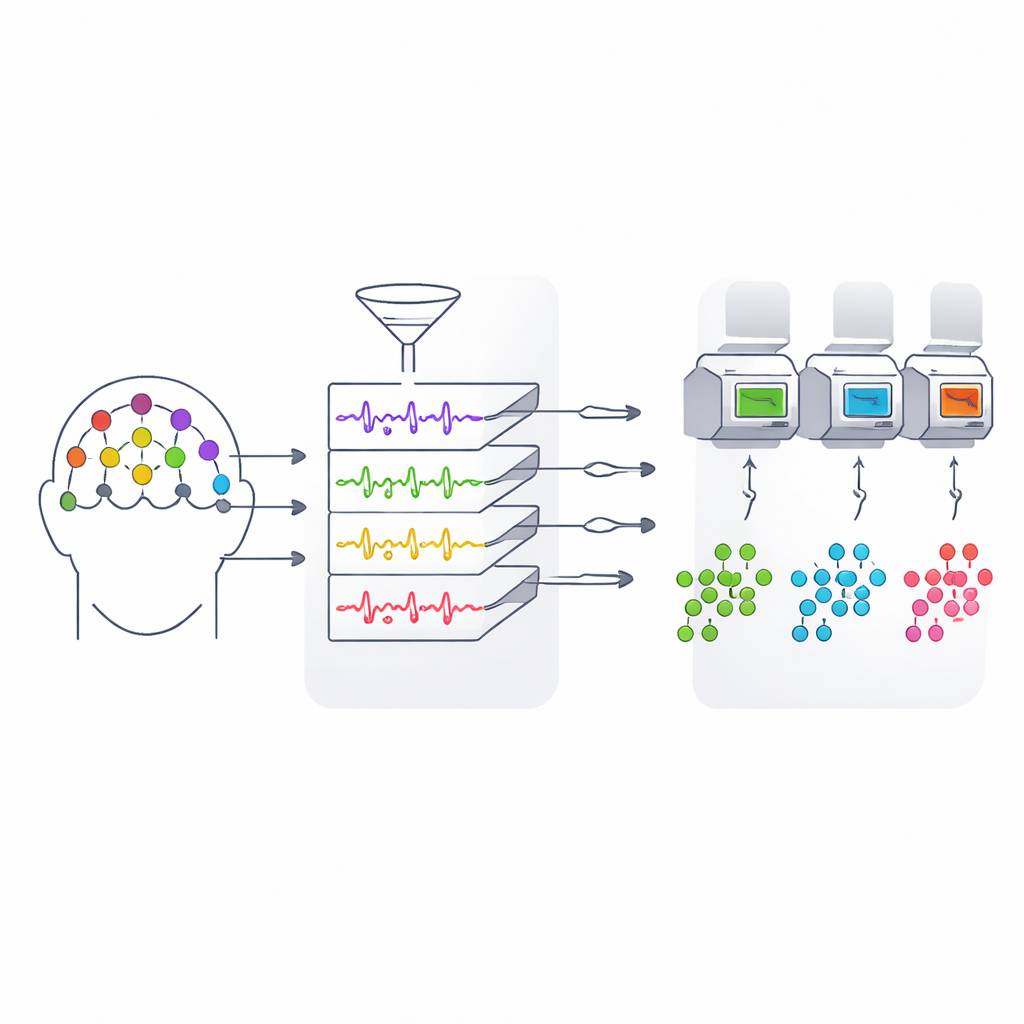

Meer bereiken met minder hardware

Een andere uitdaging is de hardware: volledige EEG-mutsen met 32 of meer elektroden zijn onhandig en duur. Het team ontwikkelt een manier om dit terug te brengen tot slechts 11 zorgvuldig gekozen locaties over het voorhoofd, midden, zijkanten en de achterkant van het hoofd — gebieden die verband houden met emotionele regulatie, opwinding, gehoor, zicht en aandacht. Vervolgens voeren ze een gedetailleerde analyse uit van hoe signaalenergie zich verspreidt over klassieke hersengolfbanden (van langzaam tot snel) onder verschillende emotionele toestanden. Door deze patronen te vergelijken, tonen ze aan dat bepaalde combinaties van frequenties en schedellocaties bijzonder sterke aanwijzingen bevatten over of een kijker bijvoorbeeld sterk opgewekt of juist diep ontspannen is. Deze multi-band energieratio-benadering stelt hen in staat de meest informatieve signalen te behouden en veel redundantie weg te laten.

De data laten zien wat belangrijk is

Zelfs met minder elektroden bevat elke seconde opname een stortvloed aan getallen. Om te voorkomen dat de modellen worden overspoeld, combineren de auteurs meerdere typen kenmerken — zoals wavelet-gebaseerde energiematen, hoe sterk verschillende hersengebieden samen fluctueren, en hoe het vermogen in verschillende frequenties in de loop van de tijd verandert — in een rijk maar gestructureerd beeld van elke kijkbeurt. Een saliency-gestuurde selectiestap rangschikt deze kenmerken vervolgens op hoe behulpzaam ze zijn om emoties te onderscheiden, en behoudt slechts een compacte subset. Met deze ingedikte representatie worden drie standaard machine learning-modellen getraind om te herkennen welke van de vier dominante emoties het beste bij een gegeven video past. In veeleisende tests waarbij het systeem moet generaliseren naar volledig nieuwe mensen, bereikt het beste model ongeveer 45% nauwkeurigheid — een degelijk resultaat voor een keuze uit vier opties met rumoerige hersengegevens en slechts 11 kanalen.

Wat dit betekent voor alledaagse technologie

Voor niet-specialisten is de kernboodschap dat we kunnen beginnen te peilen hoe groepen mensen zich voelen bij video’s met behulp van kleine, draagbare hersengolfapparaten in plaats van volledige laboratoriummaterialen. Door de emotielabels te zuiveren, te focussen op de meest informatieve delen van het EEG-signaal en slechts een handvol goed geplaatste sensoren te selecteren, laten de auteurs zien dat het mogelijk is de dominante emotionele toon van een video — blij, ontspannen, angstig of verdrietig — over kijkers heen te detecteren. Het systeem is niet perfect, maar het wijst de weg naar praktische hulpmiddelen voor publieksstemingsanalyse, contenttesting en emotie-gevoelige aanbevelingen die steunen op objectieve hersenreacties in plaats van alleen enquêtes of klikken.

Bronvermelding: Wen, X., Xu, W., Tian, L. et al. Video-dominant emotion recognition for portable EEG-based devices. Sci Rep 16, 7899 (2026). https://doi.org/10.1038/s41598-026-39315-8

Trefwoorden: EEG-emotieherkenning, brain–computer interface, video affect-analyse, draagbare neurowetenschap, affectieve computing