Clear Sky Science · nl

Gebruik een groot taalmodel om het redeneren van een ander groot taalmodel te verbeteren via beloningsgeüpdatete GRPO

Machines leren nadenken

Veel van de huidige taalmodellen kunnen chatten, vertalen en vragen beantwoorden, maar ze hebben nog moeite om hun denkwijze te laten zien zoals een goede wiskundestudent of een zorgvuldige analist dat zou doen. Dit artikel onderzoekt hoe het ene kunstmatige-intelligentiesysteem gebruikt kan worden om de redeneervaardigheden van een ander te verbeteren, en hoe dat kan zonder handmatig enorm grote, gespecialiseerde datasets te bouwen. Voor lezers die benieuwd zijn hoe AI betrouwbaarder kan worden in vakgebieden als financiën, geneeskunde of wetenschappelijk onderzoek, biedt het werk een praktische methode om modellen hun antwoorden helderder en consistenter te laten verklaren.

Van ruwe documenten naar lesbare voorbeelden

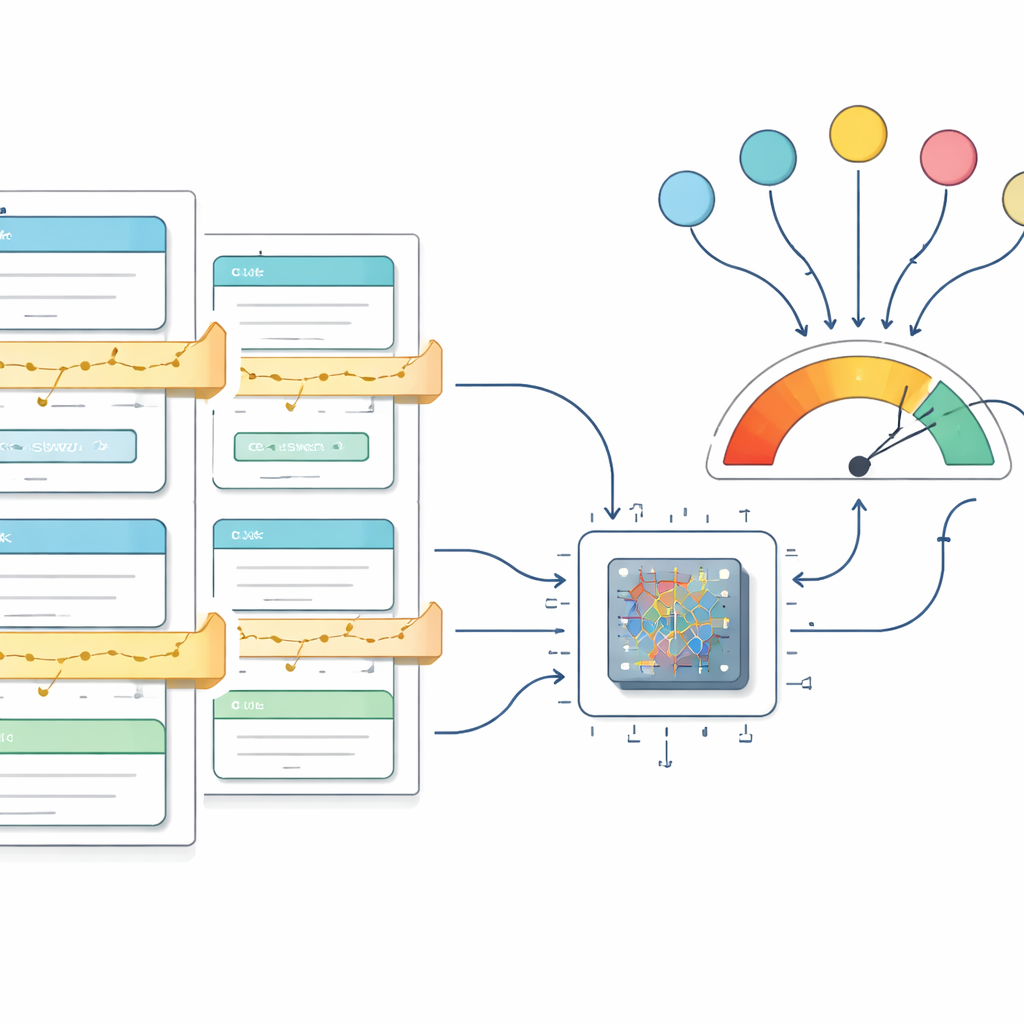

De auteurs vertrekken van een eenvoudige observatie: de meeste informatie in de echte wereld staat in rommelige vormen zoals rapporten, brieven aan aandeelhouders of webpagina’s, niet in nette vraag-en-antwoordvorm. Om die kloof te overbruggen introduceren ze twee softwaretools, Huggify-Data en de CoT Data Generator. Deze tools nemen ongestructureerde tekst en hakken die automatisch in vraag-en-antwoordparen, waarna een krachtig taalmodel gevraagd wordt om de ontbrekende redeneerstappen daartussen te leveren. Het resultaat is voor elk voorbeeld een gestructureerde drievoudige: een vraag, een keten van redenering en een antwoord. Cruciaal is dat deze pijplijn op vrijwel elk domein kan worden gericht, van schoolwiskunde tot bedrijfsfinanciën, waardoor het mogelijk wordt redeneervriendelijke trainingsdata te bouwen zonder legers menselijke annotators.

Hoe het ene model het andere traint

Zodra deze vraag–redenering–antwoord-triplets zijn gemaakt, worden ze gebruikt om een kleiner ‘student’-model te trainen om op dezelfde gestructureerde manier te denken. Van de student wordt niet alleen een eindantwoord verwacht, maar ook een duidelijk gescheiden uitleg gevolgd door de conclusie. De training wordt gestuurd door een methode die Group Relative Policy Optimization heet, die meerdere kandidaatreacties op dezelfde vraag vergelijkt en het model in de richting van betere antwoorden duwt. Het artikel werkt deze methode bij met een extra beloningsterm die controleert of de uitvoer van het model het gewenste formaat volgt, tot en met hoe nauwkeurig het overeenkomt met een goedgevormd referentievoorbeeld. Deze beloning pakt scrambled of onvolledige uitleg zachtjes af, waardoor het model naar nette, interpreteerbare antwoorden wordt geleid.

De aanpak op de proef stellen

Om te onderzoeken of het raamwerk in de praktijk werkt, passen de auteurs het toe op twee zeer verschillende datasets. De eerste, GSM8K, bestaat uit basisschoolwoordproblemen die meerstaps rekenkundig redeneren vereisen. De tweede is opgebouwd uit Warren Buffetts jaarlijkse brieven aan aandeelhouders, waarbij het doel is lange, uitgebreide redeneringen over investeren en bedrijfsbeslissingen vast te leggen. In beide gevallen zet de pijplijn ruwe tekst om in gestructureerde trainingsdata en wordt een middelgroot model genaamd Qwen 2.5 fijngetuned. Tijdens het trainen beloont een eenvoudige scoreregel correcte, goed opgemaakte reacties; naarmate het leren vordert, stijgt de gemiddelde beloning gestaag en stabiliseert zich op het theoretische maximum, wat toont dat het model het doelgedrag op de trainingsdata grotendeels heeft beheerst.

Hoe goed het verbeterde model presteert

De prestatie wordt gemeten met “gemiddelde tokennauwkeurigheid”, wat ruwweg vraagt welk deel van de kleine tekststukjes (tokens) in de uitvoer van het model overeenkomt met de verwachte. Hoewel dit verschilt van de gebruikelijke alles-of-niets beoordeling van testantwoorden, is het goed geschikt om te oordelen of uitleg en antwoorden in de juiste structuur worden geproduceerd. Op GSM8K bereikt het beste model 98,2 procent tokennauwkeurigheid, en op de Buffett-brieven 98,5 procent. Deze scores liggen hoger dan die gerapporteerd voor algemeen bekende systemen zoals GPT‑4 en Claude 3.5 Sonnet volgens dezelfde metriek, terwijl er slechts een model met 3 miljard parameters wordt gebruikt dat in minder dan twee dagen op gehuurde hardware getraind kan worden. De auteurs delen ook details over rekenkosten en hardwareconfiguraties, en publiceren alle code, modellen en datasets zodat anderen ze kunnen inspecteren en verder uitbouwen.

Wat dit betekent voor dagelijks AI-gebruik

Voor niet-specialisten is de belangrijkste conclusie dat AI-systemen niet alleen geleerd kunnen worden om te antwoorden, maar om te antwoorden op een gedisciplineerde, makkelijk te volgen manier, met behulp van data die automatisch uit gewone documenten is geëxtraheerd. Door een redeneerrijk leermeestermodel te combineren met een flexibele datapijplijn en een beloningssysteem dat zowel correctheid als helderheid waardeert, laten de auteurs zien hoe kleinere modellen gevormd kunnen worden tot betrouwbaardere probleemoplossers. Hoewel ze beperkingen benoemen—zoals de behoefte aan sterkere tests voor echte begripsvorming en veiligheid—wijst het raamwerk op een toekomst waarin organisaties hun eigen tekstarchieven kunnen omzetten in op maat gemaakte, transparante AI-assistenten voor onderwijs, financiën en verder.

Bronvermelding: Yin, Y. Use large language model to enhance reasoning of another large language model through reward updated GRPO. Sci Rep 16, 8360 (2026). https://doi.org/10.1038/s41598-026-39296-8

Trefwoorden: grote taalmodellen, chain-of-thought redenering, beloningsoptimalisatie, data-curatie, domeinspecifieke AI