Clear Sky Science · nl

Een vergelijkende analyse van ingebedde chatbotmodellen en ChatGPT-4 voor het beantwoorden van vragen over orthodontische behandeling

Waarom slimere chatbots belangrijk zijn voor beugels

Iedereen die een beugel heeft gedragen weet dat vragen niet wachten tot de openingstijden van de kliniek: stopt deze pijn ooit? Mag ik dit eten? Moet ik me zorgen maken over mijn kaak? Deze studie onderzoekt of een doelgericht orthodontisch chatbot — specifiek ontworpen om deze alledaagse vragen te beantwoorden — duidelijke en betrouwbaardere antwoorden kan geven dan een algemeen kunstmatig-intelligentiesysteem, ChatGPT‑4. Het werk biedt een inkijkje in hoe zorgvuldig op maat gemaakte AI‑hulpmiddelen zowel patiënten als behandelaren in moderne tandheelkundige zorg zouden kunnen ondersteunen.

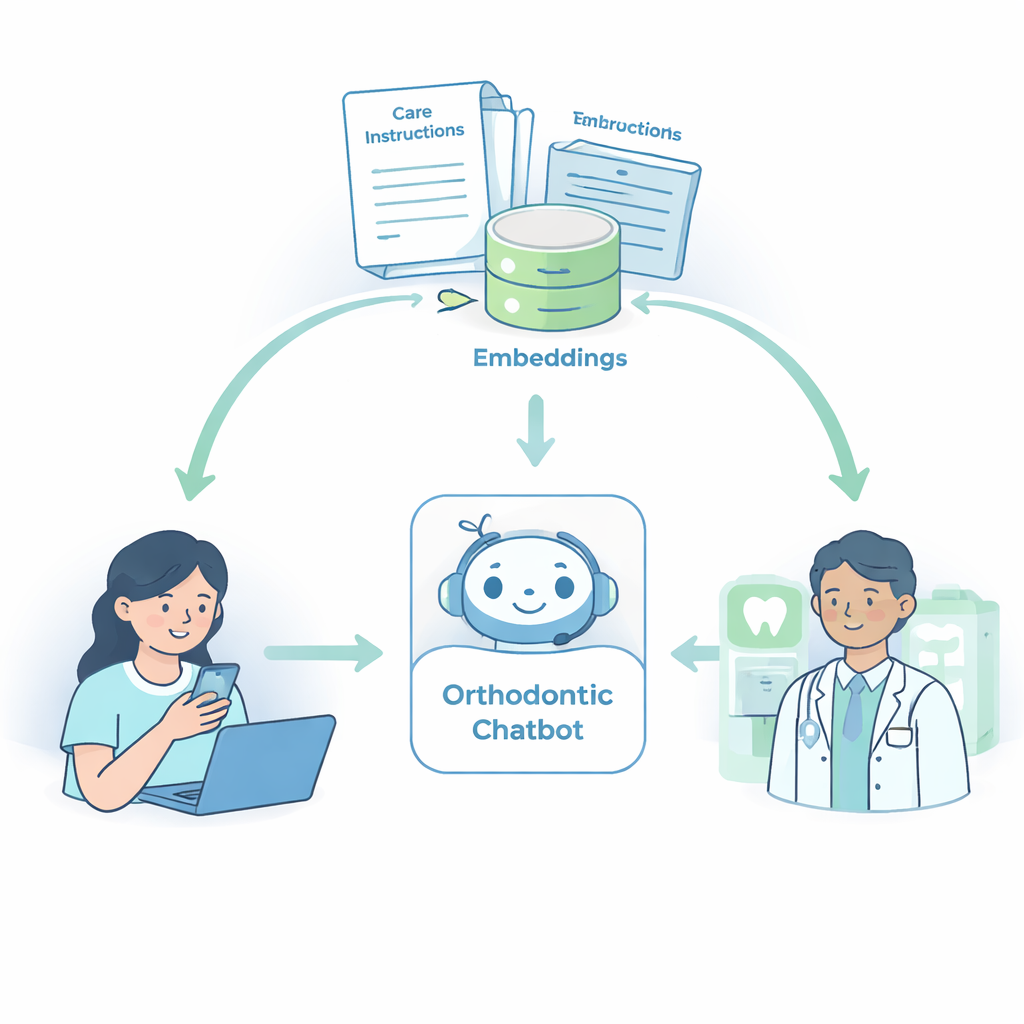

Een chatbot die alleen voor beugelvragen is gebouwd

De onderzoekers ontwikkelden een ingebedde chatbot die zich uitsluitend richtte op orthodontische behandelingen. In plaats van een nieuwe AI vanaf nul te trainen, koppelden ze een geavanceerd taalmodel aan een zorgvuldig samengestelde bibliotheek van patiëntmateriaal en belangrijke fragmenten uit leerboeken. Deze bibliotheek bevatte folders van de British Orthodontic Society over onderwerpen als mondhygiëne, voeding, verzorging van apparatuur, elastieken en retainers, samen met korte toelichtingen uit gangbare orthodontische leerboeken. Met behulp van een techniek die retrieval‑augmented generation heet, doorzocht het systeem deze bibliotheek op relevante passages telkens wanneer een vraag werd gesteld en gebruikte die passages om het antwoord te vormen, met als doel te spiegelen wat een patiënt zou horen tijdens een typische uitleg aan de stoel.

Hoe de studie de twee systemen testte

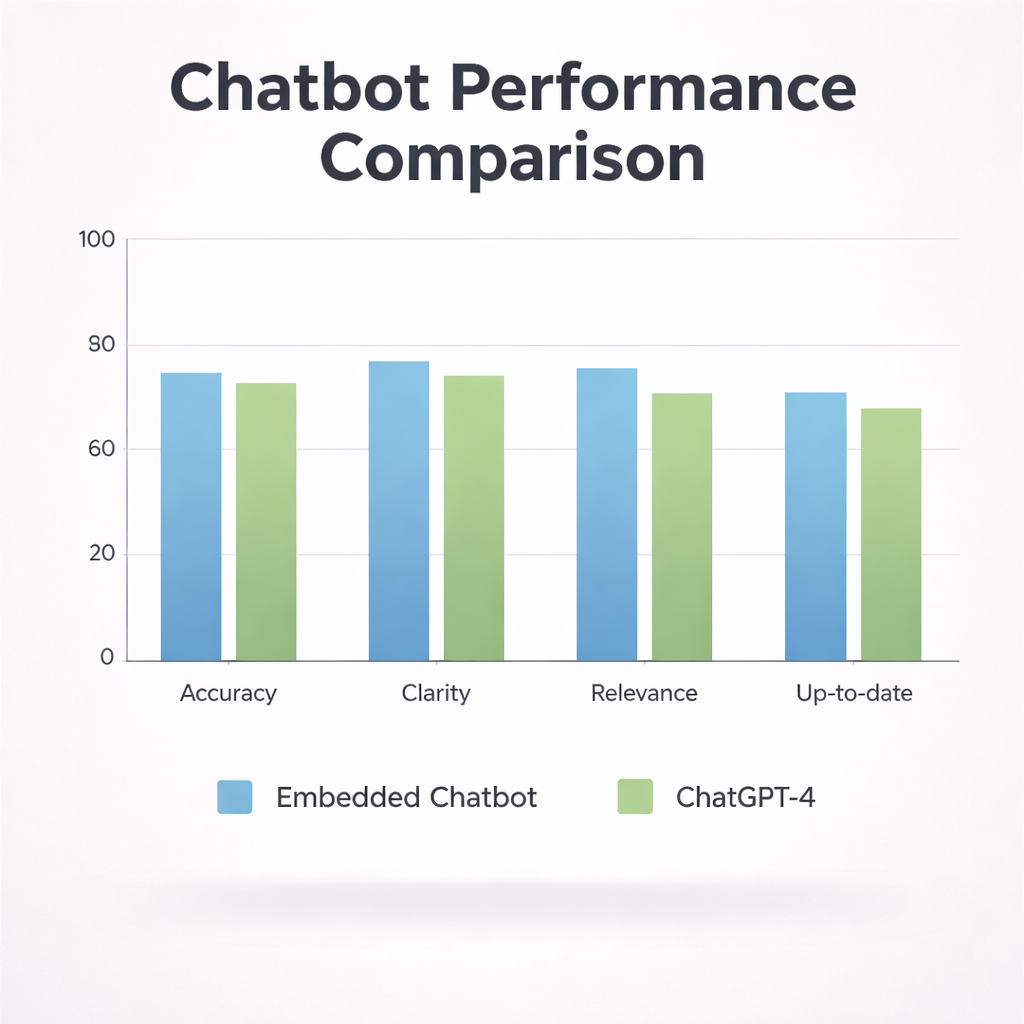

Om te zien hoe goed deze gespecialiseerde chatbot presteerde, vergeleek het team hem met ChatGPT‑4, gebruikt op de gebruikelijke manier via de ChatGPT Plus‑interface. Ze stelden 30 praktijkgerichte vragen samen die patiënten vaak stellen voor, tijdens en na de beugelbehandeling — bijvoorbeeld of een beugel pijn veroorzaakt, hoe die spreken of zingen beïnvloedt, hoe vaak controles nodig zijn en of een beugel kan helpen bij kaakgewrichtsklachten. Beide systemen kregen dezelfde prompts, met de instructie te antwoorden als een orthodontisch expert in duidelijke, voor patiënten toegankelijke taal. Zes ervaren orthodontische consulenten beoordeelden vervolgens elk geanonimiseerd antwoord op vier aspecten: juistheid, duidelijkheid, relevantie voor de vraag en hoe actueel de informatie leek, met behulp van een vijfpuntschaal.

Kwaliteit meten, niet alleen indrukken

In plaats van te vertrouwen op algemene indrukken, gebruikten de onderzoekers een gestructureerde beoordelingsmethode genaamd de Content Validity Index. Voor elke vraag en elk kwaliteitsaspect telden ze hoeveel experts een antwoord als “eens” of “volledig eens” beoordeelden en zetten dat om in een score tussen nul en één. Hoge scores betekenden dat de meeste experts vonden dat het antwoord accuraat, duidelijk, relevant of actueel was. Ze berekenden ook gemiddelden over alle vragen om te zien hoe elk systeem overall presteerde. Statistische toetsen werden toegepast om te controleren of eventuele verschillen tussen de twee chatbots groot genoeg waren om als betekenisvol te gelden in plaats van toeval.

Wat de orthodonten van de antwoorden vonden

De ingebedde chatbot kwam over het algemeen als winnaar uit de bus. Ongeveer driekwart van zijn antwoorden bereikte een aanvaardbare kwaliteitsdrempel, vergeleken met iets meer dan de helft van de antwoorden van ChatGPT‑4. Gemiddeld scoorde de gespecialiseerde chatbot beter op juistheid, duidelijkheid en relevantie, en leek hij ook iets dichter bij de actuele richtlijnen te zitten. Bijvoorbeeld bij het uitleggen van pijn tijdens de beugelbehandeling of of een beugel het spreken beïnvloedt, waren zijn antwoorden helder, concreet en goed afgestemd op standaard patiëntadviezen. Daarentegen waren de antwoorden van ChatGPT‑4, hoewel vaak redelijk, geneigd algemener en soms technischer te zijn, wat de duidelijkheid volgens de experts kon verminderen. Wanneer de onderzoekers echter formele statistische toetsen uitvoerden, waren de verschillen tussen de twee systemen niet groot genoeg om als statistisch significant te gelden.

Beperkingen en lessen voor toekomstige AI in de kliniek

De studie toonde ook aan dat zelfs experts niet altijd overeenstemmen over wat het “beste” antwoord is. De algemene overeenstemming tussen de orthodonten was zwakker dan verwacht, vooral voor subjectieve aspecten als duidelijkheid en relevantie. De onderzoekers noemden nog enkele andere beperkingen: ze bestudeerden slechts twee AI‑opstellingen, betrokken geen patiënten rechtstreeks en baseerden hun gespecialiseerde chatbot op een specifieke set schriftelijke bronnen. Toch voegt hun werk toe aan groeiend bewijs dat AI‑systemen veel voorkomende tandheelkundige vragen redelijk goed kunnen beantwoorden, en dat het toevoegen van gerichte, actuele referentiematerialen de prestaties kan verbeteren.

Wat dit betekent voor mensen met een beugel

Voor patiënten is de conclusie bemoedigend maar voorzichtig. Een goed ontworpen, op orthodontie gerichte chatbot kan heldere, betrouwbare antwoorden geven op veel alledaagse vragen en kan de onzekerheid tussen afspraken verminderen. Tegelijk laat deze studie zien dat zo’n hulpmiddel nog niet de behoefte aan professionele beoordeling of persoonlijk advies vervangt. De echte belofte ligt in het combineren van deze op maat gemaakte AI‑hulpen met deskundige zorg, zodat mensen met een beugel snel en begrijpelijk informatie kunnen krijgen, terwijl ze voor definitieve beslissingen blijven vertrouwen op hun orthodontist.

Bronvermelding: Khalil, R., Amin, L., Sukhia, R.H. et al. A comparative analysis of embedded chatbot models and ChatGPT-4 for answering orthodontic treatment queries. Sci Rep 16, 7776 (2026). https://doi.org/10.1038/s41598-026-39263-3

Trefwoorden: orthodontische chatbot, tandheelkundige AI, vragen over beugels, patiëntenvoorlichting, vergelijking met ChatGPT